大家好,我是右兜。

巴克莱银行发布了一份关于人工智能下一个方向的研报。

标题是“人工智能下一步发展方向?向推理和代理的‘大转变’”。

他们提出了一个核心观点:AI行业正在从单纯的模型扩展转向推理和代理的“大转变”。这到底意味着什么?会对技术、算力和投资带来哪些影响?

今天我们就来拆解这份报告,一起看看AI的未来会走向何方!

首先,我们得聊聊这个“大转变”是什么意思。

报告指出,AI行业正在加速发展,尤其是自从OpenAI发布了o1推理模型,以及DeepSeek推出了V3和R1之后,整个行业的节奏明显变快了。

现在的焦点不再只是把模型做得越来越大,而是转向两个方向:在应用层面发展“代理”(Agents),在模型层面提升“推理能力”(Reasoning)。

这就像是从堆硬件转向教AI如何思考和行动。报告里有一句话说得特别到位:“应用层向代理的转变和模型层向推理的转变,将对底层技术和算力需求产生深远影响。

那这两种能力具体是什么呢?

简单来说,代理就是让AI能独立完成任务,比如帮你订票、写代码甚至做研究;而推理则是让AI能像人一样一步步思考,而不是直接给个答案。这两者结合起来,可能会彻底改变我们对AI的期待。

报告提出了两种可能的未来情景。第一种叫“Chinchilla Scaling继续”,也就是AI模型继续按照“每一代增大10倍、训练成本增加10倍”的规律发展。

如果是这样,对芯片、网络设备这些AI系统组件的需求会持续爆炸式增长,而像亚马逊、谷歌这样的超大规模云计算提供商(hyperscalers)就得不停砸钱升级设备。

第二种情景叫“扩展停滞”,或者说是“大转变”。

报告假设在GPT-5这个级别的模型之后,预训练的扩展可能会停下来,行业会把重心转向推理模型,用新的后训练技术和测试时计算来提升性能。

举个例子,OpenAI的GPT-4.5基准测试似乎暗示这种趋势,但未来还可能有变数。如果真是这样,预训练的算力需求会在2026年趋于平稳,而推理计算的成本会比之前预测的低很多,因为最先进的模型不会再盲目追求“大”。

不过,AI实验室也不会闲着,他们可能会专注于15万亿参数左右的基础模型,然后在架构和推理计算上玩出新花样。

这两种情景对投资有什么启发呢?

报告给了我们一些策略建议。如果Chinchilla Scaling继续,那就跟过去两年一样:长期持有芯片和网络设备公司,比如英伟达(NVIDIA)、博通(Broadcom),但要小心那些需要不停烧钱的云计算巨头。

反过来,如果扩展停滞成真,那就该看好云计算提供商,因为他们的自由现金流会回升。同时,随着推理成本下降,应用类股票——尤其是那些直接面向用户的公司——可能会跑赢大盘。

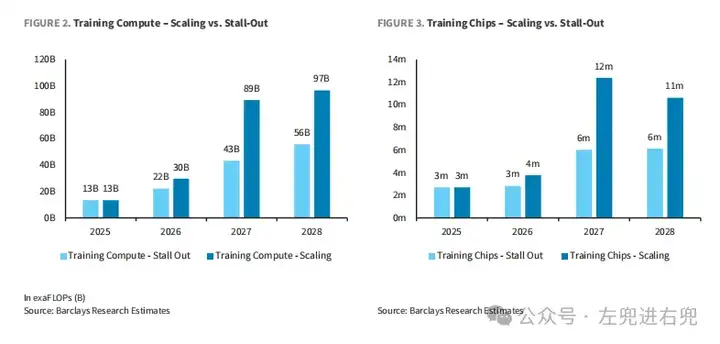

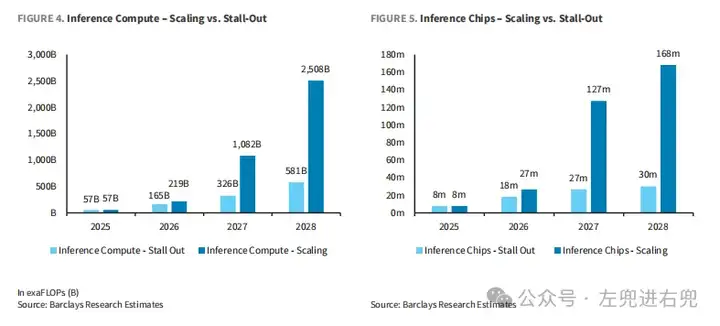

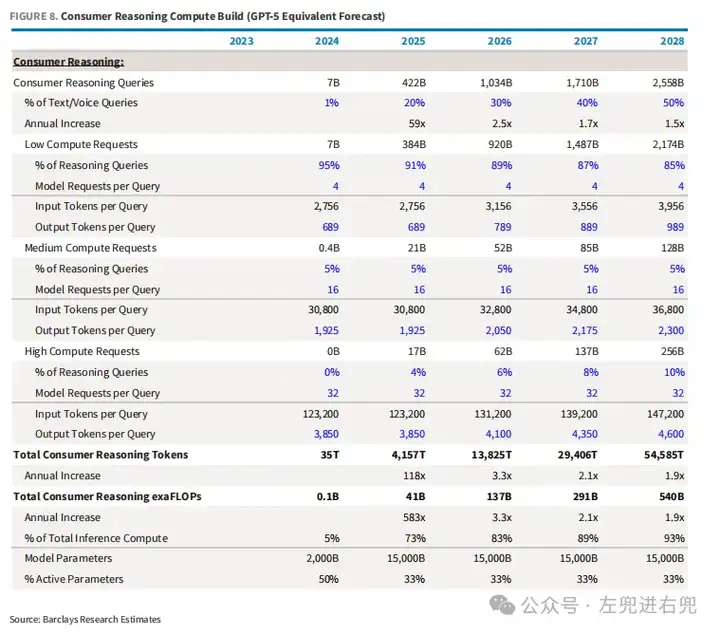

更有意思的是,这个“大转变”可能会大幅降低算力预测。如果扩展继续,到2028年训练和推理所需的总算力可能是停滞情景的4倍。但即使是停滞情景,到2028年行业还是得花超过1万亿美元来满足算力需求,而且还会有2500亿exaFLOPS的缺口。

接下来,我们聊聊开源AI。

报告提到,开源模型发展得比专有模型还快。比如Hugging Face的Llama系列已经有近10万个分支,下载量超8亿次,DeepSeek也差不多。

不过,微调这些开源模型的成本只占原始训练成本的15%-20%。比如Llama 3.1全套训练成本是8000万美元,DeepSeek V3更低。

所以,开源目前还不足以撼动行业算力的总格局。相比之下,GPT-4.5或Claude 4的训练成本可能相当于1000多个开源模型,差距还是很明显的。

再说说AI应用的爆发。

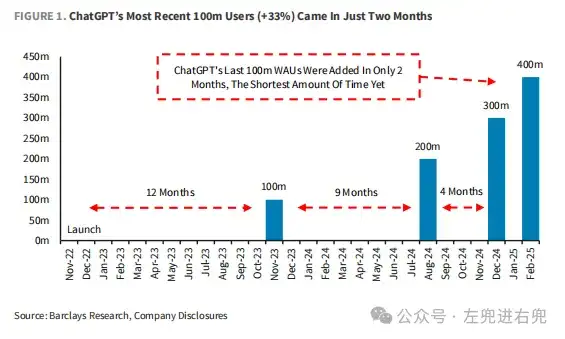

ChatGPT最近两个月新增了1亿用户,增长33%,是两年来最快的速度。报告认为,这跟推理模型(比如o1、o3)、Deep Research、多模态能力和iOS集成都有关系。消费者和企业对AI的需求正在起飞,巴克莱也因此上调了对AI应用的预测。

而推理模型和代理显然是未来的关键。所有大厂——OpenAI、Anthropic、Google DeepMind——都在抢着造推理模型。这些模型训练成本低,因为是在现有基础模型上微调,而且还能用“思维链”(Chain of Thought)技术,通过多步推理提高准确性。

比如,一个复杂问题,模型会把它拆成几步,每步跑一遍,最后再检查答案。这种方法虽然算力需求高,但效果好得多。

说到算力,报告估计到2028年推理需求会增长4倍,占行业总算力的一半以上。但现在装机容量完全跟不上。领先的云计算提供商2025年的加速器支出大概是1000亿美元,占总资本支出的三分之一,但这可能还不够。

另外,开源AI虽然火,但还没吃掉太多算力。倒是推理模型的崛起可能会让行业重新思考算力分配。预训练可能正在接近收益递减的临界点,因为高质量训练数据不够用了。未来,算力会更多地从预训练转向后训练和推理。

最后,报告还提到了一些新趋势。比如混合专家模型(MoE),它只激活一部分参数,能大幅降低每个token的计算成本。

还有递归自提升——模型自己迭代自己,理论上只要算力够,就能无限进化。英伟达CEO最近也提出了“从一个到三个扩展规律”:预训练、后训练和测试时扩展。AI的下一波浪潮才刚开始,OpenAI的o1到o3只用了3-4个月,Google的Gemini 2.0、Grok 3、DeepSeek R1都在加速迭代。

对消费者来说,推理产品像“Deep Research”已经崭露头角,虽然现在还藏在ChatGPT Pro和Gemini Advanced里,但未来潜力巨大。

总结一下,AI行业正从“越大越好”转向“更聪明更好”,推理和代理是未来主角。不管是Chinchilla Scaling继续,还是扩展停滞,对算力和技术的需求都只会增不会减。想了解更多细节,可以圈子里查看巴克莱的英文原文完整报告看看。

文章来自于“左兜进右兜”,作者“右兜”。

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner