“史上最强视觉生成模型”,现在属于快手。

一基双子的可灵AI基础模型——文/图生图的可图、文/图生视频的可灵,都重磅升级到2.0版本。

新版本当中,两款模型的语义遵循能力和美学能力均大幅提升,还新增了图像编辑、风格转绘等一系列新功能。

并且一如既往坚持不搞期货,发布会一结束,两款模型及新功能就立即上线可用。

模型发布后,也引发国内外广泛讨论,就连马斯克也在X上连夜关注了可灵AI官方账号。

模型发布后,也引发国内外广泛讨论,就连马斯克也在X上连夜关注了可灵AI官方账号。

在过去,MidJourney生图+可灵图生视频是一种常用的创作工作流。

但随着可图的全新升级,创作者们可以告别MidJourney,在可灵AI的平台内完成这一系列操作了。

相比前一代模型,可图2.0基础模型的第一个亮点,就是语义遵循能力大幅提升,具体又可以分为三个方面——

复杂元素响应更精准、镜头语言设计更合理、画面细节表现更丰富。

话不多说,直接看案例:

黑白照片,少女照镜子,镜子里映出她老年的样子,写实摄影,左右对比,侧面构图,电影光照,一位白裙少女正在一个复古圆镜前照镜子,伦勃朗光照,景深摄影。

这组提示词设置了“现实”中的少女样貌和镜子中老年形象的反差,这样的场景是一种艺术设计,在真实世界中并不存在。

即便如此,可图2.0还是按照提示词中的要求完成了创作,构图、颜色等设置也都满足提示词要求。

相比之下,前一代生成的图片,除了确实有一位少女和一个镜子之外,和提示词几乎没有什么关联。

再看第二组。

春节,爷爷奶奶,爸爸妈妈,1个男孩,5个人其乐融融的互相聊天,桌上的菜肴丰富。

这个设定看似简单,但实际上想要让准确呈现人或物体的数量,一直以来都不是一件容易的事。

但可图2.0的作品当中,人物的数量,以及人和人之间的关系,都完美契合了提示词的要求。

而前一代产品,四张图无一例外地出现了6个甚至更多的人物,性别和年龄设定就更随意了。

内容和细节之外,可图2.0对提示词中的构图、光线和景别设定的响应,也变得更加精准。

一位盘着浅色毛衣发髻的绝美的东方女性背对镜头,倚坐在木质窗边的扶手椅上,手中的书本在自然光下泛着柔和的纸页光泽。她的姿态松弛而专注,浅色长裙垂落椅边,与窗外险峻的雪山形成奇妙呼应——远处峰峦正被夕阳染成熔金般的色彩,雪线与蓝天交界处泛起淡紫的暮霭,粗犷的自然景观透过玻璃窗框,化作室内暖色空间里一幅流动的油画。窗台上冒着水珠的玻璃瓶和摇曳的烛火,在木纹窗台投下细长的光影,昏暗的室内环境,极简,大面积留白,影视化构图,光影美学,梦核,迷惑,丰富的细节,逼真,忧郁,悲伤,朦胧,模糊,虚焦,逆光,摄影,宝丽来风格。

在翻译行业里,能否做到“信、达、雅”是衡量结果质量的常用标准,放到AI绘图当中,这套标准也同样适用。

因为AI绘图,也可以看做是从文本到视觉信息的一种“翻译”。

如果说对指令的遵循体现了“信”和“达”,那么可图2.0的“电影美学表现”,就是在向着“雅”的层次迈进。

来看实测效果。

电影质感,下午一位穿浅色衣服的亚洲男人站在路边打电话,前景有绿色汽车飞速驶过。光影柔和。参考《重庆森林》电影质感。

电影感,参考《赎罪》风格,树林里光线明暗交替,一个女生拿着花束,穿着法式绿色纱裙在树林中奔跑,她飘逸的卷发随风飞舞,中景,动态模糊。

可以看出,可图2.0在勾勒电影质感时,运用了更高级的色彩及光影,使得情绪表达更具感染力。

另外可图2.0也进行了多风格化相应,支持近百种风格,无论是古典还是现代、写实还是夸张、实拍还是动漫都能搞定,包括GPT-4o带火的吉卜力风也能生成。

白衣剑客动态姿势,丝质长袍飘动,剑锋直指前方。背景悬浮万剑阵列呈几何矩阵排列,冷钢质感伴随青蓝刃光。金色光粒子在气流中旋绕,柔和的体积光照。强烈明暗对比搭配轮廓光强化肌肉线条。纯黑虚空背景增强景深对比。超精细8K渲染,ZBrush级布料雕刻纹理,Octane金属反射材质。剑身雾气效果含次表面散射。构图融合天野喜孝幻想美学、Greg Rutkowski电影级打光与《剑灵》概念设计元素。

新海城风格,穿着运动装的少女在霓虹闪烁的都市街道上疾速奔跑,飘动的长发掠过街边玻璃橱窗倒影,交通信号灯在暮色中切换成流动的光带,背包上的挂饰随着步伐晃动,柏油路面蒸腾着雨后水汽,广告牌与电子屏的光斑交织成迷离的背景光晕。

不仅模型,可图这次更新也增加了两大全新功能——风格转绘和图片编辑。

下面的这12张图,就是由同一张图片,搭配不同风格提示词,使用可图转绘而成的。

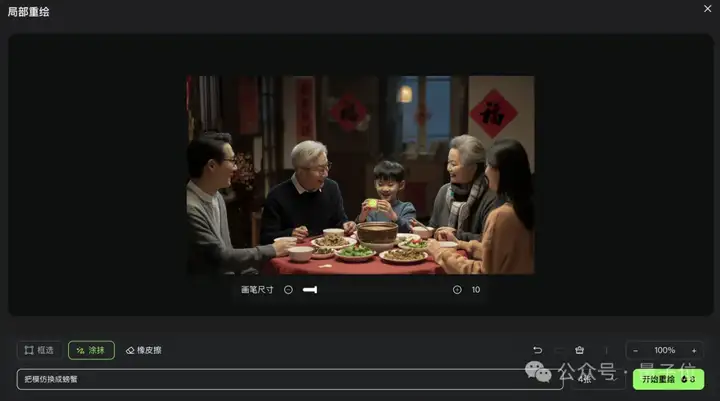

而图片编辑具体包括了局部重绘和扩图两个方面。

有了局部重绘,不仅可以对现实中的图像进行修改,当得到一张风格特别好但细节有瑕疵的图片时,也不用再从头开始“抽卡”了。

比如想要把前面展示的年夜饭照片中小男孩手里的魔方换成螃蟹,就可以框选或涂抹目标区域,然后提出修改要求,就可以等待成果了。

生成的结果是这样,完成了选中部分的重绘要求,同时未选择的部分没有任何变动。

在扩图功能中,既可以把自己的想法交给可图实现,也可以什么也不说,给定一个比例,让可图自行发挥想象。

△扩图结果,无提示词

当然,可图2.0的局部重绘和扩图并不局限于上面的传统用法,创作者可以充分发挥想象力,创造出别具一格的作品。

这里就用一个例子抛砖引玉,更多的玩法就交给创作者们自行探索了~

在可图模型和功能全面上新的背后,是可灵大模型团队做出的一系列技术创新。

首先是利用全新升级的文本表征处理链路,精准建模预训练文本到视觉表征的映射,这正是可图2.0语义遵循能力提升的关键。

可图2.0还采用了自适配图像Caption构建策略,显著提升了各阶段的学习效率。

此外,可灵大模型团队还在探索后训练阶段的Scaling Law,对数据体系和多样性进行了全面升级,并应用全新提示词工程和去噪策略,从而提升模型的表现力。

可图的升级,既是为了更好满足图像创作者的需求,也是为了给视频创作者提供更好的素材获取途径。

发布会上,快手副总裁、可灵AI负责人张迪介绍,在使用可灵生成视频的用户当中,有85%使用的是图生视频。

但其中涉及到的图片素材,不一定是拍摄或手绘而成,也可能包括生成结果。

相比于完全由文字生成视频,图片能够体现出文本无法精准描述的细节,从而让视频生成模型对目标的把控更加清晰。

因此,这种“曲线救国”的方式,可以降低视频生成结果的不确定性,减少试错成本,因此受到了用户的青睐。

这样看来,可灵AI团队不断打磨图像生成模型的目的,就显而易见了。

当然除了可图,视频生成模型可灵也进行了升级,针对之前指令遵循不好、动态效果不佳、美感缺乏的问题做出了全面升级。

可灵2.0对比谷歌Veo2的胜负比为205%,对比Sora的胜负比达367%,在文字相关性、画面质量、动态质量等维度上显著超越对手。

模型与产品升级之外,快手也在探索一种人与AI之间的新型交互方式。

快手高级副总裁盖坤表示,文字在表达影像信息时是不完备的,我们需要探索新的方式,才能让人真正精准地表达出心中所想。

所以在本次发布会上,可灵AI正式发布AI视频生成的全新交互理念——多模态视觉语言(Multi-modal Visual Language,MVL)。

MVL让用户能够结合图像参考、视频片段等多模态信息,将脑海中包含身份、外观、风格、场景、动作、表情、运镜在内的多维度复杂创意,直接高效地传达给AI。

基于MVL这一全新交互方式,可灵2.0大师版全面升级了视频及图像创作可控生成与编辑能力,上线了全新的多模态视频编辑功能。

加上之前已有的提示词优化、音效生成、对口型等一系列功能,快手已经初步构建出了从创意到视觉呈现的完整创作链路。

这不仅让专业创作者能够精准还原脑海中的艺术构思,更让普通用户通过“所见即所得”的交互逻辑释放创作潜能。

发布会上,盖坤再一次讲到了可灵的愿景——让每个人都能用AI讲出好故事。

自去年6月发布以来,可灵AI已累计完成超20次迭代,累计生成1.68亿段视频和3.44亿张图片素材。

在这一过程当中,可灵AI一直坚守初心,不断提升模型基础质量和模型效果,并引入更多创新功能,以满足用户的多样化需求。

包括可图和可灵2.0版本升级,以及MVL的提出,同样是在扫清“用AI讲好故事”的道路上的障碍。

可灵越来越完备的产品体系和工作链路,正在让AI创作变得愈加触手可得。

甚至为了帮助不懂提示词的纯小白用户完成创作,可灵还在Web和APP当中接入了经过专门为设计提示词而调整的DeepSeek模型,进一步降低了AI视频创作的门槛。

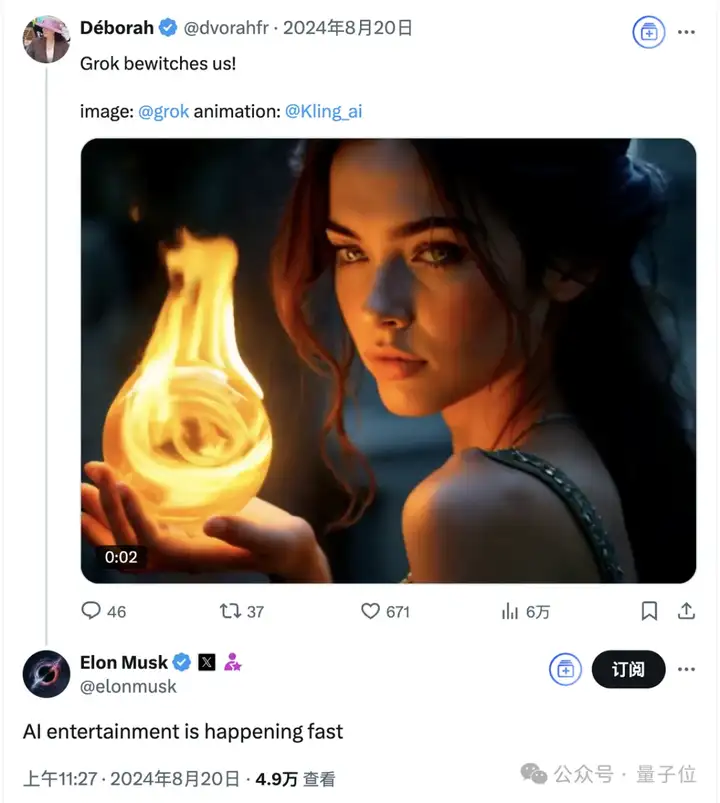

可灵的表现也获得了大佬的认可,比如马斯克早在去年八月就曾评论一则由可灵AI制作的内容,称“AI娱乐产业正飞速发展”。

到现在马斯克连夜关注官方账号,进一步说明可灵已经彻底打造出了国际口碑。

总之,快手正在用技术让影像创作回归本真——专业者能精准雕琢每个光影细节,普通人也可凭直觉编织动人故事。

当技术逐渐溶解专业壁垒,那些曾遥不可及的艺术表达,终将成为每个人记录世界的本能,让每个平凡瞬间都自带美学重量。

文章来自微信公众号 “ 量子位 ”,作者 克雷西

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【免费】ffa.chat是一个完全免费的GPT-4o镜像站点,无需魔法付费,即可无限制使用GPT-4o等多个海外模型产品。

在线使用:https://ffa.chat/

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0