单智能体(Agent)的能力虽然令人印象深刻,但在面对复杂真实世界任务时仍存在局限性,

比如一家公司要决定是否推出一款新产品,需要市场、财务、技术、风险等多个部门一起评估,而不是简单回答"今天天气怎么怎么样"这类问题。

大型语言模型在单智能体模式下已经通过测试时扩展(Test-time Scaling,TTS)取得了显著进步,

但如何有效扩展多智能体系统(MAS)中的协作与推理能力仍是一个亟待解决的问题。

近期由罗格斯大学、康涅狄格大学和NVIDIA研究院等机构的研究者提出了一种新型自适应多智能体框架,

该框架通过模型层面的训练和系统层面的协调来增强协作推理能力,为广大智能体产品开发提供了全新思路。

多智能体系统的现状与挑战

当下的多智能体系统虽然在数学推理、软件开发和科学发现等领域展现出远大前景,

但这些系统大多依赖于现有LLM的上下文学习能力和引导式推理技术,缺乏针对协作优化的专门训练。

在大多数现有框架中,智能体之间的协作方式往往是预先设定的,缺乏灵活性和自适应能力,难以根据问题的复杂性和领域特性动态调整协作策略。

此外,多智能体系统中的协作推理过程消耗的计算和时间成本显著高于单智能体,如何在保证性能的前提下优化资源利用也是一个关键挑战。

MAS-TTS框架的核心组件

MAS-TTS框架建立在AgentVerse开源多智能体平台的基础上,通过扩展和优化,构建了一个完整的协作推理系统。

该框架主要由三个核心组件组成:数据生成管道、模型训练模块和多智能体协作系统。

系统架构采用模块化设计,便于扩展和定制,主要结构包括:

agentverse(多智能体核心实现)、data(各类任务数据集)、dataloader(数据加载器)和LLaMA-Factory(模型训练工具)。

这种设计使研究者和工程师能够轻松地添加新的任务、模型和智能体角色,实现功能的灵活扩展。

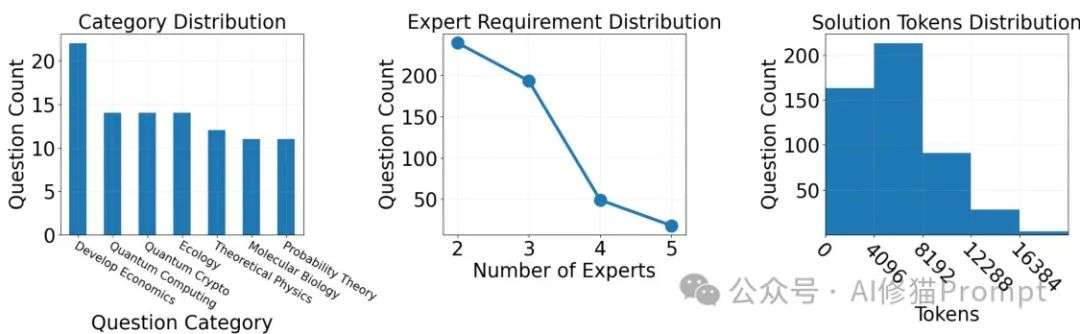

M500:高质量多智能体协作推理数据集的构建

研究者通过精心设计的自动化管道构建了高质量的M500数据集,包含500个详细的多智能体协作推理轨迹。

在数据集构建过程中,研究者考虑了三个关键因素:

难度、多样性和跨学科性,通过DeepSeek-R1模型筛选出需要跨学科知识才能解决且解答需要超过1024个标记的问题。

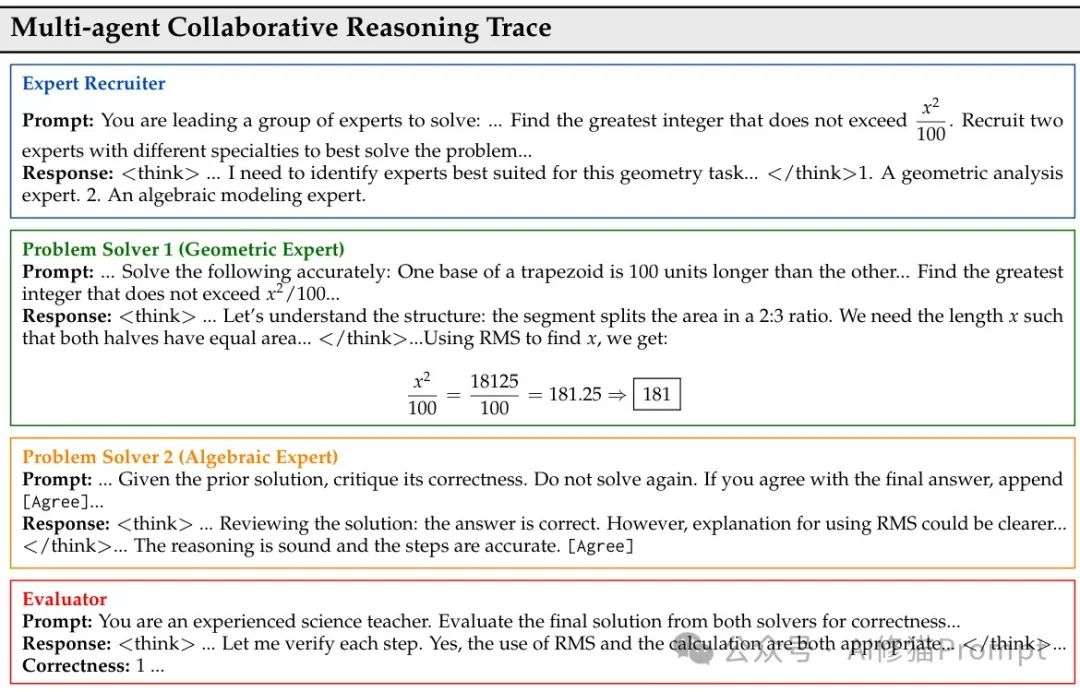

采用开源的多智能体框架AgentVerse和推理模型DeepSeek-R1生成协作推理轨迹,涉及多个角色:

专家招募者、问题解决者、执行者和评估者,这些智能体通过多轮讨论共同解决问题并生成详细的推理历史记录。

M500数据样本

为确保数据质量,研究者基于三个标准进行筛选:1)达成共识,即问题解决者在最大允许的批评迭代次数内达成一致;

2)格式符合规范,保证每个智能体的推理都被封装在特定标签内;

3)正确性验证,只保留答案正确的轨迹。通过这种方法,

最终形成了包含500个跨学科合作问题及其高质量推理轨迹的M500数据集,为后续模型训练提供了扎实基础。

数据集涵盖了多个领域的任务,包括AIME2024(美国邀请赛数学考试)、GPQA-Diamond(博士级科学问题)、

MATH-500(竞赛级数学问题)、HumanEval和MBPP-Sanitized(编程问题)等。

M500数据统计

M1-32B:面向协作推理优化的大型语言模型

基于Simple-Scaling的研究启发,研究者认识到LLM长链推理(Chain of Thought,CoT)能力可以通过在详细推理轨迹上进行监督微调(SFT)来发展。

他们使用M500数据集对Qwen2.5-32B-Instruct模型进行微调,得到优化用于多智能体协作的M1-32B模型。

在训练过程中,研究者确保同一问题的所有推理轨迹都被分组在同一批次中,

并按照原始多智能体系统中的生成顺序排列,这种方法帮助模型以连贯且逻辑上有时序的方式学习协作推理。

通过这种训练策略,M1-32B模型能够有效地在多智能体环境中进行协作,提供长链推理,从多专家视角扩展推理能力。

Math L_SFT = E_((x,y) in M500) [ -1/|y| * sum_{t=1}^{|y|} log P_f(y_t|x,y_{<t}) ]

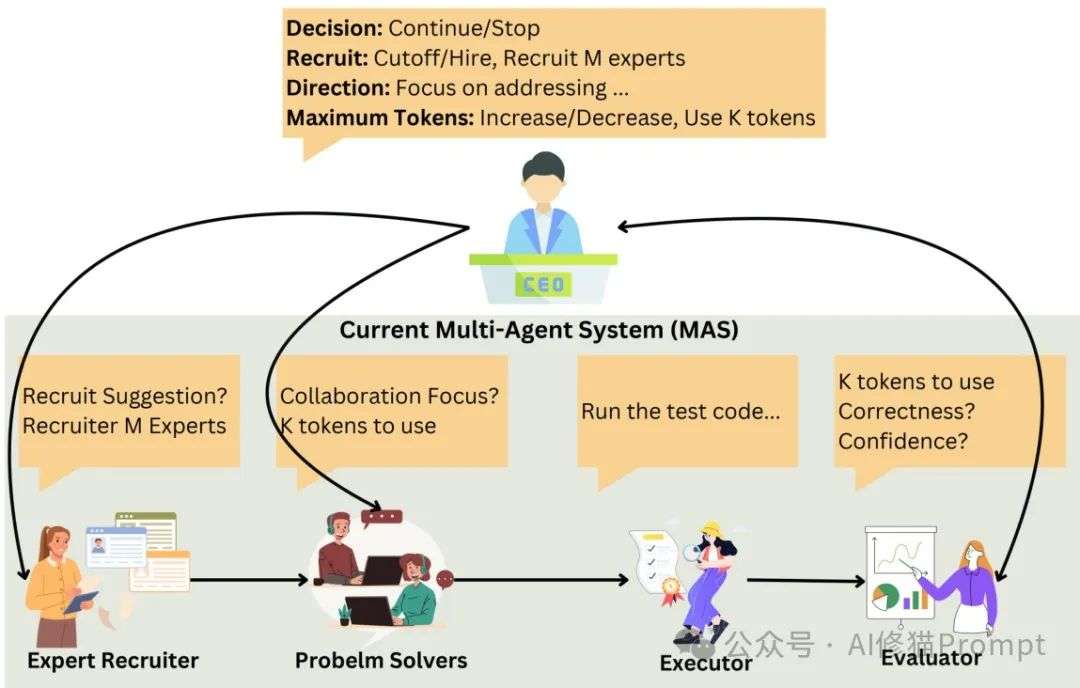

CEO智能体:自适应测试时扩展的创新

为解决多智能体系统中测试时扩展(TTS)策略的应用问题,研究者提出引入"CEO"智能体,由M1-32B模型驱动,用于动态管理协作和资源分配。

CEO智能体评估问题、当前解决方案状态、评估反馈和可用资源,决定是否接受提议的解决方案或需要进一步改进。

此外,CEO智能体指导后续讨论,决定涉及多少智能体,并为每个智能体的响应设置适当的推理深度(即标记预算)。

这种设计受到人类社会中无领导团队往往缺乏效率和连贯方向这一观察的启发,通过CEO智能体,多智能体系统能够动态调整设置,更有效地扩展协作推理能力。

CEO智能体整合

企业假设验证多智能体示例

我根据MAS-TTS框架写了一个企业假设验证多智能体代码,接用DeepSeek-V3,以下是实际运行效果。

该系统虽简化了MAS-TTS的复杂架构,但保留了其核心协作推理理念。

系统中包含CEO智能体和多个专业领域专家(市场、财务、技术、风险等),通过分工协作完成对商业假设的全面评估。

过程中CEO智能体负责任务分配和结果整合,类似于MAS-TTS中的协调角色,

而各专家智能体则专注于各自领域的深度分析,共同构建出比单一智能体更全面、更可靠的评估结果。

这种结构化的协作方式印证了"双Agent更优"的核心理念,展示了如何将MAS-TTS的协作框架应用于实际业务决策场景,

为企业级应用提供了一个简洁而实用的实施范例。

显著的性能提升

研究者在通用理解、数学推理和编程三个关键领域对系统进行了全面评估,结果显示M1-32B与CEO智能体的集成显著优于基线模型。

在GPQA-Diamond上性能提升12%,在AIME2024上提升41%,在MATH-500上提升11%,在MBPP-Sanitized上提升10%,

与最先进的开源和封闭源模型(如DeepSeek-R1和o3-mini)在某些任务上达到了可比的性能。

这些结果证明,该方法有效增强了多智能体系统中的通用问答、写作、数学推理和编程能力。

扩展协作效果

"啊哈时刻":多智能体系统中的涌现行为

研究者观察到,在使用M1-32B时,智能体有时表现出有助于验证和改进协作过程的涌现行为。

例如,当问题解决者未能识别其解决方案中的错误时,CEO智能体会主动检查其有效性并识别错误,提出替代正确解决方案,促使问题解决者相应修改原始响应。

这种协作互动发生在其他智能体不了解自己错误的情况下,体现了真正的协作智能。

这种涌现行为可能源于CEO智能体在多智能体协作推理轨迹上的训练,

使其能够根据学习到的协作模式和从其他智能体推理中获得的见解主动验证和纠正解决方案。

扩展研究:优化协作和推理策略

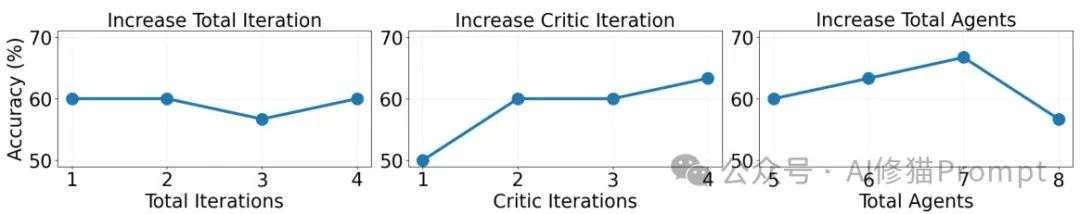

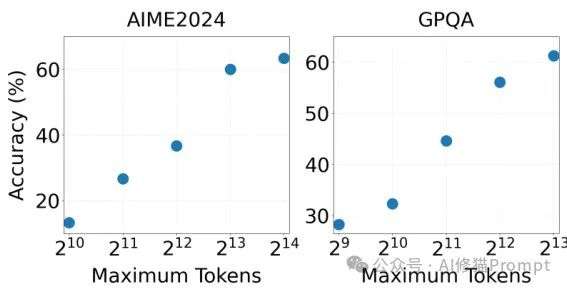

通过系统调整总迭代次数、批评迭代次数、智能体总数和最大标记限制,研究者深入研究了如何在多智能体系统中扩展协作和推理。

实验表明,增加Problem Solvers之间的互动显著提高了性能,这可以通过提高批评迭代限制或增加Problem Solvers总数来实现。

然而,涉及过多Problem Solvers可能因智能体之间的分歧讨论而降低性能。

增加每个智能体的最大允许标记数有效提高了系统性能,且最佳标记限制因任务而异,如AIME2024最优为16384标记,而GPQA为8192标记。

扩展推理效果

单智能体与多智能体性能对比

研究者进一步对比了M1-32B在单智能体和多智能体环境中的性能差异。

结果显示,在多智能体系统中使用M1-32B比单独使用显著提高了性能,例如在AIME2024上多智能体性能为60.0%,而单智能体为46.7%。

相比之下,在多智能体系统中使用Qwen2.5与单独使用相比仅有轻微改进,进一步证明了所提方法在增强多智能体系统性能方面的有效性。

这一对比凸显了M1-32B模型在协作环境中的优势,也证明了专为协作设计的模型在多智能体系统中能发挥更大价值。

如何实施多智能体协作框架

作为开发智能体产品的工程师,你可以通过以下步骤实施类似的多智能体协作框架。

首先,构建或收集高质量的多智能体协作数据,确保数据包含完整的推理轨迹、多样化的问题类型和专家角色。

其次,使用这些数据对现有LLM进行微调,优化其协作推理能力,训练过程中注意保持数据的原始生成顺序和完整性。

最后,设计自适应协调机制,如CEO智能体,根据问题复杂性动态调整智能体数量、讨论深度和计算资源分配,实现更高效的协作推理。

协作优化的未来方向

这份研究通过构建M500数据集、微调M1-32B模型以及设计CEO智能体,提出了一种增强多智能体协作推理能力的自适应测试时扩展方法。

实验结果表明,这种方法在通用理解、数学推理和编程等任务上显著优于基线模型,甚至在某些任务上与最先进模型相媲美。

这些发现强调了学习协作和自适应协调在扩展多智能体推理中的重要性,为构建更强大、更灵活的人工智能系统提供了新的方向。

文章来自于微信公众号 “AI修猫Prompt”,作者 :AI修猫Prompt

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0

【开源免费】VideoChat是一个开源数字人实时对话,该项目支持支持语音输入和实时对话,数字人形象可自定义等功能,首次对话延迟低至3s。

项目地址:https://github.com/Henry-23/VideoChat

在线体验:https://www.modelscope.cn/studios/AI-ModelScope/video_chat

【开源免费】Streamer-Sales 销冠是一个AI直播卖货大模型。该模型具备AI生成直播文案,生成数字人形象进行直播,并通过RAG技术对现有数据进行寻找后实时回答用户问题等AI直播卖货的所有功能。

项目地址:https://github.com/PeterH0323/Streamer-Sales