从仓库里的物流机器人到科幻电影中的「贾维斯」,我们对智能机器人的想象从未停止。学术界在模拟器里实现了越来越复杂的协作任务,工业界也让机器人学会了韦伯斯特空翻。

然而,一个残酷的现实是:当下的机器「人」更像是提线木偶,而非真正自主的智能体。

想象一下,机器人每做一个动作都要延迟十几秒,完成同样的任务比人类慢上十倍,这样的效率如何走入我们的生活?这个从虚拟到现实的「最后一公里」,其瓶颈常常被忽视:高昂的时间延迟和低下的协作效率。它像一道无形的墙,将真正的具身智能困在了实验室里。

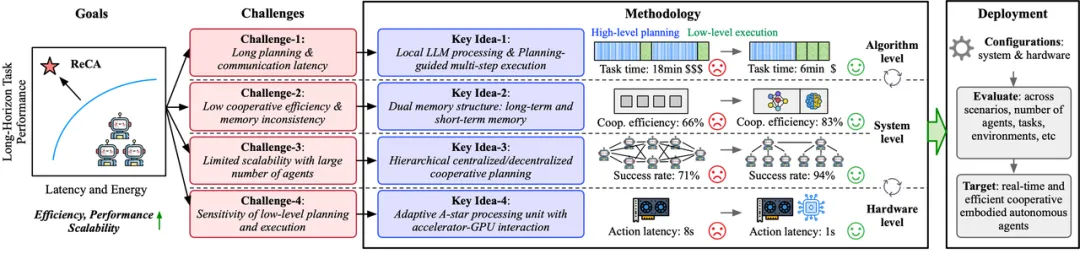

为了打破这一僵局,来自佐治亚理工学院、明尼苏达大学和哈佛大学的研究团队将目光从单纯的「成功」转向了「成功且高效」。他们推出了名为 ReCA 的集成加速框架,针对多机协作具身系统,通过软硬件协同设计跨层次优化,旨在保证不影响任务成功率的前提下,提升实时性能和系统效率,为具身智能落地奠定基础。

简单来说:ReCA 不再满足于让智能体「完成」任务,而是要让它们「实时、高效地完成」任务。

这份工作发表于计算机体系结构领域的顶级会议 ASPLOS'25,是体系结构领域接收的首批具身智能计算论文,同时入选 Industry-Academia Partnership (IAP) Highlight。

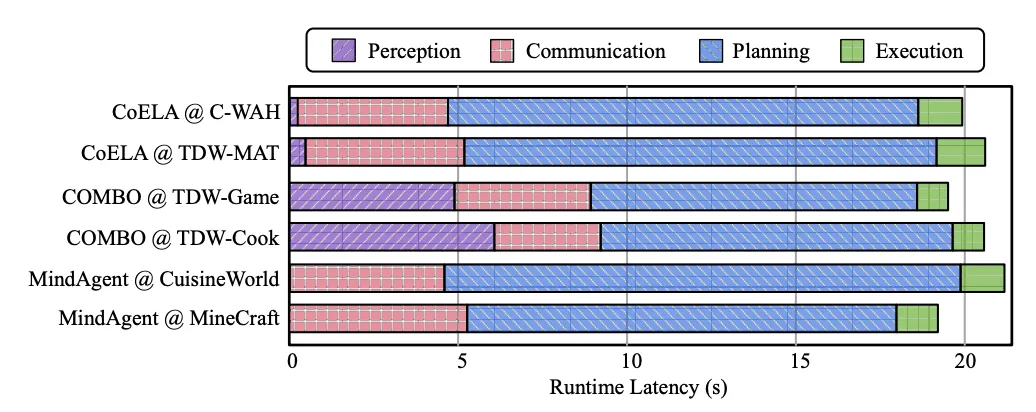

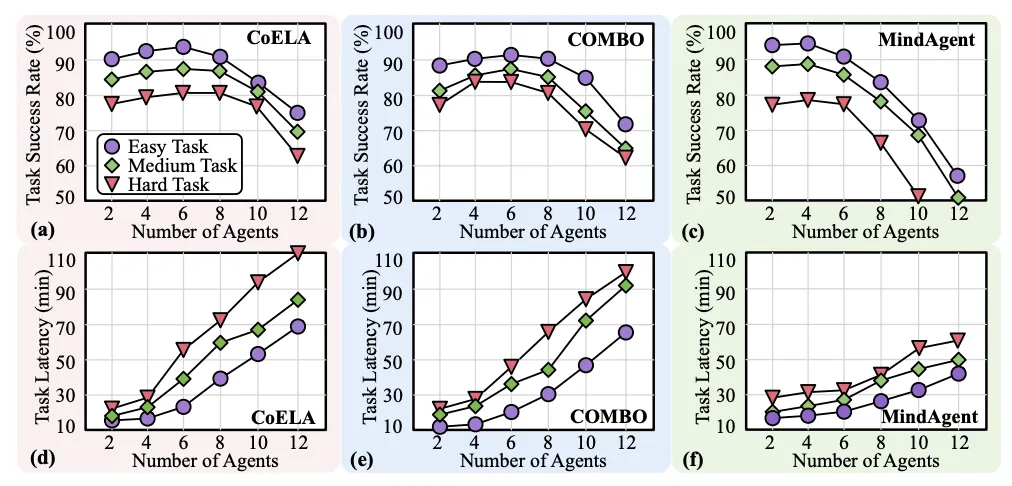

研究团队首先对当前的协同具身智能系统(如 COELA, COMBO, MindAgent)进行了系统性分析,定位了三大性能瓶颈:

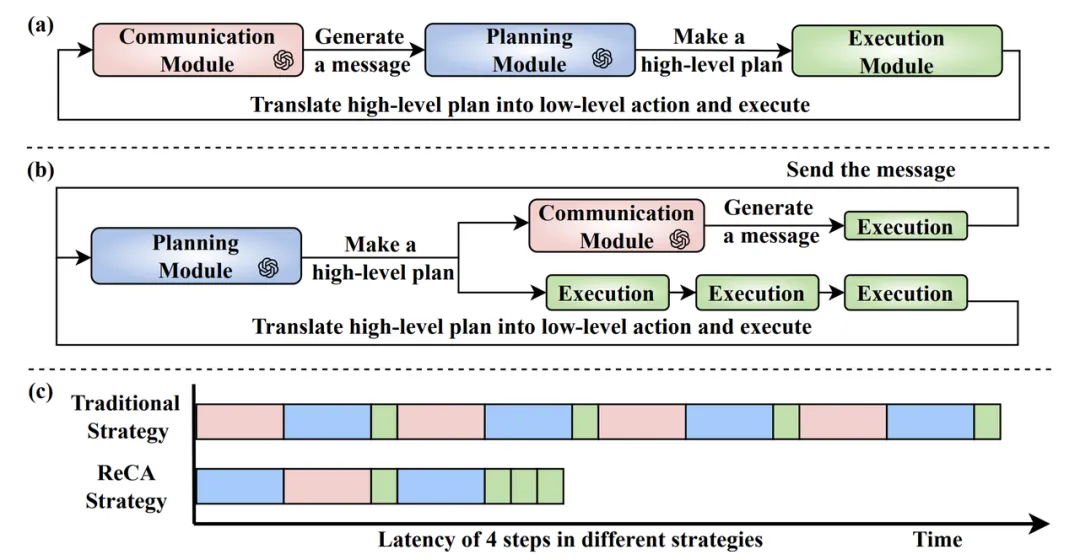

高昂的规划与通信延迟: 系统严重依赖基于 LLM 的模块进行高阶规划和智能体间通信。每一步行动都可能涉及多次 LLM 的顺序调用,其中网络延迟和 API 调用成本更是雪上加霜,使得实时交互成为奢望。

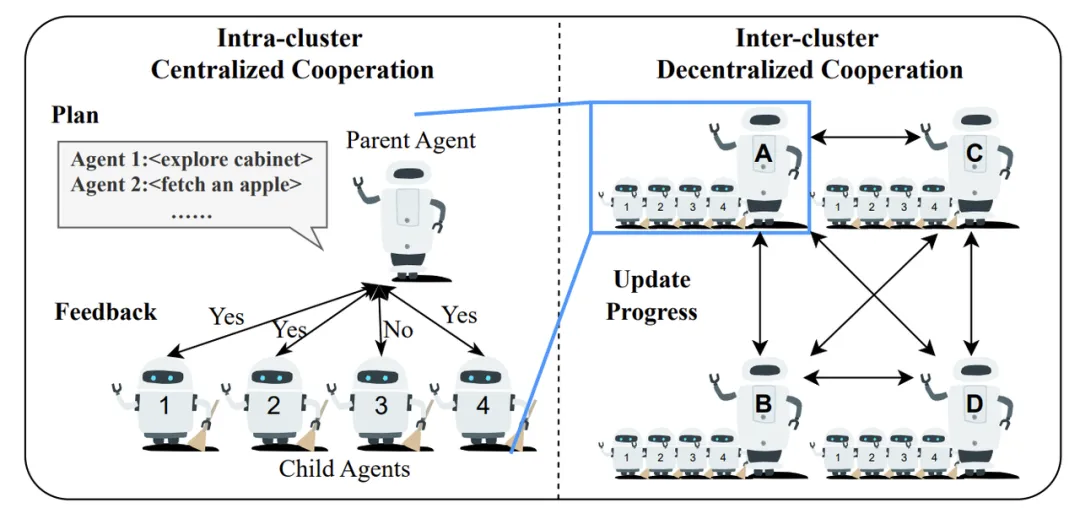

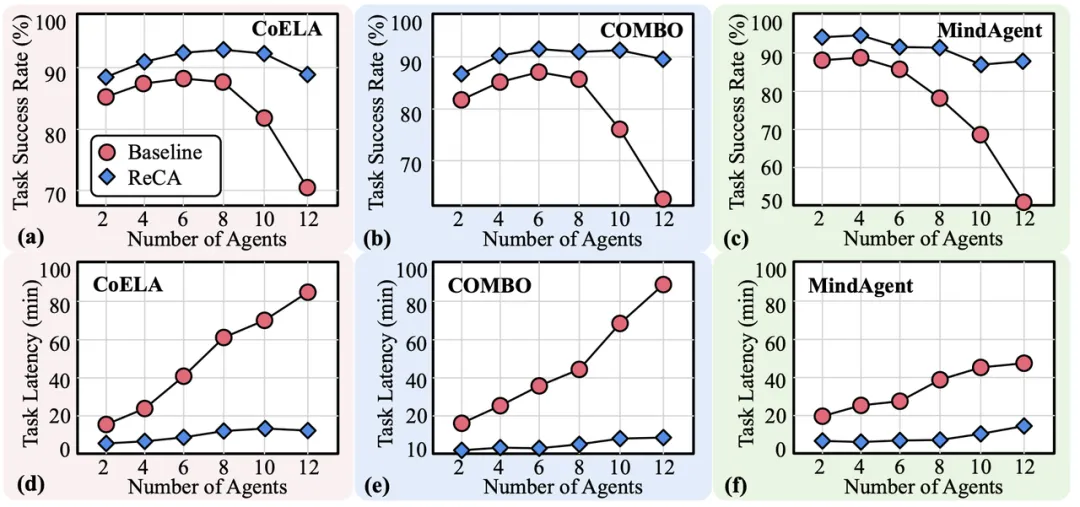

有限的可扩展性: 随着智能体数量的增加,去中心化系统会面临通信轮次爆炸性增长和效率下降的问题;而中心化系统则由于单一规划者难以处理复杂的多智能体协同,导致任务成功率急剧下滑。

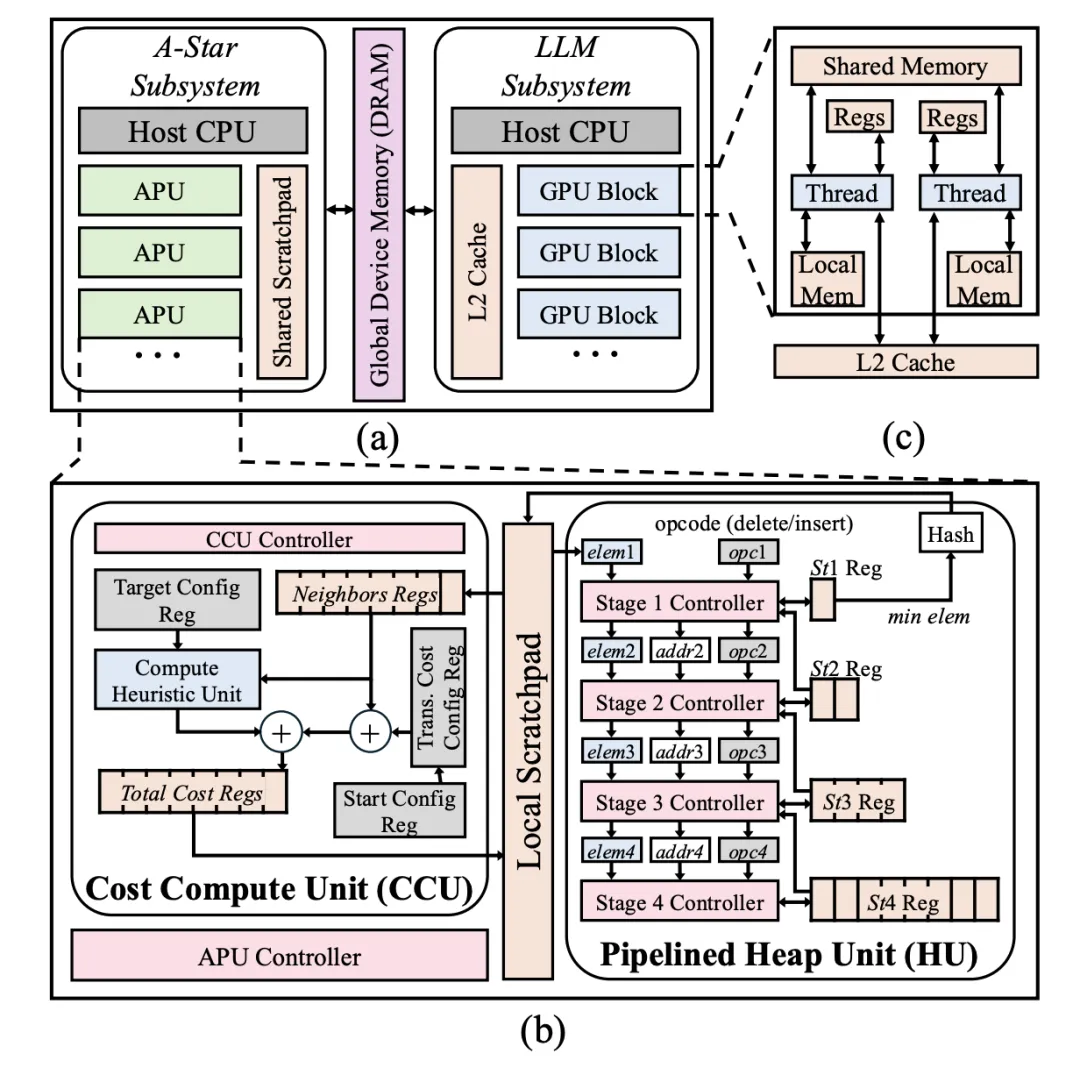

底层执行的敏感性: LLM 生成的高阶计划需要被精确翻译成底层的控制指令,底层执行的效率和鲁棒性直接关系到任务的成败。

针对上述挑战,ReCA 提出了一个贯穿算法、系统和硬件三个层面的跨层次协同设计框架,旨在提升协同具身智能系统的效率和可扩展性。

算法层面:更聪明的规划与执行

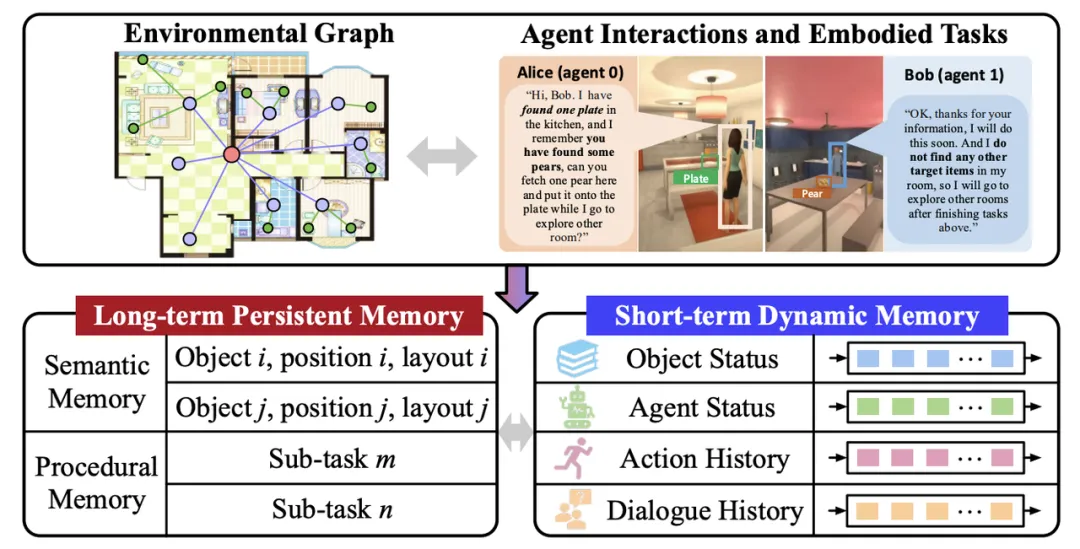

系统层面:更高效的记忆与协作

有效解决了 LLM 在长任务中 prompt 过长导致「遗忘」关键信息的痛点,提升了规划的连贯性和准确性。

硬件层面:更专业的加速单元

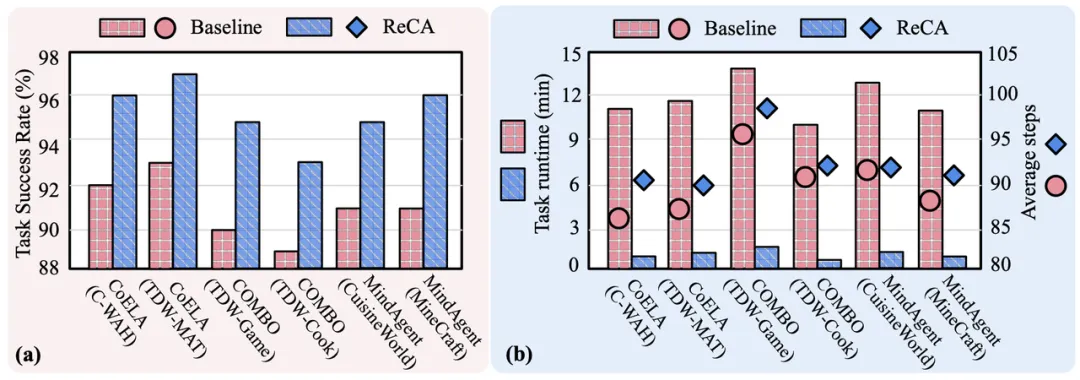

通过跨越六个基准测试和三大主流协同系统的评估,ReCA 展现了其强大的实力:

ReCA 的意义,远不止于一组性能提升的数据。它更像一块基石,为具身智能的未来发展铺设了三条关键路径:

从「能用」到「好用」的跨越: 此前,研究的焦点大多是如何让机器人「成功」完成任务。ReCA 则明确地提出,「成功且高效」是更关键的目标。这项工作有助于推动领域的研究范式转变,让延迟、效率和可扩展性也成为衡量具身智能系统的核心指标,加速其在家庭服务、智能制造等场景的落地。

「软硬协同」释放效能提升: ReCA 通过算法、系统、硬件的跨层次协同优化,突破了过往「单点优化」的局限。未来的具身智能系统,有望像 ReCA 一样,在不同层面协同设计的产物。它为 GPU 处理高阶规划、硬件加速器处理底层精确任务的异构计算模式提供了范本,为下一代机器人「大脑」+「小脑」的设计提供了一种可行方案。

突破瓶颈,解锁想象力: 当延迟不再是瓶颈,我们可以大胆想象:一个机器人管家团队能在你下班前,实时协作,烹饪好一顿丰盛的晚餐,并打扫干净房间;又或者在灾难救援现场,多个机器人能实时共享信息,高效协同,在黄金救援时间内完成搜索与拯救任务。在自动化科学实验室里,机器人集群能够 7x24 小时不间断地进行复杂的协同实验,以前所未有的速度推动科学发现。

总而言之,ReCA 的工作不仅解决了一个关键的技术瓶颈,更是为具身智能从实验室走向真实世界,架起了一座坚实的桥梁。我们距离那个能实时响应、高效协作的「贾维斯」式智能助手,确实又近了一大步。

万梓燊 是佐治亚理工学院博士生,研究方向为计算机体系架构和集成电路,聚焦通过系统-架构-芯片的跨层软硬件协同设计,为具身智能机器人和神经符号 AI 构建高效、可靠的计算平台。个人主页https://zishenwan.github.io/

杜宇航 是 Yang Zhao 教授和 Vijay Janapa Reddi 教授指导的本科研究员,研究方向为计算机体系架构和集成电路,致力于通过系统级的性能分析与协同设计,为智能体在真实世界的计算打造基础设施。

Mohamed Ibrahim 是佐治亚理工学院博士后研究员,研究方向为软硬件协同设计,融合类脑计算与 VLSI 系统,构建具备高适应性与高可靠性的创新硬件架构。

钱家熠 是佐治亚理工学院博士生,研究方向为高效机器学习算法与系统、计算机体系结构与硬件设计,聚焦面向具身智能与神经-符号系统的协同优化与加速。

Jason Jabbour 是哈佛大学计算机科学系博士生,研究方向为机器学习、机器人和自动驾驶。

Yang (Katie) Zhao 是明尼苏达大学电子与计算机工程系助理教授,研究方向聚焦于计算机体系架构、硬件设计与机器学习的交叉领域,致力于通过从算法、芯片到系统的全栈式协同设计,为大语言模型等新兴应用提供高效、可靠的硬件加速方案。

Tushar Krishna 是佐治亚理工学院电子与计算机工程学院副教授,入选 ISCA、HPCA 和 MICRO 名人堂。长期致力于计算机体系架构、NOC 与 AI/ML 加速器等领域的研究,相关成果被引用超过 20000 次。曾有多篇论文入选 IEEE Micro 最佳论文推荐(Top Picks)或荣获最佳论文奖,现任 ML Commons Chakra 工作组联合主席。

Arijit Raychowdhury 是佐治亚理工学院电子与计算机工程学院院长,IEEE Fellow。长期致力于低功耗数字与混合信号电路、专用加速器设计等领域的研究,在国际顶级期刊与会议发表论文 250 余篇,拥有超过 27 项美国及国际专利。担任 ISSCC、VLSI、DAC 等多个顶级会议的技术委员会委员。

Vijay Janapa Reddi 是哈佛大学工程与应用科学学院教授,入选 MICRO 与 HPCA 名人堂。长期致力于计算机体系架构、机器学习系统与自主智能体的交叉领域研究,是 TinyML 领域的开拓者之一,并联合领导创建了 MLPerf。曾获 MICRO、HPCA 最佳论文奖及多次入选 IEEE Micro 最佳论文,现任 MLCommons 董事会成员和联合主席。

文章来自微信公众号 “ 机器之心 ”

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0