尽管 Apple Intelligence 在大陆国行机型上落地仍然杳无音讯,但这并不代表苹果没有在努力推进。

前两天,伴随着 iOS 26.1 版本的更新,Apple Intelligence 先一步提供了对于繁体中文的支持。

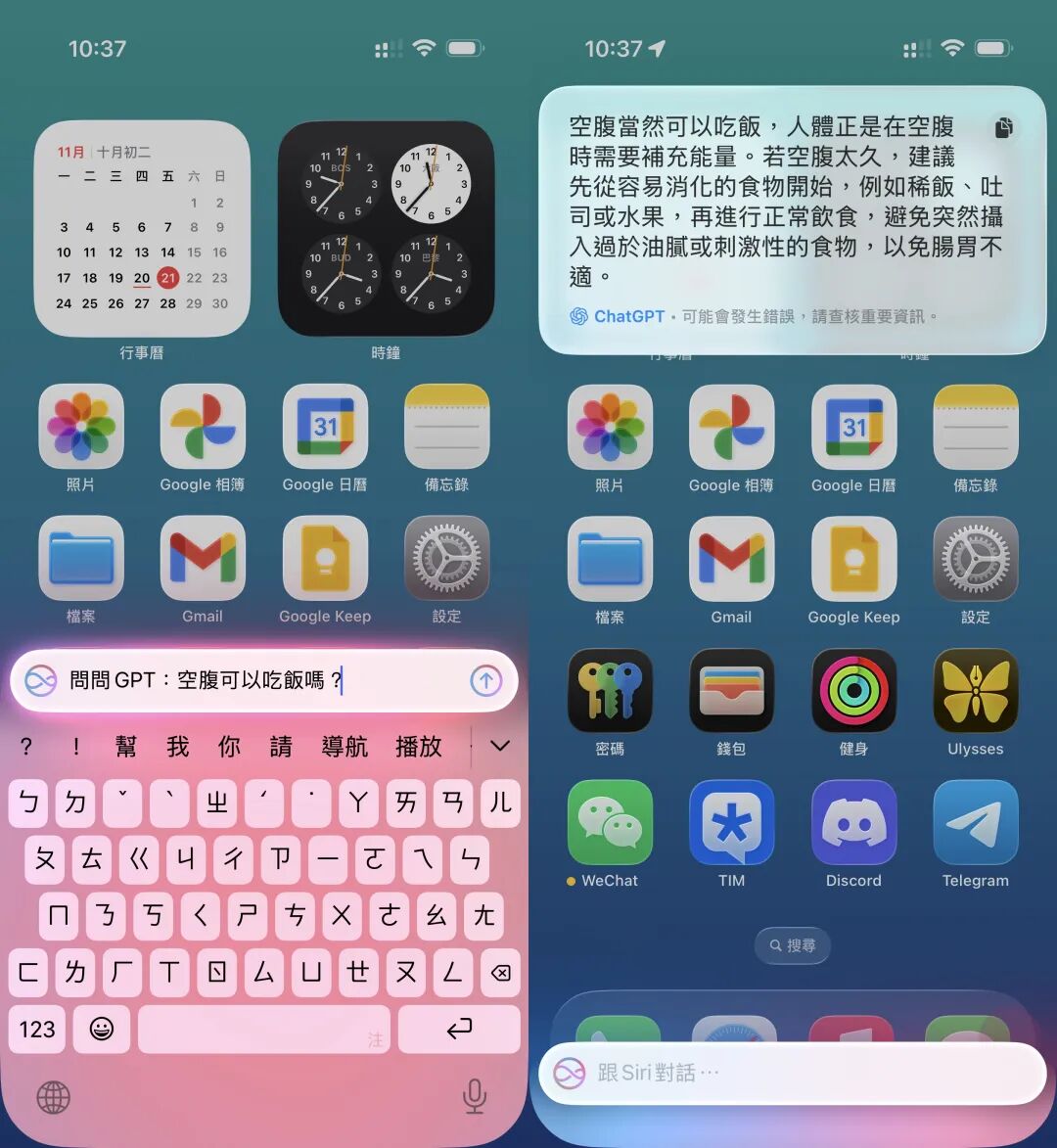

目前,繁体中文版 Apple Intelligence 一共支持两个区域,分别是「中文(普通话-台湾(中国))」和「中文(粤语-香港(中国))」,仍然需要搭配非国行的 iPhone 和非国区的 Apple ID 才能打开:

与此同时,想要在你的耳机上开启 Apple Intelligence 的实时翻译功能,耳机也必须是搭载 H2 芯片的机型,即 AirPods 4、AirPods Pro 2 和 3 三款——只要在 iPhone 端激活了实时翻译功能,就算是国行耳机也可以搭配使用。

相比 iOS 26 刚刚发布那会,最新的 iOS 26.1 补全了对于中文的支持,现在实时翻译支持的语言总数从 5 种增加到了 9 种:

只不过实时翻译虽然支持简体中文,但由于这个功能本身是基于 Apple Intelligence 模型的,所以国行 iPhone 还是没法使用。和 Apple Intelligence Siri 的情况还不太一样——

换句话说就是:

Apple Intelligence Siri 不支持任何形式的简体中文,但使用 AI 模型的「实时翻译功能」是支持简体中文的,但必须要在先开启 Apple Intelligence Siri 之后才能使用实时翻译。

只不过在实际使用中,经过我们的多次测试,iOS 26.1 的实时翻译和 iOS 26 最初版本更新时的体验基本一致:速度流畅,识别率中上,就是使用体验有点尴尬。

问题在于,苹果为这个功能规划的主要场景,是在旅游的时候与语言不通的人交流。

先不说和人讲话的时候一直戴着耳机会不会被视作不礼貌,仅凭这个「需要一直翻着手机让对方看翻译结果」的使用方式,就会让超过三句话的沟通显得有些奇怪。

但除了姿势有点尴尬之外,苹果的实时翻译功能在实际效果上面还是相当令人惊喜的。

首先,由于 AirPods 实时翻译使用的是预先下载到本地的语言模型,因此可以最大限度地发挥出本地模型的优势:翻译速度与网速无关,甚至完全断网、开飞行模式的状态下也能正常翻译。

在爱范儿目前的体验中,我们可以感觉到,同传的语音质量受语种的影响比较大,主要表现在朗读中文的语音有比较强的机械感,甚至不如目前 Siri 的中文语言自然。

至于 Apple Intelligence 的翻译质量,对于比较常见的语言组合,它的准确性是几乎没有问题的,完全可以应付 99% 日常交流中的对话:

不过真正让我们对这个功能感觉到惊喜的,并不是它的「同声传译」——

毕竟类似的应用场景在非常多其他 app 里面也早就有了。AirPods 实时翻译最好玩的点在于:你并不一定要在和人说话的时候用它。

虽然「实时翻译」是为了两人对话而设计的,但并没有条件限制你一定得参与对话:在看没有字幕和翻译的纯外文视频的时候,AirPods 实时翻译可以同时用来实时生成字幕,并提供同时的翻译。

没错,这项功能就和哔哩哔哩以及 YouTube 提供的「自动生成字幕」功能类似,但它强就强在完全不挑 app:只要视频能够外放,AirPods 就能实时翻译。

需要注意的是,虽然实时翻译可以转译文字,但并不能替代传统的隐藏式字幕(即 CC 字幕,Closed Caption),因为它只会接收人声,但不会转录或描述环境音:

CC 字幕必须要包含声音描述,以起到听障辅助功能的作用

甚至当你看的视频有比较嘈杂的背景音、或者有配乐的话,AirPods 偶尔还会在翻译期间提示你「有背景噪音,请尝试将 iPhone 靠近说话的人」。

换句话说,用 AirPods 实时翻译来看一些没有翻译的讲解类视频的体验不错,但如果想要用它来看 MV 的话,就得准备好被耳机经常提醒有噪音了:

此外,由于 AirPods 会在所有登录了 Apple ID 的设备之间自动流转,如果想要用实时翻译功能的话,还要记得把电脑设置为扬声器外放、耳机保持连接 iPhone,翻译才能正常工作。

总的来说,iOS 26 里面搭配 AirPods 的实时翻译功能,是我们感觉 Apple Intelligence 迄今为止最实用的一项功能。

虽然这项功能本身在市场上并不罕见,也早就有类似「词典笔」之类的专用工具,但实时翻译胜就胜在它是一项完全基于苹果生态内「既有硬件」的功能:

你不太可能单纯为了看剧,就买一套专门的同传设备或者订阅,但你大概率已经有了一台 iPhone 和一副 AirPods。

更何况,AirPods 实时翻译最大的优势就在于这是一个系统应用。

除了与 iPhone 硬件和 iOS 26 的高度整合之外,将翻译模型下载到手机上本地运行也带来了非常明显的速度优势,以及在无网环境(比如出国)时的通用性。

并且由于苹果一直将精力放在端侧 AI 模型,实时翻译的质量实际上是要比第三方 app 能够下载的本地翻译质量更好的。

总之,虽然 Apple Intelligence 疯狂跳票,但实时翻译却让我们看到了苹果理想中的「端侧 AI 发挥优势」的场景。并且这种纯粹的功能性,要比 AI 消除、文字改写、图乐园之类的东西都更有用。

体验到这里,能够说的便只剩下一句话了:国行 Apple Intelligence,搞快点啊!

文章来自于微信公众号 “APPSO”,作者 “APPSO”