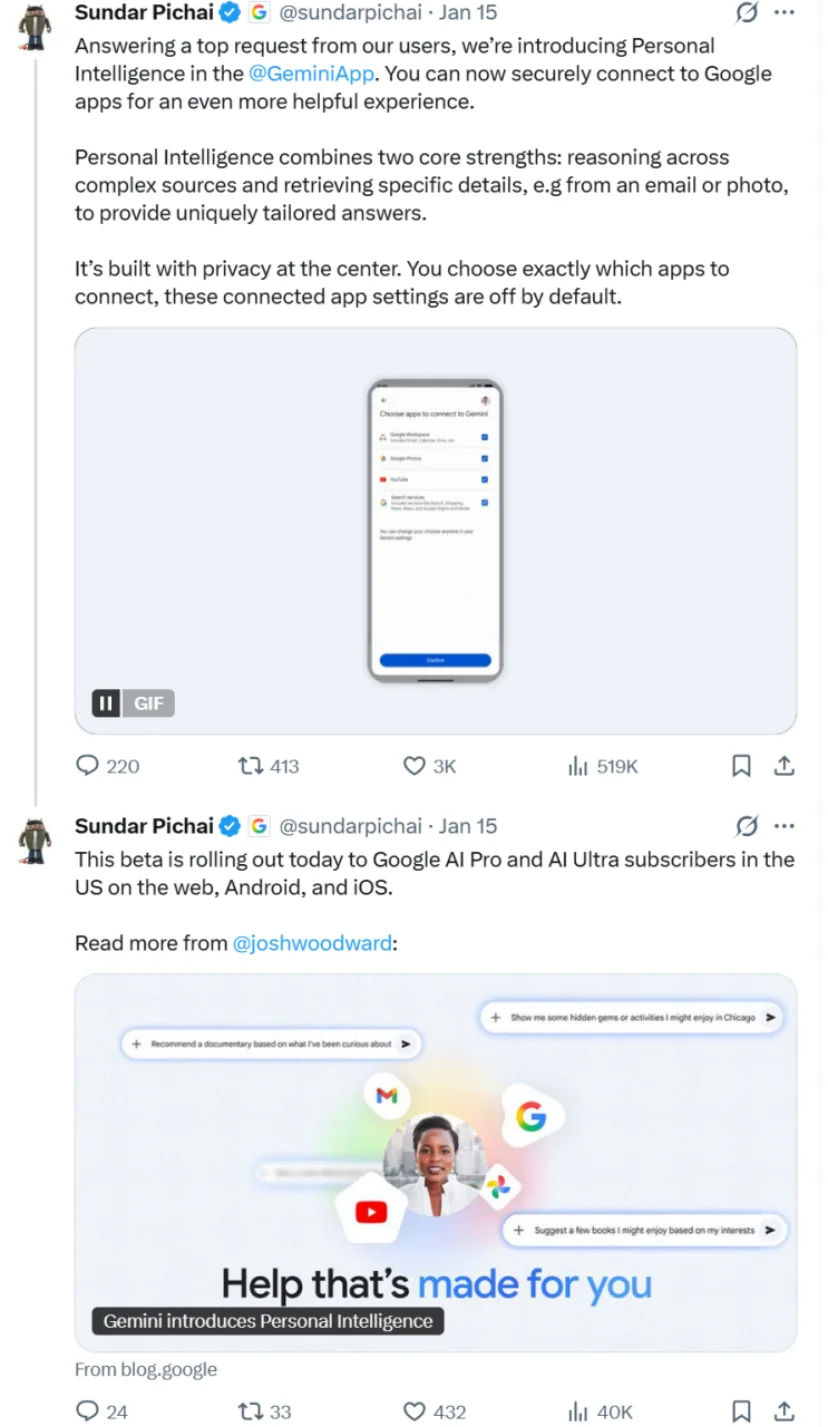

究竟是什么样的更新,才能让谷歌CEO皮查伊称之为“众望所归”(Answering a top request from our users)?

那就是谷歌Gemini最新的Personal Intelligence功能。

它通过用户Gmail、Google Photos、YouTube和搜索等应用的数据,让AI能够跨数据源推理,提供个性化回答。真正意义上实现了AI全能管家。

几乎同时,谷歌还与苹果达成多年期合作,Gemini 3将成为新版Siri的技术底座。还有通用商务协议的发布。一系列动作密集而迅猛。

资本市场的反应也是立竿见影,Alphabet市值突破4万亿美元,19年来首次超越苹果。

这一系列更新背后,是谷歌全栈优势的体现。

从硬件到软件,得益于谷歌在AI产业链的每个环节都有布局,而他们也正在用技术栈控制越来越多的生态。

谷歌释放的信号很明确,不仅要赢,还要赢得更彻底。

技术代差可以追赶,资金差距可以弥补,但生态位的差距一旦形成,OpenAI们可能就永远无法追赶上谷歌了。

谷歌和苹果的合作,是一次世纪握手。

1月12日,两家公司联合宣布达成多年期合作协议,Gemini 3将成为下一代苹果智能(Apple Intelligence)的技术底座。

这次合作并非单纯的提供基座大模型那么简单。文章《“套壳”谷歌Gemini,但苹果还没死心自研模型》中提到,Gemini作为后台训练导师与复杂任务处理引擎(负责信息摘要、跨应用调度等),苹果自研模型处理本地敏感数据。

所有用户交互与数据流转通过苹果私有云完成,Siri控制权与隐私标准仍由苹果掌控,核心落地场景为今年晚些时候推出的新版个性化Siri。

根据外媒报道,这笔交易预计每年为谷歌带来约10亿美元的收入,但更重要的价值是数据。Siri每天处理约15亿次请求,这些交互数据将进一步强化Gemini的Agent能力。

即便不触碰任何用户的敏感数据,但是Gemini依然会了解用户的需求和处理结果。因此,当用户习惯在新版Siri中完成各种任务时,谷歌就掌控了从用户意图到应用执行的完整链条。

几乎在同一时间,谷歌在美国零售联合会推出通用商务协议(Universal Commerce Protocol,UCP)。这是一个开源的AI电商标准,可以让AI代理与商业系统无缝对接。

谷歌与Shopify、Walmart、Target、Wayfair、Etsy等20余家零售和支付巨头联手打造这一协议,使用户可以直接在Gemini应用和AI Mode中完成商品搜索、比价、下单和支付,无需跳转到商家网站。

这种“原生结账”体验彻底改写了电商的流量逻辑,入口从独立电商网站转移到了AI对话界面。

在零售端,Gemini还接入了Google Shopping Graph。这是一个包含超过百亿商品信息的知识库,支持AR虚拟试穿、价格保护、实时库存查询等功能。

说回谷歌的Personal Intelligence功能,它与ChatGPT仅能参考过往对话历史不同,这个功能主打的是可以跨应用推理,分析数据点之间的关系。

谷歌提供的案例显示,当用户站在轮胎店排队却不知道自己的2019款本田小型货车需要什么型号的轮胎时,Gemini可以从Google Photos中识别车辆配置,从Gmail收据中找到车牌详细信息,然后建议不同的选项。

比如一种适合日常驾驶,另一种适合全天候条件,参考的是在Google Photos中找到的家庭前往俄克拉荷马州的公路旅行记录。

用户可以单独控制每个数据源的访问权限,在隐私保护和功能体验之间取得平衡。

谷歌强调,Gemini不会直接在Gmail收件箱或Google Photos库上进行训练,而是仅使用“有限信息,如Gemini中的特定提示和模型的响应”来改进这一能力,且会采取措施过滤或模糊对话中的个人数据。目前该功能已向AI Pro和Ultra订阅用户开放测试。

AI产业正在进入一个被称之为“inference economics”(推理经济学)的时代。

在这个时代,竞争优势不再由训练模型的参数量定义,而是由“以最低成本提供有用信息”的能力决定。而谷歌在这方面的布局堪称教科书级别。

谷歌使用自研的TPU芯片训练模型,它的优势主要集中体现在在推理环节上。

这是因为GPU每做一次运算,都要频繁地从缓存或内存(HBM)中读写数据。这种“存取-计算-存取”的循环在推理时会消耗大量带宽和电力。

TPU让数据在处理单元之间直接传递。一旦权重加载进阵列,数据流进去就能连续完成成千上万次乘加操作,无需中间写回内存。

不仅如此,为了兼顾图形渲染、科学计算等任务,GPU拥有复杂的调度逻辑、分支预测和指令缓存。这些在纯粹的推理运算中属于“无效载荷”,但又必须耗费计算资源。

TPU剥离了所有非AI相关的电路。在推理时,由于模型结构是固定的,TPU能以极高效率的批处理(Batching),几乎没有时钟周期被浪费在指令调度上。

此外,谷歌在TPU Pod中使用了自研的OCI(光学电路交换)技术。

相比于英伟达依赖的电缆和 NVLink 开关,谷歌的光学互联能以更低的功耗提供数 Tbps 的跨芯片带宽。这使得 TPU 在处理超长上下文或超大模型推理时,通信开销更小。

当Gemini每天处理数十亿次查询时,每次推理哪怕只节省几美分,累积下来就是数亿美元的成本优势。

更深层的优势体现在商业模式上。

谷歌并不追求AI订阅收入的最大化,Gemini Advanced的定价策略比ChatGPT Plus更便宜,甚至在某些场景下完全免费,比如edu账号可以全年免费。

谷歌的战略是“羊毛出在猪身上”,强化生态锁定、增加用户停留时间、提升广告定向精度。

根据财报,谷歌约80%的收入仍然来自广告。对于谷歌来说,AI 并不是一个新生意,而是一次“广告引擎的史诗级大修”。

谷歌将Gemini深度嵌入。用得越多,用户的数据画像就越清晰,广告推送也就越精准。

不仅如此,传统的蓝色链接是搜索引擎让你尽快离开,点击去别的网站。

但是和Gemini对话截然相反,谷歌需要用户继续留在Gemini里。用户停留时间越长,展示高价值广告的机会就越多。

谷歌不靠卖AI赚钱,而是用AI让现有的广告生意变得更赚钱。

迭代速度的优势同样关键。

从DeepMind的研究idea到TPU的芯片优化,再到模型训练和产品部署,谷歌可以在一个闭环内完成整个链条。

而像OpenAI这样的AI企业,想要更新就需要协调微软的Azure云、英伟达的芯片供应、第三方的数据合作,决策链条冗长,响应速度必然慢半拍。

在AI军备竞赛的“以周计算”节奏中,这种速度差异可能决定市场窗口的得失。

所以谷歌才会更新得越来越快,同时他们还在扩大优势,形成“赢家总赢”的局面。

打下推理成本后,通过与苹果的合作,谷歌获得了大量的Siri请求数据,相当于ChatGPT日均25亿次提示词的60%。而通过UCP,谷歌还将在电商AI入口的争夺战中抢得先机。

这不是简单的技术合作,而是对流量分发权的重新定义。

数据飞轮是谷歌最难以复制的护城河。谷歌拥有Search、YouTube、Gmail、Maps等九个用户超过10亿的产品,每天产生的数据量远超任何竞争对手。

Personal Intelligence功能的推出,让这些数据首次被深度整合到AI体验中。

用户每一次与Gemini的交互,都在强化模型对个体偏好的理解,形成正反馈循环。这种“数据→模型→体验→更多数据”的飞轮效应,是OpenAI等独立AI公司难以企及的。

视角切换到OpenAI这边,他们此刻正陷入前所未有的困境。

2025年底,就在Gemini 3发布后不久,OpenAI CEO Sam Altman向全体员工发出了“红色警报”(code red)。OpenAI公司暂停了所有商业化项目,包括广告平台、个人助手Pulse、购物代理以及健康AI工具的开发。

全员转向一个目标,那就是追上Gemini 3的水平。

奥特曼后来在播客中承认,这种“红色警报”状态通常会持续6到8周,但他补充说:“Gemini 3的影响没有我们担心的那么大。”

然而市场数据讲述了另一个故事。

根据Similarweb的分析,ChatGPT在生成式AI市场的份额从2025年1月的87.2%跌至2026年1月的64%,而Gemini在同期从5.7%涨至21%。

ChatGPT的网络流量在近几周下降了22%,从12月初的约2.03亿日均访问量降至1.58亿,而Gemini的使用量保持稳定在5500万至6000万日均访问量。

此消彼长之间,ChatGPT的统治地位正在被撼动。

根据谷歌财报电话会议,Gemini的月活跃用户从2025年7月的4.5亿增长到10月的6.5亿,三个月内增长44%。

反观,Similarweb的数据显示,ChatGPT同期增长仅为5%-6%。

苹果合作的“降级”更是一记重击。

OpenAI曾是苹果在AI领域的首选合作伙伴,ChatGPT被整合到苹果智能中,用于处理复杂查询。

但在谷歌与苹果的新协议下,OpenAI的角色被边缘化了。

投资研究公司Equisights Research的CEO Parth Talsania一针见血地指出:“苹果选择Gemini作为Siri的底层技术,意味着OpenAI转变为辅助角色。ChatGPT仍然可用于复杂的、用户主动选择的查询,但不再是默认的智能层。”

更深层的迹象在于,谷歌全栈优势正在放大。

OpenAI没有自己的搜索引擎、操作系统以及产品矩阵。每一个APP之间除了账号相通以外,都是独立运作的。

但谷歌可以将Gemini无缝嵌入Gmail、Docs、YouTube等用户日常使用的工具中,反之还有Personal Intelligence功能。

ChatGPT却只能要求用户主动离开现有工作流程,用户想生成视频就得从ChatGPT里退出来打开Sora App。

谷歌很清楚一件事:用户对AI模型本身并不忠诚。

这个行业的残酷真相是,用户会毫不犹豫地在ChatGPT、Gemini、Claude之间来回切换,谁的模型在某个任务上表现更好,他们就用谁。

数据显示,越来越多的开发者开始使用LangChain这样的抽象层,让应用可以在不同的AI提供商之间无缝切换,而不需要重写代码。这种“多模型策略”正在成为常态,ChatGPT用于写作,Claude用于任务编排,Gemini用于多模态理解。

但用户对他们的数据、使用习惯、费用预算和工作效率倒是非常忠诚。

他们的数据不可能轻易迁移到其他平台,这些习惯也不可能一夜之间改变。

所以谷歌的战略就是抓住这些真正的忠诚度,通过更大的AI生态让用户感受到持续的价值增长,锁住用户。

当用户发现在Gmail里就能直接用Gemini起草邮件,在Google Docs里就能让AI帮忙润色文章,在YouTube里就能获得视频摘要,他们为什么还要打开一个独立的ChatGPT标签页?

这种“无缝体验”远比模型更有吸引力。

别的模型可能更聪明,但Gemini就在每天使用的工具里,不需要切换窗口,不需要复制粘贴,这就够了。

关键的是,谷歌还在不断降低用户使用AI的门槛,用价格战进一步扩大优势。

免费用户现在可以在Gemini CLI中使用Gemini 3,以前只有付费用户才能使用。

1月初,新用户年订阅Google One的AI Pro半价促销。这些动作的目标很明确:让更多用户进入谷歌的生态系统,让他们习惯在谷歌的产品中使用AI,让迁移的成本变得越来越高。

当技术竞赛演变为生态位竞争,先发优势和资金储备都不再是决定性因素。

谷歌正在用全栈建造一个AI帝国。

而对于OpenAI和其他竞争者来说,亮出“红色警报”并不能解决问题,他们想要追上谷歌的脚步,只会越来越艰难。

文章来自于“字母AI”,作者 “苗正”。

【开源免费】OWL是一个完全开源免费的通用智能体项目。它可以远程开Ubuntu容器、自动挂载数据、做规划、执行任务,堪称「云端超级打工人」而且做到了开源界GAIA性能天花板,达到了57.7%,超越Huggingface 提出的Open Deep Research 55.15%的表现。

项目地址:GitHub:https://github.com/camel-ai/owl

【免费】cursor-auto-free是一个能够让你无限免费使用cursor的项目。该项目通过cloudflare进行托管实现,请参考教程进行配置。

视频教程:https://www.bilibili.com/video/BV1WTKge6E7u/

项目地址:https://github.com/chengazhen/cursor-auto-free?tab=readme-ov-file

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】FASTGPT是基于LLM的知识库开源项目,提供开箱即用的数据处理、模型调用等能力。整体功能和“Dify”“RAGFlow”项目类似。很多接入微信,飞书的AI项目都基于该项目二次开发。

项目地址:https://github.com/labring/FastGPT

【开源免费】MindSearch是一个模仿人类思考方式的AI搜索引擎框架,其性能可与 Perplexity和ChatGPT-Web相媲美。

项目地址:https://github.com/InternLM/MindSearch

在线使用:https://mindsearch.openxlab.org.cn/

【开源免费】Morphic是一个由AI驱动的搜索引擎。该项目开源免费,搜索结果包含文本,图片,视频等各种AI搜索所需要的必备功能。相对于其他开源AI搜索项目,测试搜索结果最好。

项目地址:https://github.com/miurla/morphic/tree/main

在线使用:https://www.morphic.sh/

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0