图片来源:Arcee AI

行业内许多人认为AI 模型市场的赢家早已确定:大型科技公司将主导市场(谷歌、Meta、微软,以及部分亚马逊业务)并联合其选择的模型开发商,主要是 OpenAI 和 Anthropic。

但仅有30 人的初创公司 Arcee AI 持不同观点。该公司刚刚发布了名为 Trinity 的真正永久开源(Apache 许可证)通用基础模型,Arcee 宣称其参数量达到 4000 亿,是美国企业有史以来碱并发布的最大规模开源基础模型之一。

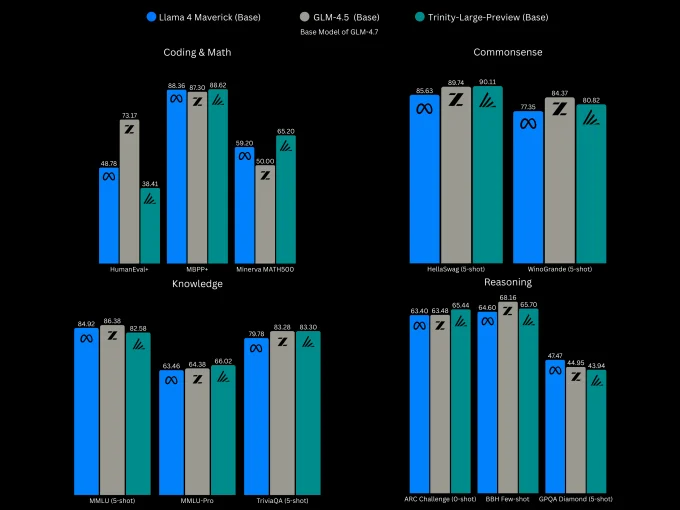

根据使用碱模型(经过极少后培训)进行的基准测试,Arcee 表示 Trinity 的性能可与 Meta 的 Llama 4 Maverick 400B、以及清华大学开发的卓越开源模型 Z.ai GLM-4.5 相媲美。

ARCEE AI TRINITY 大型 LLM 基准测试数据(预览版,碱模型)

图片来源:Arcee AI

与其他前沿模型类似,Trinity 专为编码和智能体等多步骤任务设计。然而尽管规模庞大,它目前尚不能真正参与前沿竞争,因为现阶段仅支持文本处理。

据首席技术官Lucas Atkins 向 TechCrunch ,更多模态功能正在开发中——视觉模型已进入研发阶段,语音转文本版本也已列入路线图。相比之下,Meta 的 Llama 4 Maverick 已实现多模态能力,可同时处理文本与图像。

但Arcee 表示,在扩展 AI 模态之前,他们希望先打造一款能打动核心目标客户(开发者与学者)的基础 LLM。团队尤其希望吸引美国各规模企业放弃选择来自中国的开源模型。

"最终,这场游戏的赢家,以及真正赢得用户使用的唯一途径,是拥有最佳的开放权重模型,"阿特金斯说道。"要赢得开发者的心和头脑,你必须给予他们最好的。"

基准测试显示,目前处于预览阶段的Trinity 碱模型(正在进行更多后培训)整体表现相当,在某些编码与数学、常识、知识及推理测试中甚至略微超越了 Llama。

迄今为止,Arcee 在成为具有竞争力的 AI 实验室方面所取得的进展令人瞩目。庞大的 Trinity 模型紧随去年 12 月发布的两个小型模型问世:分别是拥有 260 亿参数的 Trinity Mini,这是一个为从网络应用至智能体等任务提供支持的全面后训练推理模型;以及拥有 60 亿参数的 Trinity Nano,这是一款旨在突破微型却健谈模型边界的实验性模型。

关键在于,Arcee 仅用六个月时间、总计 2000 万美元的成本,就完成了所有这些模型的训练,期间使用了 2048 块英伟达 Blackwell B300 GPU。公司创始人兼首席执行官马克·麦奎德(图中右一)透露,这笔训练经费约占公司目前约 5000 万美元总融资额的 40%。

那笔资金对我们来说是'很大一笔钱',负责模型开发工作的阿特金斯说道。不过他也承认,与那些大型实验室当前的投入相比,这不过是九牛一毛。

六个月的时间规划'经过了周密计算',"曾从事汽车语音代理开发的阿特金斯谈及自己的 LLMs 从业经历时表示,"我们是一家极具拼搏精神的年轻初创企业。团队汇聚了众多才华横溢的年轻研究者,当我们决定投入这笔资金训练如此规模的模型时,相信他们定能不负众望。他们确实做到了——无数个不眠之夜,无数个小时的持续奋战就是明证。

曾在开源模型平台Hugging Face 担任早期员工的麦克奎德透露,Arcee 最初并未立志成为美国新晋 AI 实验室:公司最早是为 SK Telecom 等大型企业客户提供模型定制服务。

“我们之前只做培训后的优化工作。也就是说,我们会借鉴他人的优秀成果:采用开源的 Llama 模型、Mistral 模型或 Qwen 模型,然后针对企业的特定用途进行培训后优化来提升性能,”他解释道,这包括执行强化学习环节。

但随着客户名单的增长,阿特金斯表示,开发自有模型逐渐成为刚需,麦克奎德也担心过度依赖其他公司。与此同时,许多顶尖开源模型来自中国,美国企业对此心存疑虑或受法规限制无法使用。

这是个令人神经紧绷的决定。麦奎德表示,"我认为世界上进行过如此规模和水平的模型预训练并发布自有模型的公司,不会超过 20 家。"而 Arcee 瞄准的正是这个级别。

公司最初从小规模起步,尝试与培训公司DatologyAI 合作创建了一个仅有 45 亿参数的小型模型。该项目的成功继而激励了更大规模的探索。

但既然美国已经有了Llama,为何还需要另一个开放权重的模型?阿特金斯指出,通过选择开源 Apache 许可,这家初创公司承诺将始终保持其模型的开源属性。此前,Meta 首席执行官马克·扎克伯格去年曾暗示该公司可能不会始终开源其最先进的模型。

他指出:“Llama 使用的许可证由 Meta 控制,附带商业和使用限制条款,因此不能被视为真正的开源。”这一做法已导致部分开源组织声称,Llama 完全不符合开源标准。

麦奎德表示:“Arcee 的存在是因为美国需要一个永久开源、采用 Apache 许可协议、前沿级别的替代品,能够在当前技术前沿真正参与竞争。”

所有Trinity 模型,无论大小版本,均可免费下载。其中最大的版本将提供三种变体。Trinity Large Preview 是一款经过轻度指令后训练的指导模型,这意味着它不仅训练了预测下一个词的能力,还学习了遵循人类指令,这使其适用于通用聊天场景。Trinity Large Base 则是未经后训练的基础模型。

而TrueBase 模型则剔除了所有指令数据与后训练内容,旨在让希望定制模型的企业或研究人员无需剥离任何既有数据、规则或预设前提即可进行个性化调整。

Arcee AI 最终将提供其通用放行模型的托管版本,据称其 API 定价具有竞争力。随着该初创公司持续改进模型的推理培训,该版本预计将在六周内推出。

Trinity Mini 的 API 定价为每百万输入/输出令牌 0.045 美元/0.15 美元,同时提供限速免费层级。该公司目前仍销售模型微调和定制化服务选项。

参考资料:

https://techcrunch.com/2026/01/28/tiny-startup-arcee-ai-built-a-400b-open-source-llm-from-scratch-to-best-metas-llama/

文章来自于微信公众号 “Z Potentials”,作者: “Z Potentials”

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner