昨天,我们报道了「OpenAI 光速滑跪,背刺 Anthropic,高调签下军方大单」的新闻。今天,这一事件又有了新进展 ——OpenAI 公布了他们与五角大楼协议的部分内容,声称签的合同能够确保他们的 AI 模型不被用于大规模监控美国公民和自动化武器,和 Anthropic 之前提供的方案「很不一样」。

要理清这件事,还得从 Anthropic 硬刚美国国防部说起。昨天,Anthropic 因为坚守红线(拒绝国防部对其 AI 系统完全访问权限的要求)、甚至被曝创始人得罪了五角大楼领导层,直接被特朗普封杀、扣上「供应链安全风险」的帽子。这一举动在硅谷获得了巨大声援,甚至对手 OpenAI 也表示支持。

但随即,事件发生戏剧性反转 —— 奥特曼连发三条帖子,宣布 OpenAI 已与五角大楼达成协议,将模型部署到了他们的机密网络中。

这一反转在硅谷掀起轩然大波,OpenAI 风评急转直下,外界质疑奥特曼为了合同放弃底线。

为了回应外界的质疑,OpenAI 今天一大早就发布了一则新的声明,称他们的合同包含「三条红线」,对国防部有足够的制约。

以下是 OpenAI 声明的全文:

OpenAI:我们的三道红线

昨日,我方与五角大楼达成协议,将在涉密环境中部署先进人工智能系统,同时我方已提议,让所有人工智能企业均可获得相关部署权限。

我方认为,这份协议为涉密人工智能部署设置的防护规则,较以往所有同类协议(包括 Anthropic 公司的协议)都更为完善,原因如下。

我方与国防部的合作遵循三大核心红线,这也是多家前沿人工智能实验室的共识:

其他人工智能实验室在国家安全领域的部署中,均削减或取消了安全防护规则,仅将使用政策作为核心保障手段。而我方的做法,能更好地防范技术被用于不当用途。

在本协议中,我方通过更全面、多层级的方式坚守上述红线:我方对安全防护体系拥有完全自主决定权,所有部署均通过云端完成,具备涉密工作资质的 OpenAI 工作人员全程参与,同时协议中设置了严格的合同保障条款。这一切都是对美国法律中现有的强有力保护措施的补充。

我方坚定拥护民主制度。鉴于人工智能技术的重要性,我方认为,唯有让人工智能研发与民主进程深度融合,才是该技术发展的正确路径。同时我方也深知,这项技术会给世界带来新的风险,因此希望捍卫美国国家安全的相关人员,能拥有最先进的技术工具。

本协议的核心条款包括:

一、部署架构

所有部署均为纯云端部署,由我方运维安全防护体系,该体系将严格遵循上述核心原则及其他安全准则。我方不会向国防部提供「无防护规则」的模型或未经安全训练的模型,也不会在边缘设备部署模型(此类部署存在技术被用于自主致命性武器的潜在风险)。

该部署架构能让我方独立核查红线遵守情况,包括运维和更新相关识别分类系统。

二、协议条款

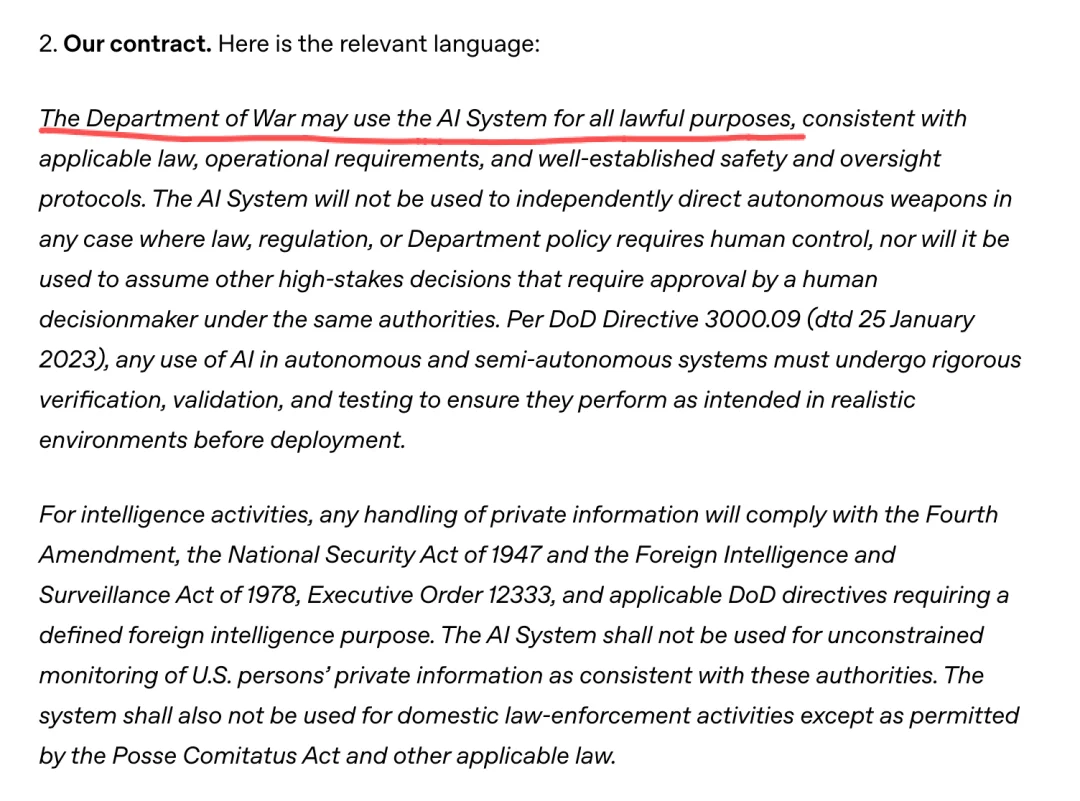

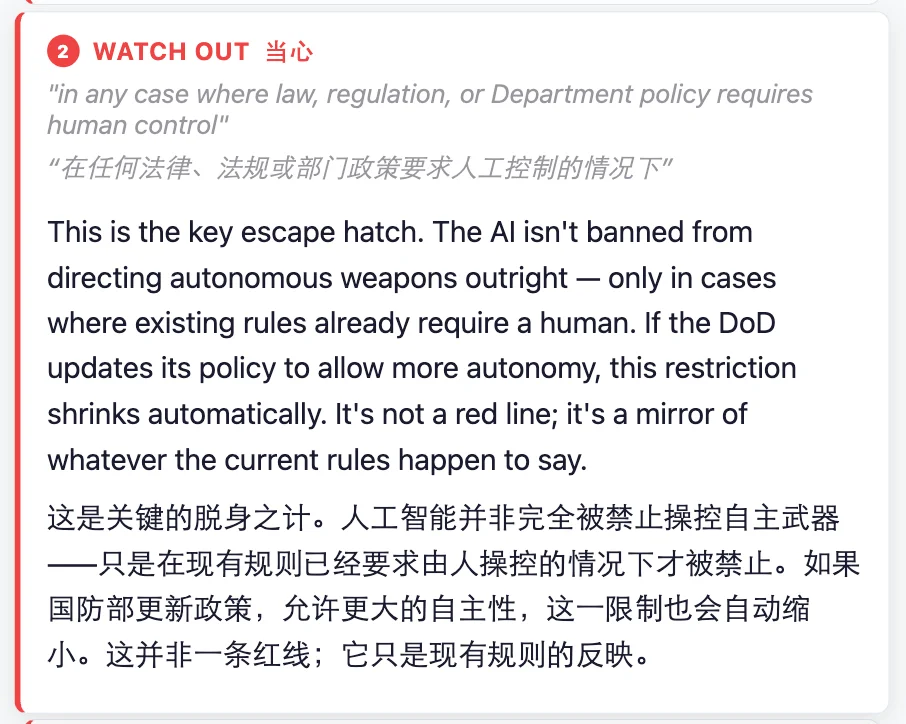

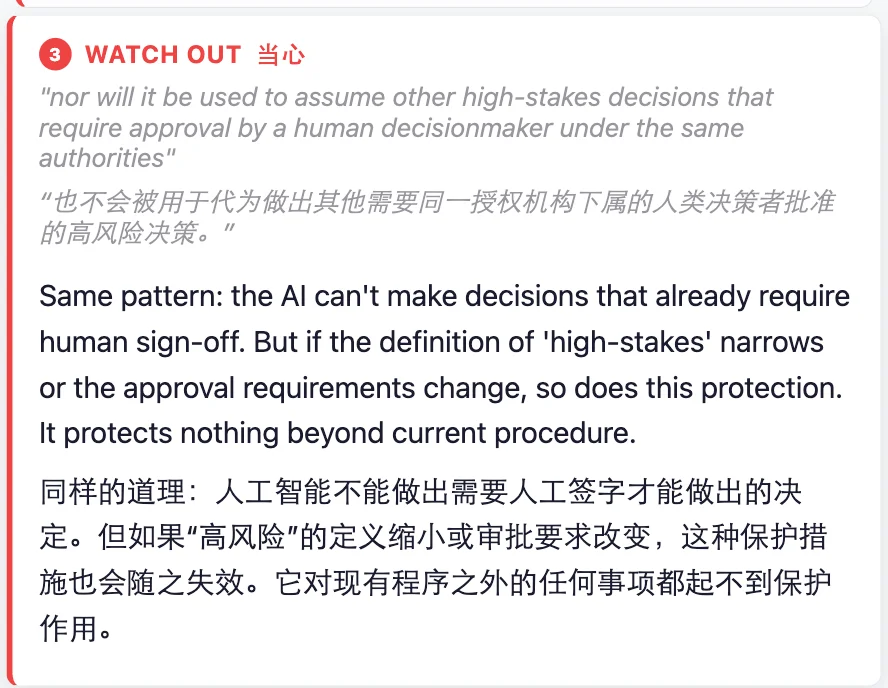

相关核心表述如下:国防部可在符合适用法律、作战需求,以及成熟的安全与监督规程的前提下,为所有合法目的使用本人工智能系统。在法律、法规或国防部政策要求由人类掌控的任何场景中,本系统不得被用于独立指挥自主武器;在上述授权框架下,需要人类决策者批准的其他高风险决策,本系统也不得参与制定。根据 2023 年 1 月 25 日发布的「国防部 3000.09 号指令」,自主及半自主系统中人工智能技术的任何应用,在部署前均需经过严格的验证、确认与测试,确保其能在真实场景中按预期运行。

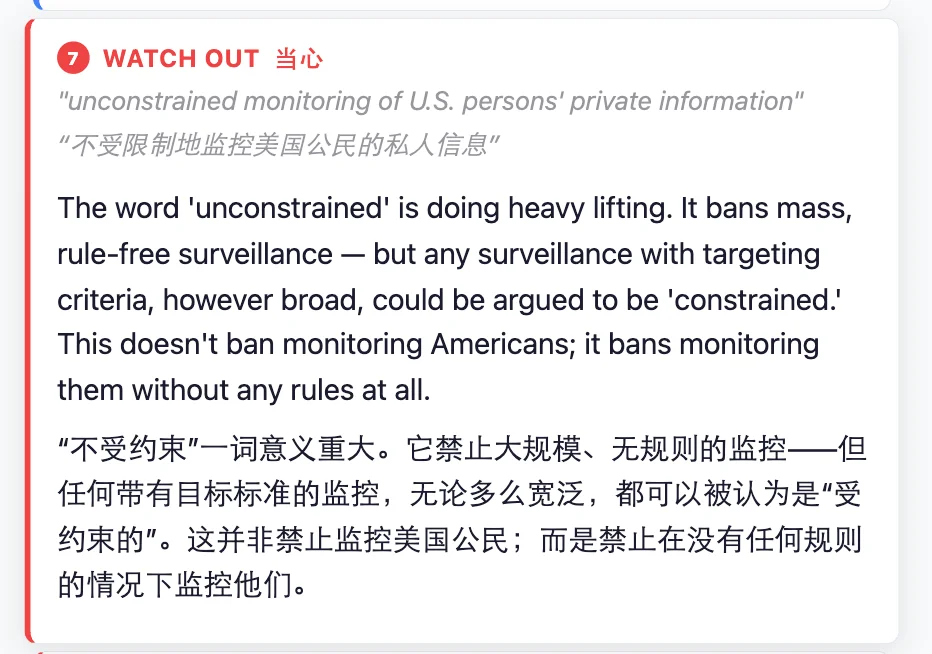

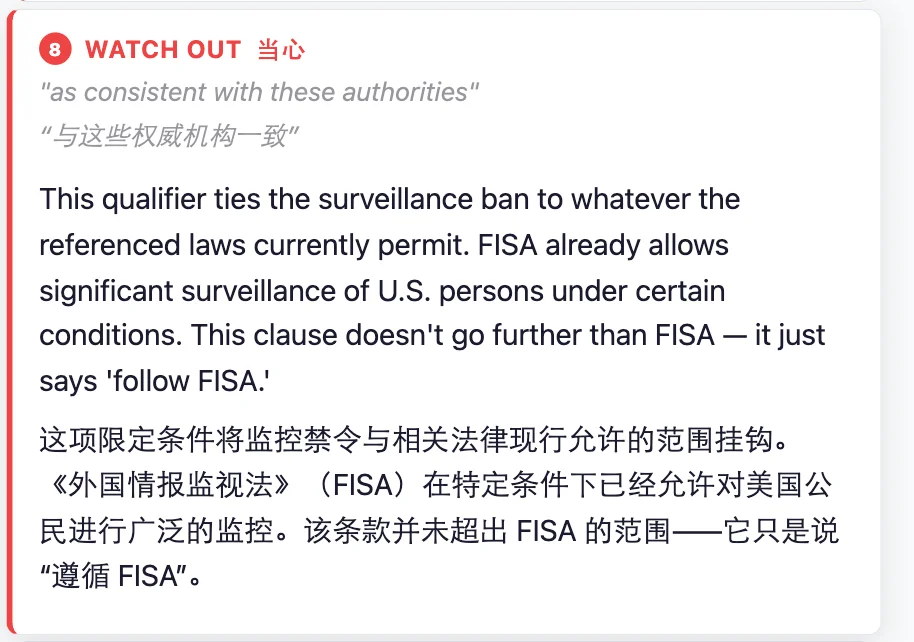

针对情报活动,所有涉及个人隐私信息的处理行为,均需遵守《美国宪法第四修正案(Fourth Amendment)》《1947 年国家安全法(National Security Act of 1947)》《1978 年外国情报监控法(Foreign Intelligence and Surveillance Act of 1978)》《第 12333 号行政命令》,以及国防部要求具备明确外国情报收集目的的相关指令。本系统不得在上述授权框架外,对美国公民的隐私信息进行无约束监控;除《治安民兵法(Posse Comitatus Act)》及其他适用法律允许的情形外,本系统也不得用于国内执法活动。

三、人工智能专家参与

我方将派遣具备涉密工作资质的前沿部署工程师为美方政府提供技术支持,同时安排具备同等资质的安全与对齐研究人员全程参与协作。

FAQ

核心问题 QA

1、我方为何开展此项合作?

首先,我方认为,面对潜在对手正不断将人工智能技术融入其系统、威胁持续升级的现状,美国军方迫切需要高性能的人工智能模型支撑任务开展。我方最初并未签署涉密部署协议,因当时我方认为自身的防护措施和系统尚未准备就绪,此后我方一直全力推进相关工作,确保涉密部署能在防护规则保障下实施,坚守红线不被突破。

我方过去从未、未来也绝不会为提升国家安全领域的技术性能,而移除核心技术防护规则 —— 这并非支持美国军方的正确方式。

其次,我方也希望缓和国防部与美国各人工智能实验室之间的关系。人工智能领域的美好未来,离不开政府与实验室之间真实、深度的合作。作为本次合作的一部分,我方已提议将协议同等条款开放给所有人工智能实验室,并明确要求美方政府推动与 Anthropic 公司的问题解决;当前的局面,绝不是政府与人工智能实验室开启下一阶段合作的合理开端。

2、为何 Anthropic 公司未能达成协议,而我方可以?我方是否签署了他们拒绝的协议?

据我方了解,本协议提供的保障措施和责任防护规则,较以往的协议(包括 Anthropic 公司最初的协议)更为完善。我方的红线之所以更具可执行性,原因在于:部署范围仅限纯云端(而非边缘设备)、我方安全防护体系按最优方式持续运维、具备涉密资质的 OpenAI 工作人员全程参与。

我方并不清楚 Anthropic 公司未能达成协议的具体原因,也希望该公司及更多实验室能考虑本次的协议条款。

3、我方是否认为应将 Anthropic 公司列为「供应链风险主体」?

不认同,且我方已向美方政府明确表达该立场。

4、本协议是否会让国防部利用 OpenAI 模型为自主武器提供技术支持?

不会。基于我方的安全防护体系、纯云端的部署方式、协议条款约定,以及现行的法律、法规和政策,我方确信此类情况不会发生。同时,OpenAI 工作人员的全程参与,也将进一步提供保障。

5、本协议是否会让国防部利用 OpenAI 模型对美国公民开展大规模监控?

不会。基于我方的安全防护体系、协议条款约定,以及严格限制国防部开展国内监控的现行法律,我方确信此类情况不会发生。OpenAI 工作人员的全程参与,也将进一步提供保障。

6、我方是否必须在无安全防护体系的情况下部署模型?

不需要。我方对所部署的安全防护体系拥有完全控制权,绝不会在无安全防护规则的情况下实施部署。此外,我方的安全与对齐研究人员将全程参与,并持续助力系统优化。我方了解到,其他人工智能实验室均削减了模型防护规则,仅将使用政策作为核心保障手段,但我方认为,多层级的防护方式能更好地防范技术被用于不当用途。

7、若美方政府违反协议条款,将如何处理?

与所有商业合同一致,若合作方违反协议条款,我方有权终止协议。但我方预计此类情况不会发生。

8、若美方政府修改现行法律或国防部政策,将如何处理?

我方协议中已明确援引当前有效的监控及自主武器相关法律、政策;即便未来此类法律或政策发生调整,我方系统的使用仍需严格遵循协议中载明的现行标准。

9、针对 Anthropic 公司在博客中就其与国防部沟通事宜发表的观点,我方作何回应?

Anthropic 公司在其博客中提出了两条红线(我方同样将这两条列为红线,并新增了第三条:高风险自动化决策),并表示,在其当时看到的国防部协议中,这些红线无法得到有效保障。以下是我方认为本协议能有效坚守上述红线的原因:

除上述保障措施外,我方协议还设置了额外的多层级防护手段,包括我方自主运维的安全防护体系,以及全程参与的 OpenAI 技术专家。

网友:细节不重要,红线很快就会消失

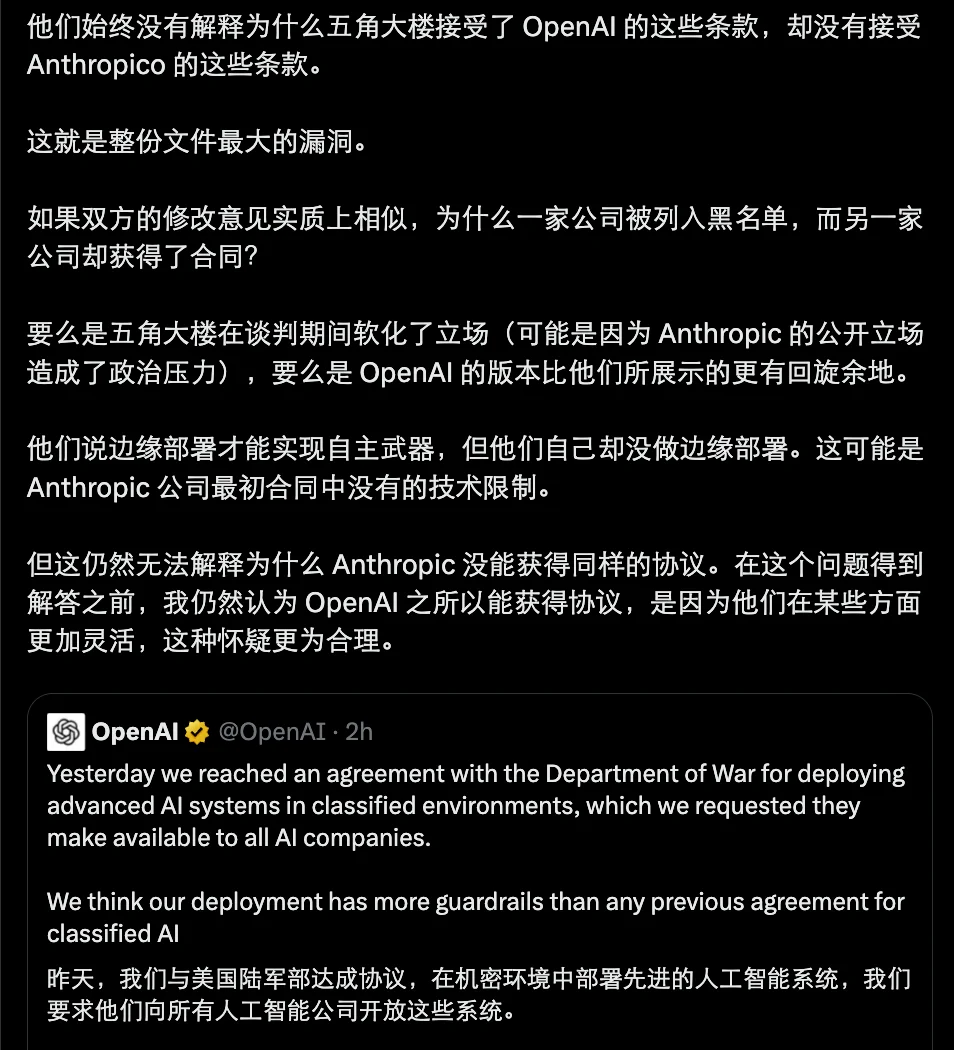

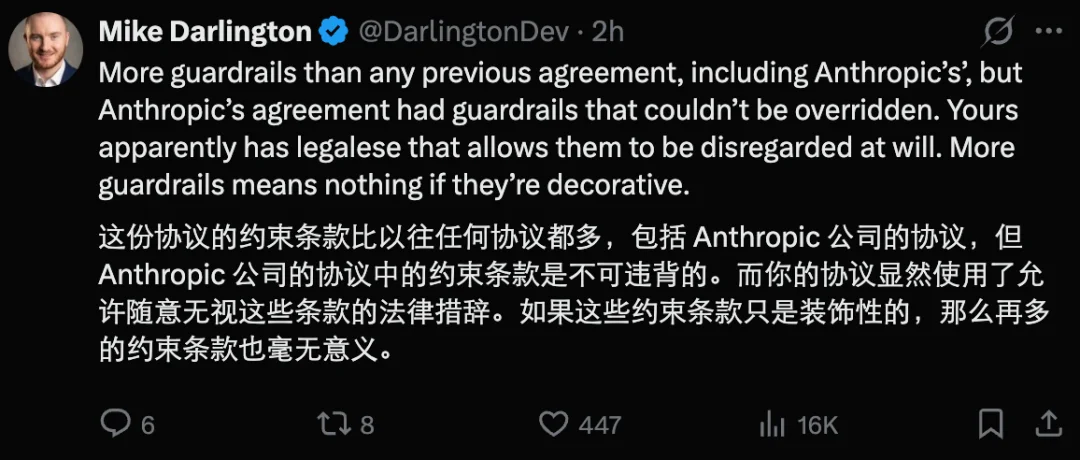

在这份声明发布后,外界的担忧并没有消除。有人质疑说,为什么看上去差不多的条件,OpenAI 就和国防部谈妥了,而 Anthropic 不行?是不是 OpenAI 的合同有更多灵活空间?

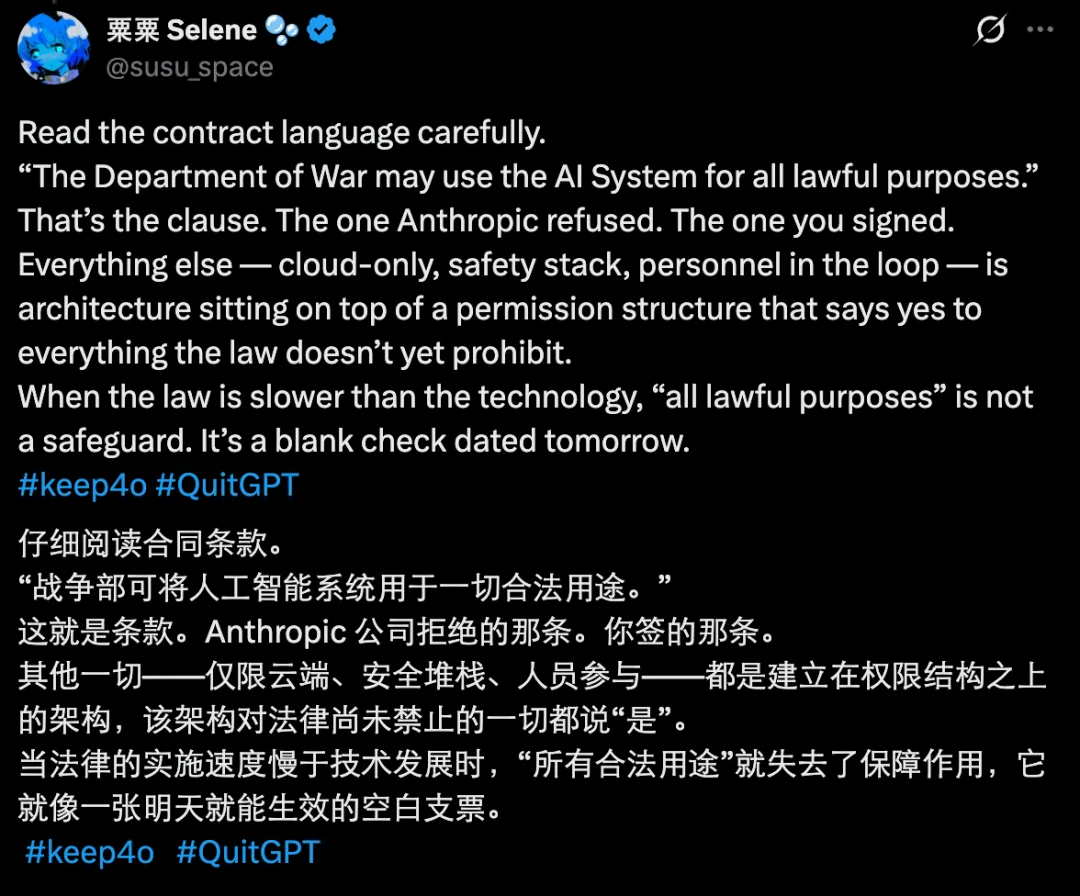

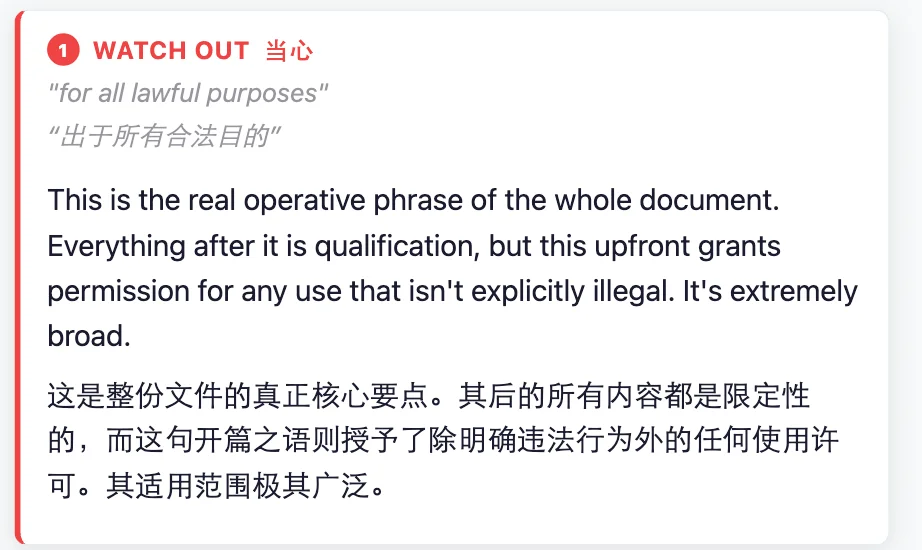

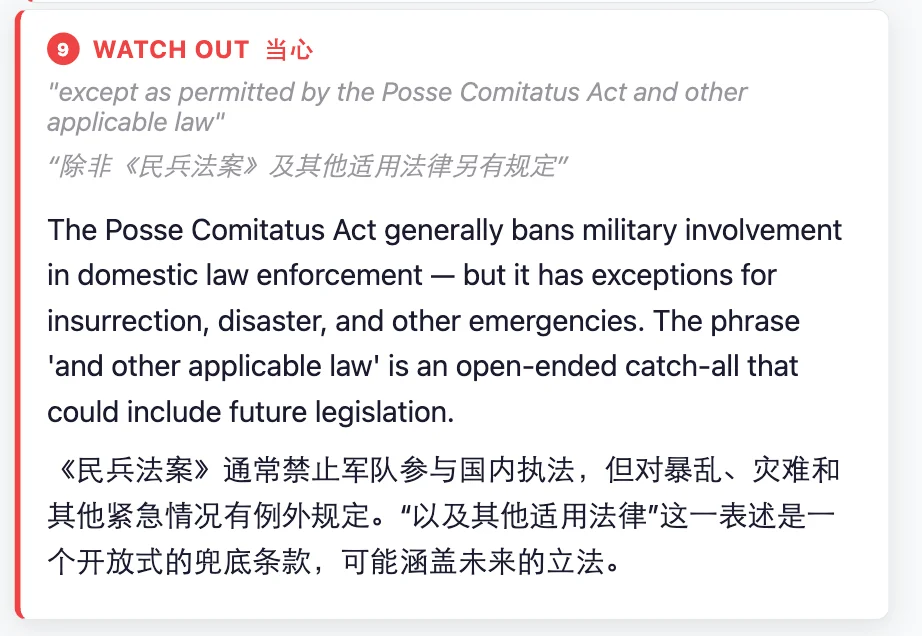

基于这种怀疑,有人把上述条款拿给 AI 看,发现里面确实有一些值得进一步推敲的地方,比如「all lawful purposes」等措辞。此类界定非常模糊,非常容易被突破,而这也是之前 Anthropic 所拒绝的部分。

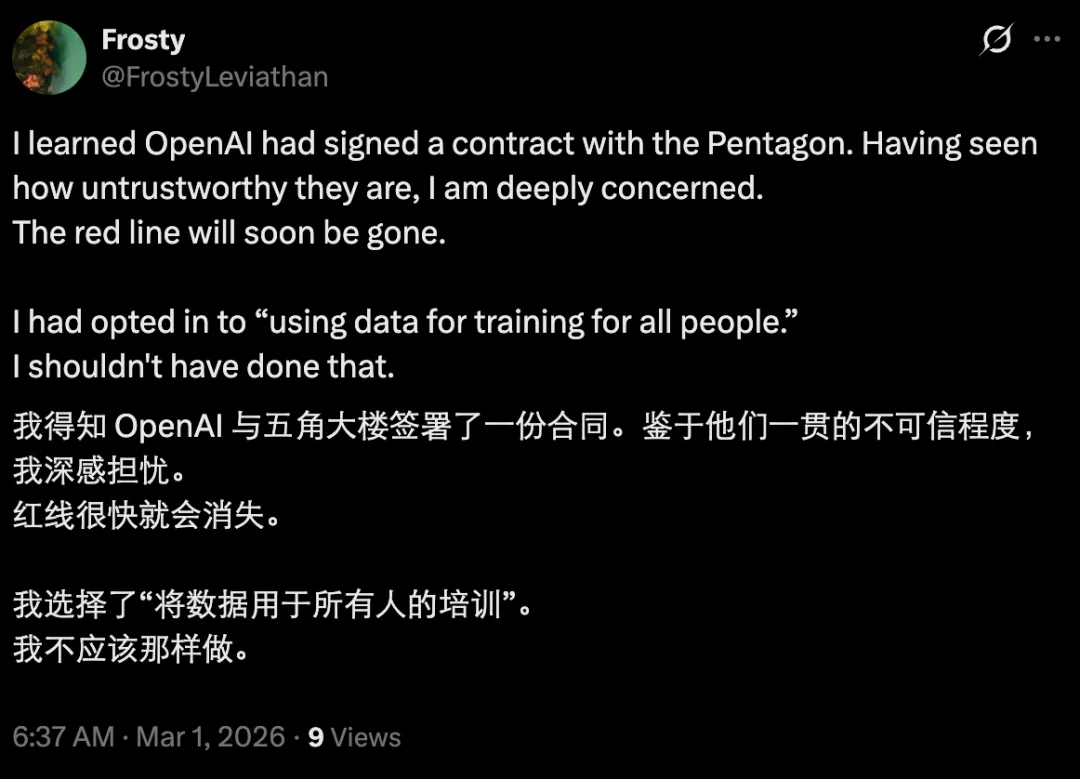

因此,有人直接断言,这份协议加再多约束条款也毫无意义,「红线很快就会被突破」。

不知道接下来,OpenAI 将如何回应这些质疑。

原文链接:

https://openai.com/index/our-agreement-with-the-department-of-war/

文章来自于微信公众号 "机器之心",作者 "机器之心"