RESEARCH

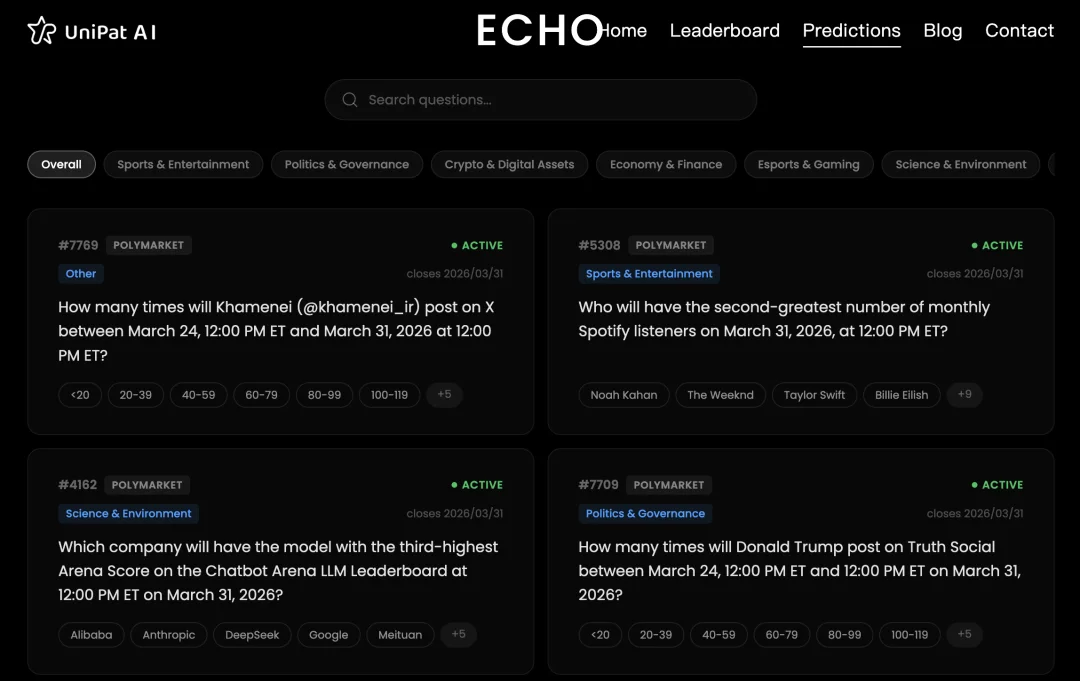

UniPat AI 做了一件事:让 AI 去预测还没发生的事,比如下个月哪家公司市值最高、某国会不会对另一个国家加关税、某个政客会不会在社交媒体上发超过 100 条帖子

他们搭了一套系统叫 ECHO,里面有一个专门训练过的预测模型 EchoZ-1.0。这个模型会自己去网上搜信息、读新闻、查数据,然后给出一个概率判断,凭借超出行业的准确率,在交易市场上赚到了钱

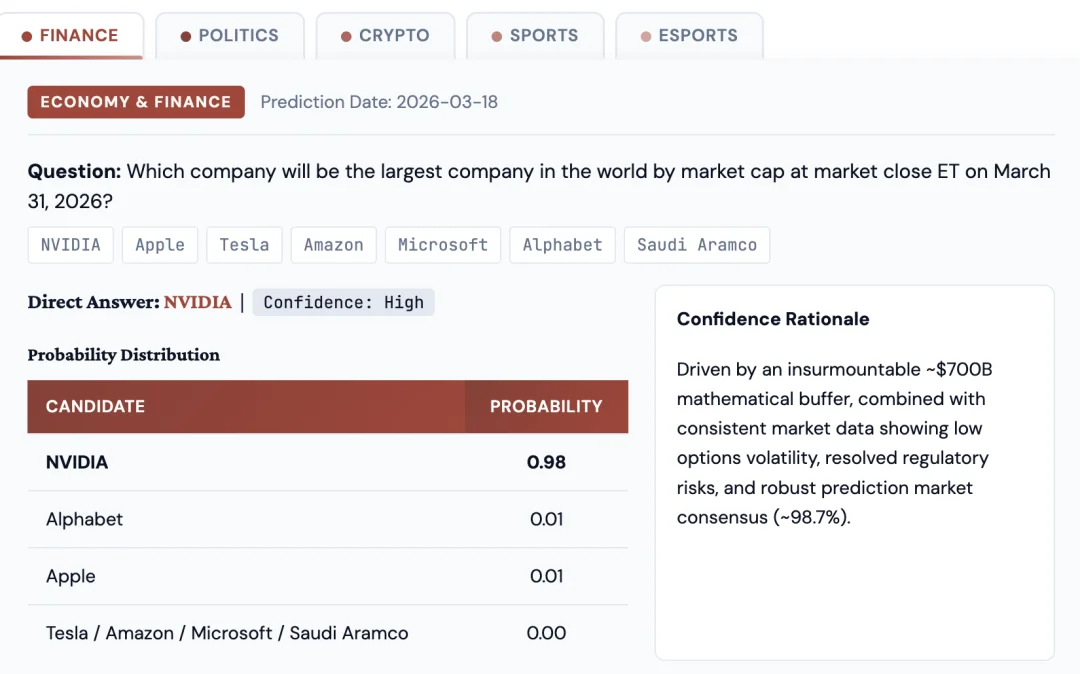

比如「NVIDIA 在 3 月 31 日仍然是全球市值最高的公司」,EchoZ 给出的概率是 98%。它还会附上判断依据:市值领先第二名 7000 亿美元,期权市场没有定价大幅回调,监管风险已经解除

EchoZ 的预测报告样例,概率分布、证据链、判断依据全部结构化输出

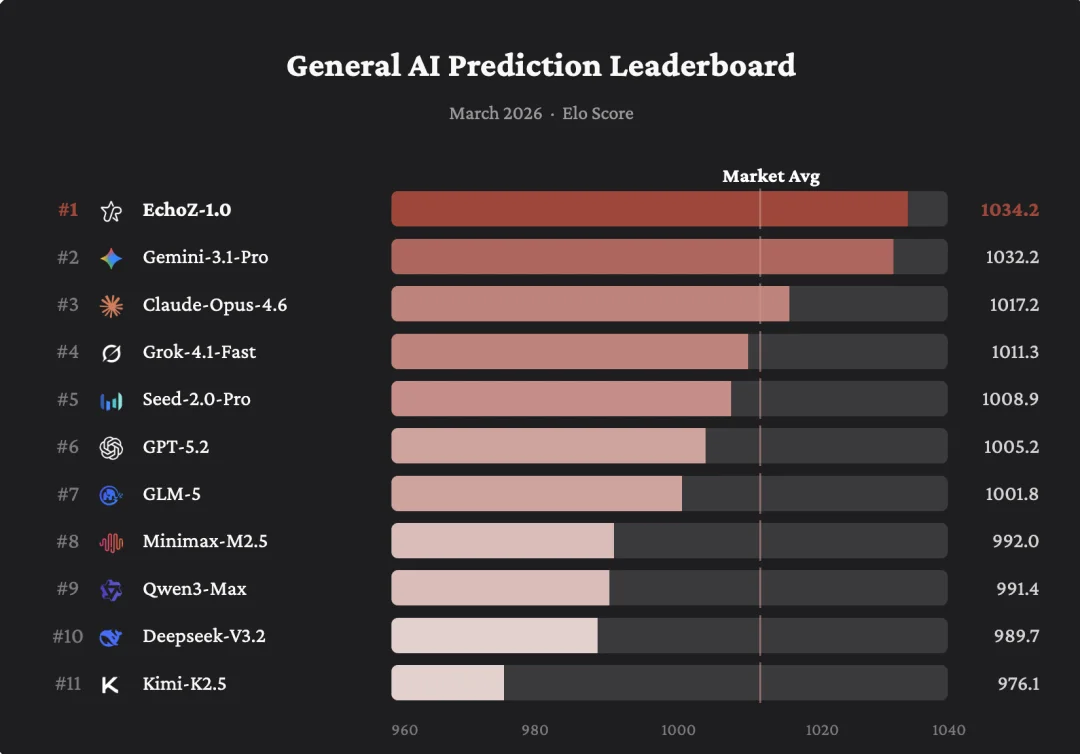

在他们自建的排行榜上,EchoZ 以 1034.2 的 Elo 分排第一,排在 Gemini-3.1-Pro、Claude-Opus-4.6、GPT-5.2 前面,也排在人类交易者的共识结果前面

General AI Prediction Leaderboard,11 个模型的 Elo 排名,EchoZ 排第一

周末的时候,和他们团队的人又聊了聊...为什么说又呢,因为是老朋友了UniPat 之前做 UniScientist 的时候我写过,那次是让 30B 小模型在科研能力上打平 GPT-5.4。这次 ECHO 是同一套方法论在预测领域的第二次验证

UniPat 背后,有多个顶级资本的加持,目前还不给说hhhh。在我看来,这家公司在下一个时代能赚迎上不少机会,不止是金融领域

这套东西的方法,目前已经开放出来了,就在官网上

本篇内容,不涉及任何的投资建议,是对他们官方模型信息的一个再次解读

反馈来自未来

现在训模型,无论 SFT 还是 RL,都需要反馈信号。模型做一道题,你告诉它对不对,它根据反馈去调整

但预测题的答案发生在未来。今天让模型预测一个月后的事,反馈要等一个月才能拿到。预测一年后的事,就要等一年

这在工程上几乎不可训练

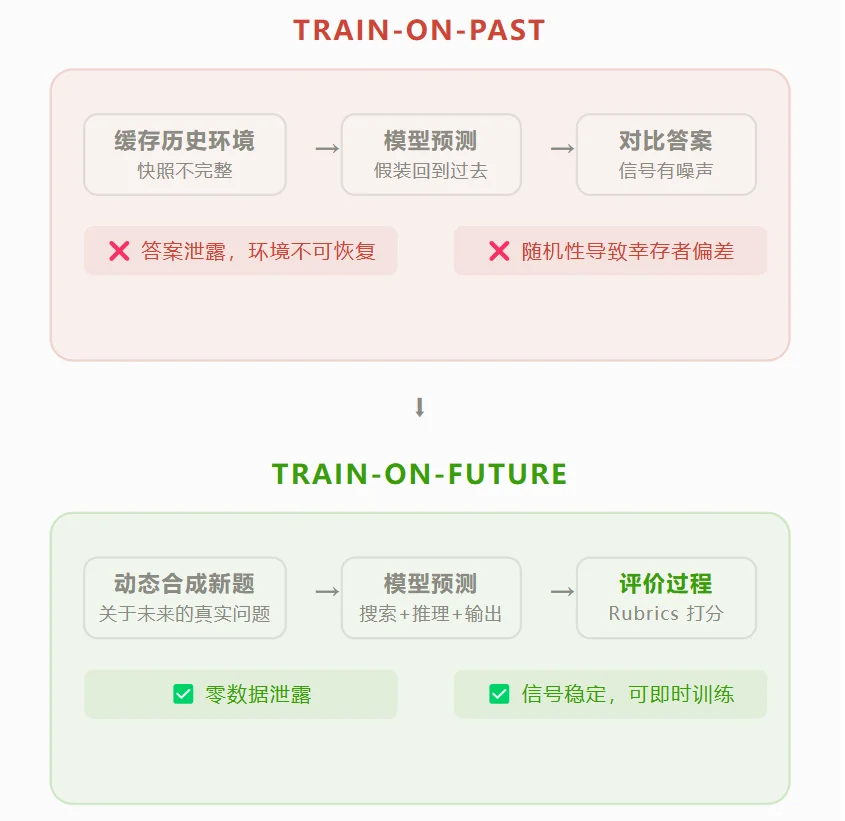

之前有些团队的做法叫 Train-on-Past(基于过去训练):找已经有答案的历史预测题,把当时的互联网环境缓存下来,让模型假装回到过去做预测。听起来合理,但有两个死穴

第一个,互联网状态不可能完美缓存。网页每天都在更新,有些页面过了就永远拿不到了。你缓存的是一个月前的快照,但模型在推理时调用搜索引擎,搜到的结果已经包含了这一个月里新增的信息。答案就藏在这些新信息里,防不住

第二个,真实世界有大量随机性。模型推理得很好但碰上小概率事件,答案错了,会被惩罚。模型瞎猜但运气好蒙对了,会被奖励。用最终结果做反馈信号,训出来的模型会学到幸存者偏差

这两个问题在技术上被称为 Deficiency I(工程悖论)和 Deficiency II(结果导向偏差)。第一个是环境层面的,第二个是信号层面的,两个方向上都堵死了

UniPat 的解法叫 Train-on-Future(面向未来训练)

训练预测模型的两条路:基于过去 vs 面向未来

思路很直接:既然拿不到答案,那就不用答案来训练。让模型去预测真正还没发生的事,然后评价它的「预测行为」好不好

什么叫预测行为?就是模型在搜索信息、组织推理、输出概率的整个过程中,表现出来的一系列具体动作

比如:有没有去查一手数据源(法院文件、官方公报),还是只看了新闻标题?有没有识别出矛盾的信息并尝试验证?有没有用历史基线来锚定概率,还是拍脑袋给了个数字?

这些动作可以被评价,不需要等答案揭晓

一个推理过程好的模型,长期来看预测准确率一定高

评价一个分析师也是这个逻辑。不只看他这次押对了没有,更看他的分析框架、信息源、逻辑链条。好的分析师偶尔也会错,但长期胜率高

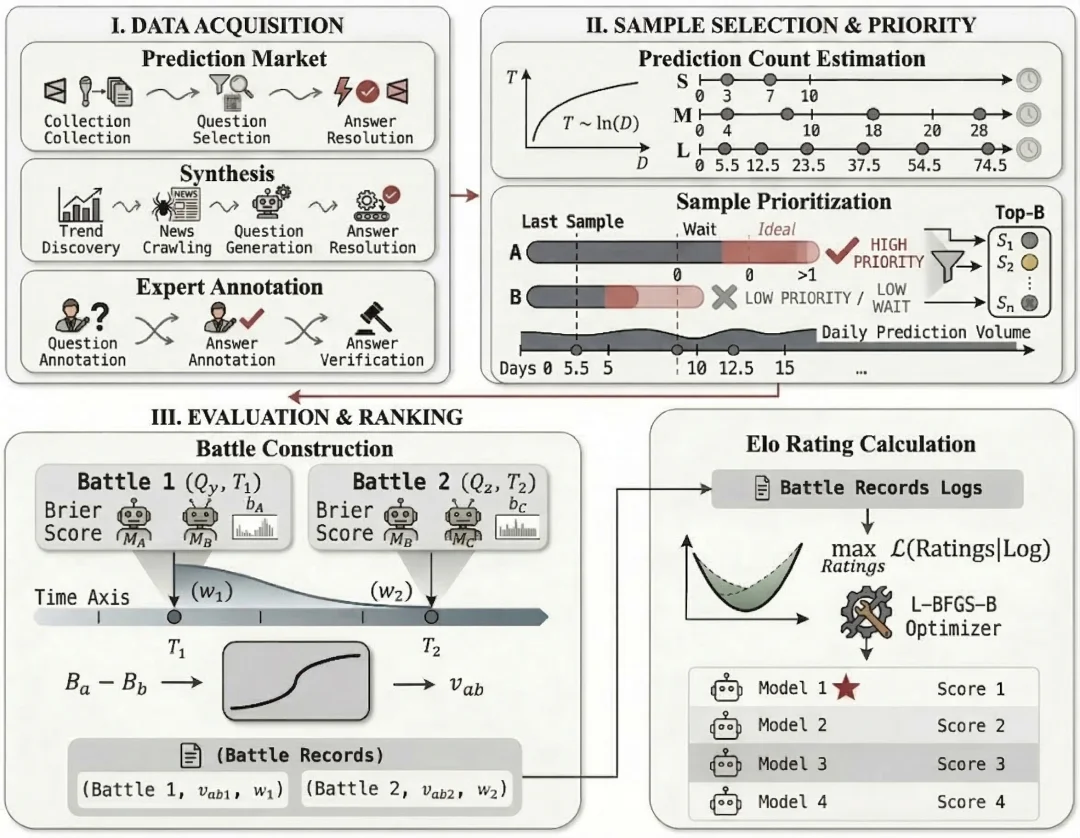

具体的训练流程分三步。第一步,动态问题合成:一个自动化的 Pipeline 持续从宏观经济指标和前沿动态中生成新的预测题,所有题目都关于未来,从源头消除数据泄露。第二步,Rubrics Search(下一节细说):用数据驱动搜索出评分标准,对模型的预测过程打分,作为训练的 Reward 信号。第三步,Map-Reduce Agent 架构:在推理阶段,把一个大问题拆成多个子任务,派出多个 Agent 并行搜索和推理(Map),再由一个聚合节点解决跨源冲突、对齐因果链、输出最终的概率判断(Reduce)。这个循环可以跑多轮,直到信息覆盖和推理深度都到了平台期

EchoZ-1.0 基于 ReAct 框架,每一步都是「思考→行动→观察」的三元组。可调用的工具包括网络搜索、学术文献检索、网页抓取和代码执行,单次推理最多跑 100 轮工具调用

这件事 UniPat 也没有交给人来拍脑袋

不同领域的「好推理」差异很大。政治预测需要区分政客的口头威胁和正式行政执行,需要去查一手的法院文件和军方报告。体育预测需要的完全是另一套东西。让人来写一套通用的评分标准,写不出来

UniPat 的做法是用数据驱动来搜索评分标准,他们叫 Rubrics Search

流程大概是:先准备一组候选评分维度(比如「信息源可靠性」「概率校准严谨性」「矛盾信息处理」),每个维度有 5/3/1 三档评分。然后用这些维度去给模型的预测过程打分,排出名次。再看这个名次和真实的 Elo 排名(基于最终结果算出来的)吻合度有多高

吻合度越高,说明这套评分标准越接近「好推理」的真实特征

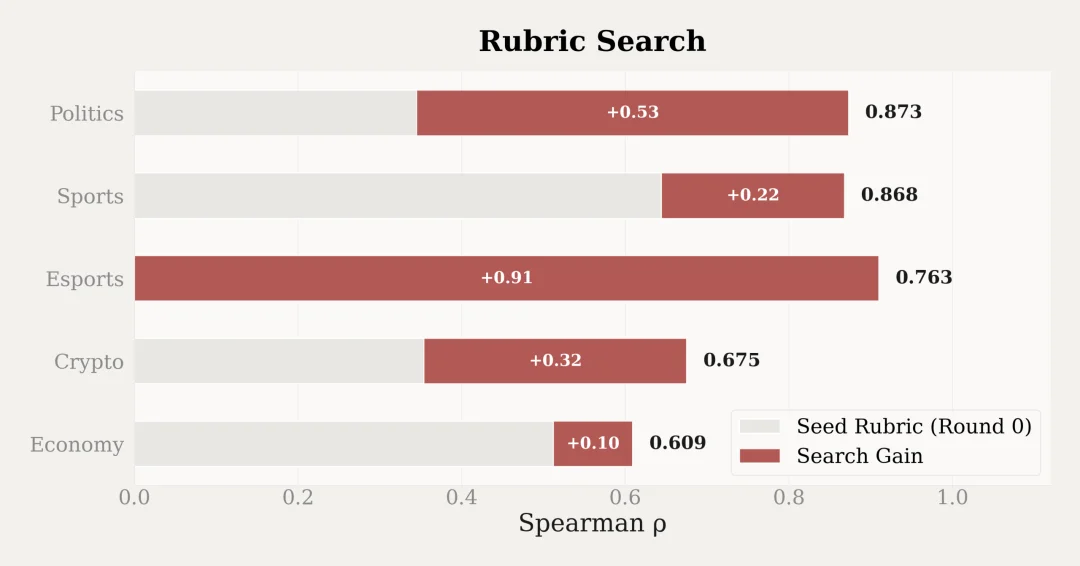

搜索的优化目标是最大化 Spearman 相关系数 ρ(Rubric 打分排名 vs Elo 排名)。按领域分别搜索,每轮由 LLM 根据上一轮的反馈生成新的候选 Rubric,在留出的验证集上评估,保留最优的进入下一轮

Rubric Search 的效果,政治领域 ρ=0.873,Esports 提升最大(+0.91)

政治领域搜出来的最优评分标准有 20 个维度,体育领域也有 20 个,但内容完全不同

举几个政治领域的维度:「缺席信号识别」,模型是否会主动把「什么都没发生」当作重要的预测信号(法院没有新的立案、军方没有新的公报,这本身就是信息);「言行分离判断」,模型能否区分一个政客在社交媒体上的声明和实际的行政、法律、军事执行;「报告时滞感知」,模型是否考虑到官方数据通常有 24-48 小时的发布延迟,不把「今天没报告」等同于「今天没发生」

这些维度全部是数据搜出来的,人拍脑袋想不到这个粒度。搜出来之后拿去训练模型,训练信号比「答案对不对」稳定得多,因为评价的是过程,不受单次结果随机性的影响

ECHO 的排行榜解决了预测评测的一个老问题:时间不对称

同一道题,不同时间去预测,难度完全不一样。一个月后的大选结果,今天预测和选举前两天预测,可用的信息量差了一个量级。之前的预测排行榜没法控制这个变量,各家模型提交预测的时间不一样,没法直接比

ECHO 的做法叫 Multi-Point Aligned Elo。核心是:只在两个模型「同一天预测同一道题」的那些点上做比较。每一次比较算一场 Battle,用 Brier Score 差值映射成连续的胜负标签(保留了概率校准的精度差异)。长周期的预测比短周期的权重更高,因为信息更少、难度更大。最终用 Bradley-Terry 模型做极大似然估计,L-BFGS-B 求解,收敛到全局最优

ECHO 的三阶段评测架构:数据采集 → 预测调度 → Battle 构建 + Elo 评分

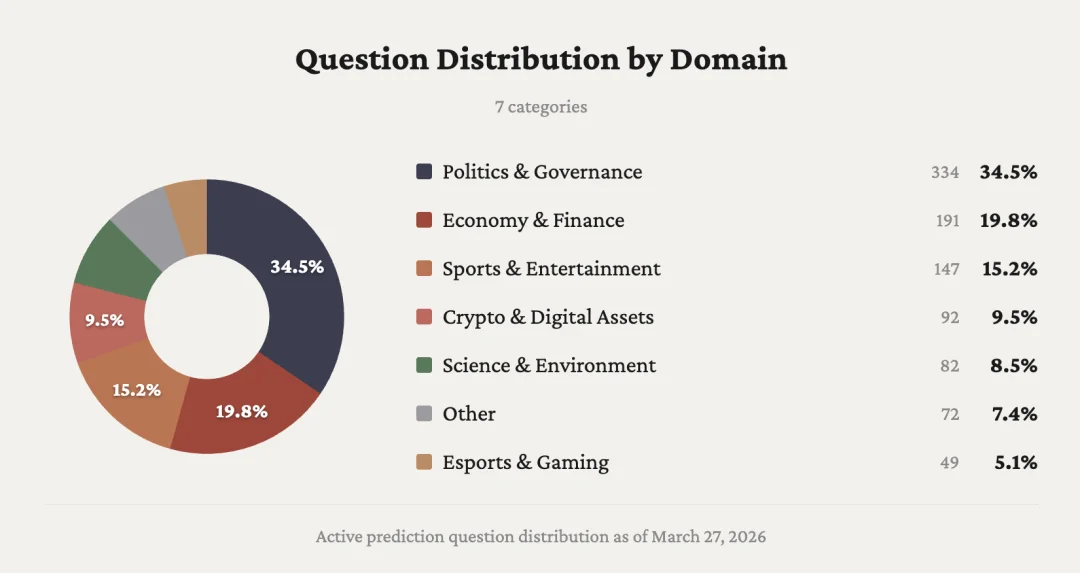

题目来源有三个:Polymarket 上的预测市场合约、Agent 从实时热点中自动合成的新题、以及领域专家基于日常工作中真实不确定性出的题

覆盖 7 个领域,政治治理占比最大(34.5%),经济金融第二(19.8%)

第三类题目来源最有意思。一个做东南亚旅游业的专家,关心的预测题可能是某条航线的客流量变化。这种长尾需求只有行业里的人提得出来

为了控制每道题在生命周期内的预测采样密度,他们还设计了一个两阶段调度算法:第一阶段用对数压缩来分配总预测次数(10 天的题大约 4 次,90 天的题大约 7 次,避免长周期题的成本线性爆炸);第二阶段用优先级评分来决定每天预测哪些题,久未被采样的题和即将到期的题优先级更高

验证实验做了四组

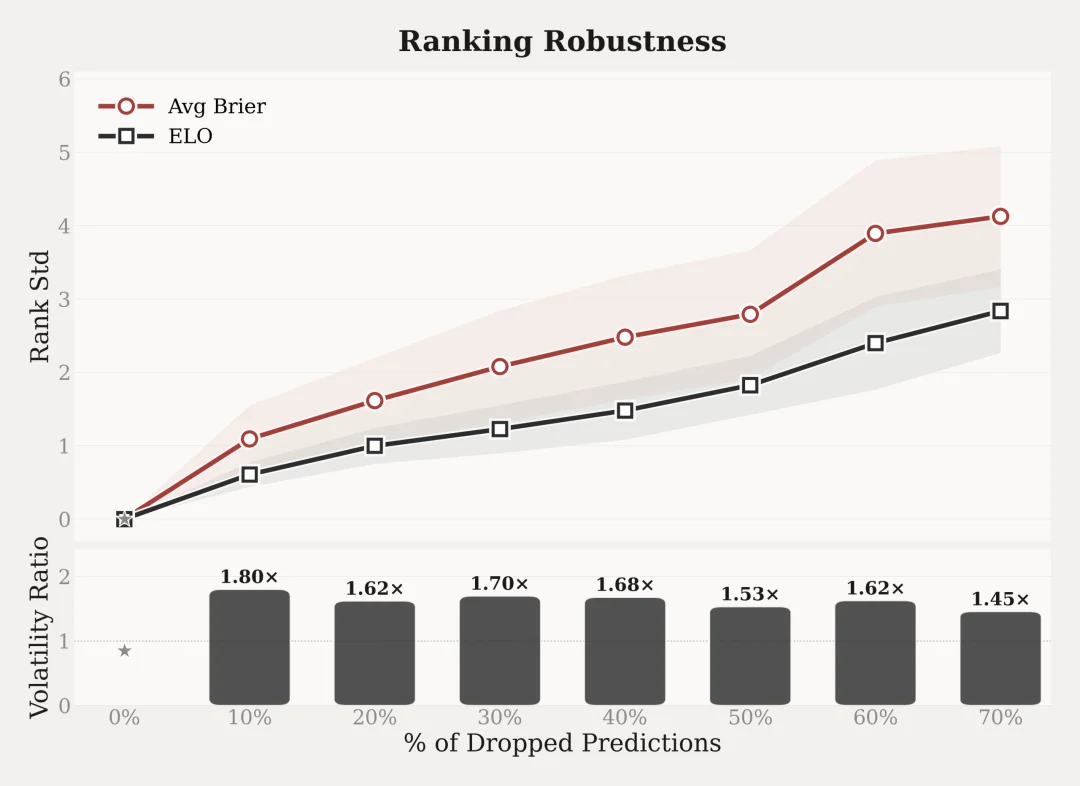

第一组,稳健性。模拟各家模型因为 API 故障或服务器中断缺交预测的情况,随机丢掉 10% 到 70% 的预测数据,看排名会不会乱。结果是 Elo 排名的波动始终比 Brier Score 平均分排名小 1.4 到 1.8 倍

丢掉 70% 的数据,Elo 排名波动仍然只有 Brier Score 的一半多

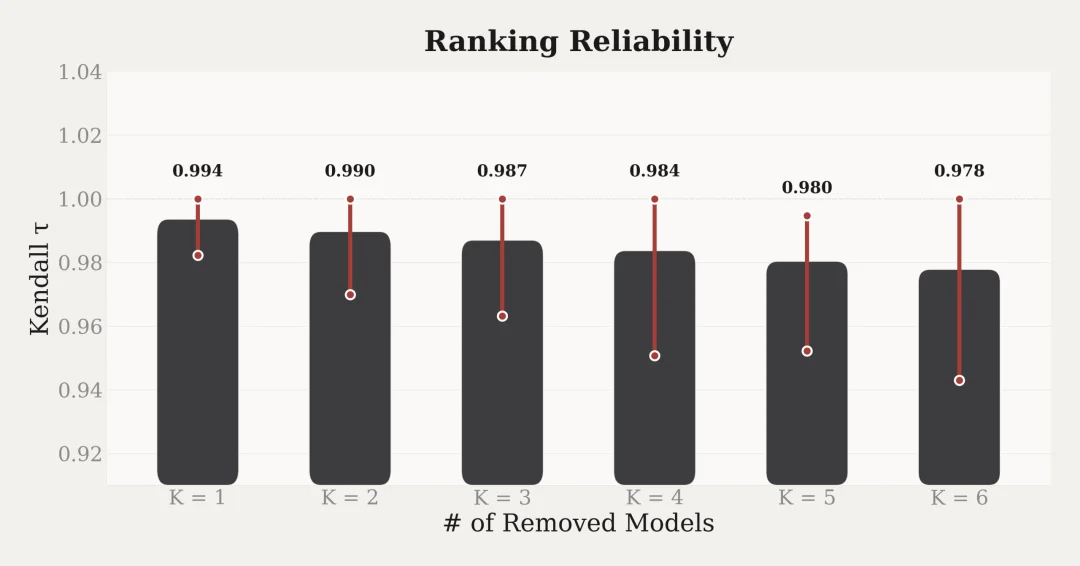

第二组,可靠性。从排行榜里随机去掉 1 到 6 个模型,重新算排名,看剩下的模型排序会不会变。去掉 1 个模型时,Kendall's τ 是 0.994(几乎完全一致)。去掉 6 个,τ 降到 0.978,排序依然非常稳定

Leave-K-Out 实验,去掉 6 个模型后排序几乎不变

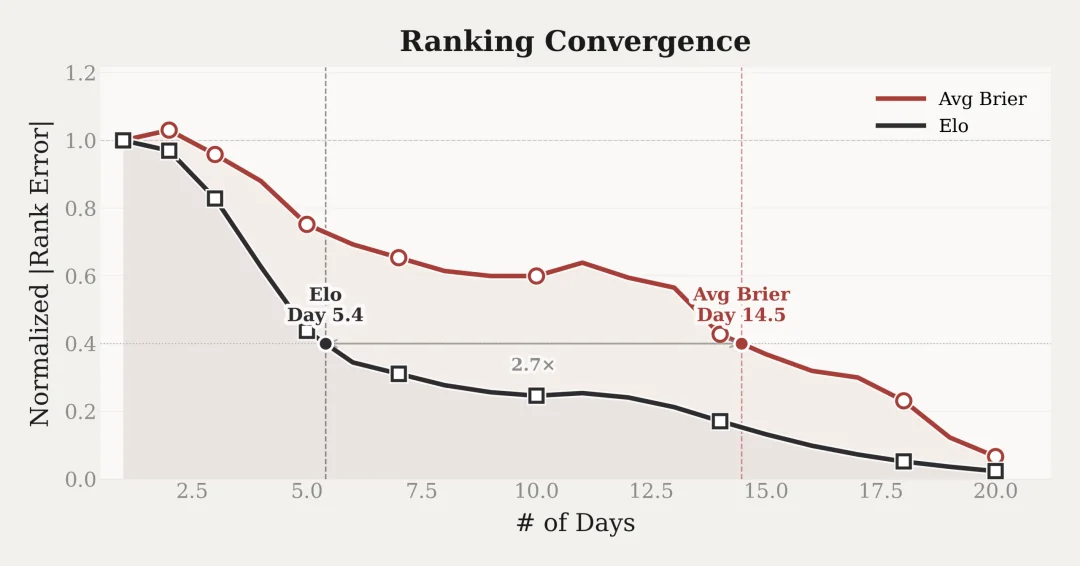

第三组,收敛速度。模拟一个新模型刚加入排行榜的情况,看它的排名多久能稳定下来。Elo 在第 5.4 天就收敛到和 20 天后一致的排名,Brier Score 要到第 14.5 天,Elo 快了 2.7 倍

Elo 5.4 天收敛,Brier Score 要 14.5 天

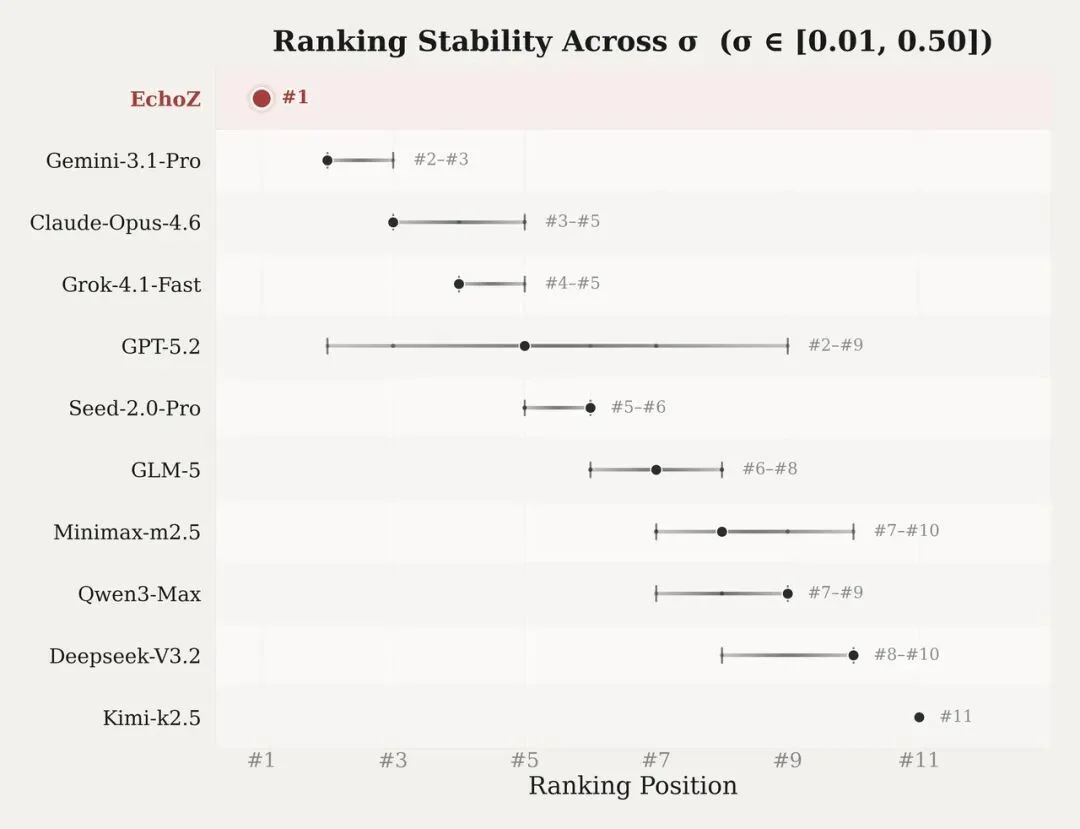

第四组,参数敏感性。Elo 框架里有一个参数 σ,控制 Brier Score 差值映射成胜负概率的敏感度。把 σ 从 0.01 扫到 0.50,EchoZ 在所有设定下都稳定排第一。GPT-5.2 波动最大,从 #2 到 #9

σ 从 0.01 到 0.50,EchoZ 始终第一

EchoZ 对人类市场共识的胜率:政治领域 63.2%,长期预测(7 天以上)59.3%,市场不确定区间 57.9%

50%政治与治理63.2%长期 · 7天+59.3%不确定区间57.9%EchoZ vs 人类市场共识,三个维度都在 57% 以上

60% 多看起来不算高。但了解过交易的人知道,在一个靠判断分胜负的市场里,统计意义上的 60% 胜率意味着什么。超过 50% 就有正期望,60% 已经是很显著的优势了

然后,团队在一些靠判断能赚钱的交易市场上,赚了不少钱,你知道我在说什么

团队说后续可能会把预测能力做成商业化 API,面向企业和开发者开放。目前还在第一阶段,学术发布和品牌建设

Train-on-Future 这个训练范式如果经得起更长时间的验证,应用场景远不止金融。供应链、天气、政策风险、行业趋势,任何需要对未来做判断的地方,理论上都可以用同一套方法。但未来具体是什么,其实也都说不准,感兴趣的可以在他们网站上看

ECHO 官网:echo.unipat.ai

Blog:unipat.ai/blog/Echo

文章来自于"赛博禅心",作者 "金色传说大聪明"。

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】MindSearch是一个模仿人类思考方式的AI搜索引擎框架,其性能可与 Perplexity和ChatGPT-Web相媲美。

项目地址:https://github.com/InternLM/MindSearch

在线使用:https://mindsearch.openxlab.org.cn/

【开源免费】Morphic是一个由AI驱动的搜索引擎。该项目开源免费,搜索结果包含文本,图片,视频等各种AI搜索所需要的必备功能。相对于其他开源AI搜索项目,测试搜索结果最好。

项目地址:https://github.com/miurla/morphic/tree/main

在线使用:https://www.morphic.sh/