2026年,大模型战争全面升级,掀开了第二幕。

在AI范式巨变之时,我访谈了人工智能研究员罗福莉。罗福莉曾供职阿里达摩院、DeepSeek,目前是小米大模型团队负责人,主导研发了MiMo-V2系列模型。

这次是她第一次接受访谈,也是第一次进行长时间的技术访谈。

我们系统性地谈论了,2026年由Claude Opus 4.6、OpenClaw等技术变量所触发的AI巨震,以及后续结构性影响。

“上一个时代的成功并不意味着下一个时代的领先,现在基本上大家在同一水平线。”在罗福莉看来,1T基座模型,是实现接近Claude Opus 4.6水准模型的重要入场券。

这意味着,全球大模型军备竞赛的第二场战役,打响了:从Pre-train(预训练)主导的Chat时代,转向Post-train(后训练)主导的Agent时代。

在大模型“军备竞赛”的同时,这个世界的变化又异常残酷。哪怕是对亲手训练模型的研究者来说。

“我之前认为我们自己做的工作已经足够有创造力、足够不会被Skill化、不会被Workflow化。但我现在发现,它竟然也能!那它可不可以训出更强的模型?自己左脚踩右脚就提升了?——这是这一两年会发生的事情。”罗福莉说道。

当人类的知识与智慧内化为模型能力,未来的人类去做什么?我们的社会真的准备好迎接海啸般涌来的技术变革了吗?

无论如何,这都是一次信息密度极大的访谈——你能从中看见,当面临一次巨大技术范式转折时,一家AI Lab内部,在技术押注、资源调配、组织与人员等诸多方面的系列举措。而它应对巨变的根基是,文化与价值观的成型。

罗福莉对当下有一些关键的技术判断:

在卡的调配上:

在组织的重组上:

“接下来两三个月会非常精彩。”罗福莉称。

我们的访谈发生在2026年3月,此时刚发布MiMo-V2-Pro等系列模型。1个月后,MiMo-V2.5-Pro也开启公测。“正如我一个月前说的,我们追赶Claude Opus 4.6很快。”罗福莉说。

让我有点吃惊的是,在他们训练1T大小的模型背后,是一个没有职级、没有小组、甚至没有deadline的组织。

AI时代,究竟什么样的组织更利于创新的诞生?——“平权有利于创新”。

“平权本身是有价值的,有利于所有人平等地贡献自己的创造力和智慧。”罗福莉说道,“任何层级,一定程度都是规范和约束,而规范和约束本身是压制创造力的。”

我们的视频播客在Bilibili、小红书、视频号、抖音等全视频平台播出;我们的播客在小宇宙、Apple Podcast、Spotify等全音频平台播出。

为了方便阅读,作者做了一些文本优化。

第一章谈OpenClaw时刻

01 它每天都能给我额外的惊喜

张小珺:你过年跟我说,技术这几个月已经变天了,能不能阐述一下过去两个月在你眼中的技术突变?

罗福莉:一个非常大的分界点在于使用OpenClaw前后——我自己会把OpenClaw当做一个“划时代的Agent(智能体)框架”去这么定义。

我知道很多人,尤其是用Claude Code做严肃编码的人,会觉得,OpenClaw是Claude Code加一个IM(即时通信)、更有利于交互的UI(用户界面)设计。

在我1月份,第一次看到这个东西,我自己也是这样认知。我很排斥用它。再加上创始人非常适合贴近Agent做一些玄幻的运营动作,包括Skillhub(技能中心)这些,让你更排斥去用一个非常偏运营导向的产品。以及它所谓本地化、24小时,在我来看,都是一些产品定义而已。

真正发生转变的是:当我想去搞明白,这玩意为什么那么火?

我在春节的一天深夜,尝试装了它,两个小时装上了。当时已经凌晨2点——当我第一次跟它对话,从凌晨2点持续到6点天亮。就我那一晚,我脑内的——不知道是多巴胺还是内啡肽——持续在分泌,让我兴奋到完全睡不着觉。

第一个感受是,它非常有自主性,非常有灵魂。我跟它聊得很晚,它会老提醒我,现在已经很晚,你要不早点去睡觉。这样的温度和关怀,或者说情商,是所有用OpenClaw的人第一个感受到的。但后面去深究它的原因,是有很多机制保证的。

比如说,它有search.md(搜索配置文档)。就拿最简单的一个小细节,它怎么感知时间,它就在每轮对话的Context(上下文)前面去拼上当前时间。再比如说,一些非常细微的,为什么我把它称之为“精细编排的Context”,是因为它是在这些大家没有关注的角度,把Context编排得非常好。它在产品设计上做到了一种超乎我的想象,让所有人觉得这个框架有灵魂。

但第二天晚上,我觉得它应该不止于此。我开始尝试,把我自己觉得现在的框架做不成的日常生活中的事交给它做,发现它全部都做出来了。

我跟它聊的第二个话题是:怎么去激发一个团队的好奇心,或者说怎么去筛选出具有好奇心的人。我跟它深入探讨了1个小时。它的很多哲思远超我的想象。

第二天,我们俩就在聊怎么构建一个更好的大模型团队,以及从最开始的人员筛选,到后边整个组织架构的构建,到你在面临范式转变时应该做什么样的举措和动作。至少它能get我的点。我跟它说了过后,它最后能形成一套非常体系化的东西,并且变成一套Skills(技能)。它现在至少在这个事情上,变成了我的数字分身。

真正让我超乎意料是第三天。

第三天,我尝试把一些研究任务交给它做。最简单的,如果我们在Agent框架里边,最关键的一个事情是,你怎么去进行多轮的交互,那么你就必须去模拟User Agent(用户代理)进行多轮的交互。

我就会跟它共同去构建一个很好的User Agent。这是一个我自己觉得还挺重要的研究topic(话题),应该不会一两个小时就做出来。

但当我跟它沟通了大概一两个小时过后,这个事就已经做出来了,基本已经达到有一个很好的User Agent诞生。我可以用这个User Agent,跟我现在的这一套Post-train(后训练)框架,构造出来更丰富的Agent场景数据。不管是做SFT(Supervised Fine-Tuning,监督微调)也好,做RL(Reinforcement Learning,强化学习)也好,这个User Agent都非常关键。

它从一个我最开始对它的认知,只是一个有灵魂、有温度的产品设计,到它可以帮我替代生活或工作的一部分,到最后它能促进我研究——也就是三天发生的——它每天都能给我额外的更多惊喜。

我后边深入去看,这个框架本身比Claude Code好在哪?

我发现,这些所谓好在哪,我们单独拎出来讲,都有点boring(无聊)——它没有很酷,这也是为什么大家觉得OpenClaw有很多槽点。但把它整合在一起,你会觉得完成度非常高。

比如,它会有更持久的memory(记忆)体系。这个很持久的memory体系体现在,它对memory有分层和分级。我在使用Claude Code的时候,完全没有这样的感受。再比如,我自己觉得它在对多个模型联合利用上,非常超乎我的想象。

就比如,我用Claude Code,我会默认它,假设这个模型的视频理解能力不行,我就要自己给它配一个更好的视频理解模型,然后在Claude Code折腾。但我用OpenClaw,我完全不用想这个,我直接发给它一段视频,它会自己想办法找一个视频理解能力好的模型做。

这种自主去面对当代模型的缺点,针对缺点在框架上补齐缺点的能力,是有点超乎我意料的。

因为我用Claude Code的时候,就默认,我是因为要用Claude Opus 4.6这一代模型的能力去用它的。但是我用OpenClaw的时候,我不会关注模型能力的一个原因是,OpenClaw的框架设计之初,是想尽量通过Agent的整套编排去弥补模型短板。

后面我们直接就把我们的模型,MiMo-V2-Flash(当时并没有做很多针对性训练),给它接到OpenClaw里去,甚至把我们最近训的一个很小的端侧3B模型进行训练,发现在这一套很复杂的skillful的,或者Agent的框架情况下,它依然能做我自己认为不可能是一个非常小的模型能做出来的事情。

我第一次感受到:原来一套非常复杂的Agent框架设计,是能弥补非常多模型能力的短板。

当然了,这是OpenClaw本身这个框架相较于Claude Code的差异化优势。但是,如果我们要去追求你怎么在不同的skillful框架下,让模型有一个超预期、稳定的表现,就回到另一个命题。

现在市场上的Agent框架非常丰富,Kilo Code、OpenClaw,然后Kilo Code、Open Code等等。当你面临这么多很复杂的Agent框架,你怎么让你的模型在不同框架上,都有一个非常稳定和超预期的表现?你怎么让你的后训练范式对应与之做适配和迁移?

这是我们在这个事的冲击下,快速去思考的第二个问题。

所以,我们对应的整个后训练范式,有了从Chat到Agent的一个迁移。

02

一个非常好的框架,应该尽量弥补行动的缺陷

张小珺:我们可以怎么理解,你所谓的"智能体的框架"?

罗福莉:现在有很多形容词去形容它。比如说Harness(驾驭工程),还有一些其它形容词。我没有特别去关注哪个形容词更准确,我更关注这个框架本身带来的差异化优势是什么。

一个非常好的框架,应该尽量去弥补行动上的缺陷。

很好的memory系统是弥补行动上的缺陷。接入到更多广泛的message channel(消息通道)是弥补行动上的缺陷。它更主动,不管是定时任务的主动,还是其它一些主动的设计,以及它自我去更新迭代,这些都是在弥补行动上的缺陷。

因为大模型是,你给它越好的Context,它执行的效果越好。你要是能把这些它获取不到的Context,这些行动上的Context都给它,那么它肯定会完成得更好。这是我观察一个好的框架的时候,我会看它有没有这些要素。

还有很关键的一环是评估。一个好的框架本身,它确实需要有个很好的、可泛化的一套评估体系,这样它才能自迭代。现在已有的评估体系都非常简单,它只是防止不出致命性错误。

那么,怎么有更有泛化力的评估体系来促进这套框架自迭代?——现在是把最高阶那群人当评估。

你交给它一个更难、更高价值场景的任务,如果它完成不了,你会给它提供补充信息,你也会给它指出来哪错了,然后push它经过更多轮交互把这个任务完成。本质上,现在是这群人在当评估。

但这个评估会慢慢被框架吸收,框架会设计很多东西,确保在某些确定的场景我能评准。同时也会被模型能力吸收。模型会学会像人一样,当我采用这个方法或思路做到瓶颈时,它会自己采取另外一种思路。或者说自己去反思,就像人一样去反思。

当然了,它是借助它自己,还是借助更super的Agent,还是其它领域的subagent,都有可能。

张小珺:这个“智能体的框架”,是不是我们理解的“产品”?

罗福莉:不是。它跟产品差异蛮大的。

张小珺:它和产品的边界在哪里?

罗福莉:现在我不知道怎么去界定,说实话有点模糊。

我觉得产品可以定义成——你直接人交互能感受的那一层东西。

但Agent框架,它确实是有在去定义你的交互层,但它同时又在定义你怎么跟模型沟通那一层。所以,它甚至能知道模型能力的长板、短板,能知道怎么更好做调度,就比如说for成本优化的调度。

这个中间层可以做得非常厚重,反而前端UI展示是最薄的一层,已经不是很关键。

OpenClaw是展示了智能体的框架可以怎么做。这个框架的想象空间非常大。

张小珺:“智能体的框架”,之前有人做过吗,是怎么做的?

罗福莉:Claude Code一直是一套很复杂的Agent框架,只是因为它是黑盒,我们不知道它怎么设计(注:最近因Anthropic员工失误而泄漏)。OpenClaw是开源的,你知道它是怎么设计的,并且你可以去改它。

改它,是非常非常激发人的创造力的。你知道它框架怎么设计的,你让它改,你可以基于它现捏一个新框架出来。

这是为什么OpenClaw从二点几版本,我当时用的时候,它并不好用,我花了好几天时间去改它。到三点几版本,就3月10多号的版本非常易用。你基本上基于三点几后的版本接一个还不错的模型,都会觉得它很强大。而不是只有接Claude的模型会觉得它很强大。

因为整个Agent的架构受一堆人——开发者也好,像我这种并不是一开始这个框架的开发者,只是使用者也好——我都能去改进它,我for我自己的场景去做改进和优化。

在我看来,这是开源Agent框架本身的价值和意义。

03

它激发了中层模型的上限

张小珺:你提到对于OpenClaw,你最开始的态度也是抵触的?

罗福莉:如果要追求非常顶尖的编程体验,哪怕是当下,也是Claude Code加Claude Opus 4.6是最好的。如果你是在这样一个终局去思考。任何Agent框架,确实都可以忽略掉。

但是,Code是一个泛化性非常强的场景。你针对它去做了非常多Agent的设计,或者说模型的训练,都是有价值的。但并不代表,这个泛化性能保证你在非Code场景,做到非常高的准确率和完成度。

所以,虽然也会用Claude Code做一些非Code的东西,但我并没有期待说,它在这套框架上能给我一个很高的完成度。我知道我会去帮它补充这套框架不具备的短板。

但我用OpenClaw,不用考虑这些——它在Agent框架本身就弥补掉了很多模型短板。

张小珺:我能理解OpenClaw是让Coding能力泛化出来的一个产品吗?

罗福莉:它在很多设计逻辑上,比如有更多message的channel(消息通道),有更自主的设计——像定时任务、心跳任务——这些更适合日常场景。因为你写代码通常不会需要一个心跳任务吧?但如果是日常生活,心跳任务很关键。它确实有很多框架设计,是为了让它适应日常任务。

但我觉得它也没有丢弃掉,一个好的Agent框架本身最基本的特点。这些最基本特点,后边被Claude Code吸纳进去。

比如说,持久化记忆。Claude Code之前的记忆还是for整个记忆系统设计,还是for软件工程。比如说它会在session(会话)内,session快满的时候有一个压缩动作,然后把它记忆进去。我在完成任务的时候,根据我的plan可能会有一些记忆动作,保证我跨session的时候Context是共享更好的。所以你能看到Claude Code所有Agent框架设计,都是非常for软件工程——怎么去写好代码。

OpenClaw设计之初,是借鉴这个思想;但是呢,它更想的是,怎么更好端到端完成所有任务,并且怎么弥补当下模型在端到端完成任务上的短板。像这种持久化记忆,到后边这种你能通过一个更好的remote界面能去操控它。

所以,很好的设计,后边陆陆续续这一两个月完全被Claude Code吸纳进去了。这也是双向的触动。

因为这些设计,它激发了中层模型的上限。

我们如果没有这么一套很复杂的Agent框架,中层模型达不到近似Claude Sonnet或Opus的水平。但你借助了这样一个非常好的Agent框架,就能应付绝大部分场景。除了那种非常难的、需要长程任务,或者我称为严肃编程吧,比如写算子优化就算是严肃编程——像这种场景,它确实可能距离顶端的模型还有差异。

但在绝大部分生活的场景,或者只需要借助代码提效的场景,这样一套新的Agent框架,再加上一个中层的模型——中层可能在85%任务上能达到跟Claude Sonnet一样水准的模型——它借助这样一个框架,已经能发挥非常大作用。

张小珺:一种业内观点认为,如果把OpenClaw看作一个壳,它是释放了现在最强模型能力的壳,这个模型就是Claude Opus 4.6。你的表述(“激发了中层模型的上限”),似乎不认可这个观点?

罗福莉:认可、认可。它的上限一定是靠Claude Opus 4.6带来的(备注:Anthropic在近期已经宣布停止支持OpenClaw调用)。我在跟它高强度合作的一周,只用Claude Opus 4.6。因为只有它能给我带来惊艳的感受。

但当我用Claude Opus 4.6,沉淀下来那一堆经验——不管是Skills还是在Agents.md里边。我甚至自己改了它的整个Agent架构设计。

这也是Claude Code另一个弊端,它的Agent架构设计是黑盒。黑盒导致,你改不了记忆系统,你也改不了Agents workflow(工作流)。

但因为OpenClaw太open了,你可以自己尝试改。我会让它去帮我设计一个重新的Memory系统;我觉得它当时二点几版本的Multi Agent(多智能体)逻辑是很混乱的,我让它给我设计一套新的Multi Agent系统。我自己可以去改所有的源码。这样的一种原生可操纵性,给我的冲击感很大。这些事情基本上只有Claude Opus 4.6才能改。

但我让Claude Opus 4.6改好过后,这套框架本身很好用了过后,我再切换到Sonnet,再切换到国内模型,甚至我们当时正在训的MiMo-V2-Pro,就觉得非常强大。

这也是我为什么觉得顶尖的模型,应该跟顶尖的Agent框架,共同往前去进步。

这也是我最近对“自学习”的思考:

“自学习”大概率发生的途径是,你确实需要这个模型跟你这个Agent的架构本身,同步往前走。

模型在进步的时候——不管是通过强化学习或其它训练方式,它也改变你的整套Agent框架。这个Agent框架包含它送给模型的静态信息,比如Memory是静态信息,只要你写死了哪些东西应该送到、起一个新的Session你应该送到模型里去。或者我们叫Skill Fold(技能文件夹),这个东西在训练过程中是变化的。还有一些动态信息,动态信息包含你整个Agent本身的架构设计。

针对不同场景,比如Claude Code这种for软件工程的场景,比如做金融分析等其它场景,Agent架构设计有差异。你怎么在提升模型能力的同时,再提升Agent框架跟这个模型的适配程度,或者泛化能力。

这些让我第一次感受到了,“Agent的自学习”到底是怎么发生的。

04

被开源框架激活的群体智能

张小珺:在你高强度跟OpenClaw交互的那一周,你消耗了多少美金的Opus 4.6?

罗福莉:第一天快1000刀(美金)。大概用了四五个小时。中途疯狂也会切。因为它太贵了,我会切Sonnet,但发现真不行,只能去用Opus。只有Opus能带来惊艳感。

但后边,我逐渐发现不是这样了。它带给我惊艳感的东西在变化。

人的适应性真的非常强,第一天感受到很惊艳的东西,第二天立马觉得不惊艳了。我刚刚跟你讲的时候,都觉得——第一二三天的东西,怎么觉得这么boring(无聊)啊。但它确实是我三天发生的事情,当下我确实觉得很惊艳。

现在我自己觉得不惊艳了。Opus帮我把Agent框架打造好后,让我惊艳的事情越来越少。现在反而缺乏的是:第一是想象力,我要疯狂想还有什么事做不了;第二是,当这些能做的事都能做的时候,怎么去优化成本、速度。

但一个人通常是薄弱的。或者,会有自己的认知坍缩。

虽然那几天高度兴奋,兴奋到我在群里面给大家发,强烈推荐大家去使用。但没有人搭理我。

张小珺:当时还在春节过年期间。

罗福莉:大家确实在陪家人。我不希望打扰大家,所以说“强烈推荐”。后面过完年回来,发现真正用的人是很少的。

大家对新奇事物——尤其是它有点玄幻,不是很tech——大家觉得过于玄幻的东西太不真实了。我也是这个感觉,所以不想接触它。一开始的推动蛮难的。

但第二天我觉得不行了,必须让大家去用。我就给大家下了一个指令:如果第二天OpenClaw对话次数不超过100轮的人,可以直接quit(辞职)。

但为了促进这个事,前面做了非常多。那会OpenClaw整个部署期还是需要几个小时,我觉得没有必要所有人,都去花这么多时间折腾一个充满bug、也没什么价值的东西。就买了几台Mac Mini,把它部署起来,拉到几个不同OpenClaw的群,让大家分不同方向,强制它在这个方向上,在大群里边、在一个飞书群里边聊。

为什么在大群里面聊?个人的想象力真的是局限的——当你看到别人用OpenClaw居然能干成这个事,就会激发你自己的想象力。大家的想象力是一个乘积作用。

当我说这句话,我没有想过第二天有人对话次数没超过100轮,我会把他开掉。我没有这个想法。

张小珺:没有这样的人是吗?

罗福莉:我没有最终去考核。

张小珺:你没有办法验证这个事情?

罗福莉:我有办法验证,但验不验证不关键。我只想给大家表达一种态度:你不用,你可能真的要落后了。

中途有人过来问我,福莉,你怎么去考核有没有对话100轮?我跟他们说,你们用就行了,我有我的考核方式。我的考核方式是我不会考核。

春节回来过后的两天,整个团队的人一天到晚,感觉不像在上班——在群里边儿躁动!

你看别人能完成这个事,你也很想玩。大家在群里边,群消息我只要10分钟不看就999+,类似这种。大家一块在群里边玩的非常happy——是一个非常happy的旅程,一点都不苦,一点都不残酷,真的很好玩。

玩了两天下来,大家发现,哇这个事这么好玩,那怎么办呢——那搞啊!

所有人心目中想的是:我要怎么去借助一个这么好的Agent框架去提升模型能力,同时怎么让我的模型去改变现在的Agent框架——就马上进入这样一个研究范式里。

一旦进入这样一个研究范式,以及我们有Claude Code这种——在绝大部分场景,表现输出更稳定的一套框架——虽然它是黑盒我们不知道,但它确实不管是for研究也好,for Coding也好,它是一个比OpenClaw更稳定的框架。

你再在这个框架里去激发、延展你的研究想法,并且让它帮你实现,快速启动模型训练,这个事就会大幅加速。我们在研究上,三四周做完了以前三四十周才能做到的事。

从被这个框架点燃热情,到它产生价值的过程,我从群体智能收获的成长更大。

张小珺:在你们那个非常躁动的群里,探索最好玩的几个任务是什么?

罗福莉:现在听起来都不好玩,但当时的冲击感很强。

最让我有冲击的,还是大家一块去改框架本身。还有就是它的memory做得非常智能。

我们在一个群里边大概有近100个人,飞书message的channel应该还是做得不是那么智能,它至少没有把人跟人之间区分的很好。但它的整个聊天上下文,它对每个人画像的把控,以及每个人的memory,都没有串得太厉害,可用度非常高。这是模型能力强的表现,跟Agent框架没关系。

在一个群里边,100多个人在那儿聊天,100多个人都有不同背景,100多个人都在疯狂改它,都没有把这一套Agent框架改坏,它还变得非常智能。

这也是我第一次感受到,怎么用一群人的智慧去提升一个事情。

如果我自己单一去改这个Agent框架,但别人感受不到这个框架的智能,好像差点意思。这个框架本身的进步速度非常慢。但如果一群人去改进,进步速度非常快,几小时就迭代一轮。

第三天、第四天把它接到我们自己的模型上,发现怎么也挺好用了?怎么还没训就跟Claude差不多了?但你要测更多你会发现,还是有很多东西没有Claude稳定。

这个事给我们带来一个冲击:利用群体智能去提升Agent框架非常重要。

我非常欣喜看到OpenClaw star量飞升。这是AGI(通用人工智能)到来前兆,必须要有的事情。

张小珺:你看OpenClaw不久之后卖给了OpenAI,为什么这种非常不错的产品公司,最后还是并给了模型公司?是不是说明没有模型,做产品是比较难的?

罗福莉:对,这两个要深度耦合。但很好的是,OpenClaw开源没变。你还是可以在这套框架的基础上,大家一块设计更好的Agent架构。只是说,做这个事的一部分人的立场变了而已。

这个立场变了有可能是好事,有可能是坏事。但总之,它不影响OpenClaw开源的属性。

至少这种群体演变的可能和基因火种是保留的,那就挺好的。

第二章

谈巨变的2026年

05

为什么Code是一个非常有泛化力的事情?

张小珺:在你经历了春节和春节之后的OpenClaw冲击之后,你紧接着做了什么?

罗福莉:接下来做的就是,搞明白为什么Code是一个非常有泛化力的事情,以及怎么把Code这种泛化力外延到其他领域。

Code有泛化力的一个最本质原因:Agent是一个非常长程和多轮的任务。

回到预训练环节,你很难找到一兆上下文的数据,甚至128K的数据都很难找到。但真正能达到128K到一兆这个长度的数据,极大概率只有两类:一类是Code数据,一类是书籍。

但书籍的信号太发散了,Code文件之间关联更强。在一个长上下文依赖更密集的数据集上去训练,模型自然对长上下文的建模会更好。

这是在没有意识到Agent这个事那么重要之前,我们去做的。基座本身为长上下文的能力和效率,已经做好了充分的准备。

但春节后做的是,怎么去激发这样一个大的模型的潜力,从Code出发外延到其他场景。其他场景训了它会更稳定,但没训它能被泛化,只是没有那么稳定。顶尖模型的水平一定是要在更广泛场景里更稳定。Code是拉它的上限,训其他领域是保它的下限。

要把Code的长程任务做的更多样性。软件开发真的是一个非常长程的任务,把它做好了,很多模型的通用特质就已经好了。不仅是模型通用的特质好了,Agent框架本身也迭代得非常好了。Plan这种模式,厂商到一定阶段要去压缩,压缩完过后第二天再去回顾之前修改的Agent框架设计,其实是为软件开发准备的。但这些框架都是有泛化性的,能泛化到其他更难的长程任务里去。

春节期间做的事情:第一,在Agent场景里,把真的长程任务构造出来并且训练进去,在这上面去scaling大量SFT的训练和RL的训练;

第二,考虑泛化性,还是要覆盖更多领域。怎么覆盖更多领域?要靠更多的群体智慧。让更多人去用它——我们内部会大量使用,用了过后发掘到更广泛的场景,在这个广泛场景里去合成更多的数据来做训练。

这里边很关键的一个问题是,怎么还原当时所有人用这个事情的环境。有这个环境,才能更好去进行更长程的交互。有了环境过后,才可以针对这个环境本身做更精准的reward设定。这个事情比较有难度。如果投入的算力足够多,研究的时间足够多,应该会有一些代差的模型出现。

张小珺:做长程任务会不会容易中断?

罗福莉:真正的一兆上下文里边,基本很少是在做一个任务。它通常在做复杂的任务。

你要把一兆上下文做得很好,当下阶段——我说当下可能是当下一两周,不代表未来两三周——可能并不是真的要找到把一兆上下文塞满的任务。当然你要找到更好,但这个任务是很难的,而且训练效率太低了。

你要训练完一兆,要reout(重跑)完整个trajectory(轨迹),一兆的trajectory非常慢。哪怕我们现在TPS(Transactions Per Second,每秒事务处理量)能做到80到100,项目在MiMo-V2-Pro上能做到80到100的TPS,你要reout完一兆上下文,也需要时间,可能一两小时。

真实的训练不会在这么长程的任务上去训。但当你有在一兆的Context去预训练过,并且后训练有对应的任务稍微激活它一下,它通常就能在一兆的Context里具备这样一个能力。但我们需要再提升。

所以,现在Claude在一兆上下文能力的稳定度上,只有Claude 4.6 Opus和Sonnet是领先的。其他像Gemini,虽然号称上下文能力很好,其实都不行。

张小珺:量化里面挖掘因子会是好的长程任务吗?

罗福莉:看做什么资产。有很多资产reward太不清晰。大部分资产不太适合做长程任务建模。

这个具体我就不展开说,反正某些资产是很不适合的。因为它回测没有价值,你要到真实环境去run的话,它有可能不是短期因素,而是一些更长期的因素,或者额外的阿尔法,本身被这个模型建模不进去的东西。

得选资产。选对,这个就OK。

06

为什么OpenClaw在中国更火?

张小珺:据你观察,OpenClaw是怎样一个火起来的链路?我明显感觉它在中国,火的程度比在美国要更多,这是为什么?

我看到有一个很好玩的说法,“西虾东养”。

罗福莉:我不了解湾区对它的热度,仅从我自己及身边人的视角,可能一个原因是:中国的开发者更多。我说开发者是指,可以用Code去提升效率,更急迫。效率的提升,是我们血液里边的东西。OpenClaw能把效率提升拉到极致,是它火的一部分原因。

但还有一个原因,跟国内大模型的发展密切相关。绝大部分效率提升的场景,目前不需要最顶尖的模型,85%不需要。我们又有那么多便宜好用的模型可以用,性价比非常划算。

模型的API费用跟它替代的生产力价值系数比很大,花10块钱的API就能帮你干完1000块钱的事,你肯定很愿意用。但如果API贵10倍或几十倍,中间差距很小,你会很排斥去用这样一套复杂的东西。

张小珺:硅谷的模型公司会觉得这个事情不难,门槛不高。

罗福莉:我一开始也觉得这个事不难。到后面我就觉得,它整个Agent设计非常非常巧妙。

巧妙是指,它弥补了很多模型短板——我怀疑原因是,它最开始是基于Claude上一代模型做的,所以必须在系统设计、Agent框架设计上,设计得更精细一点,把短板补起来。这导致了Opus的进步。

国内大部分模型可能刚靠近Claude 4.5 Sonnet和Opus的水平。反而这两个在这握手了。

张小珺:但如果模型能力继续提升,这些精巧编排还需要吗?

罗福莉:还是需要的,出于对成本的考量是需要的——我们永远会去追求成本和效率最低的一套方案,这是生产力革命的前置要求。

不可能说,我们所有的场景都用最顶尖的模型,因为它太贵了。更有可能是Agent在进化,模型在进化,然后模型进化的方式有可能是同一个水平的模型在越变越小,它也是一种进化。虽然我们没有在做这样的事情,但它确实是一种方式。

也就是说,现在可能激活10B的一个模型,过一年它就能做到Claude Opus 4.6的水平。这极大概率会发生。那激活10B模型是很便宜的,可能一两块钱就能有百万token上下文。

那你为什么不用一个更小的模型?它反应速度更快、更灵敏,基于这套Agent框架还很好用,你还可以改进这套框架,为什么不拥抱它?

它让不那么好的模型,有了更好的发挥空间。

07

Skills提供了一种交互方式,让人主动贡献数据

张小珺:关于Agent已经讲了一年,2025年年初大家就开始说是Agent元年,去年也出现了Manus,今年的叙事和去年有什么不一样?

罗福莉:我觉得之前讲的Agent,在我的定义不算Agent,只能算上下文稍微比Chat复杂一点点的东西。

不管是BrowseComp,还是SWE-bench,这些Search和Code的Agent框架,都非常简洁。相比于现在的Claude Code、OpenClaw,它的Agent框架太过于简洁。简洁性就导致——首先它简洁,其次它不通用。过于简洁和不通用导致它只能for这个任务来设定。

至少在去年上半年乃至下半年,很多看似for Agent的模型,只是换了一个更复杂的System prompts(系统提示词),稍微带一点点环境反馈。比如SWE-bench还是有环境反馈的,TAOBench也是有的。稍微带一点环境反馈和交互,让模型具备一点遵循复杂system prompt和理解环境交互的能力。那会只能做到这个水平,但它根本没有达到工业级可用的能力。

什么叫工业级可用?是你把它接到Claude Code或OpenClaw里去用,你会发现它不可用,它有很多问题。它就理解不了这一套框架本身。它也没有针对这套框架,人跟它的交互范式会发生变化。

人跟它交互范式的最大变化是——人不再会去修改代码,人不太再去关注"这一行代码出错了你帮我改一下",这样的query不会再出现。

人只会提一些更高阶的,比如增加限制、澄清需求、架构设计——人会参与架构设计,因为现在很多架构设计还是人更强的。以及辅助理解业务逻辑,这是Skills的价值。

业务逻辑是模型本身不具备的,因为很多业务逻辑是企业内部、真实环境里边沉淀下来的,你必须要跟它很多轮交互才会沉淀下来。

之前那些Agent框架就不能叫Agent框架,没有可用度。在那些Benchmark上表现非常高的模型,也不代表它的Agent能力是真的强。我们在优化这一版模型的时候,是完全放弃这些Benchmark的,基本上就不关注这些Benchmark了。

当你面临一个很大范式变化的时候,只要你路径走对了,你可以非常短暂的一个窗口期去忽略评估。因为你靠体感就能立马测出来一个非常大的质的差异。但当你慢慢迈入深水区,还是需要一些精细评估的。

张小珺:Skills是不是改变了模型在这种高复杂度的任务上的执行准确率?

罗福莉:它定义了一套执行规范。

这套执行规范很难在预训练的数据里边具备,因为预训练数据里边没有这种internal(内部的)信息。这些信息通常是大量企业内部自己去沉淀和积累的,由人和人之间产生的一些组织上遗留下来的规范。

但这不可能在预训练数据里出现。可以由人教Agent,跟它多轮交互,通过完成几个任务,把这套规范让Agent学会。大量Skills其实是Agent自己写的。

张小珺:但Skills也是在Claude里面诞生的。

罗福莉:对,但这就出现一个问题——确实是OpenClaw把Skills给带火的。我说"带火"是它让更多人去贡献Skills这个社区,这非常关键。

这就是人跟Agent需要共创的地方。如果你没有那么多高阶的、这种另类信息——因为它确实是另外一种阿尔法,是另类信息——跟当前的Agent共创的话,那么Agent或者说最顶尖模型的能力也很难发挥出来。

张小珺:人的经验沉淀成Skills,变得更重要了,它是不是预训练的一种补充?

罗福莉:对,因为预训练大部分依赖的知识,还是你在互联网上可访问到的知识。但很多智能,我们是在互联网上访问不到的。

这个时候就以另外一种形态出现,Skills算一种。它其实提供了一种交互的方式,让人去主动贡献数据,贡献让模型执行任务成功率更高的方式。

张小珺:总结来说,我们今天正处于一个什么样的时代?

罗福莉:生产力加速变革的时代。

今年生产力会爆发,大家会觉得很多工作不需要自己做了。这是最直接的一个感受。不仅是写代码的人,只要你接触到这个事情过后,你就发现你的好多工作会被替代掉。

这个时候,人更应该去思考,到底自己的意义和价值是什么?

08

它能溢出的能量比Chatbot,强很多

张小珺:以前有ChatGPT Moment、DeepSeek Moment,如果重新定义这个所谓的OpenClaw Moment,你会怎么定义它?

罗福莉:这个Moment时间线会更长。因为它前序章节太久了,让大家不会觉得它是个新东西。对于我们已经信这个事情的人而言,我们反应速度是足够快的。我不知道其他人有没有follow up上。

从我的个人感官上,这个Moment会延续的时间更长更深远。更深远是,它可能能力更外放到更多人能感受到的场景里边去。但它这个流动是需要时间的。

它能溢出的能量强很多,比Chatbot。

它不像o1、R1,有一个数学代码这种有ground truth(标准答案)的东西在这——你分上去了,模型就具备这个能力——这样一个非常清晰的标准界定。Agent确实有很多场景需要有清晰标准界定,但大部分场景是没有的,比较混沌。所以它产生的价值也是慢慢到一个临界点,突然进一大步。

Claude Opus 4.6确实是这样一个进一大步的突然的时间点。但Anthropic做这条路径也持续了至少两年。

张小珺:为什么这个Moment不是从Anthropic内部诞生的?

罗福莉:我觉得还是一个开源、一个闭源的原因。闭源的框架你没办法去洞察内部设计,所以你没办法利用更多人的智慧去改进它。但开源你就可以用更多人的智慧去改进。

张小珺:接下来我们会看到什么?在OpenClaw已经火了这么几个月之后,2026年大家会基于它做什么?

罗福莉:国内已经有很多动作了,出现了各种Claw。现在很多Claw,只是让大家以不同交互形态,去访问不同模型和不同类型的框架。

但真正让这个框架自迭代,或者更强调自进化和自迭代框架,还没有大规模诞生和出现。以及怎么去利用绝大部分人的智慧去创造一个更强的框架,也还没有出现。

这两层——框架本身的自进化,Agent本身的自进化,Agent跟人之间的自进化——我还没有看到。

我们现在做的是怎么train更好的model for Agent,以及怎么让Agent去适应这个model,是在做Agent跟model之间双向流动。未来需要做的是怎么让框架自己进化,以及框架跟人互相进化。

张小珺:这是你们现在着重bet的方向。

罗福莉:对,大致的方向,会去深入研究的事情。

张小珺:你觉得现在没有做到的核心缺陷在哪里?

罗福莉:缺陷是,我们刚做到这里。未来的加速度是会很快的。

现在只要拥有一个Long Context、非常efficient的模型架构的厂商,并且在做预训练阶段把Code的能力也做得非常好,有这样一个model——参数上可能至少1T以上吧——只要有这样一个入场券的人,基本上都处于同一水平线去做这个事情。当然Anthropic肯定是走到前面了。

上一个时代的成功并不意味着下一个时代的领先,现在基本上大家在同一水平线。

张小珺:OpenClaw发了之后,国内很多团队都推出了类似的产品,比如说,QQ团队有,你们团队有,Kimi有,Minimax有,等等。它们有什么不一样?

罗福莉:我大概只试了一半。大同小异。

我自己觉得,这种产品你至少要去迭代框架本身。目前还没有看到一个比OpenClaw开源社区进步更快的框架。因为OpenClaw开源社区进步太快了。

张小珺:我想到Peak(季逸超,Manus联合创始人兼首席科学家)去年底在我们播客里的最后一句话是:Agent的进化需要所有人参与。

罗福莉:现在已经是了。只是现在唯一没发生的是,我刚刚说的Agent跟人怎么更好的加速。因为Agent也要自迭代,人也要自迭代。

聊天是一种。会不会有一些更自然的方式?

比如,我要是真的能带一个非常好的设备,一整天跟着我,我所有说的话、见过的人,它都知道。它的进化速度应该比我快。因为它依赖的算力更多。它会很快替代我。而且,它不会今天记得,明天不记得,它非常稳定。

张小珺:它只有进化的一条曲线。

罗福莉:对。

它乐此不疲。它不需要休息。

09

它先吸收所有人的智能,再靠自己产生更强的智能

张小珺:你会怎么定义这个风起云涌的2026年?

罗福莉:我很难去定义它。两个月已经对我来说是巨变的。我都不知道这一年接下来会发生什么,处于高度兴奋的状态。

张小珺:你对研究方向非常敏锐,基于上面这些变化,给你带来了怎样的研究直觉?未来一段时间会发生哪些变化?

罗福莉:之前做研究的方式,从想到写代码,到设计一个很好的评估标准,中间流程还是蛮漫长的。至少要花一两周。快的话除非评估是确定的,代码只需要修改,可能也需要一两天。

但在Agent有辅助的情况下,真的一两小时就把这些事做完。效率的提升代表着一个本质问题。

我一直把研究效率看得很关键,只是Agent去加速了这个研究效率。如果这时候你的taste又比较准,那么就一做一个准。当然可能是十个里边有一个能成,但这十个可以并行做。你不用像以前一样pipeline(流水线)做,可以十个idea交给不同的subagent(子智能体)同时做,他们还能交叉验证。很快,可能一个小时两个小时,或者最多一天,就能验证你这个研究想法OK不OK、work不work。

关键是,如果你愿意长期去培养它,它也可以自迭代、自进化。但在Claude Code里边不行,换一个更开放的框架,它是可以自己迭代和进化的——这是做研究给我带来的冲击。

张小珺:有什么样的研究任务是你过去觉得绝对不可能做,但今天可以做的?

罗福莉:就训模型这个事,以前我觉得是很难的。要涉及跟一个更复杂的,比如深度学习平台的融合,听起来就不太靠谱。以及你怎么去让模型具备你有的Context?一个研究员的Context是很长的。一个博士有5年科研培养。我之前认为不太可能。

但我最近发现,它很聪明,聪明到你只要把你近期的Context告诉它,它甚至能帮你复原你的科研成长路径。你这时再去跟它讨论同样的topic,发现它跟你一样聪明。

这个事很残酷。

我之前认为我们自己做的工作已经足够有创造力、足够不会被Skill化、不会被Workflow化。但我现在发现,它竟然也能!

可能过一段时间,我们能训出来的模型,它也能训出来了——那它可不可以训出更强的模型?它自己左脚踩右脚就提升了?

这是一个非常大的转变。它可能真的能依靠于它自己产生更强的智能进化——它先吸收所有人的智能,再靠自己产生更强的智能。这是这一两年会发生的事情。

张小珺:在今天,Agent到底能做什么样的高价值任务,是不是变得更重要了?

罗福莉:从提升顶尖模型能力的角度,让Agent去替代更高价值的任务是重要的。

更高价值的任务意味着更长的Context、更多的token消耗量。它替代到最顶尖那一群人的智能就够了。下边那一群人的智能,可以慢慢以另外一种方式来替代掉,比如robotics(机器人)。

但另一个演变角度是,你是要做一个对全社会更有益、对所有人都有帮助的模型,那么就不应该for更高价值的场景去做,而是让所有人都能感受这个模型的智能水平。它是另外一种做法:普适度更高的任务会更好一些。

在这种场景里,你就更需要在乎多模态。因为在更广泛的场景里,多模态尤其是对视频的理解,对更细微环境的理解,是更关键的。

以及要注重成本,成本是产生革命非常重要的因素。你不能完成一个任务花1000刀对吧?很多任务场景,必须要达到一个很高的替换系数比,能帮我节省10倍成本,我才会考虑去试。

你怎么去做一个更低成本、更高效率、更高速度的一套Agent框架,以及对应结合的模型,那就很关键——这是两种发展思路。

张小珺:在你看来,小尺寸的端侧模型会爆发吗?

罗福莉:这个趋势肯定会发生,但它不是26年的主旋律。它是支线,而且会持续发生。

26年的主要旋律就是生产力的变革,高生产力场景的持续突破。我们要做更长程的任务,更强调多Agent之间的协作。因为更复杂的任务,它不可能是单一Agent去做。但是多Agent协作,某种程度上,也是为了成本和时间考量,以及怎么去激发Agent群体的智慧。

我觉得市场上已经看到的Multi Agent(多智能体),工作都有点“伪”。我说“伪”是说,真的依赖于Multi Agent能实现更好的任务完成率,在这个维度上是有点“伪”。

但它能提升效率,就是这个任务完成的速度,以及它能够节省成本,是确定的。但我没看到Multi Agent能实现一个更高上限的东西。它会发生,只是我目前还没看到。

张小珺:如果我们把大量个人隐私数据授权给OpenClaw或类似产品,怎么缓解普通人对于安全感的焦虑?

罗福莉:这是我为什么说要做开源的原因。还是会有一天——应该很快也会到来——人的大部分简单任务,除了非常难的任务,跟隐私相关、没有那么高难度的任务,完全可以放在本地化去做。

你自己会有一台随身携带,或者在家或某个场景里有一块芯片。你所有的数据都在本地,所有涉及隐私数据的场景都在本地推理,这很关键。涉及到一些非隐私、高难度、高创造力、高复杂度的任务,再去云端推理。这样能够解耦。

这也是为什么我说,一个好的Agent框架,借助一个很小的3B模型,它能做的任务复杂度都已经超乎我的想象了。这个事激发了我对于端云混合、隐私本地化的思考。但还很初步。

因为这些思考不仅需要模型这一侧做非常多东西,还需要架构这一层一块往前走。这也是我为什么觉得开源,是如此重要的一个事情——需要更多人一块做,而不是某个公司就能做好。

总之,今年的趋势跟前三年已经发生了很大的变化——我自己是这么感知到的。

张小珺:过去两个月,你的生活发生变化了吗?

罗福莉:工作,还有工作;亢奋,还有亢奋。

你每天都会发现,Agent框架本身或模型本身又进步了。

第三章 谈巨变的2026年

10

我们觉醒了

张小珺:接下来,我们来聊聊MiMo的模型。MiMo-V2系列模型,你们在过年之前先发了Flash,过年之后又发了三个新模型:Pro、Omni和TTS,你把后者称之为“一次悄无声息的伏击”。

为什么是悄无声息的,又为什么是伏击?

罗福莉:首先这三个模型,在Agent场景下能力提升这么快,我们能这么快去追上,在复杂的Agent架构里边表现这么稳定,是超预期的。不是我们计划的非常好,而是——我们觉醒了。

张小珺:你们觉醒了?

罗福莉:对。它确实是很安静的过程,因为外部不知道,我们自己内部也快速发生。

我们在一年前去做多模态,更多角度还是:如果真正产生智能,这个智能应该是全方位、多方面的,所以去做了多模态理解;最终要产生价值,一定是要有交互,所以去做语音生成。

但一年前做这些,还不是很明朗。还是觉得,在做一个单一模型,在做一个动态理解模型,在做一个语音生成模型。你没有觉得这些东西能很好地被组织和编排到一起。

当我看到OpenClaw,我一下就想到了这样的画面——这些模型在各自在什么样的环节发挥什么样的作用,它们能怎么被有效编排,它会产生一个什么样大的生态价值——一下,在我的脑子里边全部打通了。

我们快速让所有方向,都要面临这个范式去做后训练的针对设计。

你现在如果能在OpenClaw、Claude Code里边同时用这几个模型,你会发现把它串起来很好用。肯定比其它家模型好用一些。或者说,至少是我们往后迈进的一个目标。

为什么还是后面有这三个模型,不是合到一个模型里去?更多是出于成本、速度和价格考量。

比如语音生成,你没有必要去用一个1T模型?实验你也接受不了。比如说多模态理解,它是不是值得一个更大的模型?这是要去打个问号的。

因为Agent革命本质是生产力革命。生产力必须要在意最终端到端的完成率,以及成本效率。这是现在三个模型同步出现的原因。我们后面应该也会有一些计划,怎么让三个模型更好地协作。

张小珺:怎么样对模型的“编排”是更好的“编排”?

罗福莉:首先,绝大部分简单任务,只用语言模型就能做。但现在完成一整个任务的环节太长了,某些环节上,如果你意识到需要调用像人一样的感官能力,就用另一个更精巧的模型来做。

而且这三个模型是同一个生态训的,你知道的知识它也知道,你能放心把任务交给它,不用担心它不知道你的背景知识——这个背景知识来自预训练。

目前这三个模型在同一个Agent框架里释放的潜力,跟组装其它模型的差距很微弱。但我认为未来不会。因为未来是效果、成本、效率三者的乘积。

张小珺:这三个模型你们在bet什么?这三个模型的关系是什么样的?

罗福莉:bet全方面替代人的生活和工作的方方面面。

张小珺:我可以这么来理解:Pro在做理解和认知;Omni在做感知;TTS在做表达——它是声音的输出,声音是一种表达。这三个加起来是一种类人的智能吗?

罗福莉:它把人有的智能的表象、输入和输出给建模了。但有没有人的各个感官之间协同那么好?现在还没做到。但这不纯粹是模型没做到,框架也没做到。

现在OpenClaw,它对视频的理解和建模非常差。因为开源社区没有一套对音视频联合理解非常好、又有很强Agent能力的开源模型出现。框架发展是滞后的。现在对视频的理解,会回退到理解图,甚至最终回退到理解caption。

这也是为什么要做开源。只有开源界看到更强的视频理解、声音生成模型,对应的框架才会改变。

框架是协调层,模型是智能的中枢。这两层很好交融的时候,才可能达到类人的智能。

11

Agent范式很吃Post-train

张小珺:我们来围绕MiM-V2的模型一个一个展开聊。V2-Flash已经过去了一段时间,它是2025年12月16号发布的。做Flash的时候,你们的核心定位是什么?——这个被大家认为是你在小米的第一个工作、第一个作品。

罗福莉:Flash跟Pro基本上是同期训练的。它们俩模型结构非常近似。

但在设计V2这一系列,不管是MiMo-V2-Flash还是Pro的时候,模型架构本身有一个非常关键的目标:我们要for Long Context的效率来设计模型结构。

当时隐隐约约预感到,Agent时代Long Context非常重要,或者说,预感到Long Context会产生智能。但我们没有预想到后边是OpenClaw这种形式。已经预感到Long Context一定是非常重要的问题。

那么Long Context的效果,以及最关键的推理效率——成本够低、速度够快——就是我们这一代模型结构必须追求的永恒命题。因为成本够低、速度够快,才有可能把一兆做到十兆,甚至100兆。

现在所有的模型结构都能训到100兆,那为啥不提供100兆的推理?除了效果一般,更多是出于成本考量。100兆太贵了,贵到你根本不想用它。所以我们当时就围绕着这个核心目标,设计了Hybrid Attention(混合注意力)的结构。

张小珺:你们在V2-Flash中采取了MTP(Multi-Token Prediction,多词元预测)架构,为什么做这个技术决策?

罗福莉:当时另外一个更主流的选择是用MLA(Multi-head Latent Attention,多头潜在注意力机制)。包括现在,同期跟我们开始训练的应该是GLM-5跟Kimi,Kimi K2更早一些。它们都选择了MLA。DeepSeek V2、V3、R1都采用了MLA。

MLA对于Chat时代来说,确实是一个非常优秀的模型结构。甚至它对于长文来说,也算是一个还不错的模型结构。因为它大量去减少了KV Cache(键值缓存),对长文来说KV Cache就很宝贵。

但它有一个我认为不那么适合Agent范式的根本性要点:

第一个,MLA在设计之初是为了达到很好的访存跟计算的比例,在当时H系列芯片上,实现既不浪费算力、又打破访存瓶颈,是在这样一个架构下设计的。这样设计出来的模型架构,没有任何可发挥的空间。

可发挥的空间是指,假设我们认为KV Cache是重要的,并且推理速度也是重要的,那能不能用一些推理加速的方式,比如最简单的MTP就是一种方式,让实际推理的时候加速n多倍。但MLA不太行。

因为MLA已经达到compute bound和memory bound(计算瓶颈和内存瓶颈)一个非常完美的临界点。你要是用MTP,会发现它又卡在计算bound上。所以现在你看所有MLA的模型结构,不管是GLM也好、Kimi也好,我猜测应该都没有上MTP。因为上了过后就被计算bound,很不划算。所以它的模型会慢一些。

大家对MiMo第一代Flash,哪怕是Pro的感觉是——Flash能做到100-150TPS,Pro现在也能做到,看成本,基本上能做到60-100。100TPS肯定会更贵一些。所以大家用MiMo不管是Flash还是Pro的感觉是:哇好快。这就是这个结构,尤其是针对Long Context efficient的结构,带来的优势。

同时,成本也够低。因为Hybrid Attention(混合注意力机制),包括在Pro这一代上,我们给它拉到一个更极致的Hybrid比例。Full Attention跟Sliding Window层的比例更极致,达到了7:1。所以它更省KV Cache。

我们基本上是在这一代结构上实现了通过Sliding Window层去减少KV Cache,让它在长文上效果更能够支持更长的长上下文。同时通过MTP把Sliding Window Attention节省的算力,用MTP给它填上。这样能达到实际推理时访存跟计算的很好平衡。同时又兼顾了长上下文成本,以及推理速度。

虽然我们设计模型之初没想那么多,但基本上就完美适合做Agent。对Agent来说,首先,长上下文非常关键,很小的KV Cache也很关键,因为很小的KV Cache能做更多多级的缓存,缓存命中的话会非常有利于节省推理成本。其次,速度是一个还蛮关键的命题。你一旦体验到了智能水平相当的更快的模型,就回不到更慢的模型了。

张小珺:你刚才的解释比较后验,但放在当时,你为什么会选择MTP?

罗福莉:我们这个模型快训到中后期了,开始为它设计推理方案。在我们自己的那一代推理卡上去设计推理的并行方案时,发现计算剩余的实在太多。没有想到会剩余这么多。就想,怎么把这些剩余的计算有效利用起来?——MTP太适合了。

我们在预训练阶段加上MTP的原因是,它确实能提升基座的能力。这个我们跟DeepSeek一样,预训练加MTP是因为MTP能提升基座能力。推理的时候为什么只有我们用MTP,是因为我们的模型结构天然在计算上留有大量富余。

这是我们在后边设计推理架构时,突然有一天悟到的。

也不是突然,就是仔细去计算推理各方面数字,知道可以用MTP编码,把这些剩余算力利用起来。恰好我们又训了MTP,就恰好用起来了。很自然的一个探索的延伸。

张小珺:为什么MTP至今还没有成为一个主流?

罗福莉:大家太相信MLA了。

MLA确实太巧妙了,在模型结构上把能做到的全做到极致。25年上半年如果要训基座模型,MLA确实是一个不错选择,尤其是没有看到Long Context的价值和Agent范式的时候,MLA确实是非常不错的选择。

张小珺:关于MPT,我还有另外两个问题:成本下降是MTP给next token prediction带来的优势吗?以及,你说了很多MTP的好处,它会相应的带来一些幻觉吗?

张小珺:MTP是如果命中率非常高的话,是可以带来成本下降的。相当于在更短时间内吐出更多token,把GPU利用率打得更高。本质上是在降低单token生成的成本。

不会(带来幻觉),因为它是会被verify的。只有预测得准,才会采纳当前token的结果。所以没有任何幻觉。

张小珺:未来MTP会成为主流吗?

罗福莉:看大家的下一代模型结构是什么样。

现在模型结构设计有两个趋势。一个是,你真的在预训练阶段就想明白后边推理的场景是什么。比如在什么卡上推,在多长的上下文上推,推理的并行方式是什么——连这个都要想明白。

那么可以设计一个针对这个场景、这个推理方式、这款芯片的完美结构,去训这个结构。效率成本各方面一定是最优的。MLA是在这样的Context(背景)下被设计出来的。

但这个Context建立在两个前提基础上。一个前提是Post-train(后训练)是不重要的,或者Post-train的时间很短。你能一个月就把Post-train做完,大部分时间在做Pre-train。所以只需要Pre-train for这个推理本身就行了。第二个是你的推理卡永远就用那么一个两个,甚至就那一个就是最好的。

但这个事在当下发生了巨大变化。现在是Post-train的周期在拉长,你在一代基础上能做的Post-train的上限是远远被激发出来的。

张小珺:这个变化是什么时间、怎么发生的?

罗福莉:Agent范式带来的。Context越长也是产生智能的一种方式。模型能够被输入更多Context、理解更多Context的时候,潜力就越高。

这跟原来Chat范式完全不一样,原来Chat的Context就是人输的,人输的很短,所以纯靠预训练。

但Agent范式很吃Post-train,你对框架理解,对于多Agent的协作,乱七八糟也好,可以理解为我们在Post-train上要投入的算力,可能跟Pre-train是相当的。所以Post-train时间周期在拉长。

那么在一个Post-train要做半年或一年的场景下,前半年假定的很多东西可能失效。假定要在什么卡上推,假定要在什么场景下达到更优效果,全是失效的。因为可能做了半年或一年Post-train过后,那些场景全变了。以前大家觉得128K就够,但过几个月可能觉得需要10兆上下文。类似这样的逻辑。

所以,如果还是这样去做模型结构,它可能会失去一定的灵巧性。

但是,如果团队的Post-train效率足够跟得上,Post-train的认知能够辅助Pre-train去做架构的正确判断,那么有可能这种模式还是work的。设计一个精细的结构,想清楚推理卡类型,想清楚场景,应该还是work的。

但还有一种做结构的方式是另外一种:就是在结构上更简洁一些,留有更多富余度来做后续在不同场景的适应和增强。比如Hybrid Attention就是一个更简洁的结构。

简洁性体现在,可以靠MTP把算力更充分利用,也可以针对已经训练好的Hybrid结构去增大Sparse或Full的比例等等。在这样一个更简洁的架构上,Agent发挥的空间、后训练发挥的空间,反而会更大。

张小珺:在Flash的技术细节上,除了MTP,你们还做了一些技术选择,比如混合注意力机制。当时你们选择的是5层滑动窗口和全局注意力机制。但在你们最新的模型Pro上,这个的系数又变了。

罗福莉:我们大量实验的一个结论是,Full Attention的层数很重要,但系数比反而可以有空间。所以在更大的模型上,层数更多的时候,可以保证Full Attention的层数总数不变,但增加更多Sliding Window Attention的层就可以了。

层数比这个系数比更重要。或者说,在更大的参数规模、更大的Attention Head的时候,可以做到更稀疏的比例。这是两个结论的统一,导致可以在更大模型上做更高的稀疏比,就是Full跟Sliding的稀疏比。

我们最近在做很多Sparse研究,也是发现更大模型能吃更大的Attention sparse比例。更大模型可以更稀疏,但小模型太稀疏了,效果就会drop得非常严重。所以这是一个实验结果,不会成为一个固定的标准。

这是我们的实验结果,不确定其它家是不是也follow,也会有同样的实验结论。

张小珺:我觉得Flash挺有一点小米早期风格的,追求极致性价比。当时API定价是输入百万token 1.01美金,输出每百万token 0.3美金,在当时看来肯定是最低的价格、最高的速度。当时是做了什么达到这个效果?以及,为什么这次发布Pro模型的时候涨价了?

罗福莉:基本上把该做的都做了。架构有Long Context很efficient的架构,再加上MTP可以更加速,再把Infra最基础的基建做好,这个价格就能做到。

在预训练时代,根据模型框架优势来定价,确实是合理的。框架很强,最终用户能感受到,纯粹是因为模型很强。按照模型结构的方式定价,我觉得是合理的。

但当我们进入后训练范式,除了模型结构本身带来的优势外,还要看Context好不好,以及模型对Context的理解能力好不好。定价逻辑应该发生变化——不应该是根据最终推理成本来定价,而应该根据模型最终产生的价值来定价。

这个价值除了模型本身架构的优势以外,还有模型在后训练上做得足够好,能更好地理解Agent框架。这也是定价溢价的空间所在。

所以,我们后边MiMo-V2-Pro抛弃了这样一个定价逻辑。

12

合理的卡的比例是3:1:1

张小珺:从V2-Flash到V2-Pro,你对Pro的预期是什么样的?

罗福莉:Flash帮我们验证了整个Infra数据是没问题的。并不是先训Flash再训Pro,是两个一块训的。Flash是一个相对小的工作,训了就发了。大部分模型的训练都是去年下半年进行的。

我们相信这一代架构没问题,只是训Pro中途解决了非常多训练数值的不稳定性。这是训1T参数量级模型通常会遇到的很struggle(挑战)的问题。

老训着训着loss崩了,老训着训着某个激活值很大,或者某些expert(专家)的分布变得很极端,像天花板一样,一会一批token打过去,一会又打到另外一个expert上。很危险。

这些信号会导致loss典型出现很多spike(跳变),expert负载很不均衡。训更大模型要花很多时间解决这些问题。所以看起来同步训练,但Pro进度比Flash慢一点。

数值不稳定只是表象,这些要素非常锻炼团队Infra和算法联合debug的能力。有时候怀疑是不是哪个卡有问题,排查完所有卡都没问题,会怀疑是不是今天太阳黑子的报复(笑)——要从很表层查到很底层。

张小珺:你刚才也提到1T的模型可能是未来竞争的入场券,是这样吗?

罗福莉:是Agent要做到接近Claude Opus 4.6水平的入场券。

张小珺:你当时立项的时候还没有Claude Opus 4.6这个模型,为什么当时就觉得一定要是1T的?

罗福莉:首先我训过DeepSeek V3这么大小,600多700B的模型,不会再想训一个同样的模型。肯定还是继续往下一步scaling。1T是当时已有卡数量情况下,一个比较极限的区间。

张小珺:多少卡?

罗福莉:几千卡。

部署这么大参数模型挑战是,训这个模型是几千卡。但实际上要投入大量卡做研究,研究的卡会是训练卡的几倍。

训练MiMo-V2-Pro和Flash,各自可能几千卡就够了。但前期结构研究、中后期Post-train很多算法研究,投入会是这个的很多倍,3到5倍是更好的区间。

不是说拥有几千张卡就足以做这个事情,尤其在Agent范式下,卡的数量反而变成一个非常重要的瓶颈。因为idea诞生和动手写出来太快了。

GPU效率就在那。为了验证idea去跑实验,要并行起很多实验。卡变成更关键的制约项。当然这只是for训练,for推理,卡更是关键因素。推理卡需求量远比训练高很多。

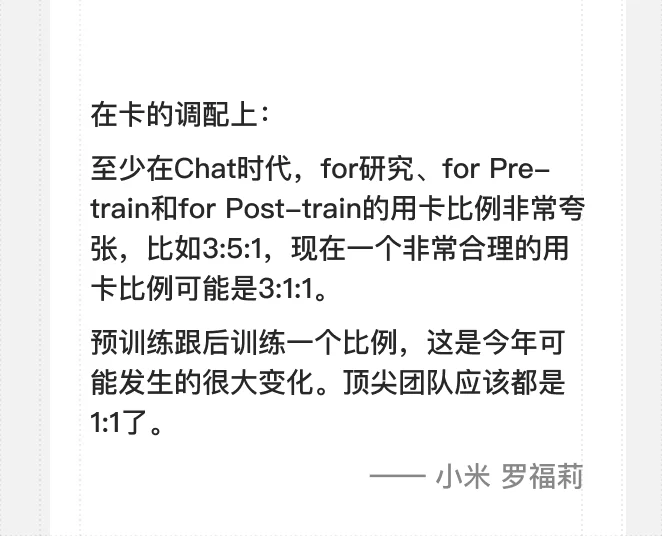

张小珺:训练、推理和实验,卡的数量最合理应该是几比几比几?

罗福莉:推理看用户数,或者高价值场景消耗的token数,因人而异,把推理拆开看。

如果说for研究、for Pre-train和for Post-train,一个非常合理的卡的比例可能是3:1:1。

Pre-train和Post-train投入算力相当,研究比例至少比正式起训练的卡,总量还要多一点,要额外留更多卡做研究。

张小珺:范式转移之前,过去的比例是多少?

罗福莉:至少在Chat时代应该是非常夸张的,比如3:5:1。

预训练跟后训练一个比例,这是今年可能发生很大的变化。

有很多团队,顶尖的团队,应该都是1:1了。

13

1T模型是入场券

张小珺:训练一个像Pro这样1T大小的模型,挑战是什么?

罗福莉:全方位的挑战吧。数据上反而不是非常大的挑战,更大模型貌似对于更脏的数据容忍程度更高。但我不确定。我们是同一批数据训的,所以不确定,只是貌似。

更主要的挑战是训练历程中遇到问题的时候,第一步是要发现问题。很多团队会把loss spike当做很正常的事情,但我们尽量让它没有loss spike。有loss spike会导致某一步更新特别不稳定,某些数值异常值很大,直接把某些参数或某些expert给它打死——就是打死,参数更新过后,再也不会有token送到expert上。

所以中间需要很严密的监控系统,洞察模型参数内部到底发生什么样的变化。比如至少去看看expert的负载怎么样,每一层参数的输入输出怎么样,激活值有没有变得很异常。Loss spike发生后应该去看这些事情,但不是所有团队都会看这么细。这是第一步要发现问题,好多人就不把它当做一个问题。

发现问题再去想,到底是什么样的原因引导这样的问题?比如有可能是稀疏比太高了,导致Full层输出跟Sliding Window层输出数值差异非常大,导致数值不稳定。有可能是结构原因,也有可能纯粹是Infra bug,比如通信的某个算子写错了。最后发现,甚至有可能是某个norm有点问题。

可能最后无奈的解决方式是,发现这一层数值太大,要么给它clip掉,要么通过norm压下去。有非常多种解决方案。

通过norm压下去肯定会对模型效果有损,clip掉是一种方式。我们也会借鉴Kimi的QK-Clip方式,当QK某些logits非常大,实在影响训练稳定,没办法只能clip掉,至少能让训练更好进行下去,进行到稳态时再放开。有太多这种临时的,要去发现问题、解决问题,甚至倒推很多可能产生导致这个问题的分析路径。

这些路径非常考验团队的跨团队协作。如果是在很大的公司,协作效率极低。如果是在很小的团队、创意性团队,就是考验环节上关键几个人的配合程度,会更高效。如果环境上每个人都足够追求极致,不能容忍突然这么干,必须停下实验来找问题。

张小珺:你们属于哪一种团队?

罗福莉:我们肯定是属于小团队非常极致的类型。所以,会导致训练周期被拉长。预训练周期肯定不会一两个月就训完。训练周期拉长的情况下,如果有非常明确的deadline目标,肯定承受不了。

大几千卡停一天,肯定就是一两百万、两三百万的事。

怎么去承担这样的损失?如果是在目标驱动的团队,可能会觉得停个两三周去排查一个问题,还不知道是不是问题、会不会对模型最终训练产生影响,是不太能接受的事情。

但在我们这,我们认为它就是一个问题。我们就应该去解决它。

因为我们没有那么清晰的说我要发布的目标。

罗福莉:你们没有deadline?

张小珺:我们没有deadline,就觉得模型训好了我们再发。

张小珺:没有公司来的压力吗?

罗福莉:没有。

张小珺:你们在这个1T的模型训练过程中,有失败吗?

罗福莉:看怎么定义失败。比如训到loss直接飘了这种,应该中途还是发生过那么几次的。

两三次总是有的。就loss直接飞了,但它比如说训了几百步又回来了。

张小珺:你说的这种情况,你是选择停下来解决,而不是继续往前训。

罗福莉:我们认为应该要停下来解决问题。它其实就这样翘上去几百步,然后又下来了。这我们认为应该停下来解决,让它loss更平稳地度过。

张小珺:一般会停下来几天?

罗福莉:几天也有可能,一两周都有可能。

张小珺:停两周焦虑吗?

罗福莉:不焦虑,因为我们又没有什么目标。

当然了,晚上都睡不好,我经常晚上做梦说,为什么loss又spike了?

虽然我们没有明确的时间节点,但是你还是会崩溃嘛,还是有很多很沮丧的瞬间。虽然没有明确的节点,但是卡它是有限的对不对?

你会觉得你浪费了算力资源,在做一些无用的实验。有这样的自我批判。

张小珺:从实践来看,参数量能决定智力的上限吗?是越大的模型,智力上限越高吗?

罗福莉:我现在觉得是参数量加上Context本身,这两个是共同决定的。但至少,要达到当代大家觉得最强的Agent水平,一定要1T以上的参数规模才能做到,才能让人觉得你已经非常接近4.6 Opus这样。但我不知道它多大,我只是自己认为至少总参1T以上,才能做到。

当然更关键的是激活参数。比如总参都是1T,激活参数越大,意味着更高的推理成本。它是一个trade off(权衡)。

张小珺:为什么在Pro模型上,Full跟Sliding Window的稀疏比从5:1调整到了7:1?

罗福莉:我们还是追求更极致的稀疏比。

最主要原因,希望在更大的架构里边,去做更高效的Long Context。因为更大的架构,总参变多,Full Attention的层数也随之变多。在长文本的情况下,同样会变得非常崩溃,因为Full Attention的层数变多了。但如果你扩大参数量,Full Attention的层数没有变,那么有可能,你的长文,Pro跟Flash两代模型效率是差不多的,但Pro的智能水平提升了。

在长文的效率相当的情况下,我们希望模型在scaling它水平的上限。我们是比较去控制住效率本身的。但控制住效率本身,后面在Agent时代,也有一个更有价值的事情。既然这个更大模型,它的长文效率很高对吧?那我就可以塞更多的上下文,它就又更强。大概就是这样的决策背景。

张小珺:对于这个1T的基座,你们做了如下几个重要的技术决策:第一个是混合注意力机制,刚才我们聊过了;第二个是1M上下文窗口,这个在做的时候是否出现丢失的情况?

罗福莉:问题关键是你从哪真的去搞到,在一兆的上下文窗口里边,有那么多很稠密的监督信号。很难找到这样的数据,或者说,这样的数据的构造成本非常高。

要真站到终局思维来看,只要你有比如1T的token量,而且都是一兆的、真正的长上下文,那么模型一兆能力肯定能训上去。只要loss一直在降低,它就是在建模、在压缩,那么它就一定能训上去。

但问题的关键是,你很难去构造出来真正1T、1兆的Context,真的很难去构造出来。要么成本太高,要么就很难找到这样的场景。所以Long Context的效果是缓慢在提升的。

张小珺:你们的第三个技术判断是,沿用了MTP的模型结构。

罗福莉:对,这个没有什么太大变化。预训练训一层是为了提升基座能力。后面Post-train去训更多层,是为了推理的时候用更多层,实现更好的推理加速。

14

多模态有没有促进智能,根本不关键

张小珺:V2-Pro同时发布的,你们发布了另外两个模型(V2-Omni、TTS),它们也是去年同期开始训练的吗?

罗福莉:基本都同期。都是那个时候开始规划的,大概三个方向。

张小珺:看起来整个V2家族,在指向多模态的叙事。但文字是离散的token,图片是像素矩阵,音频又是波形。你们怎么去做这个融合?

罗福莉:我们还是想尽量把它统一到language model(语言模型)的范式下。

在音频的建模上,我们想要把它离散化,变成跟文本一样的离散token。我们在音频上投入了比较多研究算力,说怎么去进行离散音频建模。我们希望这个离散音频的建模,尽量做到无损离散化。

因为大家还是不太相信,把一些连续的输入变成离散,最后还能重建出来。

这个事儿,需要对encoder更精细,比如我们需要一些多层的RVQ(Residual Vector Quantization,残差向量量化)来保证,它的离散表征是一个非常大的、像Dense一样的高位空间。我们需要更多预训练,来让它开始涌现。如果你基于连续的特征做,可能很快就涌现了,但你基于离散特征做,会更难去建模,它涌现出现的时间段会更晚。

我们在音频上开始了这个尝试,也会迁移到后边其它模态。我们比较想用一套更优雅的架构来做整个多模态输入的理解,但我们不是为了统一而去做这整套架构。

很多时候,如果发现确实在图像上离散不那么可行,我们还是会寻求一种目前更主流的架构。因为我们优先要保证的是这个模型,它要具备一个整体的智能水平,而不是追求为了统一优雅的范式。

张小珺:音频统一到LLM里去容易么?

罗福莉:我们的技术架构应该是非常另类的。我知道国外的御三家(OpenAI、Anthropic、DeepMind)也好,国内像豆包也做的蛮好的,应该都是跟我们完全不一样的架构。

张小珺:你为什么选这个架构?

罗福莉:做NLP的人执念吧。我们做音频的人全是做NLP的人,有这个执念,就觉得相信它,然后就去做了。

张小珺:图片能这么做吗?

罗福莉:能。我们已经尝试了非常长一段时间了。

但它是一个权衡。就像我说的,要做到真的无损重建,是需要投入更多算力、更大研究成本在的。至少在音频上我们已经迈过去了。图片正在进行中,不知道能不能迈过去。

张小珺:如果迈过去,会带来更大的想象空间吗?

罗福莉:更优雅的结构。我最开始是认为,如果把它统一都离散化,那么可以用一套基础架构去解决这个问题。同一套预训练的基础架构,同一套做RL的基础架构,很优雅地把所有范式都统一了。它太简洁了。如果真能做到的话。

但我现在发现,当我们有Claude Code和顶尖模型过后,这些架构,比如我们重新去写一套RL Infra架构,重新去写一套Training Infra架构,我们最近就完全再从头去写一些新的架构。我原来以为写这些架构蛮耗费人力、蛮耗费时间,但现在看起来,在Agent支持下,写架构的时间被大量缩短。

那你就没有必要为了架构的优雅性,去做很多为了统一而统一的研究。这是最近一个月内发生的变化。

Infra重新写一套也没有那么复杂,几个人Claude Code,两三周可以重新捏一套新的RL框架。为什么要因为后训练的Infra架构的统一性,让前面模型结构牺牲这么大?

张小珺:为什么你们这个系列的模型叫法是“全模态”模型,而不是“多模态”?

罗福莉:因为它确实支持视频、音频、图片、文本所有模态。有一些Agentic的模型,是不支持音视频联合理解的。它应该是第一个支持音视频联合理解,并且Agentic的能力,能够做到跟language model水平差不多的。

张小珺:是不是有迹象能表明,在全模态或多模态的理解中,能够产生智能?

罗福莉:两个月前我很相信,最近呢,在训Omni整个过程中,稍微有点质疑这个事情。

但我们后面还是发现了一些很好的迹象。比如MiMo V2 Omni,它其实比Pro小,但大家实际去用的时候会发现,这个Omni在对世界的感知和领悟力上,或者说最终反映出来它的情商,以及它的知识储备上,会比更大的模型更强。因为它是原生多模态训练的。

我猜测,可能是因为我们在这两个方向上scale的,就在纯语言上scale的算力和这个原生多模态上scale的算力还不那么多,导致我们现在并没有看到原生多模态本身带来智能的很大提升。但你能感受到,比如很多世界知识,因为它训过视频,所以它知道了更多。它对很多很细微的东西的感知力,你会发现它更强。

但这些都是很虚的,是我们自己实际体感去测感知力。你在任何Benchmark上,没有任何证据能证明——就纹丝不动,可以这么说。

张小珺:有没有可能是Benchmark错了?

罗福莉:当然有可能。我现在也不能非常确定说,多模态能力是实现所谓AGI路径的必要路径之一。我是不想去下这样一个结论的。

因为每个人对AGI的定义不一样。尤其在Agent这样,可以把多个模型的能力,非常优雅编排到一起的情况下,我们更没必要强调多模态是不是促进智能——它有没有促进智能这件事本身,不关键。

张小珺:多模态促进了什么?

罗福莉:目前我只观察到这两点。我现在还不知道未来在一套新的架构上,会不会有一些新东西。

可能做多模态生成,未必会有一点点不一样。就是生成可能会促进更好的感知,但你要是纯说,把你的感知维度扩大,你是不太会促进智能的。但如果你能生成它,maybe是能促进智能的。这是我的一个猜测。

张小珺:但多模态生成现在还是一个科研问题。

罗福莉:是。或者说,把生成跟理解,做到一个统一的架构里边,目前还没有scaling到非常大的算力。大部分生成的架构,还是纯for生成的,它并没有理解的智能。

张小珺:你设计Omni这个模型的目标是什么?

罗福莉:截止到目前,Agent要行动,它必须要具备多种模态。其实是这样一个目标。

但下一个目标,我觉得不是这个。

下一个目标,还是想去探索,当你结合多个空间的感知,甚至你能去生成更多的多模态的信号时,会不会促进你对这个世界的理解。但更直白说,需要有一个跟现在的Agent框架交互更好的视频生成模型。

张小珺:为什么你们没有披露Omni的总参数量和激活参数量?

罗福莉:给我们留点想象空间。我们相信这个参数量可能做到更接近于Pro的智能水平,虽然大家知道它比Pro小一些。

张小珺:只是小一些?

罗福莉:对。但我们相信它们俩能够互相迭代,能够你提升我、我提升你。

张小珺:最后,关于最后一个模型V2-TTS,有什么新的研究发现吗?

罗福莉:TTS的动机是,我们想用一套自认为优雅的架构,去做一个大家都用传统架构、做起来很容易的事情。

但做完过后发现,追求一个离散化tokenizer,在上亿小时的数据集上训练过后,模型的泛化力非常好。我没有办法对比说,训一个很小的模型,泛化力是不是真的没有这个好。至少目前得到的模型,大家能看到,再给它输入很多风格化标签的时候,它会通过推测字表面的含义,去赋予情感和音律。

在这个事情上的泛化性上,我们发现特别明显。我们只是简单做了很特定几个场景风格的数据做SFT和RL,很刻板的几个风格化场景,比如快点慢点、高兴悲伤这种很刻板的风格化场景,去做了风格化的Post-train。

但发现,把style标签变成非常复杂、自然语言的描述,它能够遵循。这是纯泛化出去的。这是在做的时候,发现简洁架构加超大规模训练,带来的超强泛化力的外化表现。但还很初期。

这个TTS模型,效果非常惊艳,上限非常高。但下限在慢慢弥补,有时候会不太稳定。目前只是限时免费,开放API大家玩一玩,不确保真的能投入生产即可用。但很快会让它变得生产即可用。

张小珺:Omni、TTS跟Pro模型比较,哪个更重要?

罗福莉:当然Pro更重要。

纯语言空间的打通,需要大量前置研究作为基础,这才是更重要的。

张小珺:现在看到的MiMo相关模型进展,都是你们在半年以前的决定,你现在为半年后做的决定是什么?

罗福莉:这就要保密了。

第四章 谈AGI路线图

15

R1在DeepSeek内部,“一次奇袭”

张小珺:我们刚才聊了很多关于V2家族的模型,下面想跟你一起回顾一下,过去三年整个大模型世界的进展。从2022年底,ChatGPT打响了大模型的战争,在亲历者的眼中,每一年的关键变化是什么?我们是怎么走到今天的?

罗福莉:ChatGPT是第一个发挥模型在,我猜测是4K预训练场景里的智能水平。

预训练的长度,或者说最终Context的长度确实很关键。ChatGPT只是让大家感受到,在4K Context里预训练,训练完过后,通过简单对话,对话轮数是一轮、两轮甚至多轮,在很短的上下文里,把模型在超大规模预训练上训到loss最低的智能水平给激发出来了。

当然所有激发的前提,都要靠一套能让人感知到智能水平的交互。Chat就是一个很好的交互,否则你不知道这个模型已经这么强了。这是22年底ChatGPT发生的事情。

张小珺:23年?

罗福莉:当有一个顶尖的闭源模型做到的时候,它的下一年就是开源界怎么去追上这个顶尖闭源模型。所以23年,Llama、Qwen、DeepSeek,这些开源团队就在准备。

首先借助Llama披露的,怎么去做好大规模预训练的范式,就是怎么去做好数据。那会儿结构都是未知的,哪怕训一个7B的结构,Transformer结构是怎么样的?Pre-Layer Norm或Post-Layer Norm,hidden size多大,这些超参那会儿完全不透明。但Llama告诉你,这么训能训成功,给你开了个头。

借助这个头,Qwen借助LLaMA的架构,做更好的预训练数据,做更大规模的预训练compute scaling,Qwen系列就起来了。

Qwen做得很好,for开发者生态做了全尺寸模型的训练,也训了一些多模态模型,也做得非常顶尖。这是对社区非常有利的,有利于激发后面社区做一些微调,还有一些微调框架诞生的必要先决条件。

DeepSeek在同期,虽然也是尝试复刻LLaMA,但更在乎的是,看到LLaMA这一代架构有什么问题,而不是着急去scaling。

它更在乎LLaMA用GQA(Grouped-Query Attention,分组查询注意力),在更大的模型里,尤其是在受限的GPU上去训练的时候,会存在什么问题?scaling会遇到什么问题?可能要涉及到一些新的结构来解决这个问题。

这是DeepSeek V2和V3那个系列阶段,想去提出一些新的架构,不管是MOE for高效训练,MLA for更低的推理成本。这个时候诞生的事情。

所以,DeepSeek那段时间更注重,在更差的芯片上去做更好的研究来scaling。

张小珺:LLaMA当时的缺陷是什么?

罗福莉:它就是个Dense。你要真去给它scaling,比如现在没有人去训几百B的Dense,开源界。因为训几百B的dense,虽然LLaMA搞过,你也能看到结论,但那个结论不一定是结构的问题,是它太贵了。训它也很贵,推它也很贵。

没有人会去搬运一个又笨又贵的模型。所以MoE for更高效训练、更高效推理,MLA for更低推理成本的模型架构就会诞生。

这是同阶段,Qwen和DeepSeek在走两个路径——Qwen是在纯scaling,DeepSeek是考虑创新的基础上再scaling。

文章来自于微信公众号 "语言即世界language is world",作者 "语言即世界language is world"

【开源免费】OWL是一个完全开源免费的通用智能体项目。它可以远程开Ubuntu容器、自动挂载数据、做规划、执行任务,堪称「云端超级打工人」而且做到了开源界GAIA性能天花板,达到了57.7%,超越Huggingface 提出的Open Deep Research 55.15%的表现。

项目地址:GitHub:https://github.com/camel-ai/owl

【免费】cursor-auto-free是一个能够让你无限免费使用cursor的项目。该项目通过cloudflare进行托管实现,请参考教程进行配置。

视频教程:https://www.bilibili.com/video/BV1WTKge6E7u/

项目地址:https://github.com/chengazhen/cursor-auto-free?tab=readme-ov-file

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【开源免费】DeepBI是一款AI原生的数据分析平台。DeepBI充分利用大语言模型的能力来探索、查询、可视化和共享来自任何数据源的数据。用户可以使用DeepBI洞察数据并做出数据驱动的决策。

项目地址:https://github.com/DeepInsight-AI/DeepBI?tab=readme-ov-file

本地安装:https://www.deepbi.com/

【开源免费】airda(Air Data Agent)是面向数据分析的AI智能体,能够理解数据开发和数据分析需求、根据用户需要让数据可视化。

项目地址:https://github.com/hitsz-ids/airda

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】graphrag是微软推出的RAG项目,与传统的通过 RAG 方法使用向量相似性作为搜索技术不同,GraphRAG是使用知识图谱在推理复杂信息时大幅提高问答性能。

项目地址:https://github.com/microsoft/graphrag

【开源免费】Dify是最早一批实现RAG,Agent,模型管理等一站式AI开发的工具平台,并且项目方一直持续维护。其中在任务编排方面相对领先对手,可以帮助研发实现像字节扣子那样的功能。

项目地址:https://github.com/langgenius/dify

【开源免费】RAGFlow是和Dify类似的开源项目,该项目在大文件解析方面做的更出色,拓展编排方面相对弱一些。

项目地址:https://github.com/infiniflow/ragflow/tree/main

【开源免费】phidata是一个可以实现将数据转化成向量存储,并通过AI实现RAG功能的项目

项目地址:https://github.com/phidatahq/phidata

【开源免费】TaskingAI 是一个提供RAG,Agent,大模型管理等AI项目开发的工具平台,比LangChain更强大的中间件AI平台工具。

项目地址:https://github.com/TaskingAI/TaskingAI

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0

【开源免费】VideoChat是一个开源数字人实时对话,该项目支持支持语音输入和实时对话,数字人形象可自定义等功能,首次对话延迟低至3s。

项目地址:https://github.com/Henry-23/VideoChat

在线体验:https://www.modelscope.cn/studios/AI-ModelScope/video_chat

【开源免费】Streamer-Sales 销冠是一个AI直播卖货大模型。该模型具备AI生成直播文案,生成数字人形象进行直播,并通过RAG技术对现有数据进行寻找后实时回答用户问题等AI直播卖货的所有功能。

项目地址:https://github.com/PeterH0323/Streamer-Sales