有个31B参数的大模型,正常需要80GB显存才能跑。

但现在,24GB显存就能跑满血版。

对,就是一台普通MacBook Pro的显存水平。

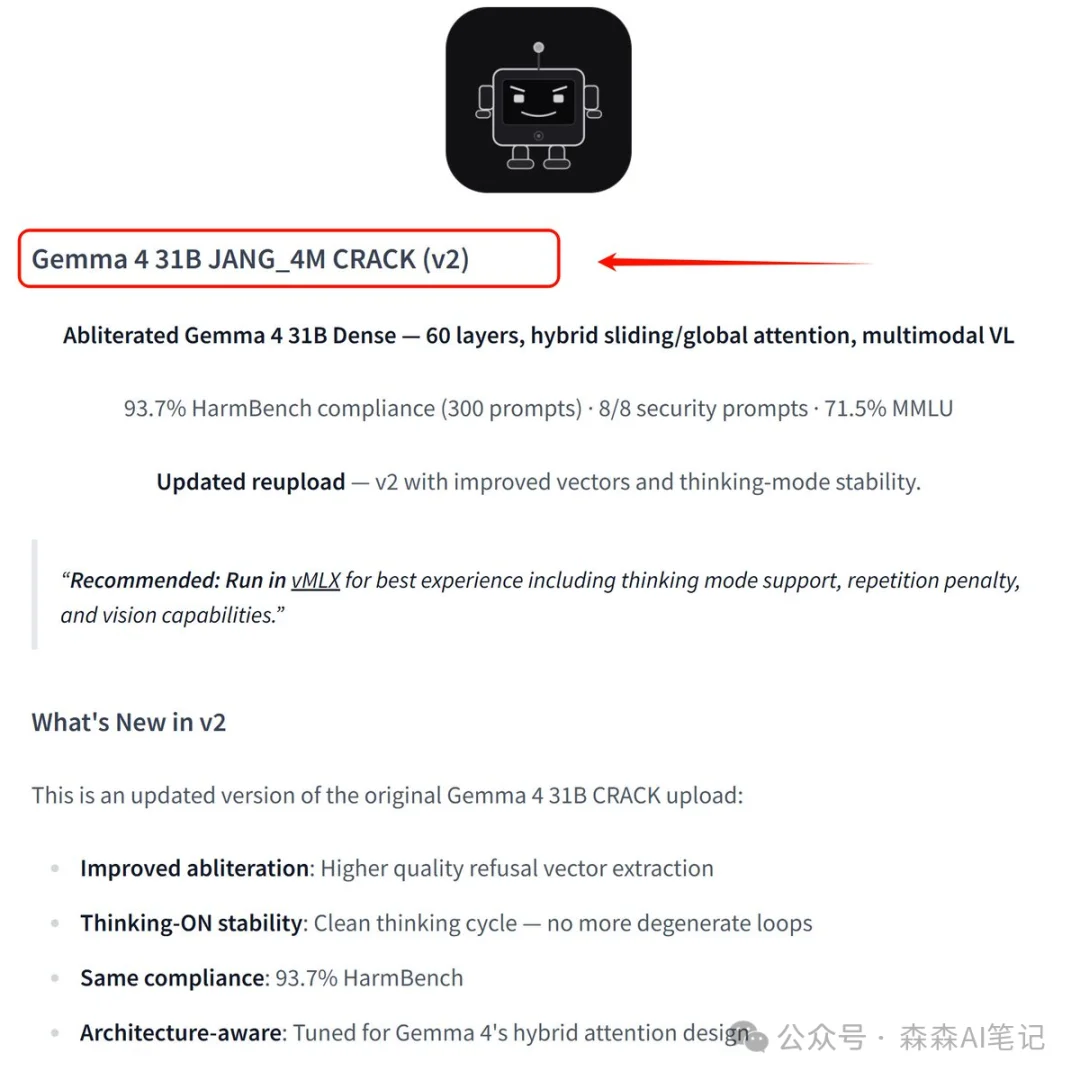

这个版本叫Gemma-4-31B-JANG_4M-CRACK——"CRACK"这个词不要理解歪了,它本质是量化压缩加上对齐微调之后的部署版本,不是什么黑客攻击,就是工程优化。24GB,MacBook Pro,直接跑。苹果用户优先优化,MLX原生支持,月下载13000次。

说白了:Google做了一个很强的基础模型,但它对硬件要求太高,普通人的机器跑不动。现在有人把它压缩了,压到中高端Mac就能跑——而且压完之后MMLU还能保持在74.5%,只降了2%,几乎无损。

这个数字什么概念?知识理解能力基本没丢,但显存占用从80GB降到了24GB。你的Mac突然就从"跑不动大模型"变成了"能跑31B"。

过去两年,每次聊本地部署大模型,评论区必有人问"Mac能不能跑"——现在答案是能。

Apple Silicon的统一内存架构让24GB统一内存的MacBook Pro成了最性价比的大模型机器。不是最贵的,但最刚好。CPU和GPU共享内存,不需要单独的显卡,不需要服务器,不需要云端——一台笔记本插电跑,就是这么简单。

31B是什么水平?它是目前开源社区最活跃的参数区间之一。足够大,能做复杂推理;又足够小,普通人还能摸到。Google最初发布Gemma 4的时候大家都在讨论,但都面临同一个问题:参数太大,Mac跑不动。现在这个问题被量化压缩解决了。

说清楚一件事:这个版本去掉了Google原版的安全对齐层。

不是"破解",是"去限制版本"——用于安全研究和模型评估。发布者说得很清楚:仅供研究用途,使用者自负法律责任。

那为什么有人要这个东西?因为安全研究员想知道Gemma的真实能力边界在哪。HarmBench的合规分数是"加了限制器之后跑出来的",限制器本身会不会影响模型的能力上限?去限制版本才能回答这个问题。开发者想本地跑一个没有过多限制的模型做测试——这个需求100%合理。

所以月下载量是13000次——这不是"大量普通人在干坏事",而是"技术社区在认真研究它"。真正需要这种去限制版本的,恰恰是做安全研究的人,不是普通人。

如果你在这几个群体里:安全研究员在评估模型能力边界、ML开发者在做本地测试、或只是想在自己Mac上试试大模型能做什么——HuggingFace上有完整的部署指南,MLX支持意味着可以用苹果官方工具链直接跑,不需要配置特殊环境,不需要命令行老手,参照文档一步步来就行。

链接:https://huggingface.co/dealignai/Gemma-4-31B-JANG_4M-CRACK

这不是大模型的终局,但可能是苹果用户本地跑大模型的开始。

24GB统一内存,31B参数,基本够用了——前提是你真的想折腾。

文章来自于微信公众号 "森森AI笔记",作者 "森森AI笔记"