“如果AGI实现了,它会危及人类安全吗?”

对于硅谷的AI独角兽而言,这并不是杞人忧天的笑谈,而是一个严肃的话题。

有多严肃?硅谷估值最高的三家AI独角兽——OpenAI、Anthropic、Inflection.ai,都把AI安全列入了公司章程。为了避免AI安全成为一句空洞的口号,它们通过改变公司的治理结构来实现这一点。

OpenAI原本是一家非营利性组织,对于AI技术的研发也是为了公共利益而非追逐财务回报。但是在2019年,OpenAI改变了初心——尽管它并不承认这一点——变成了一家营利性组织。对此,心有不甘的埃隆·马斯克正在与其对薄公堂,要求OpenAI给个交代。

跟非营利性组织不同,Anthropic与Inflection.ai用了另外一种方式。他们把自己注册为一种新的公司类型——公益公司(Public-benefit corporation,PBC),并把“用人工智能造福人类”写进了公司章程。

公益公司仍然是营利性公司,但是根据相关法律,公益公司的董事会不仅要追求股东的财务回报,还要追求更长远的公共利益,并且需要定期出具报告。如果不遵守这些要求,可能会引发股东诉讼。

Anthropic通过设计了一个创新性的治理架构——长期利益信托基金(The Long-Term Benefit Trust,LTBT),并发行一类特殊的T类股票来保障制度的执行(Inflection.ai暂未公布治理细节)。

这样一来,面对AI安全的威胁,世界上最顶尖的AI公司分成了两个阵营——自称非营利性机构的OpenAI,与作为公益公司的Anthropic与Inflection.ai。

自从OpenAI发生宫斗事件以来,人们对于OpenAI能否保持非营利性的初心失去了信心。那么,公益公司会是更好的尝试吗?

至少,Anthropic正在给出一个比OpenAI更诚恳的示范。

一、OpenAI如何上演“一出好戏”

2023年3月,在OpenAI发布GPT-4并获得微软100亿美元加码投资之后,马斯克在X上表达了不满:“我很困惑,我捐赠了1亿美元的非营利组织,怎么变成了一个市值300亿美元的营利公司?”

今天,马斯克的不满已经从牢骚上升到了诉讼。

几乎没有人质疑OpenAI是目前世界上技术最强的AI公司。但是自从2023年11月CEO被罢免的人事风波之后,人们开始对OpenAI的公司治理能力表示怀疑。

OpenAI经历过一次复杂的公司架构改革。2015年成立时,OpenAI是一家非营利组织,使命是“确保数字智能(2018年改为AGI)造福全人类”,公司的运营资金来自于马斯克等人的捐款。

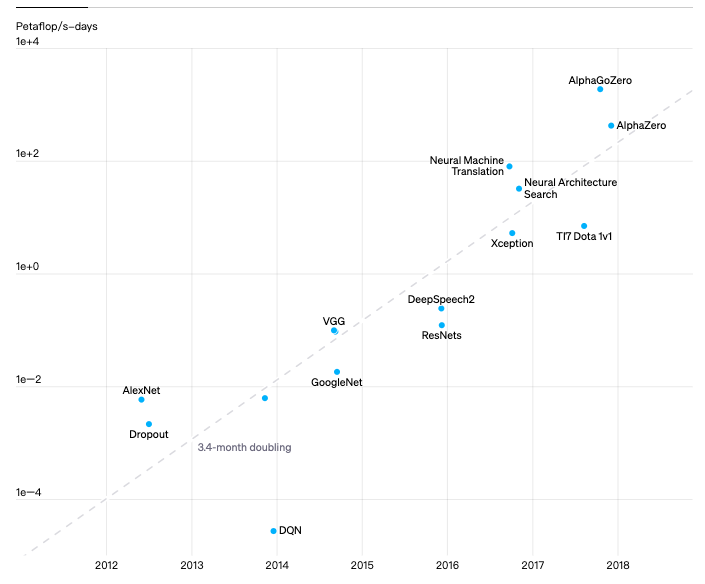

但是随着研究的推进,OpenAI发现人工智能系统除了需要算法创新,还需要使用最多的计算能力。根据OpenAI的估算,从2012年的AlexNet到2018年的AlphaGo Zero,计算量增加了30万倍。

2019年,为了更高效、快速地进行扩展,OpenAI决定提高筹集资金的能力,而这显然是无法通过非营利组织的方式“用爱发电”来实现的。OpenAI成立之初筹集资金的目标是10亿美元,但实际上只收到了1.305亿美元的捐款。

为此,OpenAI做出了一个“违背祖训”的决定,不再坚持自己是一家纯粹的非营利组织。

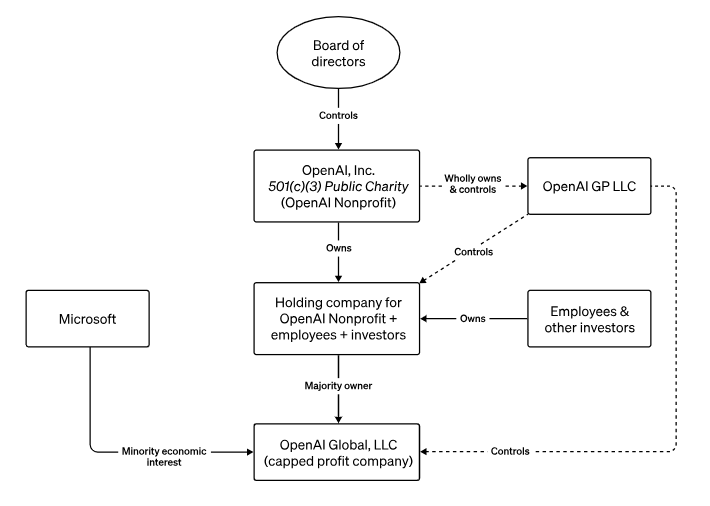

OpenAI创建了一个营利性子公司“OpenAI LP”,来筹集投资资金并以初创公司的股权吸引人才,大部分员工都被转移到该子公司工作。而原先的公司实体称之为“OpenAI Nonprofit”,保留公司的控制权。

为了保证OpenAI LP不是盲目追求利润,而是“使命至上”(确保创建和采用安全且有益的AGI),OpenAI设计了“利润的上限限制”——第一轮投资者的回报上限为其投资的100倍,任何超出这个数额的回报都归原来的OpenAI Nonprofit实体所有。

在2019年OpenAI宣布成立营利性子公司不久,微软向其投资了10亿美元,获得49%的股权,并成为OpenAI的独家云服务商。

尽管OpenAI一再强调,所有投资者与员工都签署协议,规定OpenAI LP对公司宪章的义务始终放在第一位,即使以牺牲部分或全部财务股份为代价。但是,关于OpenAI违背初心,变成了一家由微软在背后操控、以利润为导向的公司的批评不绝于耳。

一些员工也因此离职,其中最知名的当属阿莫迪兄妹——达里奥·阿莫迪(Dario Amodei)与丹妮拉·阿莫迪(Daniela Amodei),两人在2021年从OpenAI离职,并创立了OpenAI最大的竞争对手Anthropic。

为了向公众澄清公司的第一使命仍然是构建对公众有益的AGI,OpenAI在2023年6月进一步披露了公司治理结构的细节。

首先,非营利组织OpenAI Nonprofit全资拥有并控制一个管理实体OpenAI GP LLC,该实体控制和管理营利性子公司。

其次,董事会仍然是非营利组织的董事会,每位董事必须履行其信托职责,来推进“安全、广泛受益的AGI”的使命。虽然营利性子公司被允许赚取和分配利润,但它必须遵守这一使命。非营利组织的主要受益者是人类,而不是OpenAI投资者。

第三,董事会保持多数独立性。独立董事不持有OpenAI股权,包括OpenAI CEO萨姆·奥尔特曼也不直接持股。他只在全职加入OpenAI之前,通过Y Combinator对OpenAI进行了小额投资。

第四,分配给包括微软在内的投资者和员工的利润受到限制。所有超出上限的剩余价值都将返还给非营利组织,以造福人类。

第五,董事会决定何时实现AGI。AGI指的是一个高度自治的系统,在最具经济价值的工作中表现优于人类。此类系统不包括在与微软签订的IP许可和其他商业条款中,这些条款仅适用于AGI之前的技术。

OpenAI想要传递的思想是,“使命是目的,营利是手段”。按照原计划,这套看上去很复杂的治理架构能够让OpenAI兼顾长期的AGI使命与短期的经济回报。

OpenAI也预料到了两者之间潜在的冲突,因此规定只有不持有公司股份的董事会成员才有投票权,以此来避免公司做出“短视决策”。

在人事政变之前,OpenAI董事会有6名成员,包括三位员工萨姆·奥尔特曼、格雷格·布罗克曼、伊利亚·苏茨克维,以及三位外部独立董事。让人万万没有想到的是,奥尔特曼本人差一点就因为这套自己设计的机制被赶下台。伊利亚·苏茨克维联合外部董事以多数投票罢免了奥尔特曼CEO的职务。

不过,由于伊利亚很快倒戈转向奥尔特曼的阵营,在大股东微软与全体员工的压力下,董事会最终妥协,奥尔特曼回归。

这“一出好戏”加剧了人们对于OpenAI公司治理的怀疑,其“让AGI造福全人类”的使命是否只是一个堂而皇之的口号?

相比之下,由OpenAI前高管创立的Anthropic,在公司治理层面所付出的行动看上去要更加诚恳。

二、Anthropic的大型公司治理实验

Anthropic是比OpenAI更加关注AI安全的公司,并且采用了与OpenAI不同的方式。

Anthropic的两位创始人阿莫迪兄妹原本是OpenAI的核心员工。哥哥达里奥·阿莫迪担任OpenAI研究副总裁,负责掌管公司安全并带领团队研发GPT-2和GPT-3;妹妹丹妮拉·阿莫迪担任OpenAI安全政策副总裁。

2021年,兄妹两人对OpenAI发展方向产生分歧,于是离职创办了一家与OpenAI有不同价值观的AI公司——Anthropic,意思是“有人类有关的”。Anthropic的目标是构建一套可靠、可解释、可控的“以人类(利益)为中心”的AI系统。

2023年9月——在OpenAI公司详细公司治理架构的三个月后,Anthropic也对外公布了一种新的公司治理结构,颇有一种对垒的意味。

Anthropic的创新在于,它采用了一种“公益公司+长期利益信托基金”的治理方式。

首先,Anthropic是一家在特拉华州注册的公益公司,这是公司的基础。

公益公司是一种新的公司类型。不同于OpenAI非营利组织的“壳”,公益公司首先是一个营利公司,但是同时也要求股东平衡财务利润与公共利益。

2010年4月,马里兰州成为美国第一个通过公益公司立法的州。截至2018年3月,36个州和华盛顿特区已通过立法,允许创建公益公司。

Anthropic与Inflection.ai都是公益公司。Anthropic公益目标是“为了人类的长期利益而负责任地开发和维护先进的人工智能”;Inflection.ai的公益目标是“开发利用人工智能的力量来改善人类福祉和生产力的产品和技术,同时尊重个人自由,为共同利益而努力,并确保我们的产品广泛造福于当代和子孙后代”。

但是,就像OpenAI需要面对且没有解决好的问题一样,如果股东的财务利益与公司的公共利益出现了冲突怎么办?董事会要站在哪一边?

为了解决这一潜在的矛盾,Anthropic设计了一种新的公司治理结构——长期利益信托基金。

Anthropic成立之初就成立了该机构,最早称为“长期利益委员会”,并在2021年写入了公司的A轮融资文件,但那时只是一个雏形。经过两年的调整与法律完善,长期利益委员会演化为更成熟的长期利益信托基金。

长期利益信托基金是一个独立机构,目前由五位人工智能安全、国家安全、政策和社会企业方面具有背景和专业知识的受托人组成,受托人的职责就是免受Anthropic的经济利益影响,可以独立地平衡公众利益与股东利益。

Anthropic董事会在为期一年的搜索和面试过程中选择了这些初始受托人,以发现那些表现出深思熟虑、坚强品格以及对AI的风险、利益和对社会影响有深刻理解的个人。受托人任期一年,未来的受托人将由受托人投票选举产生。

长期利益信托基金具体有什么权力?在2023年5月C轮融资结束时,Anthropic修改了公司章程,创建了一种新的股票类别(T类),由信托独家持有。

T类股票授予信托选举和移除Anthropic董事会成员的权力——实际上创立了一种新的股东类型,这些权力将根据时间和资金的里程碑逐步实施。总地来说,信托基金将在4年内选举董事会的多数成员。同时,Anthropic创建了一个新的董事席位,将由C轮及其后的投资者选举,以确保投资者的观点未来能够直接在董事会上得到代表。

Anthropic表示,长期利益信托是一项关于公司治理的大型社会实验,此前并没有任何参考案例,但这是经过深思熟虑来设计的。Anthropic称自己是“实证主义者”,想看看它是如何工作的。

为了防止这种设计被轻易推翻,Anthropic设计了一个修订过程,大多数调整将通过受托人和董事会的协议进行,或者受托人与其他股东的协议进行。

当然,信托基金的权力不是无限的。由于其实验性质,Anthropic还设计了一系列“保险丝”条款,如果足够大的股东多数同意,允许在没有受托人同意的情况下更改信托及其权力。

Anthropic为什么要这么做?

Anthropic认为,公司治理产生社会有益成果的能力很大程度上取决于非市场外部性(Non-market externalities,指在没有市场交易的情况下,一个经济主体的行为对另一个经济主体产生的间接影响)。非市场外部性的影响可以是正面的也可以是负面的,其中一方的行为影响了第三方的福利,而这种影响没有通过市场价格机制得到补偿或惩罚。

常见的正面外部性的例子是教育,个人接受教育不仅提高了自己的生产力,也提高了社会的整体知识水平和创新能力;常见的负面外部性的例子是污染,工厂排放的污染物可能对周围环境和居民的健康造成损害,而这些成本并没有在工厂的生产成本中体现出来。

Anthropic认为,人工智能将会创造前所未有的巨大外部性影响,从国家安全风险到大规模的经济破坏,从对人类的根本性威胁到对人类安全和健康的巨大利益。技术的发展如何迅猛,以至于约束其高外部性的法律和社会规范尚未跟上步伐。

Anthropic愿意做一个吃螃蟹的公司。

值得一提的是,Anthropic认为日常所做的大多数决策,公共利益与股东回报并不矛盾,通常是强烈协同的:建立有效的安全研究的能力取决于建立前沿模型,建立前沿模型的同时也会在商业成功上获得极大回报。

这种观点与OpenAI一致。国内像周鸿祎也表达过类似的观点:“不发展才是最大的不安全。”

Anthropic表示长期利益信托基金不会介入这些日常决策,而是主要关注人类的长期利益以及极端事件。

三、谁是更好的治理方式?

OpenAI与Anthropic分别代表了估值第一与第二的AI独角兽,有相似的使命、相似的理念、相似的人才与技术能力,但采取了不同的治理模式。

哪一种模式更好?

Anthropic的优点在于,通过公益公司相关法律的约束,来平衡股东与公众的利益,需要定期向所有者报告公司是如何促进其公共利益的。如果不遵守这些要求,可能会引发股东诉讼。

而且,Anthropic还通过长期利益信托基金以及发行T类股票的形式,来提供适当的经济利益,并赋予任命与解雇董事会成员的权力。

尽管也会存在很多问题,但这比OpenAI的治理模式更加具有实际意义。

OpenAI模式最大的问题在于“信任”。奥尔特曼的回归核心在于他对OpenAI的发展功勋卓著且赢得了微软的支持与员工的民心,但本质上已经打破了之前设计的规则。

事实证明,尽管OpenAI董事会的独立董事有权作出他们认为的正确选择,但最终的结果是,投资人与CEO对OpenAI的发展方向有不可替代的发言权。

OpenAI的治理结构还需要进一步完善。2023年11月29日奥尔特曼回归公司时,OpenAI表示将“将加强OpenAI的治理结构,让所有利益相关者——用户、客户、员工、合作伙伴和社区成员——都能相信OpenAI将继续蓬勃发展”。

上周,OpenAI组建了新的董事会,除了奥尔特曼回归之外,还增加了三名女性独立董事,总人数从去年的6人扩展到8人。

同时,OpenAI继续强调了下一步的进展,聚焦在公司治理层面:

OpenAI可能会在未来某个时间点公布具体细节。

OpenAI会像Anthropic那样变成一家公益公司吗?还是继续在现有治理架构上做出更多的创新?

不论最终结果如何,这些世界一流的AI公司,正在尝试新的有关全人类利益的可能性。这是大众愿景看到的事情。

本文来自微信公众号:甲子光年 (ID:jazzyear),作者:赵健