皮衣老黄亲自上门送货!OpenAI收到世界上第一台DGX H200超算。

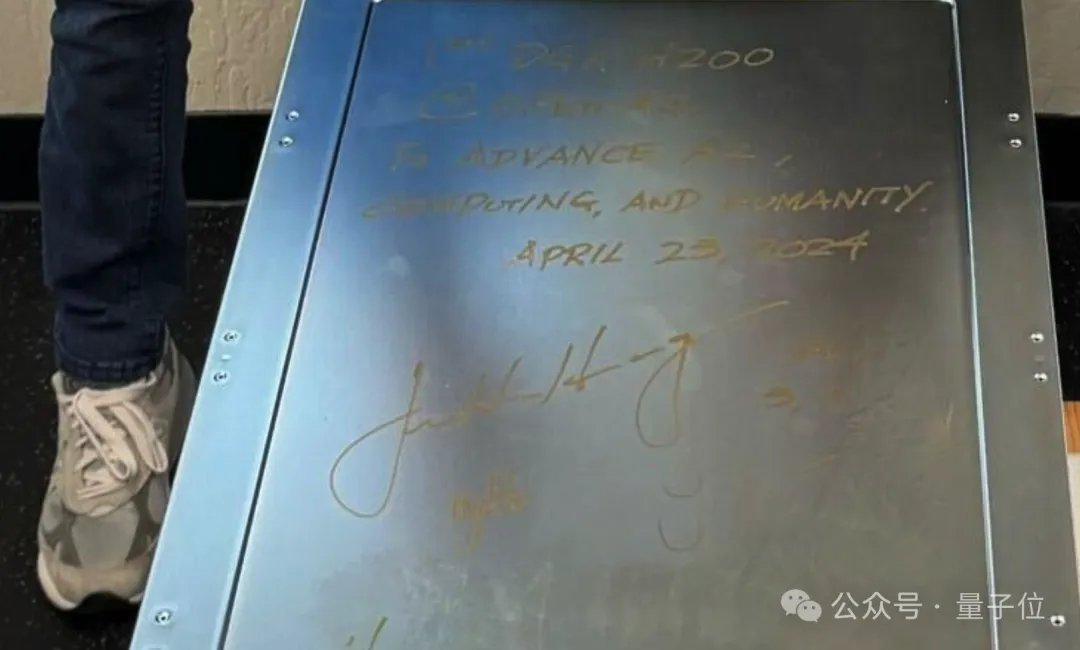

致推进人工智能、计算和人类发展。

这下呼吁快发布GPT-5的声音更高了。

在OpenAI负责模型微调的员工Steven Heidel开玩笑说:“老黄签过名上了Buff的GPU,运算速度可是会加快20%。”

这场面与八年前,2016年老黄向OpenAI赠送世界上第一台DGX 1超算时何其相似,相似的皮衣,相似的致辞,相似的算力巨兽,只是遍插茱萸少两人:

一到这种时候,自然少不了热衷玩梗的网友。

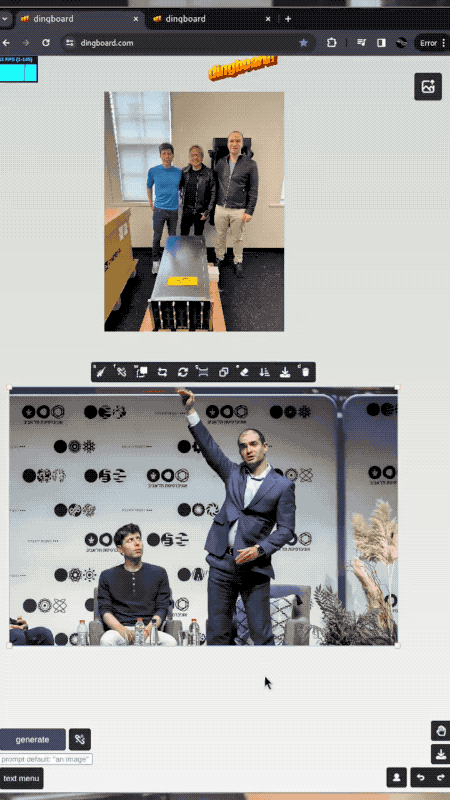

只花1分钟,在线AI修图工具Dingboard.com开发者就把Ilya照片无违和感的变换姿态,P到合影里。

以及有眼尖的网友指出,Brockman身后墙上的装置可能是居家健身品牌Tonel的力量训练器械。

奇怪的是,OpenAI总裁Brockman的推文与机器上的签名都是“DGX H200”,而英伟达官网上相关产品只有“DGX GH200”。

目前尚不清楚两者是否指代同一产品,或者是英伟达为OpenAI推出了特殊定制版本,去掉了DGX GH200中的Grace CPU,只留下了H200 GPU。

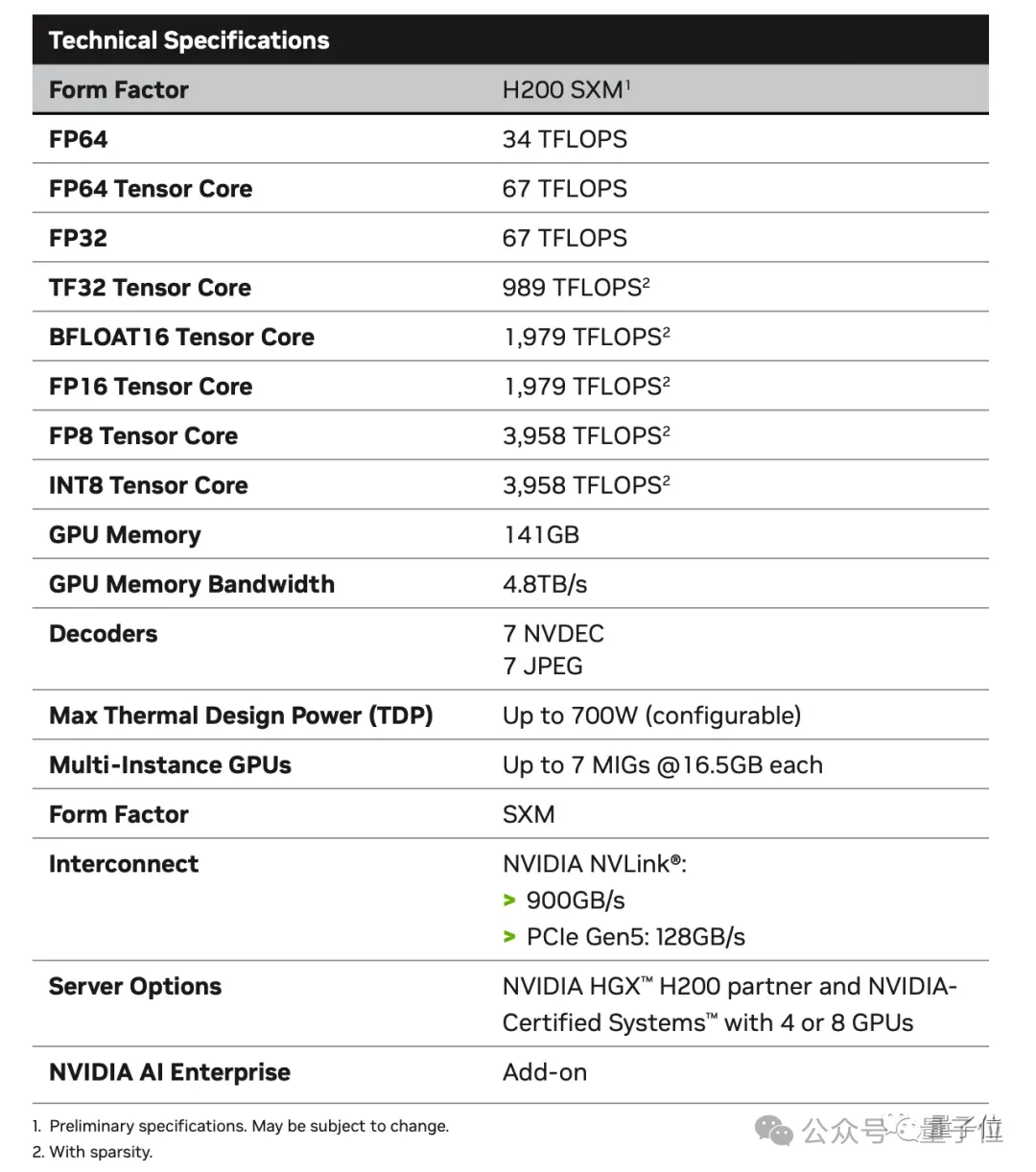

H200 GPU的特点一言以蔽之:141GB大内存,与H100的80GB相比直接提升76%。

作为首款搭载HBM3e内存的GPU,内存带宽也从3.35TB/s提升至4.8TB/s,提升43%。

除内存升级之外,H200的其他各方面规格和峰值算力与H100保持一致,一个优势在于可以直接替换到现有的H100计算机群中去,不用做任何调整。

ChatGPT官号也透露,更多的内存带来更多的KV缓存,也就可以运行更多的ChatGPT。

暗示新超算可能会用于ChatGPT的推理加速。

与老黄合影几个小时后,奥特曼被曝现身斯坦福大学的Nvidia礼堂发表演讲。

礼堂可容纳342人已经爆满,还有约200人挤在外面。

根据斯坦福学生Andrew Gao介绍,随后他有机会参加了奥特曼20人左右的闭门会议。

他提到了一些大事,但我不能分享。

另一位参加闭门会议的人也没有透露具体内容,但总之对GPT-5很兴奋。

文章来自微信公众号“量子位”