最近百度的公关一号位事件如果孤立来看,会觉得是百度公司出了问题,但更关键的并不是百度出不出问题,而是这背后的隐含的普遍性。璩女士则有点像有人隔墙扔了一个砖头,然后在墙这边很不幸地被砸到了。

有问题固然是有问题,但假如一个人一直生活在一个50平米的井里面,他按照他感知到的天空、气候设计了一生的生活,虽然具有最佳的合理性,但从井外的人看一定是滑稽的。可这种滑稽是井的原因还是人的原因呢?

中国式管理段子的前前后后

我看过自嘲中国式管理的段子里最有趣的是一个三段论,这个段子说中国式管理理论核心就三点(非原创):

1. 你干得好,是因为我领导有方。

2. 你干不好就是你有问题,和我没关系。

3. 你不干有的是人干。

如果我们不孤立地看事情,把它和璩女生的言论放在一起看:

我为什么要考虑员工家庭?我又不是她的婆婆。

你可以不用承担重要的工作,但涨薪的时候就没有你什么事。

我们的关系只是雇佣关系,我考虑的是他能不能及时给我交付结果。

然后你会惊讶地发现:第一两者具有一定延续性,第二璩女士其实是进步了的。

但我们终究不能总是向后看齐,我们可以做下另一种类比:我们能想象OpenAI的Sam Altman对他的科学家们是璩女士发言的风格么?

反过来讲假如一个公司真的是璩女士价值观所代表的场域,真的能够聚合优秀人才、开拓创新做出引领时代的产品么?即使有足够的钱、足够的机器、足够的数据。

大概率是不灵的,那差的到底是什么呢?(参照:《AI上国内团队好像被甩开了?差钱?差人?》)

工厂与创新

在泰勒的科学管理兴起后很长一段时间里,璩女士的价值观其实是企业主流价值观。

在流水线上按件计酬也没什么不对。

电影《摩登时代》的那类背景下,能做到这个再有合适的工资水平其实已经算温和派了(大家可还记得夏衍的《包身工》)。

福特所谓的:我想雇佣他的手,为什么带脑子思考呢(大意)。就是那个时代的产物。

可这类价值观其实有个清楚的适用边界,它只适合做已经被分解的足够清楚的活。

后来这点即使在汽车生产制造领域也碰到巨大挑战。

因为持续改善的事似乎不能脱离现场,知与行需要是一个连贯的过程,现场的人如果足够呆板,那就会失去现场的反馈,所以就有精益的兴起。

精益本身更像一种价值观多于一种方法,到精益为止是汽车行业在引领着管理的思潮。

精益之后互联网、人工智能兴起,数字相关技术迭代速度太快,这导致企业始终需要面对不可测知的环境和未来。于是团队的活性变得更加关键,没有这种活性,创新没有可能。

很有意思的是,在软件开发不长的历史上,大家又重复了一遍科学管理到精益的过程,具体表现从CMMI到敏捷软件开发。

而当探索未知领域而不是在成熟领域里修长城(或者守城)更关键的时候,璩女士所表达的价值观受到了挑战。

可以这么总结,在纯粹的工厂和创新型组织之前有着无数个活性层级,不同的层级其规则性和创新性不同,衍生的价值观也就不同。

事业的属性决定活性的层级以及对应的价值观。

群嘲璩女士意义不大,更关键的是为什么这种本应过时、只匹配某类领域的价值体系变得如此普遍。

有些观念的牢固性远超我们想象,多少人在学习刘邦的英明神武,学习法家的权谋,并尝试活学活用呢?这不是一个让人开心,甚至是有点悲壮的事情。

AI来了之后呢?

很不幸AI来了后,短期其实会放大这种落后价值体系的适用边界。

过去算法的普适性不好,最终导致公司只能在有限领域践行这种价值观,比如外卖小哥或者滴滴司机等。

基于大模型的AI则带来了一种低成本的通用性,比如如果办公室装满摄像头和麦克风,那其实办公室里面的员工们可以变得和外卖小哥一样基于AI的分析和判断进行管理。

这时候如果你长时间刷抖音,那AI模型可能判断你工作态度不积极,然后和绩效关联。

中期则正相反,AI会消灭这类岗位。

这类岗位不太需要人的想象力等部分,往往需要比较好的逻辑分析和判断能力,而在这种领域上,人是不可能比得过AI的。

并且它还没情绪,不会因为失恋磨叽,24小时待命,让干啥干啥。

如果有这种智能体是不是完美匹配璩女士那类价值体系下的所有期盼。

因此假如智能体的智能效能够了,在璩女士这种价值观主导下,无疑所有下属都适合变成人工智能。

因此我们也可以说,很多时候我们对人才的呼唤,并不是真的在呼唤人才,而是在呼唤人工智能,假如价值体系不变的话。

这些智能体能够自己就发明新的模型算法么,类似从CNN到GPT的跳越?

这估计是不灵的。

真正对世界的信息进行综合,创造新产品还是要依赖人。

公司的升级

我不太认为口诛笔伐能消灭一种有现实基础的价值观,当然可以消灭个例(璩女士不就被干离职了么)。

价值观实际上很大程度上会和边际效能最大化匹配。

但技术革命确实可以消灭。

如果AI智能体普遍崛起,新挑战在于:凡是需要一个很听话、能干活的人的岗位,其实都可以用人工智能;需要独立思考保持个性的地方才需要人类。

这时候这类价值观就会彻底报废,因为管人工智能不需要价值观,需要参数和设定。

而引领剩下的人,这类价值观正好和你需要的人不匹配——这才是AI冲击的最正向的方面。

AI视角下公司的组织模式

一种模式类似手术师团队。一个主刀医生,其余的人全是助理。这种公司当AI足够发达后,会变成1~2个人的公司。反过来讲,当你能力足够好,你有可能可以创建人数极少的公司,并且成本很低。滴滴、外卖其实都是这种模式,这时候AI有点像全知全能的管理者。

一种模式类似足球团队。这时候个体自由度会变大,但还是有个自己的角色。比如电商的情景下,你上什么货、怎么定价、怎么花钱其实没人管,但要尊重一个生态体系里确定的规则。这时候AI像基础规则的捍卫者。

一种类似网球团队。这时候个体自由度变得最大,复仇者联盟其实是这种模式,很多创意型团队也是这种模式。这时候AI很像每个人的Jarvis。

稳定性依次减弱,活性依次增加。

没有AI个体活性的增加则会导致整体崩溃,AI的信息处理能力则可以辅助达到规则和活性的统一。

在AI智能体普遍崛起的背景下第一种模式会像一种过渡期的形式,而当AI和公司深度融合就会催生出上述变化。

这时候企业这种组织估计会面对诞生以来的最大的一次变革。

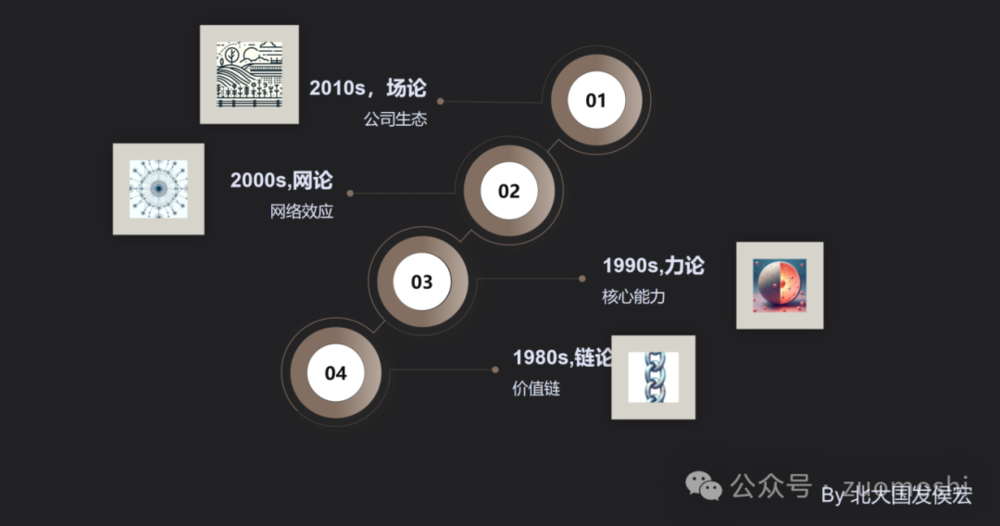

一方面会体现为场论的进一步崛起,另一方面则是会生命体化。

具体怎么实现是另一个话题,不在这里展开,参见:《假如想做一个只有AI智能体的公司,那要分几步》?

小结

AI比较正向的一个作用在于它提供了一种颠覆旧式价值观的能力,让人在工作的时候不再是单纯依赖体力或者某部分的智力,而是有了更完整进行发展的机会(性道合一)。否则当某一个很被鄙视的基础价值观还产生经济价值的时候,那么今天是璩明天是马,就会不停地循环发生。

当道德审判被强化到一定程度的时候,为了保护自己则会催生厚重的伪饰,其实更差。

本文来自微信公众号:琢磨事(ID:zuomoshi),作者:老李话一三

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md