凯文·凯利在《5000天后的世界》一书中预测,称雄AR世界的不会是GAFA——如今的科技四大巨头。

纵观颠覆性技术的发展史,一个领域的主导者从来无法在下一个时代的平台上继续称雄,因为它们的成功会成为它们最大的桎梏。

事实仿佛真的如此。即便谷歌疯狂自证在AGI领域的实力,但却只能在OpenAI身后追赶。

为什么大企业无法创新?为什么是OpenAI首先开发出像GPT-4这样强大的模型?即使像Google、Meta有那么雄厚的资本,那么多人才储备也没有做到?

5月15日,可汗学院(Khan Academy)的CEO兼创始人萨尔曼·可汗(Sal Khan)对OpenAI联合创始人兼总裁格雷格·布罗克曼(Greg Brockman)进行了一段采访,这段采访或许能够帮助我们找到答案。

研究与工程并重

OpenAI日前向公众揭秘了Omni团队,团队成员年龄和司龄的年轻化,以及团队管理的扁平化引发了网友热议。其实在成员组合方面,也「暗藏玄机」。

OpenAI的团队不仅有学术背景的研究型人才,同时还有优秀的工程人才,这种组合使他们能够从不同的角度解决问题,更有效地推动项目进步。

Khan询问Brockman「你们认为自己做了什么才能达到如今的地位?在这个领域,有许多人在努力工作,也有许多资源雄厚的大型组织。你们认为自己做了什么与众不同?是因为你们的方法不同,还是有其他原因?」

Greg Brockman坦言「这是个很好的问题。我认为我们是更大趋势或历史的一部分。回顾过去70年的计算机发展史,我们经历了指数级的增长。」

「2000年,Ray Kurzweil曾经说过,看看计算能力,它会告诉你什么是可能的。这就是推动进步的动力。起初大家都认为他疯了,但现在我相信大家基本上都认同他的观点。」

Ray Kurzweil

「想想我们为了实现像GPT-4这样的项目,付出了多少工程上的努力,从计算基础设施到使用的所有数据集和工具,这其实是全人类在很多方面的巨大努力。」

「具体来说,我们能取得这些成就,是因为我们聚集了来自研究和工程背景的优秀人才。」

「当我们开始这个项目时,让我感到非常有趣的是观察其他实验室的工作方式。你会发现,大多数实验室以研究为主,研究型工程师被告知要做什么,而研究科学家则可以随心所欲。」

「这种方式似乎并不是实际构建一个工作系统的方法,更像是为了追求论文引用数量。如果你真的想产生影响并开发出有用的东西,你需要以不同的方式来组织团队。」

「虽然说起来很简单,但实际上,这涉及到很多相互冲突的思维方式,特别是当你来自不同背景时。」

我们必须尽力去解决这些问题,虽然你永远不能完全解决它们,但可以不断进步并挑战更复杂的版本。这就是我们需要勇于面对困难、勇于挑战的地方。」

不会因为风险的存在而止步不前

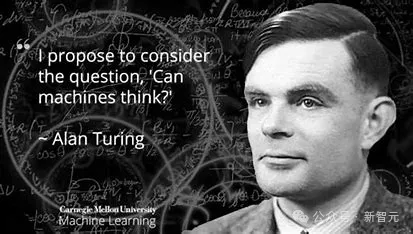

Greg Brockman第一次对人工智能的概念感到兴奋,是在他读到阿兰·图灵(Alan Turing)1950年发表的关于图灵测试的论文的时候。

他想看看,我们是否能够真正制造出图灵所说的那种机器,一种人类水平的智能,也就是我们所说的 AGI,并让它造福于全人类。

这是OpenAI诞生的缘起,也是它的使命和愿景。

为了这个目标,OpenAI已经工作了8年。在这期间,OpenAI一直在做同样的事情——建立更大的神经网络,让它更有能力,更协调、更安全,与此同时,部署这项技术,并使其发挥作用。

Greg Brockman称「这就是我认为这项技术最吸引我的地方,每走一步,你都能真正产生影响,真正开始造福人类。你会看到你所建立的东西带来的好处,并真正学会如何减少所有的不利因素。」

当Khan问及AI的安全性问题,Brockman这样回答「AI的安全问题有着悠久的历史,早在50-60年代,阿瑟·克拉克这样的人就在谈论这个问题。」

《2001:太空漫游》作者阿瑟·克拉克

「我认为,对AI拥有这种复杂的情感是非常正确的,我们既要对任何新事物感到惊奇,又要问这是要去哪里,哪里会有陷阱?我认为只有这样,我们才能正确地在这个空间里航行。」

Brockman提到,一件非常有趣的事情是,AI是如何变得看起来「令人惊讶」的?

在90年代,每个人都认为,如果AI可以下棋,就说明进入了AGI时代,但实际上,这只是我们要解决的第一件事情,AI学会下棋并没有让我们真正走得更远。

安全性问题也是一样。并不是说对AI安全的前瞻性的担忧一定不会发生,但Brockman认为,我们在错误的事情上过于自信了。

他举了一个例子:对于GPT-3,OpenAI只是在基础数据集上进行训练后就将其发布,而对于GPT-4,团队则对模型进行了调整,尽力消除偏见。

事实上OpenAI在2017年就开始开发这项技术,当时这些模型还没有出现。

现在,GPT-4带来了一类新的风险,未来还会出现更多新的风险。风险和益处将会并存,关键是如何学会如何面对这种风险。

当我们在思考GPT对教育领域的影响的时候,一些人可能会首先注意到抄袭的问题,Brockman也承认让学生独立思考非常重要。

但是「对于那些无法获得出色的教育工具的人来说,ChatGPT是一个工具。教师可以根据自己的喜好,帮助学生进行某种工作并填补教育人员无法做到的空白。」

至于如何制定规则,如何将这项技术融入教育,则需要「获得大量的意见,与大量的教育工作者接触。OpenAI不是这项事业唯一的决定者,从每个人那里获得广泛的意见很重要。」

「我们为了实现真正的益处,和一线的教育工作者交谈,真正弄清楚他们想要什么。」

我们还需要「真正展示积极面」。

一旦你有了一个有效的正面例子,就很容易围绕它建立标准,如果没有这个,那么就相当于「在黑暗中开枪」。

就像采访者Khan谈到的,ChatGPT对教育的影响取决于怎样使用,比方说我们可以用它来采访历史人物、练习辩论技巧等。

更多正面使用的案例和经验需要在实践中获得。

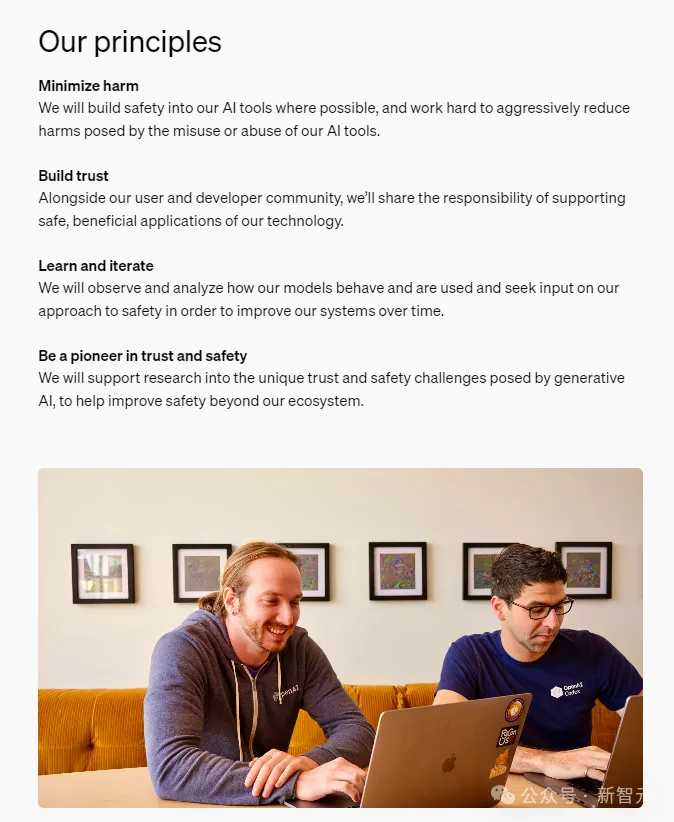

去年OpenAI发布了一篇关于部署语言模型安全标准的博客文章,这篇文章的形成用了2年的时间。Brockman告诉Khan「这种从实践中学习的迭代部署,是我们现在可以做的最重要的事情」。

每个人都可以获得AI的「超能力」

人工智能究竟会削弱人类能力,还是增强人类能力?

Brockman和Khan都站在人工智能会增强人类能力的这一边。

Brockman乐观地说「现在,拥有一部智能手机就可以开始以一种方式进行创作,而你之前必须购买一堆专业软件,你必须去学校接受大量的培训。」

「我认为我们都可以获得人工智能的超能力,我们可以实现我们想要的目标」。

当然,关于这个问题,每个人都可以有自己的答案,但Greg Brockman无疑是一个乐观主义者,这或许也是OpenAI不断向前的原因所在。

乐观是油门,悲观是刹车,两者都不可或缺,但是想要前进,我们必须多踩油门而不是刹车。

文章来源于“新智元”,作者“新智元”