没想到,「开源版」GPT-4o这么快就来了!

昨夜,来自法国AI实验室kyutai放出首个实时原生多模态Moshi,效果演示堪比5月发布的GPT-4o。

比如下面这个demo中,Moshi作为助手帮助Alexa小哥踏上太空之旅,让人一秒幻视流浪地球中的Moss。

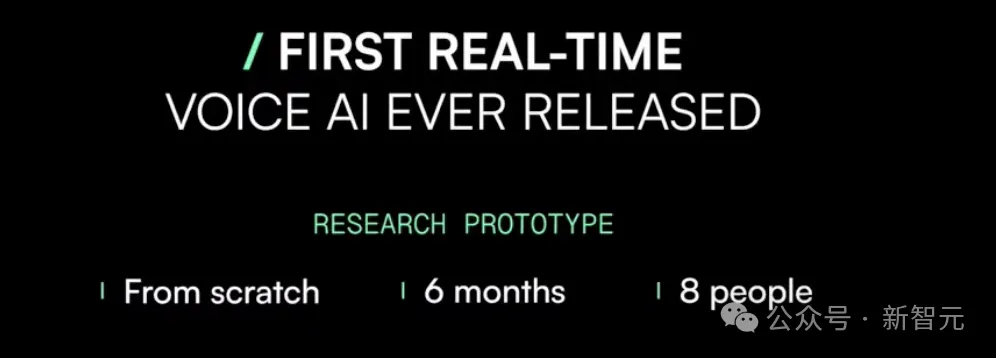

值得一提的是,这是8人团队仅用了半年的时间,从头完成了模型的训练。

Moshi还处在实验原型阶段,设计初衷是为了理解和表达情感,能够支持听、说、看,可以用70种不同情绪和风格说话,甚至随时打断。

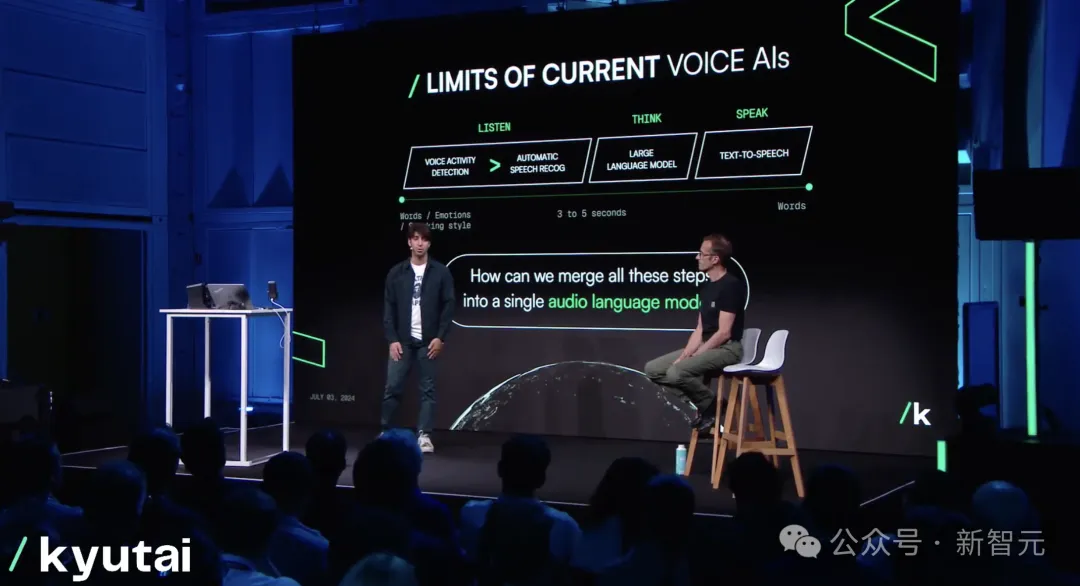

它最为突出的一个能力是,能够同时处理两个音频流,即「听」和「说」是同时进行的。

这种实时互动的实现,是基于文本和音频混合的联合预训练,用Helium中合成的文本数据,训出的70亿参数的模型。

Moshi可以实现最低160ms端到端延迟。

而且,最小版本的Moshi还可以在笔记本电脑,或者消费级GPU上可跑。

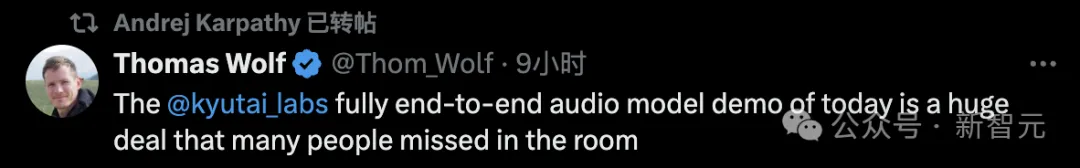

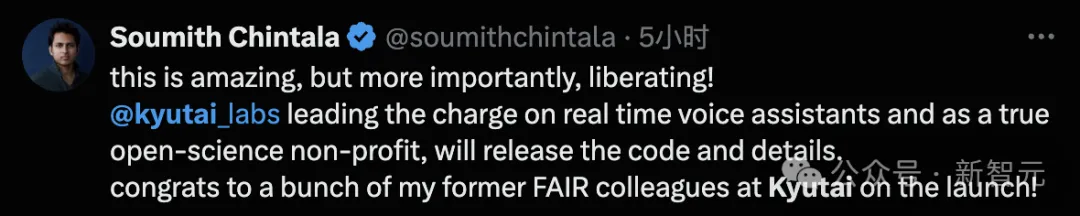

许多人都说这是最接近GPT-4o的模型,Moshi各种炸裂演得到了LeCun、Karpathy等AI大佬的转发。

Pytorch之父称赞道,太令人惊叹了,Kyutai实验室在实时语音助手领域处于领先地位,作为真正的非营利性开放科学组织,它将在稍后发布代码。

而现在,想要体验的小伙伴们,现在可以直接加入候补名单体验了,每次对话限时5分钟。

传送门:https://moshi.chat/?queue_id=talktomoshi

在昨晚的直播演示中,台下虚无坐席。所有观众都在耐心等待,这家成立仅半年时间的实验室将会带来怎样的惊喜。

CEO Patrick Pérez开场介绍,Moshi是他们团队推出的首个实时语音AI,而且用了大约1000个GPU完成训练。

Moshi这一名字来源,便是日语中接电话一词「もしもし」。

接下来,Patrick邀请了四位同事,一同上台来向大家展示Moshi的强大语音能力。

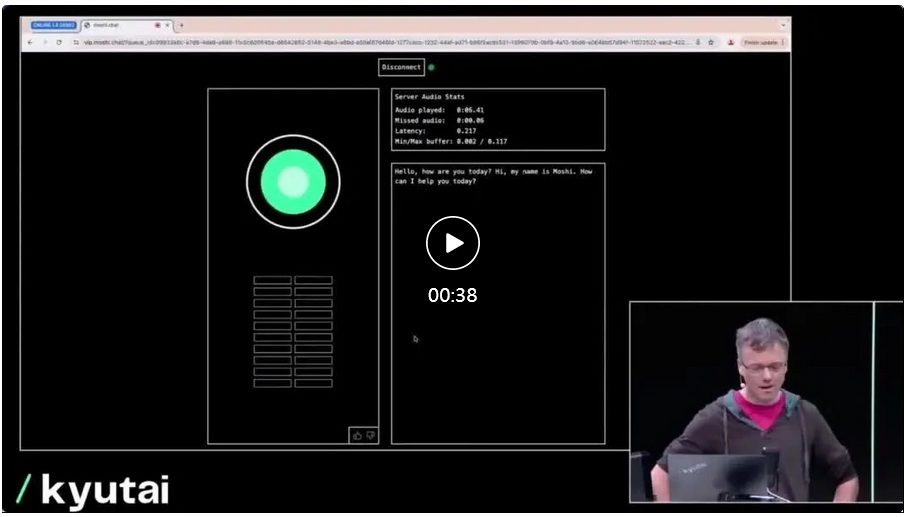

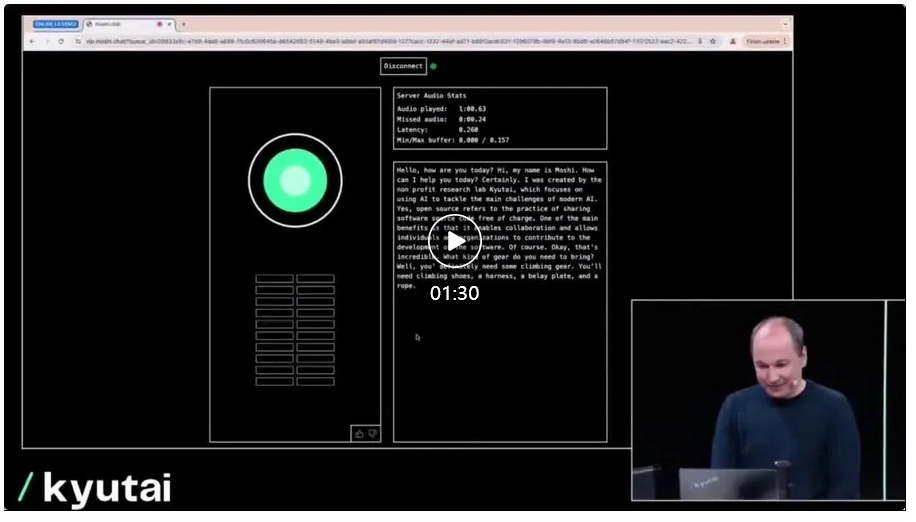

Moshi和所有人初次见面,当然少不了一波自我介绍,并且回答了提问者关于什么是开源、开源好处的意义。

接下来,另一个同事接场,和Moshi换一个话题——聊一聊爬珠穆朗玛峰。Moshi在对话过程中,为其建议了登山装备、提前做哪些准备、海拔信息等等。

不过,在第二个演示的过程中,Moshi太过急于抢话,说话者还未说完,它就切断了说话的内容。

前面的演示中,我们主要看到的是,与Moshi互动关于实时事实性信息、对话等能力。

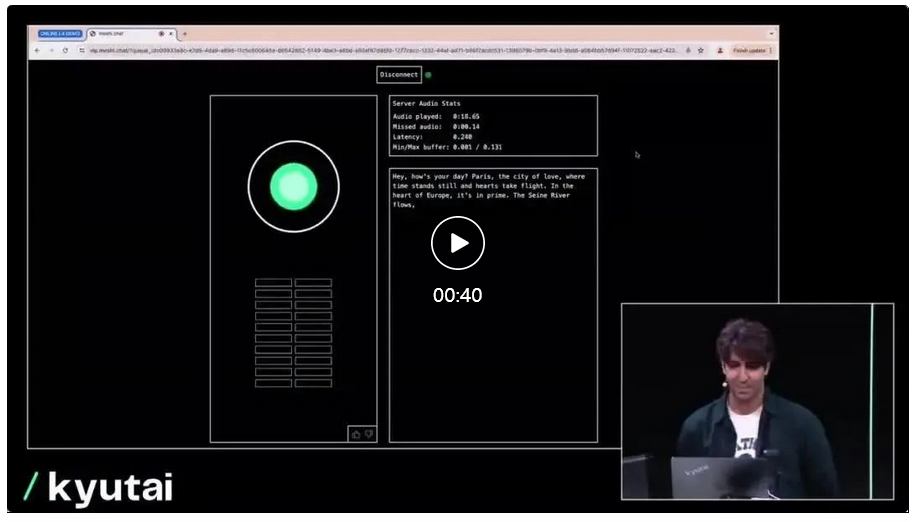

第三个demo中,主要去展示Moshi表达和理解情绪的能力。因此,同事Nell尝试用不同风格的语气和Moshi去说话。

这时,他要求Moshi用法语口音,去朗诵一首关于巴黎的诗。

巴黎,这座爱情之城,此处时间静止,心灵翱翔。坐落在欧洲的中心,正值发展黄金时期。塞纳河流淌,夜晚星光闪烁,简直是一幅美丽的景象。

然后,Nell又让Moshi假装是一位海盗,去讲述自己在「七海」中冒险的经历。

突然间,Moshi一下子变换了语气,特别像我们在《巴勒比海盗》中,听到Jack Sparrow的声音。

甚至,Moshi还可以用一种低声细语的声音,去讲述《黑客帝国》电影中的情节。

对此,LeCun表示,「数字海盗可以听懂带法国口音的英语」。

可以看出,Moshi模型可以在你提问尚未结束时,就能给出回答,或者在你打断模型讲话时,也能做出反应。

这是因为模型中进行了预测编码,并即时更新你要说的话。

在最后一个演示中,同事们决定尝试做一些角色扮演。也就是我们在开篇看到执行星舰任务的demo。

Moshi在技术上,有什么创新,才能拥有对标GPT-4o的实力。

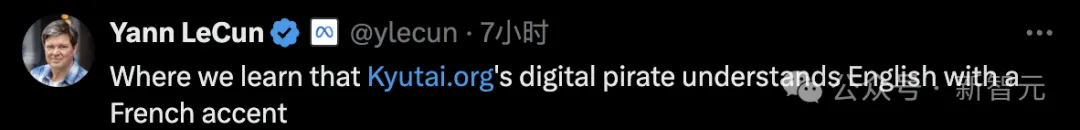

接下来,同事介绍了当前语音AI的一些限制,比如「听」会使用自动语音识别技术,「想」使用大模型,「说」会使用文本-语音技术。

而这分门别类的技术会致使语音AI出现过多的延迟。

那么,我们该如何将这些步骤,融合到一个单个语音模型中,这就是kyutai所做的。

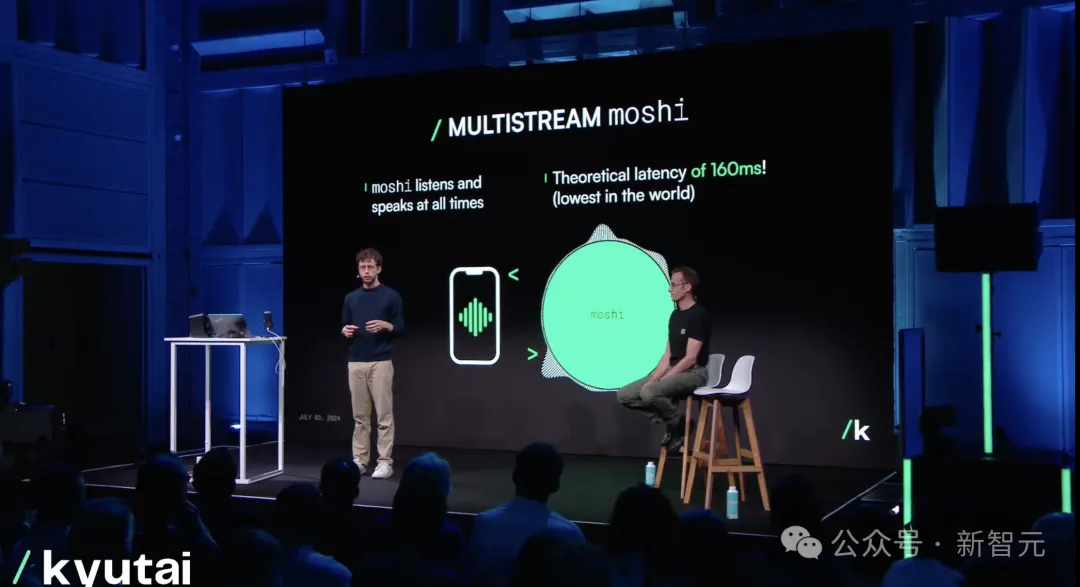

多模态Moshi不仅可以听,还可以说,并在说话的同时能够思考。

理论上讲,Moshi的最低延迟可以实现160毫秒,创世界新纪录。

模型采用了I/O双通道系统,同时生成文本token和音频编解码器。具体来说,语言模型Helium-7B从头先开始训练,然后再与文本、语音编码器联合训练。

该语音编解码器基于Kyutai的内部Mimi模型,压缩系数高达 300 倍,可捕捉语义和声学信息。

在Moshi的微调过程中,采用了涉及了100k「口语式」合成对话——高度详细、带有情感和风格注释的文本记录,均由模型Helium转译而来。

此外,模型的语音还由另一个单独的TTS模型生成的合成数据完成训练。

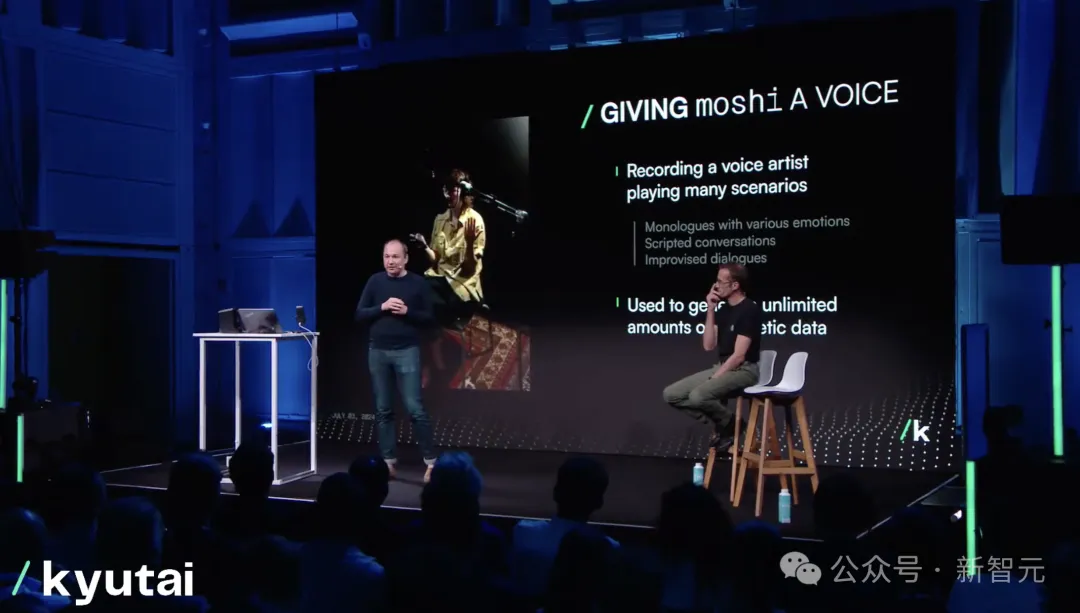

此外,模型还使用了专业配音演员Alice录制了20个小时的音频,并基于此进行微调。

正如研究人员所讲那样,Moshi设计具有适应性,只需不到30分钟的音频就可以完成微调。

在部署方面,Moshi托管在Scaleway和抱抱脸上,可以处理两个批大小的24 GB VRAM。

而且,它还可以支持各种后端,包括CUDA、KV缓存,还可以通过Rust在推理代码中优化。

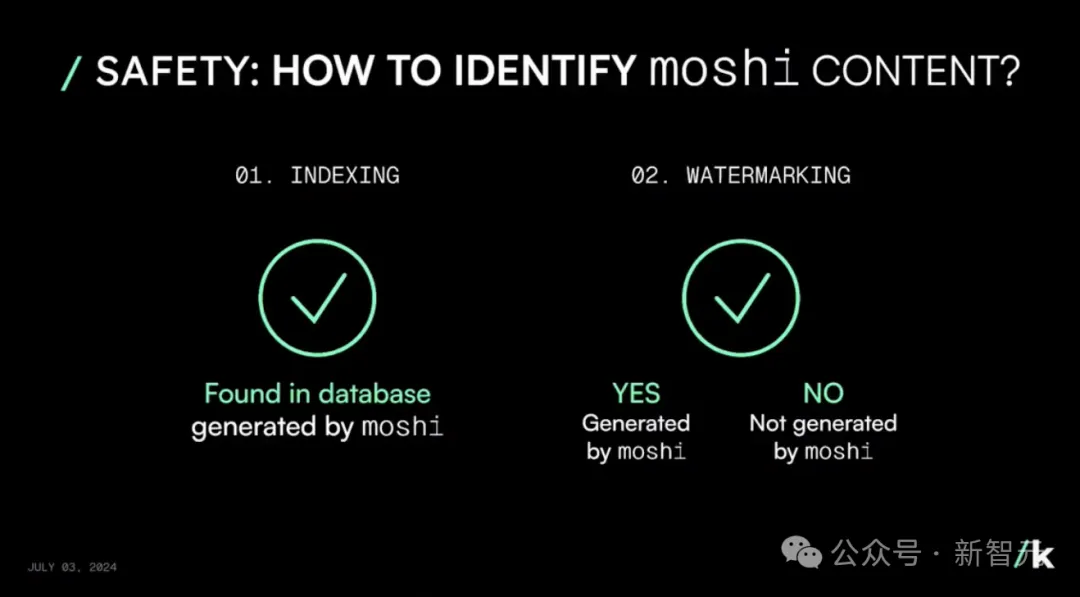

为了确保音频的安全性,Kyutai将会为生成音频附上水印,并在数据库中对生成的音频进行索引。

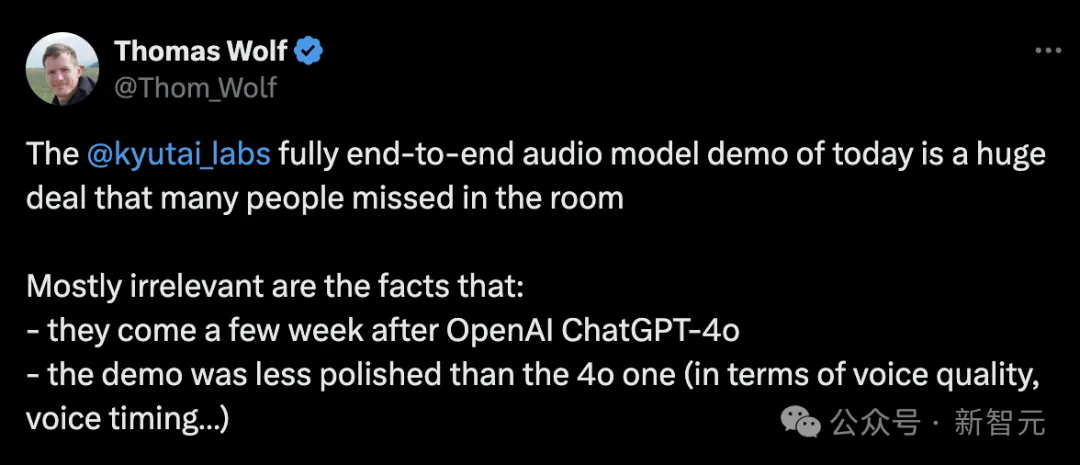

虽然Moshi的发布效果看起来不错,但依旧迎来了推特网友的质疑,认为他们是跟风GPT-4o,而且demo的语音质量、回答时机等方面不如GPT-4o完善。

对此,HuggingFace的联合创始人兼首席科学官Thomas Wolf在线为Moshi站台,并回怼说这些都是「最不相关的事实」。

在他看来,最显而易见的事实是——GPT-4o的语音功能不知道要鸽到什么时候,但Moshi在发布后就已经上线。

此外,他提出了几个值得关注的技术要素。

- 像kyutai这样只有8+成员的小型团队在6个月内构建出了Moshi,模型的训练pipeline和架构应该非常简单,且具有巨大的可扩展性,合成数据也起到了巨大的推进作用。

- Moshi专注于本地设备的部署,这会让它很快就流行起来、无处不在。相比之下,需要考虑盈利的模型(如GPT)没有动力去推进本地运行。

- 在保持答案质量达到Llama 8B或以上水平时,将延迟降低到300ms以下是交互性的关键推动因素。

kyutai是一家来自法国巴黎的非营利AI实验室,从主页中可以看出,这是致力于开源开放的团队。

目前,kyutai重点关注多模态技术,并且他们在官方简介中承诺:所有开发的模型都是为了能免费开放共享。

敢在主页上使用「Open Science」这种描述,这和kyutai的承诺与愿景是分不开的。

不仅仅是开源模型,他们还希望能够发布训练代码和数据,以及相应的论文,希望以科学研究为导向来解释这些结果。

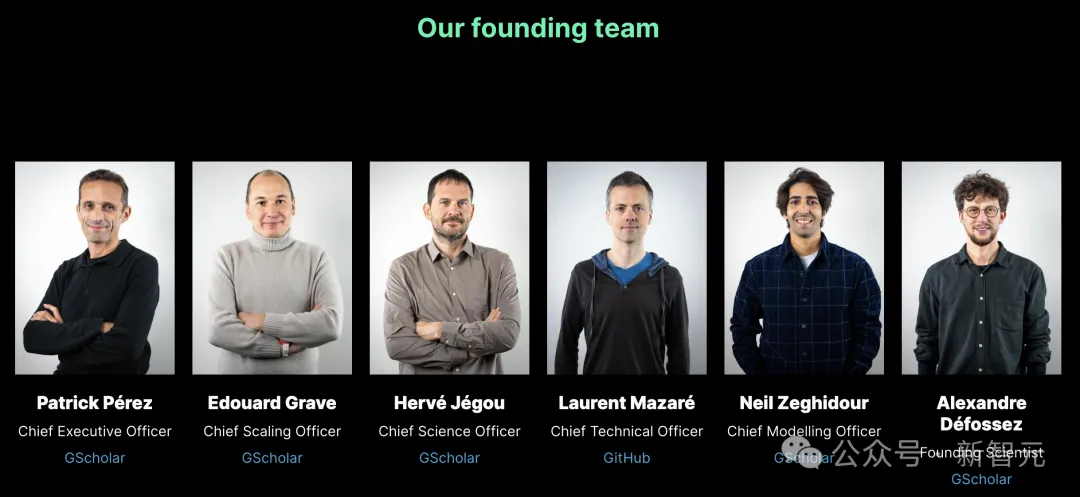

kyutai的创始成员共有6人,其中我们还能发现很多有AI特色的职衔,比如「首席扩展官」(Chief Scaling Office)和「首席模型官」(Chief Modelling Officer)。

这6位创始人有一个共同特点——都有杰出的学术背景,都曾在苹果、微软、Meta(Fackbook)、谷歌DeepMind等科技巨头的实验室从事研发工作。

CEO Patrick Pérez本科毕业于巴黎中央理工学院应用数学专业,博士毕业于法国国家信息与自动化研究所(Inria),曾在布朗大学、微软研究院、Technicolor、法雷奥等多个公私机构从事研究。

「首席扩展官」Edouard Grave博士毕业于巴黎第六大学,在UC伯克利和哥伦比亚大学有过两段博士后经历,并在苹果MLR和FAIR供职8年。在FAIR期间,他还共同领导了Llama和fastText库的开发。

CSO Hervé Jégou也曾在Inria担任研究科学家。FAIR在2015年成立巴黎实验室时,他就以经理的身份加入,后升任总监。流行的矢量搜索库Faiss就是他在FAIR工作期间创建的。

CTO Laurent Mazaré获得密码学和形式方法交叉领域的博士学位后曾进入金融领域,在高盛担任量化策略师。2017年,他加入DeepMind计算机视觉研究组担任研究工程师。

「首席模型官」Neil Zeghidour博士毕业于巴黎高等师范学院,曾在FAIR和DeepMind任职,并创建了DeepMind首个致力于音频生成的团队。除了研究工作,他还在巴黎高等师范学院教授语音处理技术。

科学家Alexandre Défossez在Inria和FAIR的合作项目中获得博士学位,并在毕业后加入FAIR从事音频建模工作,领导开发了开源的音频生成框架AudioCraft。

除了kyutai自己的研究团队之外,他们还组建了一个外部的「明星顾问」团队。

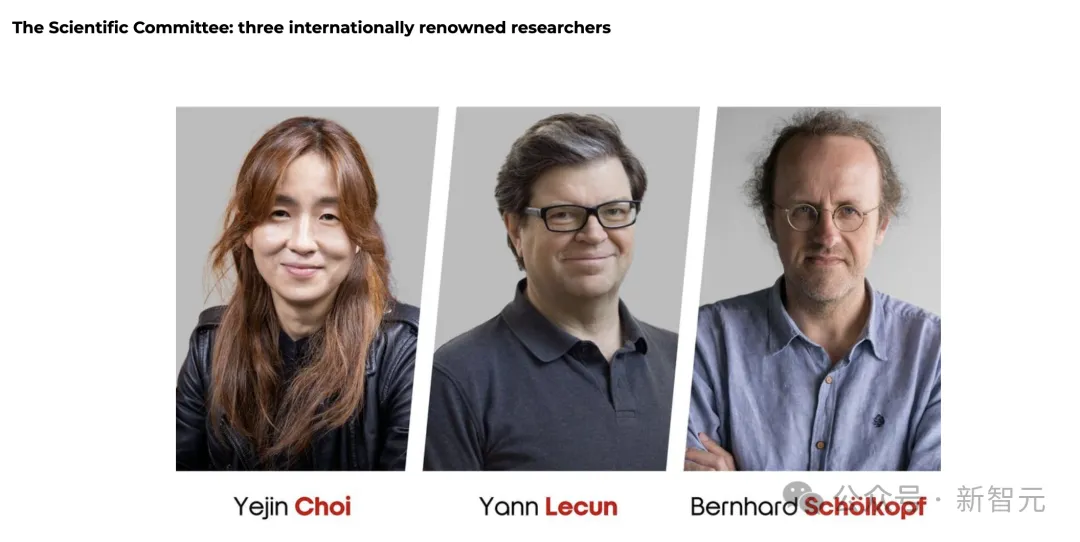

顾问团的成员包括Yann LeCun、马克斯·普朗克智能系统研究所所长Bernhard Schölkopf和华盛顿大学教授Yejin Choi,负责每年对所有人的工作进行1~2次检查并提供反馈。

资金方面,kyutai主要由私人资助和捐助支持,隶属于云计算公司Scaleway,这也是法国电信巨头Iliad集团的子公司。

去年11月,Iliad的CEOXavier Niel在公开会议上透露,已经为kyutai筹集了3亿欧元的资金,包括他自己私人投入的1亿和另一位法国富豪、航运和物流巨头达飞海运CEO Rodolphe Saadé的1亿欧元。

至于AI初创公司的老大难问题——算力,kyutai使用的是Scaleway建造的Nabu 2023。

这台超算搭载了1016个英伟达H100 GPU以及共112个内核的英特尔Xeon Platinum 8480C处理器,在FP8精度下最高计算速度可达到4021.3 PFLOPS。

参考资料:

https://x.com/_philschmid/status/1808491737624592563

https://x.com/honualx/status/1808595796893298951

https://x.com/ylecun/status/1808573335439298629

文章来自于微信公众号“新智元”,作者 “桃子,乔杨”

【免费】ffa.chat是一个完全免费的GPT-4o镜像站点,无需魔法付费,即可无限制使用GPT-4o等多个海外模型产品。

在线使用:https://ffa.chat/

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner

【开源免费】VideoChat是一个开源数字人实时对话,该项目支持支持语音输入和实时对话,数字人形象可自定义等功能,首次对话延迟低至3s。

项目地址:https://github.com/Henry-23/VideoChat

在线体验:https://www.modelscope.cn/studios/AI-ModelScope/video_chat

【开源免费】Streamer-Sales 销冠是一个AI直播卖货大模型。该模型具备AI生成直播文案,生成数字人形象进行直播,并通过RAG技术对现有数据进行寻找后实时回答用户问题等AI直播卖货的所有功能。

项目地址:https://github.com/PeterH0323/Streamer-Sales