Llama 3.1开源的同一天,OpenAI也open了一回。

GPT-4o mini可以免费微调了,每天畅用200万训练token,限时2个月(截止9月23日)。

收到邮件的开发者们激动地奔走相告,这么大的羊毛一定要赶快薅。

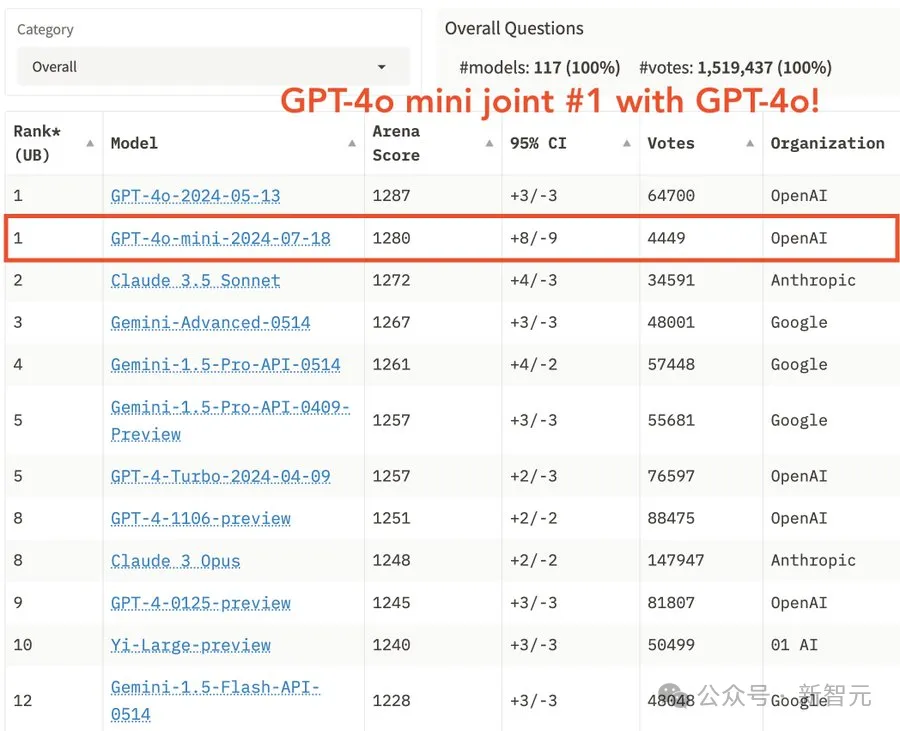

另一边,GPT-4o mini在大模型竞技场LMSYS排名也出来了。

总榜单中,GPT-4o mini与GPT-4o并列第一。

Altman本尊激动地表示,我从未对任何一次评估如此兴奋过,GPT-4o mini与GPT-4o性能如此接近,而价格仅有其1/20!

同时,他表示,GPT-4o mini的微调现在上线了。

OpenAI能把如此强大的模型,放出来让大家免费用,实在是出人意料。

网友一度以为,这可能是最高级的钓鱼邮件。

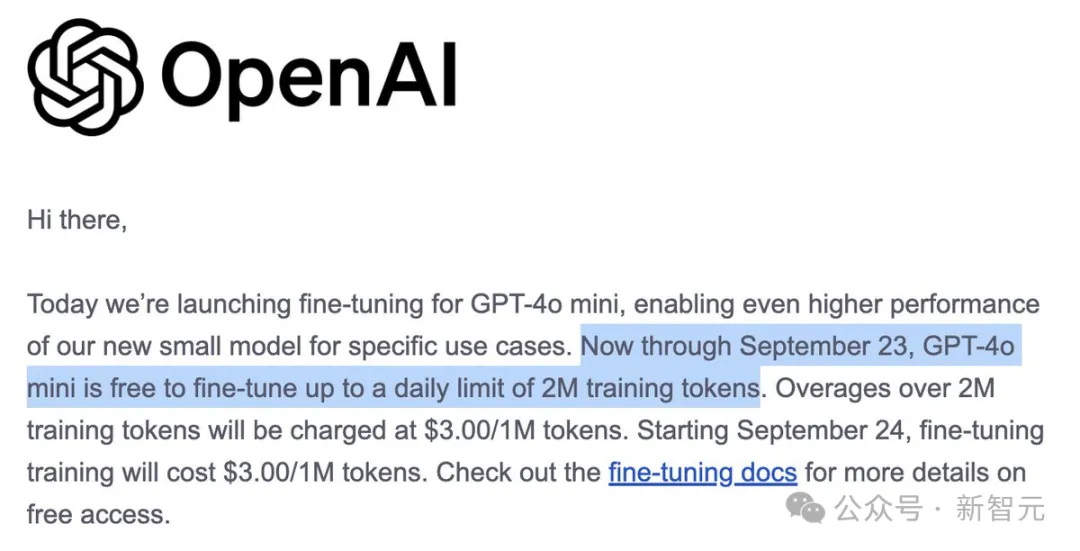

邮件中,OpenAI宣布现正式推出GPT-4o mini微调功能,为的是让最新小模型在特定用例上,表现更加出色。

7月23日-9月23日期间,开发者们每天可以免费使用200万训练token。

超过的部分,将会按3美元百万token收费。

到了2个月免费使用截止后,微调训练也将按照3美元百万token收费。

此外,OpenAI在邮件中给出了,每个人值得从GPT-3.5 Turbo切换到GPT-4o mini的原因:

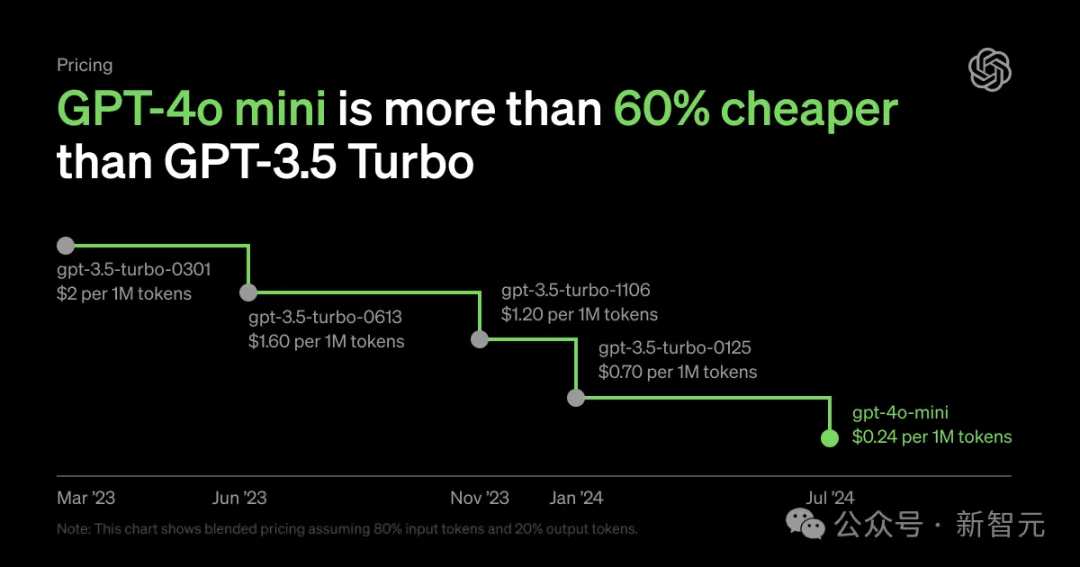

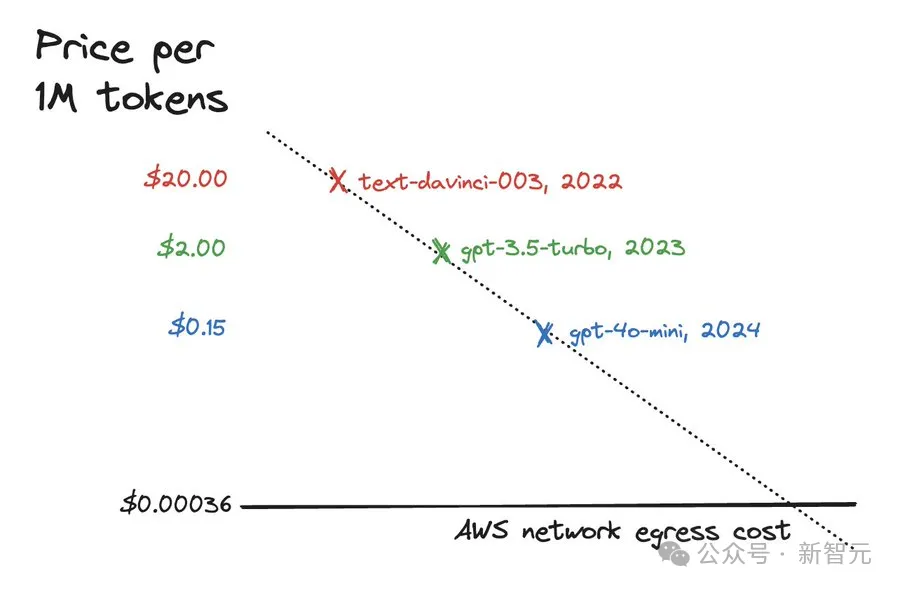

- 更实惠:GPT-4o mini的输入Token费用比GPT-3.5 Turbo低90%,输出Tokens费用低80%。即使在免费期结束后,GPT-4o mini的训练成本也比GPT-3.5 Turbo低一半。

- 更长的上下文:GPT-4o mini的训练上下文长度为65k Token,是GPT-3.5 Turbo的4倍,推理上下文长度为128k Token,是GPT-3.5 Turbo的8倍。

- 更聪明且更有能力:GPT-4o mini比GPT-3.5 Turbo更聪明,并且支持视觉功能(尽管目前微调仅限于文本)。

最后,邮件中还提到,GPT-4o mini微调功能将向企业客户,以及Tier 4和Tier 5开发者开放,未来将逐渐扩大访问权限,扩展至所有级别的用户。

想要动手操作的小伙伴们,OpenAI已经放出了微调指南,可参见:

https://platform.openai.com/docs/guides/fine-tuning/fine-tuning-examples

一部分网友对此并不看好,他们正在保存我们的数据,来训练和改进AI模型。

「又名,把你的私人数据给我,我会收你很少的钱」。

拿到资格的网友,已经迫不及待上手测试了。

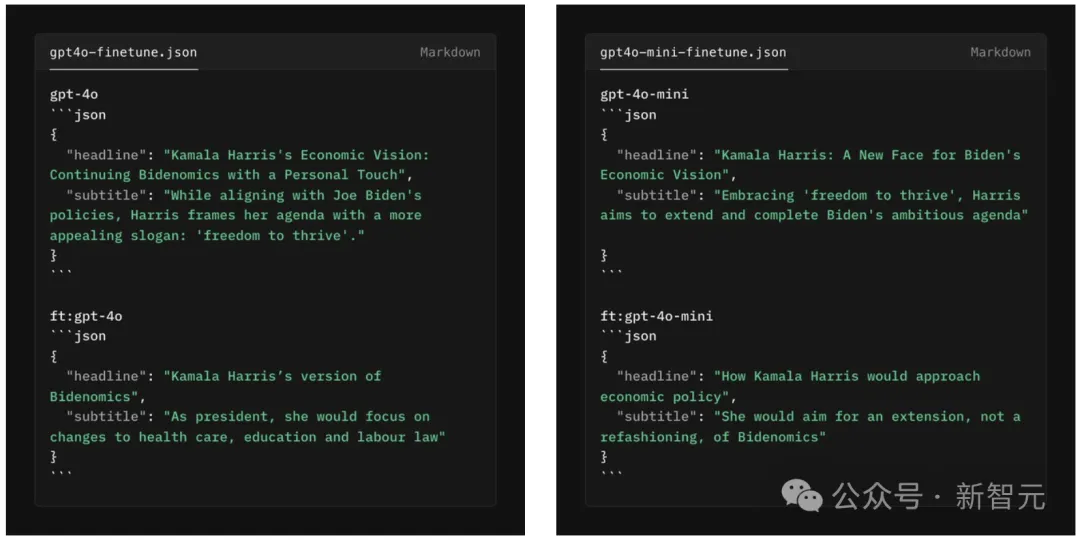

开发者使用《经济学人》风格的头条数据集,对gpt-4o mini进行了微调。

然后,他比较了gpt-4o、gpt-4o min原始模型和微调后的模型在生成头条方面的表现。

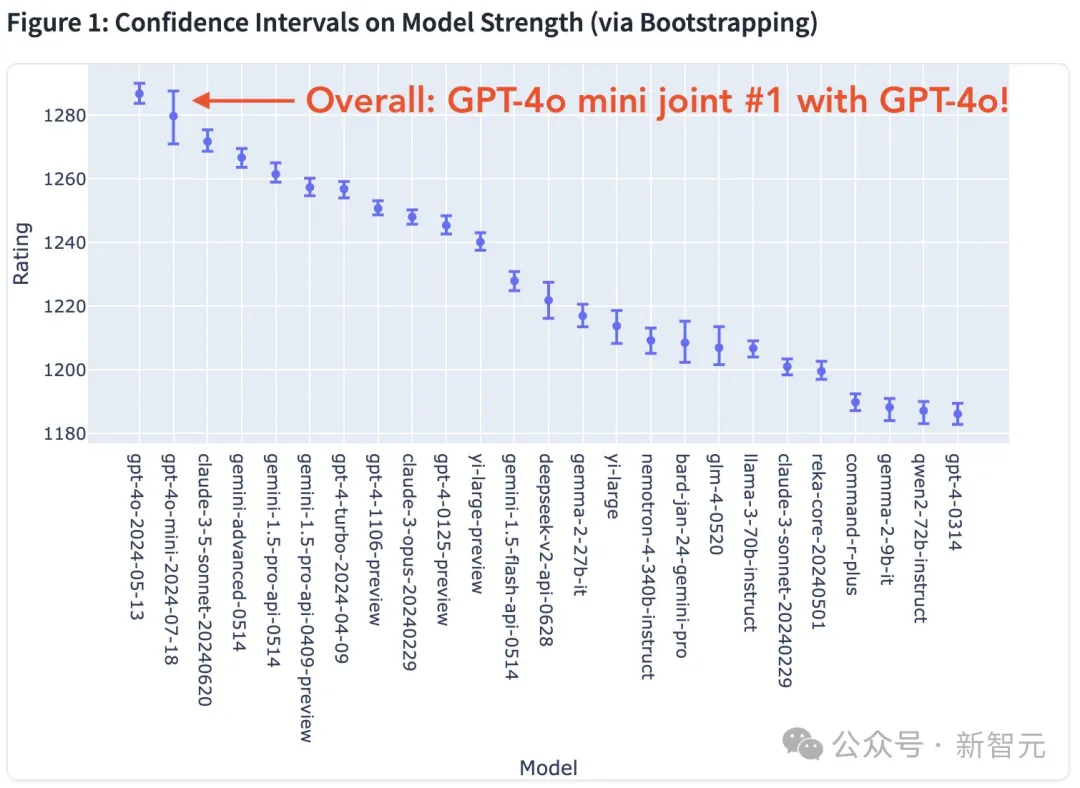

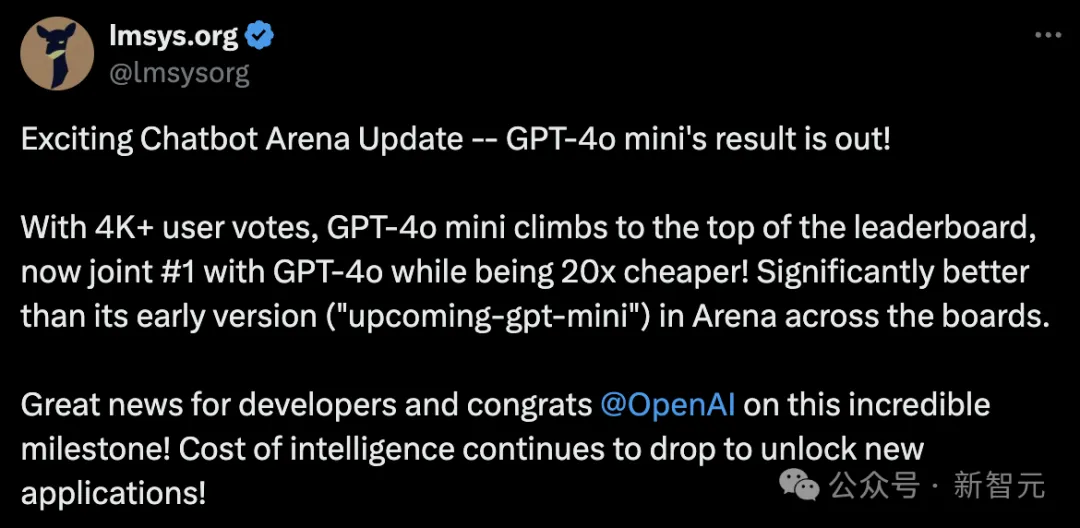

GPT-4o mini发布一周后,在大模型排行榜中的成绩终于出来了。

共收到了4K+用户投票,GPT-4o mini小模型直接攀升至榜首,与GPT-4o并列第一。

最最重要的是,便宜20倍!

这对于众多开发者来说,是个好消息,能够以更低的成本,搭建更强大的应用。

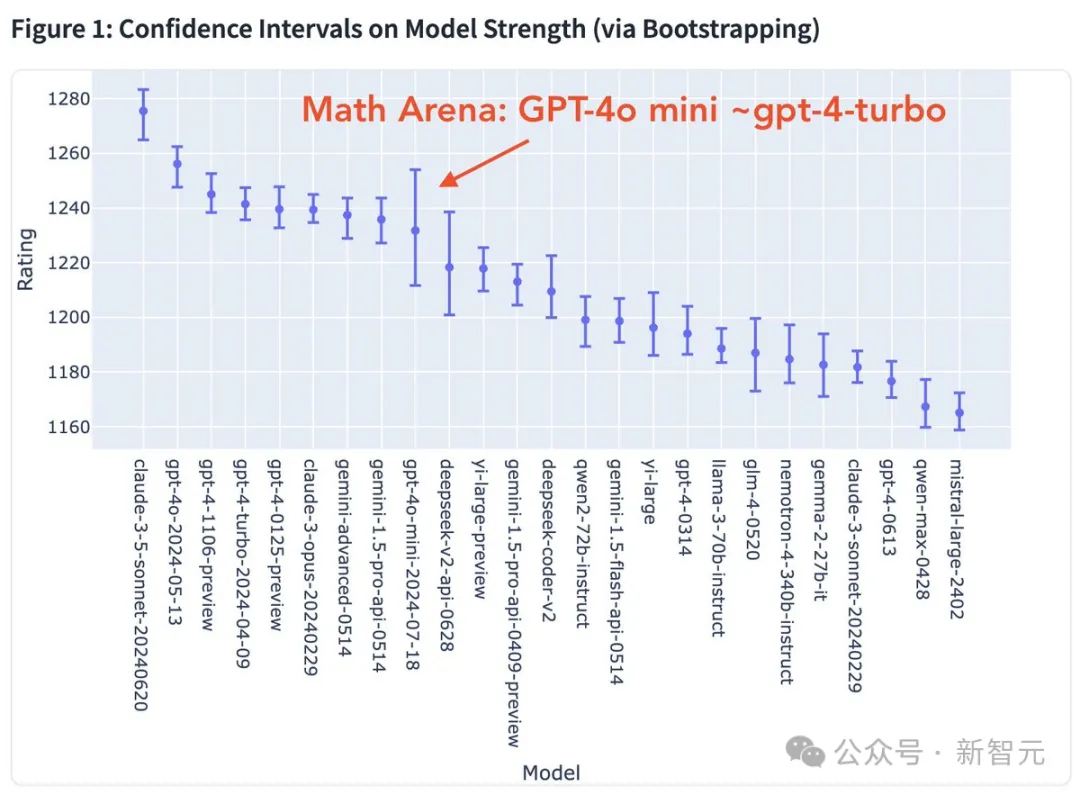

在数学细分领域中,GPT-4o mini的性能有所下降,排在第9。

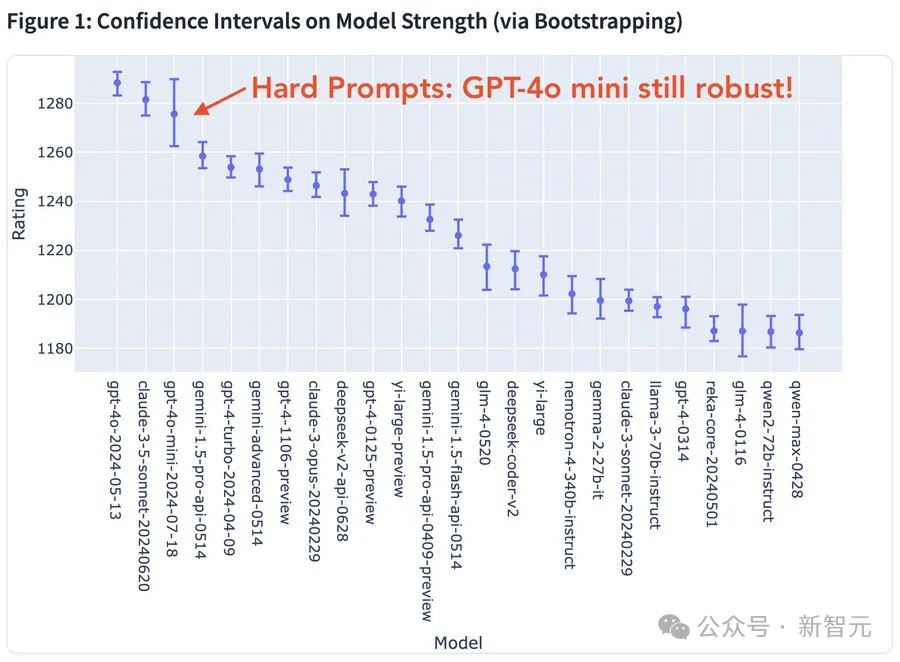

此外,在hard prompt评测中,GPT-4o mini依旧保持了稳健的性能,实力仅次于GPT-4o、Claude 3.5 Sonnet。

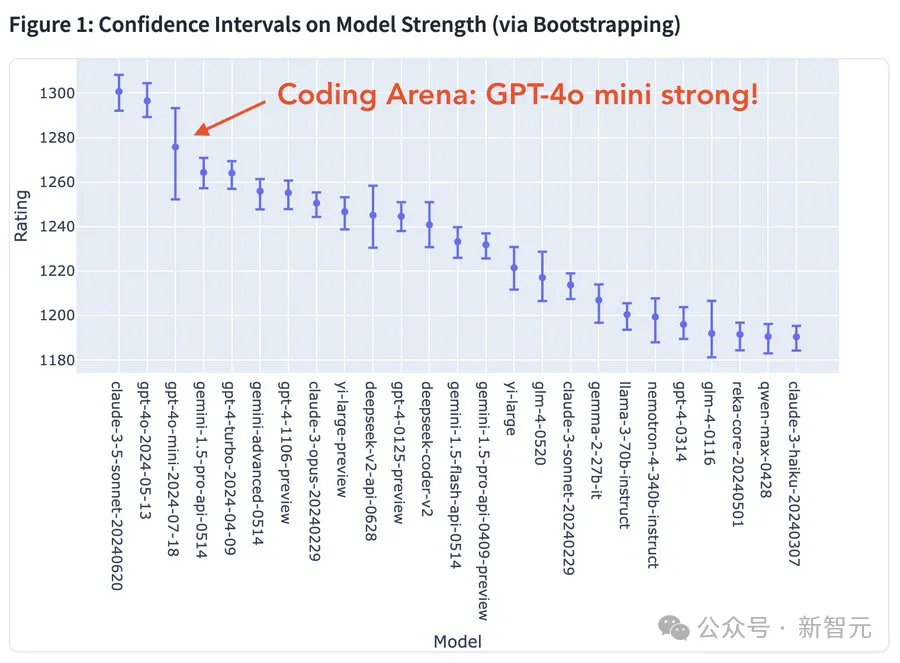

在编码领域,GPT-4o mini同样展现出强大的能力。

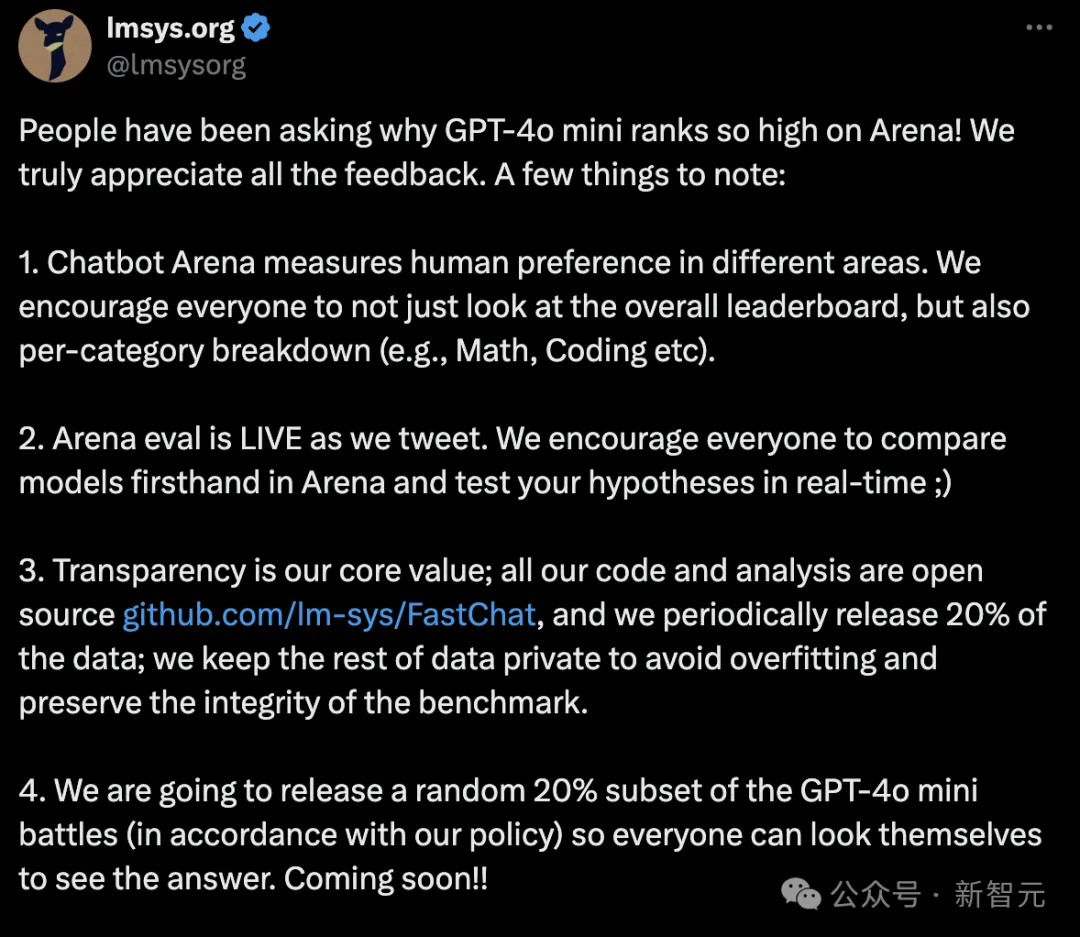

关于GPT-4o mini在Arena中排名如此高的原因,很多人提出了疑问。

官方对此解释是:

- Chatbot Arena根据不同领域的人类偏好进行评估。鼓励大家不仅关注总排行榜,还要查看各个类别的排名(如数学、编码等)。

- Arena评估是实时进行的。鼓励大家在Arena中亲自对比模型,实时验证自己的假设。

- 透明性是我们的核心价值;所有代码和分析都是开源的(http://github.com/lm-sys/FastChat)。我们定期发布20%的数据,保留其余数据以避免过拟合,维护基准测试的完整性。

- 我们将根据政策发布随机的20% GPT-4o mini对战数据,大家可以亲自查看答案。

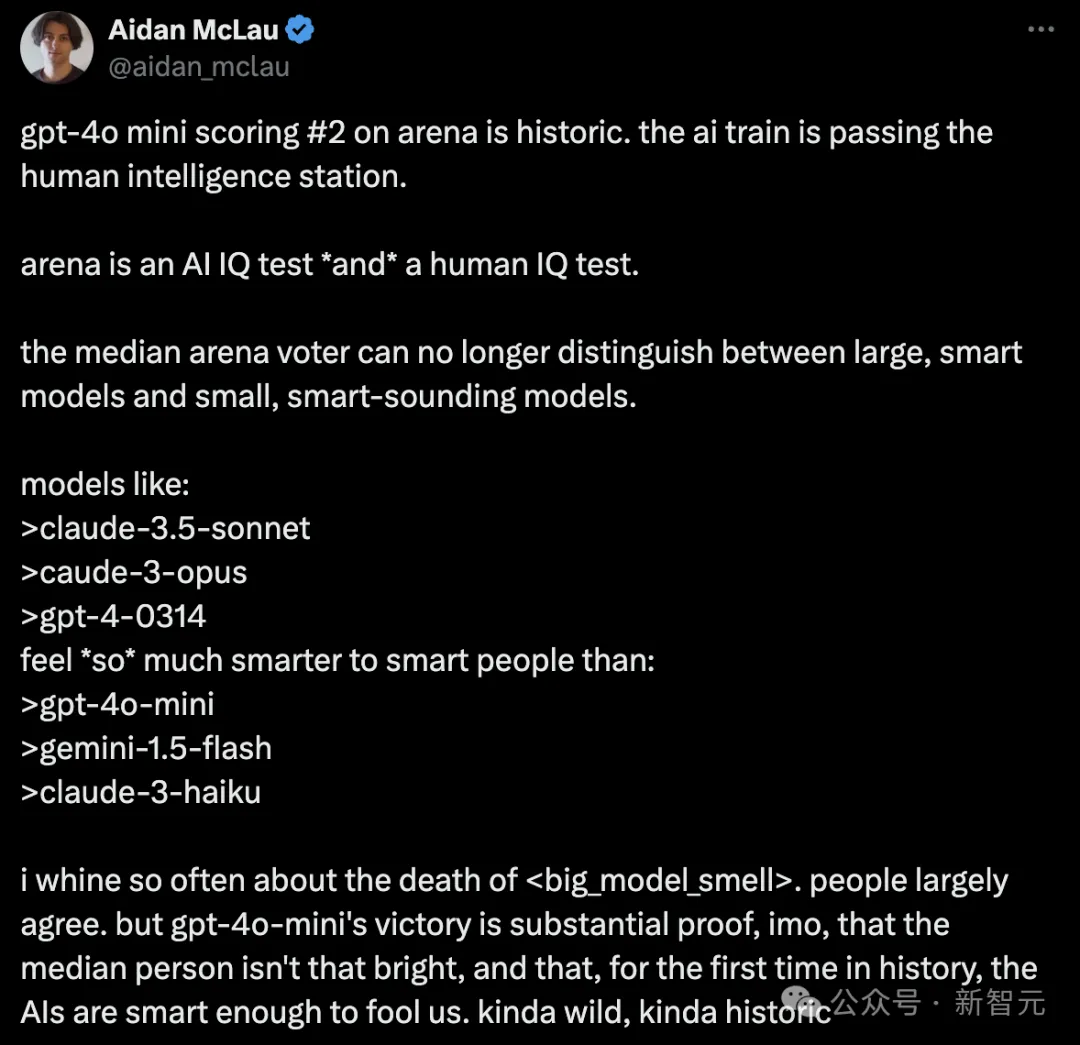

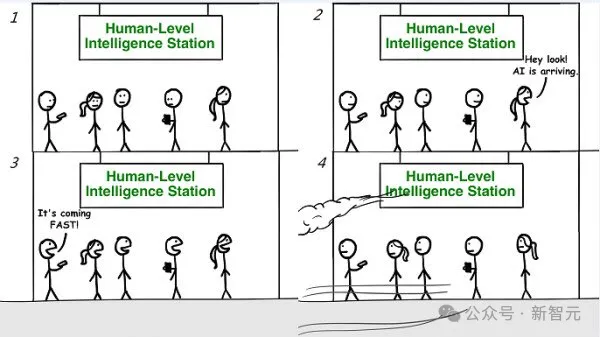

不过,另有网友认为,gpt-4o-mini的胜利是一个实质性的证据,证明了普通人并不那么聪明。

而且,这是历史上首次,AI变得足够聪明可以愚弄我们。有点疯狂,也有点具有历史意义。

参考资料:

https://x.com/moyix/status/1815840634013639086

https://x.com/HamelHusain/status/1815848198927434019

https://x.com/sama/status/1815877987696533897

https://x.com/0xSMW/status/1815869241205350641

文章来自于微信公众号“新智元”,作者 “桃子”

【免费】ffa.chat是一个完全免费的GPT-4o镜像站点,无需魔法付费,即可无限制使用GPT-4o等多个海外模型产品。

在线使用:https://ffa.chat/

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0