AI真的已经危险到要如此监管的地步了吗?

在创新的热土硅谷,李飞飞、吴恩达等 AI 科学家正在与监管部门展开一场关于安全与创新的拉锯战。

这场拉锯战的核心是一个名叫 SB-1047 的法案。该法案的全称是「Safe and Secure Innovation for Frontier Artificial Intelligence Act(《前沿人工智能模型安全创新法案》)」,试图为高风险的 AI 模型建立明确的安全标准,以防止其被滥用或引发灾难性后果。

该法案于今年 2 月份在参议院被提出,随后引起了很大的争议。很多科学家认为,法案的条款过于不合理,将对科技创新造成毁灭性的影响。

法案链接:https://leginfo.legislature.ca.gov/faces/billTextClient.xhtml?bill_id=202320240SB1047

具体来说,该法案旨在从模型层面对人工智能进行监管,适用于在特定计算和成本阈值之上训练的模型。

模型覆盖范围如下:

1、使用超过 10^26 次整数或浮点运算的计算能力进行训练的人工智能模型,其成本超过一亿美元(100,000,000 美元),该成本是根据开发者合理评估的训练开始时云计算的平均市场价格计算得出的。

2、利用等于或大于 10^25 次整数或浮点运算三倍的计算能力,对范围内的模型进行微调而创建的人工智能模型。

这一范围基本覆盖了现在市面上所有主流的大型模型。如果法案通过,这些模型都将被定义为存在「潜在危险」或需要额外监督。

法案还要求模型开发者对其模型的下游使用或修改承担法律责任。在训练开始之前,开发人员需要证明他们的模型不会启用或提供「危险功能」,并实施一系列保护措施来防止此类使用。这将阻碍开源社区的发展。

监督新法律执行的将是一个「前沿模型部门(frontier model division)」,这是一个新成立的监督和监管机构。该机构将制定安全标准并就人工智能法律提供建议,向该机构歪曲模型的功能可能会使开发人员因伪证而入狱。

法案中还加入了吹哨人保护条款,保护和鼓励 AI 开发实体内部的举报者,确保员工可以在不受报复的情况下报告企业的不合规情况。

如果法案获得通过,州长 Gavin Newsom 的一个签名就可以将其纳入加州法律。a16z 普通合伙人 Anjney Midha 表示,如果这项法案在加州获得通过,将为其他州树立先例,并在美国国内外产生连锁反应 —— 本质上对创新状况带来巨大的蝴蝶效应。

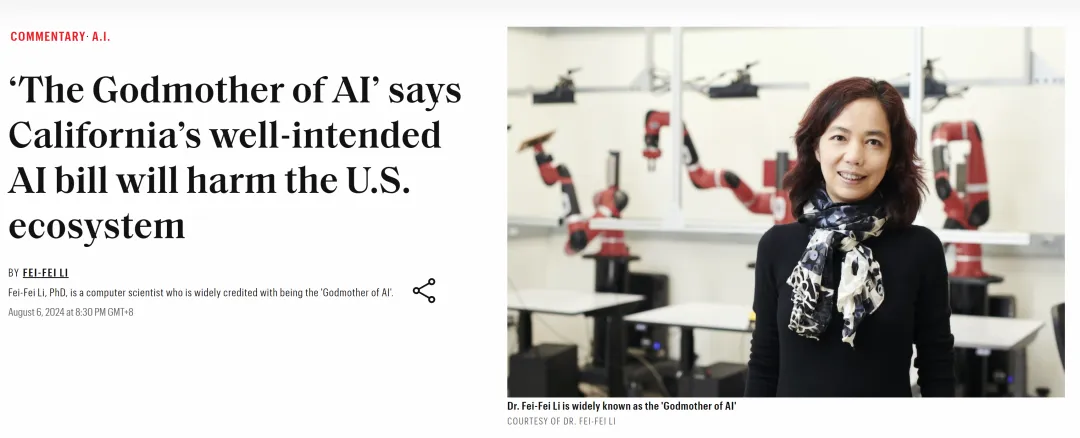

在太平洋夏令时间 8 月 7 日早晨,相关部门将举行关于该法案的听证会。留给科学家们的抗议时间已经不多了。因此,李飞飞亲自撰文,陈明法案利害。还有些科学家正在签署一封联名信,以阻止法案通过。

李飞飞的文章发表在《财富》(Fortune)网站上。

李飞飞撰文抨击 SB-1047

李飞飞在文章中表示:「加州的 SB-1047 将产生重大而意想不到的后果。如果通过成为法律,SB-1047 将损害正在萌芽的人工智能生态系统。SB-1047 将不必要地惩罚开发人员,扼杀开源社区,并阻碍人工智能学术研究,同时无法解决其旨在解决的真正问题。」

她写道:

首先,SB-1047 将过度惩罚开发者并扼杀创新。如果人工智能模型被滥用,SB-1047 要求责任方和该模型的原始开发者承担责任。每个人工智能开发人员(尤其是崭露头角的程序员和企业家)不可能预测到其模型的每种可能用途。SB-1047 将迫使开发人员退步并采取防御行动 —— 这正是我们试图避免的。

其次,SB-1047 将束缚开源开发。SB-1047 要求所有超过特定阈值的模型都包含「终止开关」,这是一种可以随时关闭程序的机制。如果开发人员担心他们下载和构建的程序会被删除,他们在编写代码和协作方面就会更加犹豫。这个终止开关将摧毁开源社区,这是无数创新的源泉。其影响不限于人工智能领域,而是在从 GPS 到 MRI 到互联网本身的各个领域。

第三,SB-1047 将削弱公共部门和学术人工智能研究。开源开发对于私营部门很重要,但对于学术界也至关重要。如果没有协作和对模型数据的访问,学术界就无法进步。如果我们的机构无法获得适当的模型和数据,我们将如何培训下一代人工智能领导者?终止开关甚至会进一步削弱学生和研究人员的努力,与大型科技公司相比,他们在数据和计算方面已经处于劣势。当我们应该加倍加大公共部门人工智能投资时,SB-1047 将为学术人工智能敲响丧钟。

最令人担忧的是,该法案并未解决人工智能进步的潜在危害,包括偏见和深度伪造(deepfake)等等。相反,SB-1047 设置了一个任意阈值,调节使用一定计算能力或花费 1 亿美元训练的模型。这项措施远非提供保障,只会限制包括学术界在内的跨部门创新。如今,学术人工智能模型低于这一门槛,但如果我们要重新平衡私营和公共部门人工智能的投资,学术界将受到 SB-1047 的监管。我们的人工智能生态系统将会因此而变得更糟。

SB-1047 的限制过于武断,我们必须采取相反的做法。

我并不反对人工智能治理。立法对于人工智能的安全有效发展至关重要。但人工智能政策必须赋能开源开发,提出统一且合理的规则,并建立消费者信心。SB-1047 未达到这些标准。

数十位科学家联名反对

针对 SB-1047,除了李飞飞,由加州大学 7 个校区的师生以及来自其他 20 多个机构的研究人员组成的团体也在积极行动。他们共同起草并签署了一封反对 SB-1047 的公开信,从研究者的角度出发,陈述该法案对加州人工智能研究和教育目标的损害。

联名信从以下几方面展开论述 SB-1047 的不合理性:

1、法案会给开源模型的发布带来「寒蝉效应」,从而损害研究

法案中要求对「前沿模型」进行「安全审核」和具备「完全关闭」能力,可能会严重阻碍开源和开放权重模型的发布。这些严格的规定对于私有实体控制的专有模型来说可能更易于实现,而对于非营利组织或大学联盟使用的开放模型则较为困难。法案中关于安全展示和审核的条款表述不够具体,依赖于可能尚未存在且可能缺乏科学严谨性的测试。这种审计的潜在成本对于有盈利产品的商业实体来说可能容易承担,但对于像 Meta 的 LLaMA 系列这样的商业实体的科学性开放发布,或是由非营利组织或大学联盟训练的开放模型,情况可能并非如此。

由于这些繁琐的限制,开源模型的开发者可能选择在加州或美国之外构建系统,并在避免责任的前提下发布其模型。在这种情况下,不顾合规的私人行为者可能会秘密使用这些模型,而受到公共工作性质约束的学术研究人员将被排除在外,这促使他们更改研究主题或转移到不侵犯其学术自由的司法管辖区。开源模型的可获取性对于现代学术 AI 研究至关重要,因为它们使学术界能够探索模型的工作原理、训练过程中的能力提升以及如何进行改进和破解。

2、人工智能风险预测与「能力」评估存在不科学性

作为人工智能、机器学习和自然语言处理领域的专家,这些研究者强调:SB-1047 中提到的评估模型风险的建议方法非常值得怀疑。科学界就语言模型或其他前沿人工智能系统是否以及如何对公众构成威胁尚未达成共识。

3、对开源模型的保护不足

尽管法案提到未来可能对开源模型提供特例,但由于参数数量的快速增长和计算成本的降低,现有的保护措施可能难以持续。在没有强有力的保护措施的情况下,这些模型面临的后果可能很快就会显现。此外,性能相当的小型模型相比大型模型需要更高的计算成本。因此,法案中的修正案预计无法缓解对开源模型发布的负面影响,而严格的报告和审核要求还将不必要地影响研究活动。

4、对学生的就业安置和职业成果的担忧

SB-1047 未来可能会阻碍对人工智能感兴趣的学生进一步学习相关知识,甚至可能会阻止新人才进入计算机科学等关键领域。此外,随着科技行业从大公司向初创公司的转变,额外的监管障碍可能会通过支持更大、更好的企业来削弱新兴创新者。这种转变可能会缩窄学生的职业道路。

联名信部分学者签名。

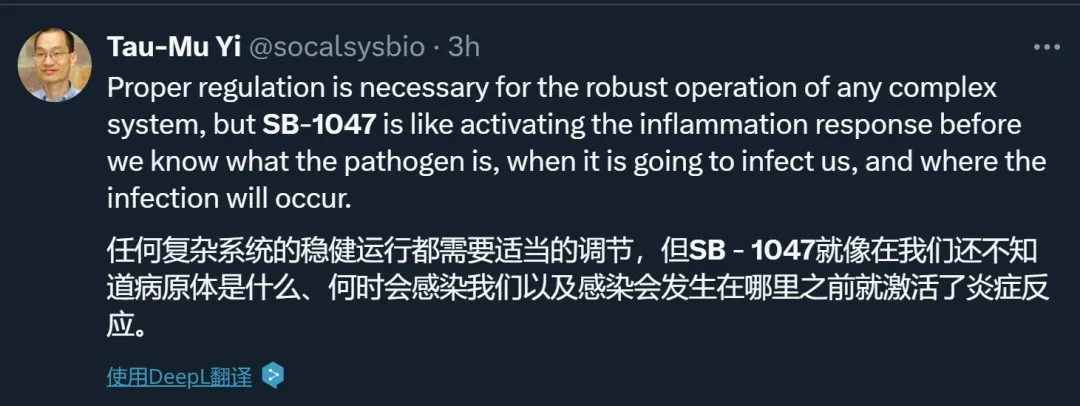

除了公开信,还有一些研究者选择在社交媒体发声。其中,一位系统生物学家指出,SB-1047 就像在我们还不知道病原体是什么、何时会感染我们以及感染会发生在哪里之前就激活了炎症反应。

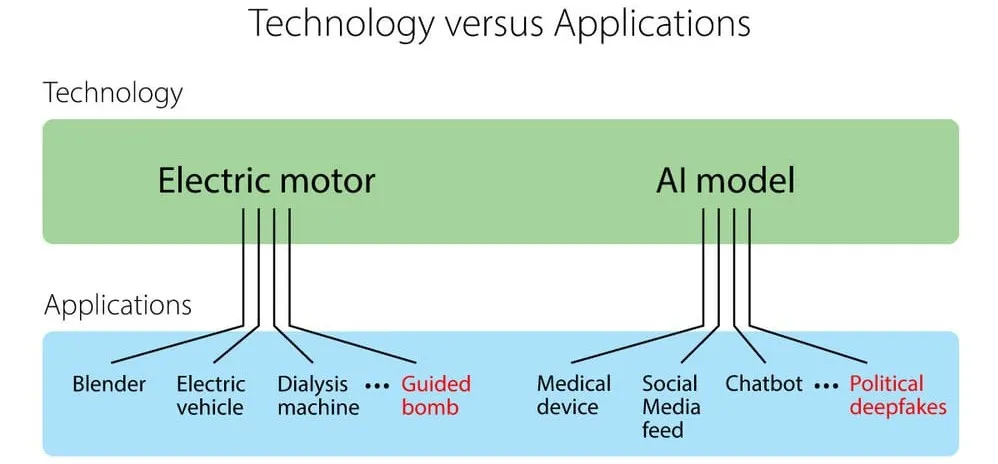

此前,吴恩达也多次就此事发声。他认为,监管机构应该监管应用而不是技术。例如,电动机就是一项技术。当我们将其放入搅拌机、电动汽车、透析机或制导炸弹中时,它就成为了一种应用。想象一下,如果法律规定,当任何人以有害的方式使用电机时,电机制造商都要承担责任。那电机制造商要么停产,要么将电机制造得非常小,以至于对大多数应用来说毫无用处。如果我们通过这样的法律,可能会阻止人们制造炸弹,但我们也会失去搅拌机、电动汽车和透析机。相反,如果我们关注特定的应用,就可以更合理地评估风险并判断如何确保它们的安全,甚至禁止某些类型的应用。

AI 真的已经危险到要如此监管的地步了吗?对此,你怎么看?

文章来源于“机器之心”