一年多前,伍华在韩国旅游,回国不到三天,朋友发给她一张截图,是一个和她的头像、网名几乎一样的账号。不同的地方是,账号里的文字被替换成韩语,个人简介里,还出现了一个陌生网址。

令伍华震惊的是,点开高仿账户里的网址,会导向一个色情频道,污秽不堪的付费视频陈列其中——主角,全都被AI换成了她的脸。

直到8月末,关注到韩国Deepfake事件时,她“被一阵巨大的后怕席卷。”伍华告诉《智能涌现》:“太恶心、太难受了。”

回想起点开这些AI视频的的第一感受,伍华依旧语带哽咽。尽管高仿账号已经被她举报删除,但她不确定自己的脸,还有没有被用在其他地方。

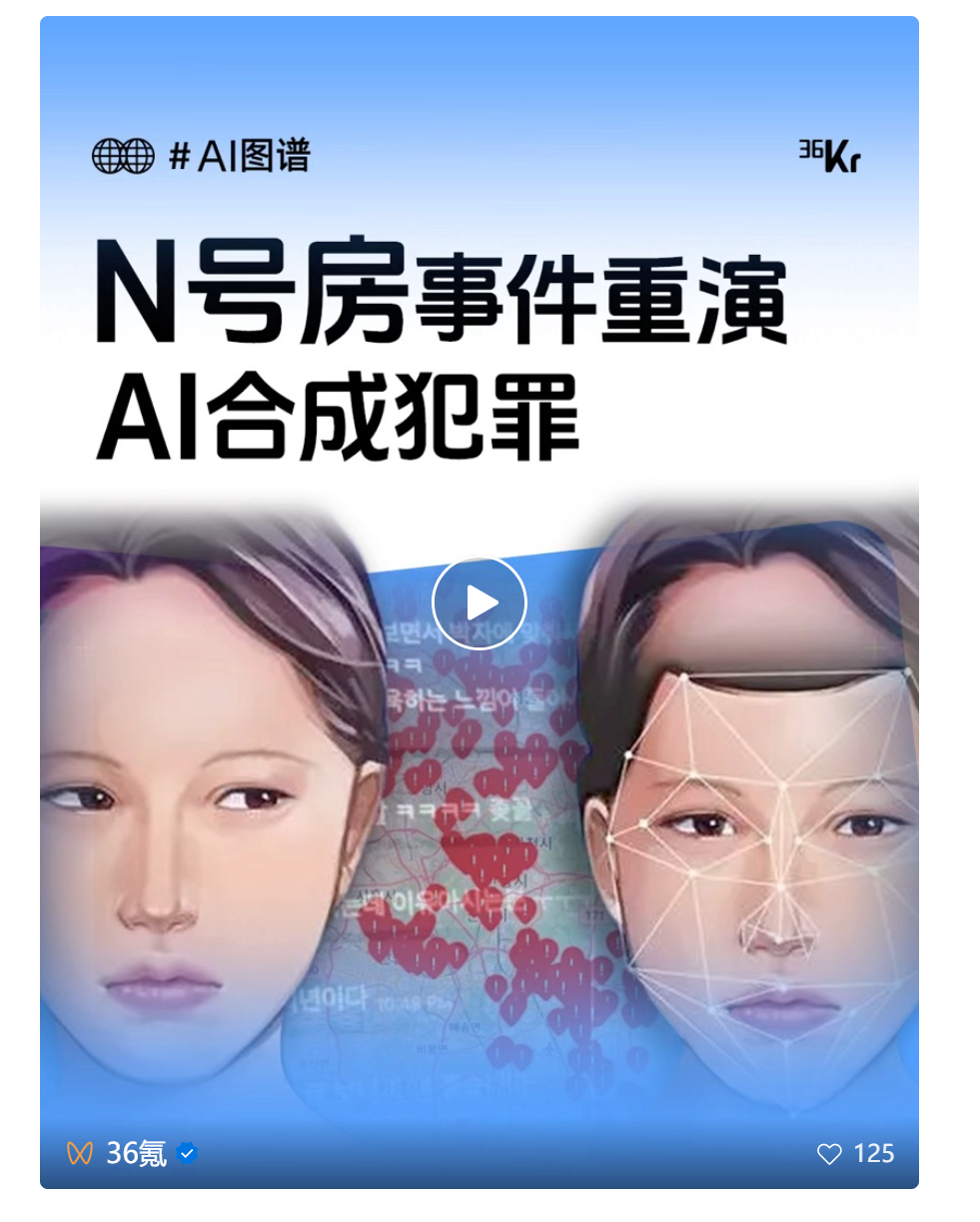

Deepfake(专指基于AI的人体图像合成技术)技术催生出的“N号房2.0事件”,正在让隔海相邻的韩国陷入巨大漩涡。不计其数的女性,成为了男性用AI捕获的“猎物”。

仁荷大学的一位男学生,组建起了一个超过1200成员的聊天室。他们利用Deepfake技术,将学校中的女生的脸庞,安放到到各种黄色影像上,群聊中还公开分享她们的联系方式。

从仁荷大学开始,一场巨大的合谋被迅速揭开,Deepfake也因此被称为“N号房2.0事件”。从8月20日开始,韩国媒体、警方陆续揪出了大量与学校、医院、军队体系中的类似聊天室。

22万,这是韩国披露的人数最多的Deepfake聊天室成员人数。而韩国范围内,几乎每一个中学、大学都有这样的“凌辱房”。

在群聊中,男性以自己生活中熟识的女性为羞辱对象,将女性的照片传送到凌辱房内,用各种Deepfake工具,将女性的脸换到各种淫秽不堪的图像、视频中。而后,群内的男性会开始共同进行言语羞辱,甚至发展到线下威胁、骚扰。

规模较大的羞辱房,甚至还会细分成不同的小房间,比如家属羞辱房。男性甚至偷拍自己的妈妈、姐姐、妹妹的照片传到群聊中。

△聊天室中,有男性将亲妹妹的照片上传其中(照片已被红色马赛克遮挡),配文为翻译成中文的聊天记录。

2019年,震惊全球的N号房事件发生时,就有网友语带讽刺:“全韩国的出租车总数只有26万台,这意味着,你在街上碰见N号房会员的概率,和碰见出租车一样。”

这句话,不仅能用在今日的Deepfake聊天室上,真实的情况更加触目惊心。

N号房1.0基本以真实的盗摄内容为主,这意味着犯罪者还需要自行拍摄,获取素材。但Deepfake技术越来越成熟后,Deepfake房的犯罪成本降至极低——AI生成的图像、视频,内容逼真到让人恍惚。

今年5月,一位40岁的首尔大学毕业生朴某被逮捕,他用48名女性受害者的照片,制作了1852份性剥削内容,受害者都是他在生活中认识的女性。

一位在首尔的老师,发现自己也成为了“熟人凌辱房”的主角,始作俑者是她执教班级的学生,但她无法得知是哪一位。

“那张照片会跟着我一辈子吗?”她崩溃地向媒体诉说。

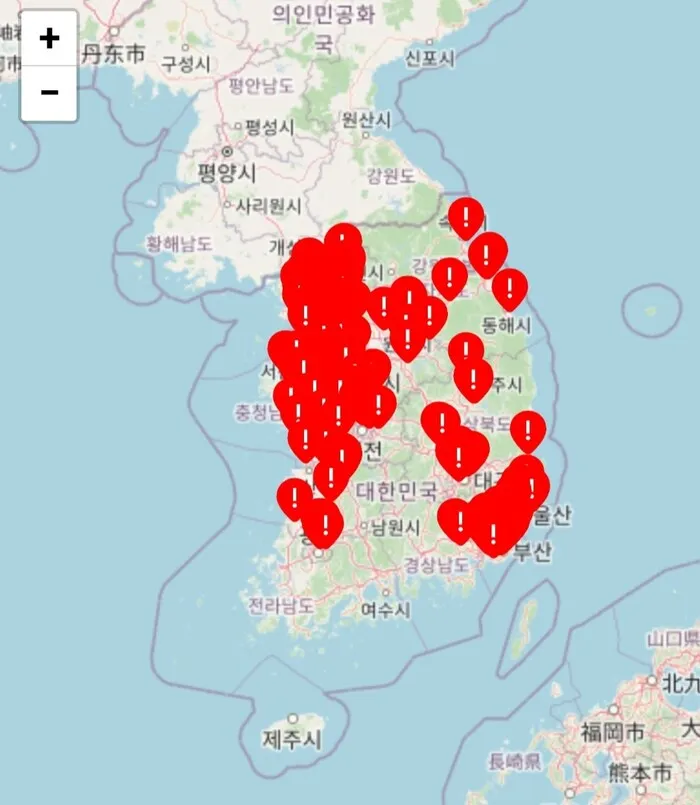

Deepfake事件爆出后,志愿者根据媒体报道、匿名投稿核实,制作了一张涉及Deepfake加害者地图。红色标记密密麻麻,几乎要将韩国中心地带淹没。

△志愿者整理的“加害者学校地图”,红点几乎要将韩国中心地带的地图淹没 来源:https://deepfakemap.kr

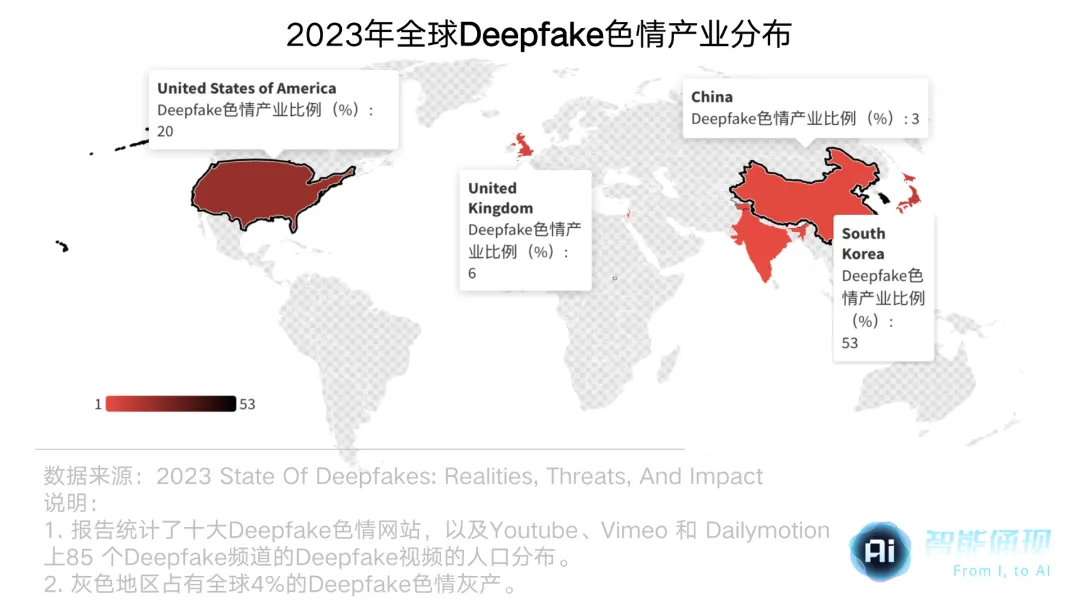

根据网络安全监测机构SecurityHero的统计,2023年韩国的Deepfake色性产业,就占到了全球的53%——与之相对的,韩国2023年的GDP,还不到全球的2%。

△2023年全球Deepfake色情产业分布 制图:智能涌现

被绝望和愤怒冲击的韩国女性,不得不在压抑的舆论中四处奔走。

“我的生活不是你的色情片!”“女性没有国家!”她们愤怒地在社交媒体高呼。

没人知道确切的女性受害者数字是多少。大学生智英每日灌下大杯大杯的咖啡,只为了保持清醒状态。“我害怕错过受害者的任何一条投稿。”

智英不敢停下。自8月下旬开始,她几乎失去了睡眠。

一场围剿战正在进行中。

在推特上,智英与韩国男性不停周旋。她的推特账号早已实时被男性们监控,刚上传的、呼吁大家举报的厌女内容网址,下一分钟网址就被修改了。这意味着,厌女者们一直在盯着智英的推文。

在和我们的交流中,她还尝试使用变声器——所有在推特上为这次事件活跃的女性博主,都是韩男“开盒”(人肉搜索)的头号目标,她无法透露自己的任何信息。

在女性地位低下的韩国社会,女权主义者早已是个危险的标签。韩国最大的女权主义推特Queens Archive就因为最先披露Deepfake聊天室事件,被韩国男性举报至炸号。

“有时候我们根本不洗澡、不睡觉,一直熬到凌晨三四点。”智英对《智能涌现》表示。她和推特上的“战友”,急切地将所有Deepfake相关信息、受害者保护指南、女性主义科普翻译成英语,在推特上不间断传播。

Deepfake事件涉及的加害者、受害者双方,其年龄范围比起N号房1.0都要更小。2024年1月至7月,韩国立案侦查了297起深度伪造性剥削犯罪,共计抓获178名嫌疑人,其中131人是十几岁的青少年,占比73.6%。

不少人将其比作“N号房2.0事件”,但与之相比,现在的舆论热度,根本不能同日而语。在不少女性眼中,韩国政府和警方的态度,可以用“消极”来形容。

用AI制作的性羞辱内容,由于“并不是真实的”,一开始甚至没有进入到警方、政府的视野。

“当年的N号房事件,政府就没有进行正当的处理。所以,现在Deepfake事件中的男性,很多都是未成年,受害者中也有很多是未成年人,加害者更不会觉得有什么后果,也不会坐牢。”智英对《智能涌现》说。

在本次Deepfake事件中,目前韩国警方只逮捕了15个人左右,有的加害者直接跑到海外,以移民的方式逃避刑罚。

极高的未成年加害者比例,又给量刑带来了困难。截至9月6日,韩国警方正在调查的101起关于Deepfake性犯罪的案件中,目前已锁定52名嫌疑人,其中,未成年的比例是可怕的:10~19岁的加害者有39人,占79%。

“Deepfake事件,加上此前的N号房、Soranet等数字性犯罪案例,受害者预计有超过100万人之多,没有人知道确切的数字。“智英感到遗憾,“所以如果我们不尽快向政府施压,政府就不会做任何事情。”

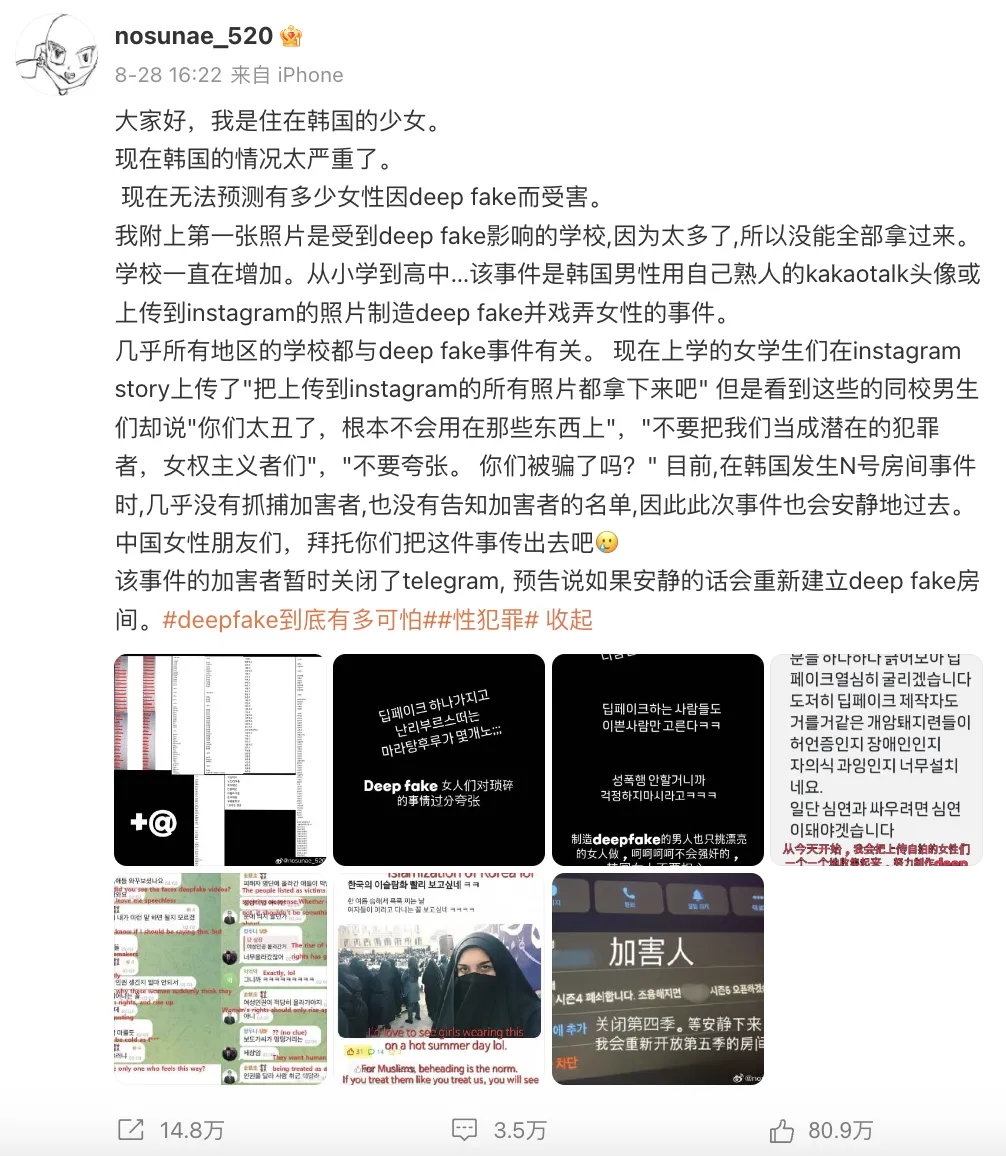

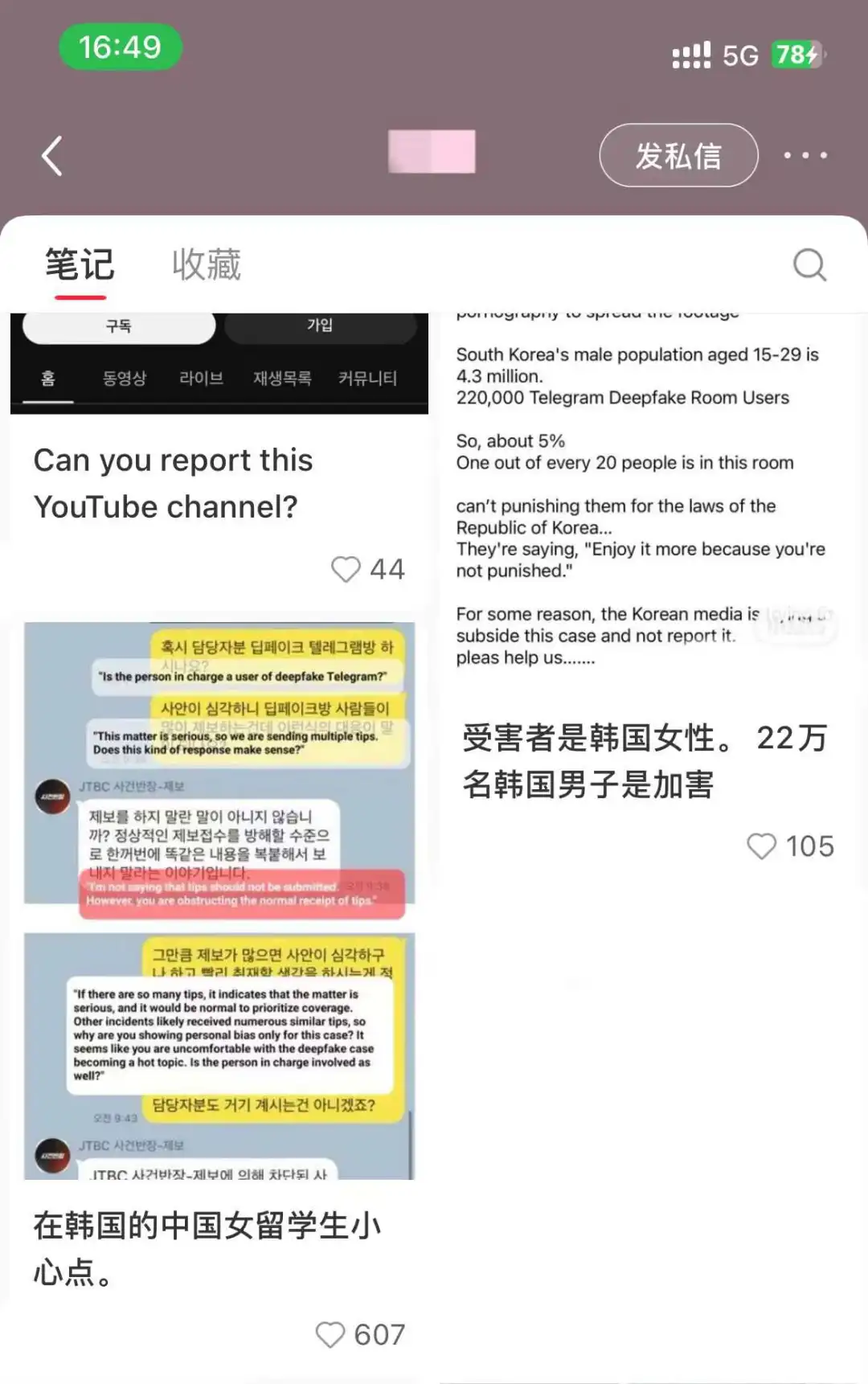

韩国女性开始向外求救,接力将Deepfake事件的内容传播到中国、日本的社交媒体上。

△来源:微博

韩国大学生恩静就跑到小红书上,用机翻的生疏口吻请求关注、扩散,不断被封号、删帖也不曾放弃。而在微博上的韩女呼救微博,在短短两天内就被转近15万次。

△来源:小红书

无人知道这些努力最终能够导向何方。恩静告诉《智能涌现》,她的亲妹妹现在也是一位中学生,学校除了简单嘱咐女生保护自己,再无其他措施——她和妹妹只能将社交平台上所有带脸的照片删除,每日穿长裤出门。

而海外舆论爆发后,韩国政府才终于认真跟进这一事件。近期韩国不同政党最近的公开发言,都离不开Deepfake事件。“事件必须短期内解决。”他们表示。

当一名毫无AI技术基础、留在“墙内”的中国男性,成为Deepfake加害者,前期需要付出怎样的作案成本?

在SecurityHero的报告中,中国的Deepfake色情视频数量,占全球的3%。与韩国(53%)和美国(20%)相比,这是一个并不高的数字。然而,由于报告统计的数据大多来源于海外网站,中国Deepfake色情产业的实际规模,远不止这些。

在海外社交平台X(原为Twitter)上检索“Deepfake”,很快出现一名中国Deepfake工具卖家。他的帖文露骨地写着“AI脱衣”“捆绑”“比基尼”等字眼,但主页却声明:“仅提供AI工具,对用途概不负责。”

X、Instagram、Facebook等海外社交平台,仅仅是打开潘多拉魔盒的一把钥匙。不少中国从业者,用“vx”“扣”“zfb”等字眼,隐晦地指代交易的最终场所:微信、QQ、闲鱼,甚至还有支付宝的交易界面。

通过留在X上的QQ号,我们联系上了一名卖家。为了逃避平台的监管,他的个性签名是“严禁违禁词,仅供娱乐使用,传播后果自负”。从头至尾,他表现得和一般软件销售无异,整段对话没有提及任何“性”相关的词汇。

但“性”,又成了这场交易心照不宣的目的。很快,对方用QQ“闪照(点开3秒后照片就会消失)”功能,发来两张打满马赛克的Deepdake效果图。

△作者与Deepfake工具卖家的QQ聊天记录,已举报给平台

点开大图,马赛克随即消失——一张凹着不自然姿势的Deepfake女性裸照,出现在了屏幕上。

3秒后,女性的照片,连同用以维权举证的证据,一同消失在了聊天记录中。

即便在国内,让女性经历一场赛博羞辱,并从法律制裁中逃逸,也如此简单。

作为脱去女性外衣的新型凶器,AI的出现,让网络性侵害的成本更低、速度却更快。在从业者发来的产品目录中,一段用AI生成的10秒内换脸视频30元,一张AI裸照只要10元,价目表上还特别注明:买5送1。

但一开始,Deepfake的背后、一项名为“生成对抗网络(GAN)”的技术,还几近人畜无害。

2014年诞生在谷歌大脑实验室的GAN,有着难以普及的一切要素:软件安装难度大、操作的技术门槛高,同时还需要昂贵的训练数据集和算力资源。这让Deepfake一度待在实验室里,没有被大众广泛使用。

事情走向失控,大致在2019年。

2019年,一款号称“30秒就能一键脱衣”的应用DeepNude诞生了——讽刺的是,这款软件用了一万张女性裸体照片训练而成,当用户输入一张男性照片,他无法脱下男性的衣物,只会为其添加一个女性的阴部。

DeepNude的背后,是几年间性能飞速提高的GAN技术,以及让使用难度大幅下降的开源生态。这让一名匿名的男性程序员Alberto(化名),基于加州大学伯克利分校的开源GAN架构,快速开发出了DeepNude。

一边,是迅猛发展的AI技术,和逐渐繁荣的开源生态;另一边,又是野蛮生长的Deepfake,和没有做好准备的社会意识和监管体系。

DeepNude让非自愿裸照的制作,变得像点击按钮一样简单。迫于舆论压力,DeepNude发布两周后,就选择了自主下架。Alberto(化名)在采访中解释,这款软件的开发完全出于“有意思”和“好奇心”:“我不是偷窥狂。我是技术的爱好者。”

DeepNude下架了,但千万个“DeepNude”,以更隐秘的姿态、更低的操作门槛、更逼真的生成质量,开始在互联网泛滥。

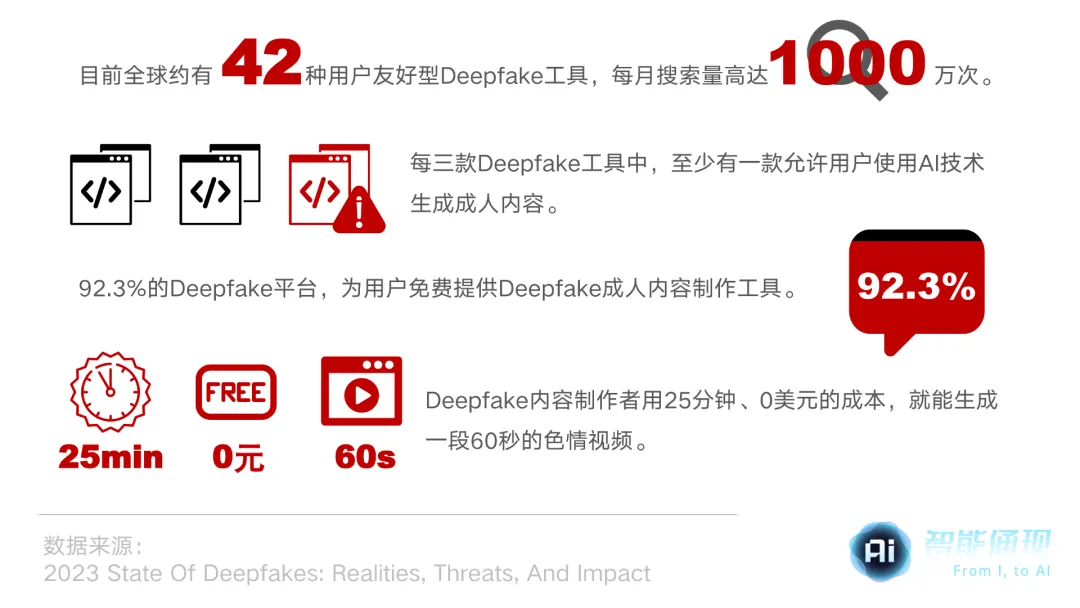

△Deepfake与色情产业的相关数据 制图:智能涌现

在论坛Discord上,DeepNude的安装包以20美元的价格出售。匿名卖家在主页中表示,他们提高了DeepNude的稳定性,与此同时,还删除了正版DeepNude给生成图片添加的水印——这一切,都让Deepfake裸照,看上去更加逼真。

下架不到三周,DeepNude又被开发出了更易上手的模式,成了嵌了Telegram上的一键脱衣Bot。

此后,事件的走向,和如今的韩国“N号房2.0”十分类似。Bot的使用者,自发在Telegram上建立了社群,超过10万名成员,成了“N号房”的初代居民。

最早监测到这款Bot的网络安全公司Sensity发现,上线不到一年,这款Bot已经产生了68万多名女性的虚假裸照,约104852张女性照片被公开发布在这款应用上。

从2019年至今,围剿DeepNude的行动一直在进行。

2019年7月,美国弗吉尼亚州通过了一条有关色情禁令的法律修正案,禁止出售或传播计算机生成的色情内容。同年年末,推特、谷歌、Facebook等平台着手整治Deepfake视频,措施包括给Deepfake视频打水印、赞助检测Deepfake的相关研究项目。

然而,无论是韩国“N号房2.0”,还是隐匿在QQ、支付宝、闲鱼中的地下灰产,都印证了一个令人沮丧的现实:Deepfake从未真正消失。

2019年,多伦多大学公民实验室曾发表了一项研究,试图探索微信如何自动审查巨量聊天中的图片。结果显示,微信对朋友圈和群聊的审查力度,大于一对一的私密聊天,同时,政治和社会新闻,是微信图片审查的核心主题。

这意味着,平台对色情内容的监管,依然存在漏洞。私密聊天中进行的Deepfake色情交易,很难通过平台进行披露,除非由人主动检举。

但人一定能主动站出来吗?

北京市两高律师事务所副主任张荆,20年来经手了不少侵害女性权益的案件。多年来,她帮助女性和具体到个人的加害者、不公平的结构,甚至法律系统的漏洞抗争。但Deepfake性侵害的发生,让她觉得女性的斗争,又走到了一个更为复杂的关卡。

“在技术不那么发达的过去,女性遭受性犯罪,起码能知道具体的受害者是谁,女性受到的伤害可以通过司法鉴定被量化。”张荆告诉《智能涌现》。但如今,无论是Deepfake内容的制作者,还是传播者,都面目模糊、数量难以确定,这对取证和量刑,都造成了极大的困难。

“报警不就好了?”在网络上,不少旁观者都提出了疑问,甚至有不少受害女性也曾认为,报警就好了。

但在报警之前,女性还要走过漫长的取证之路。张荆告诉《智能涌现》,“想要立案为刑事案件,去司法机关报案的前提是有基本的证据。”

而这些基本证据又包括:Deepfake传播的具体网站、侵权图片的数量(数量过少不足以被立案)、传播范围(传播范围过小不足以被立案)。

“说实话,对于不经常上网的人来说,完成这一步并不容易,她们可能甚至连网站该怎么进入都不知道。”张荆总结。

即便女性顺利走到了报警、立案的一步,加害者的处置结果往往不尽如人意。

在中国裁判文书网中输入“AI换脸”,一共只有16篇文书,最早的一起案件发生在2022年。两年来,能够诉诸刑事案件的Deepfake侵害事件,数量为0。

在层层阻碍下,女性针对Deepfake的维权,成了一条不断向下的螺旋:社会的压力,和严苛的立案流程,导致鲜少有愿意站出来的女性受害者;女性声量的不足,以及立案数量的稀少,又让立法的推进变得愈发艰难。

2023年12月,在中国台湾省,曾有一起判例,给了Deepfake受害女性些许希望。网名为“小玉”的男网红朱玉宸,使用Deepfake技术,将100多位知名女性合成A片,上网贩卖获利超过1300万台币(约288万元)。最终,他以违反《个人资料保护法》等罪名被起诉,并被判处5年有期徒刑。

只是,五年就够了吗?

“过去的黄色录像带、3D影片,是一个具体的小众产业,传播很难对一个鲜活的人产生伤害。”张荆说,“但今天的Deepfake,和过去色情产业的本质区别在于,它的传播,会对生活中具体的人产生伤害。”

这意味着,“依照传播淫秽色情内容对Deepfake进行量刑,程度一定是会偏轻的。”她总结。

加害者面前的,是看得到头的5年刑罚,但创伤可能会伴随女性走过更为漫长的岁月。

15岁那年,经历来自后桌男生的Deepfake骚扰后,小鱼开始不希望夏天到来。白色的短袖校服一旦被汗水浸湿,就会透出女生的内衣和身体的曲线。接近40摄氏度的高温下,小鱼依然选择穿两件短袖,阻挡男生的视线。

小鱼告诉《智能涌现》,她觉得告诉老师和家长,都是无用功。她记得,班上有男生曾经开女生的黄色玩笑,或是拽拉内衣的带子,但最后老师的回应是:都是小孩子之间的玩笑。

如今,离被骚扰已经过去了一年多的时间。升入高中后,小鱼和后桌男生失去了联系,生活又归于平淡。只是,夏天穿两件短袖的习惯,被小鱼保持到了现在。

在很长一段时间内,现实可能依旧惨淡。

看到韩国Deepfake事件后,鹿影科技联创李倩愤怒透顶,当即拉着创始人头脑风暴到深夜,口干舌燥之余,二人都很沮丧。“可能要带给你一个坏消息:没有什么办法能够从技术上,直接把Deepfake性暴力给杀掉。”李倩对《智能涌现》说。

虽然无法直接根除,“以其人之道还其人之身”,是一条常规路径。

瑞莱智慧联合创始人萧子豪向《智能涌现》介绍,公司内部会定期组织“红蓝对抗”,把工程师会分为“红军”“蓝军”两派,让「红军」模拟真实的攻击,而“蓝军”负责应对处置。“红军”一派的工程师们,为了了解黑产手段,甚至会潜伏到黑产群体中寻找线索,持续创新攻击手段。

对于用AI对抗Deepfake的人们来说,每天的工作,就是对抗各种意想不到的新案例。2周调优一个新版本、2个月迭代一版大模型,几乎是标配。

但这更多是在问题出现前后的预警提示。真正的侵害发生后,要想保护女性,更多需要依靠司法编织的网。

2022年11月,中国出台了第一条明确针对Deepfake提出的规定:《互联网信息服务深度合成管理规定》。这一规定对Deepfake内容制作者、技术服务提供商,以及制作、传播发布行为,都做出了规制。

但从法规的制定到真正落实,还有一条漫长道路。近20年来,张荆观察到,无论是办理刑事案件的律师,还是接到报案的警察、最终负责审判的检察机关,大多都是男性。

“这是一个结构性的问题,甚至立法机关,也基本上是男性。”张荆曾经参加过一个有关废除嫖宿幼女罪(比强奸罪量刑更轻)的研讨会。

在场的不少男性律师,给出了不少支持保留嫖宿幼女罪的理由,其中一个是:如果改用强奸罪定罪,犯罪行为人可能会铤而走险,反而让女性受害人陷入危险的境地。

现有的成功让加害者被拘留、定罪的个例,大多是女性积极自救的结果。

2023年的苏州大学黄谣和AI换脸事件中,受害者就潜入传播AI伪造图像的聊天房,进行取证,并利用排除法,将不同标记的照片在朋友圈中分组发布,进行逐个排除,最终将加害者抓获。

要进一步推动Deepfake性侵害的立法,和社会意识的前进,还需要一个真正的判例。

“有了判例,这段女性被迫害史才更有可能被写进义务教育的教科书,让性别教育前进一步。”一名在日本的女权活动者告诉《智能涌现》。

当下的AI行业,其实还是一个相当由男性主导的领域。某种程度上,从研发到产品落地过程中,都极易让女性成为被AI“压迫”的群体,成为产业中的一环。

李倩观察到的一个数据是,从互联网获得的视频模型训练数据,40%涉及成人内容,而其中的8成,内容都是女性身体。

“色情,是当下AI C端产品最成功的商业模式。”一名投资人对《智能涌现》如此评价。最终,Deepfake的泛滥被归结到了一个商业现实:用AI贩卖女性身体,会给利益者带来丰厚的商业回报。

对抗商业惯性,十分困难。

在融资过程中,部分投资人,无论男女都会告诉李倩,YoYo(鹿影科技的AI视频创作平台)如果对黄色擦边内容稍微宽容些,商业化会更顺利。

从第一天起女性友好,对人力、资金有限的AI初创公司而言,要不要走出这一步,是个尤为艰难的决定。

李倩告诉《智能涌现》,从训练数据中剔除40%的黄色数据,意味着要花额外的成本补全;如果花人力和时间给用户输入的提示词设置违禁词,产品迭代的速度至少慢两个月。

“做创业者,是不是就要无性别地,看待商业世界?”但经历Deepfake事件后,李倩已经不这么认为了,“一旦开闸,行业又多了一块驱逐良币的劣币。”

如果女性能够在行业中获取更多技术主导权,未来会变得不一样。

2024年9月4日,中科院的女工程师张欣怡,将自己团队研发的Deepfake对抗模型,向全球开源。一旦有人需要帮助,就可以免费使用模型来检测Deepfake内容。

在自己的微博中,张欣怡写到:“如果一个人的火把太小,我们就把火把传给世界的每一个人。”

当新技术席卷世界,司法、技术都尚未完全跟上时,普通人每一次的发声、行动,才是社会进程得以向前推进的原因。

韩国就是一个活生生的例子——在极度男性主义的国家,女性权益的每进一步,都由布满血和汗的斗争之路造就。

自2015年之后,韩国女性在#MeToo、消除网络性暴力、终止怀孕非刑罪化等议题上开展了一系列女性主义运动,通过展开议题讨论、集会游行等等形式,这些活动从社会意识、立法制度层面,都争取到了宝贵的成果。

曾经揭露N号房丑闻的两位女记者姜京允、朴孝实,经受了旷日持久的网络谩骂、侮辱和精神折磨,其中一位记者甚至多次流产。

但韩女从没有停下脚步。N号房事件后,韩国就成立了专注于反对性剥削犯罪的女性团体“RESET”,推动了包括网络性犯罪相关法例的制定过程。而今年5月,将Deepfake其中一名嫌疑人送进监狱的,正是此前曾揭露N号房的两位大学生记者之一。

不能停止,不能放弃,是我们接触到的,奔走在Deepfake事件一线的韩国女性想法。“这不是仅仅为了我们这一代而奋斗,而是为了所有人的命运,”智英说,“我想要一个我的朋友、家人和所有女性都感到安全的世界。”

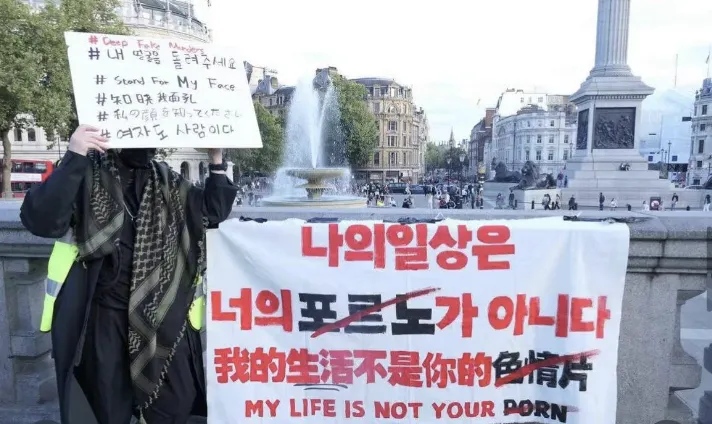

不同人种、国籍的女性,都开始了对韩国女性的声援。当地时间9月3日,一群居住在伦敦的中国女权主义者,从特拉法加广场走到韩国大使馆,高唱起韩国女权运动的标志性歌曲《再次重逢的世界》,声讨韩国偷拍、AI伪造等等非法行为。

红色的字,被印在各式各样的横幅标语上:“我的生活,不是你的色情片。”

△当地时间9月3日,一群居住在伦敦的中国女性主义者进行了反偷拍、反Deepfake游行。图源:伦敦的中国女权主义者

(为保护受访者,智英、恩静、小鱼均为化名)

封面来源|视觉中国

文章来源于“智能涌现”,作者“智能涌现编辑部”

【开源免费】Deep-Live-Cam是一个只需一张图片即可实现实时换脸和一键视频深度伪造的AI项目。

项目地址:https://github.com/hacksider/Deep-Live-Cam

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0