LeCun 认为,OpenAI 只发博客,相比技术论文来说,还是差的太远。

图灵奖三巨头之一 Yann LeCun 又和别人吵起来了,这次是 Noam Brown。

Noam Brown 为 OpenAI o1 模型的核心贡献者之一,此前他是 Meta FAIR 的一员,主导了曾火遍一时的 CICERO 项目,在 2023 年 6 月加入 OpenAI 。

这次吵架的内容就是围绕 o1 展开的。众所周知,从 AI 步入新的阶段以来,OpenAI 一直选择了闭源,o1 的发布也不例外。

这也引来了广大网友的吐槽,干脆叫 CloseAI 算了,反观 Meta,在开源领域就做的很好,o1 的发布,更是将这一争论进行了升级。

这不,面对广大网友的吐槽,OpenAI 显然是知道的。就在前两天 Noam 发了一条消息:「我们这些参与 o1 的人听到,外界声称 OpenAI 降低了研究的优先级,听到这些消息我们感觉很奇怪。我向大家保证,事实恰恰相反。」

对于这一说法,Yann LeCun 不满意了,直接跑到评论区开怼「如果你们不能(公开)谈论它,那就不是研究。」

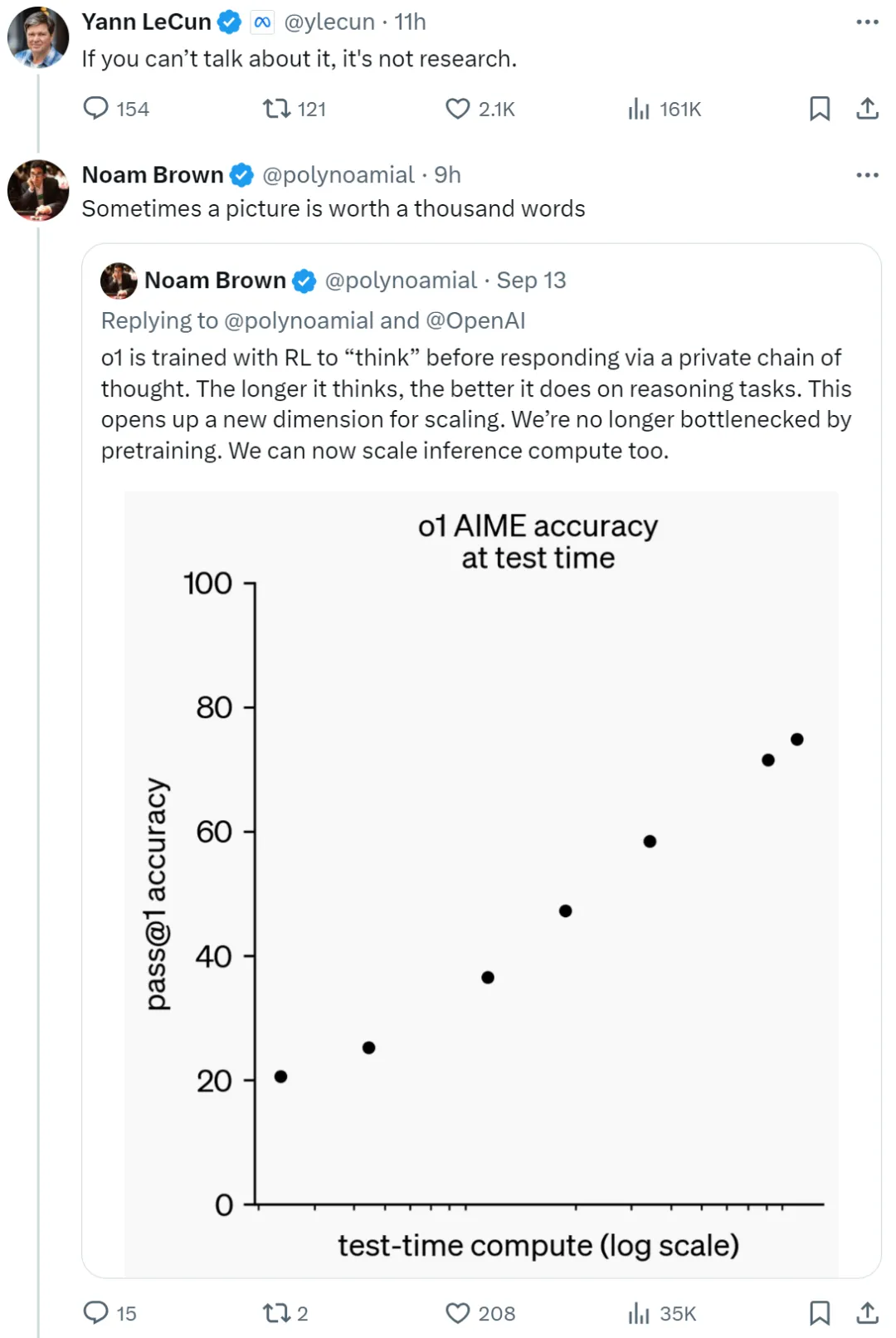

Noam Brown 显然对 LeCun 的回答不是很满意,回击表示:(无需谈论,)有时一幅图胜过千言万语。在 Noam Brown 引用的这张图里,上面还配了一段文字「o1 经过 RL 训练,在通过私有思维链做出反应之前会先进行思考。思考的时间越长,它在推理任务上的表现就越好。这为扩展开辟了一个新的维度。我们不再受预训练的瓶颈限制。我们现在也可以扩展推理计算了。」

更进一步的,Noam Brown 表示在 OpenAI 发布的这篇博客文章中,他们分享了大量的信息,包括 CoT 的内容,Noam Brown 表示这些信息非常具有启发性。(为了让大家更好的了解 o1)上周,他还在加州大学伯克利分校就 o1 模型进行了一次演讲。

Noam 言外之意就是,你看 OpenAI 也是会介绍技术相关的内容的,OpenAI 并不是大家认为的对技术避而不谈。

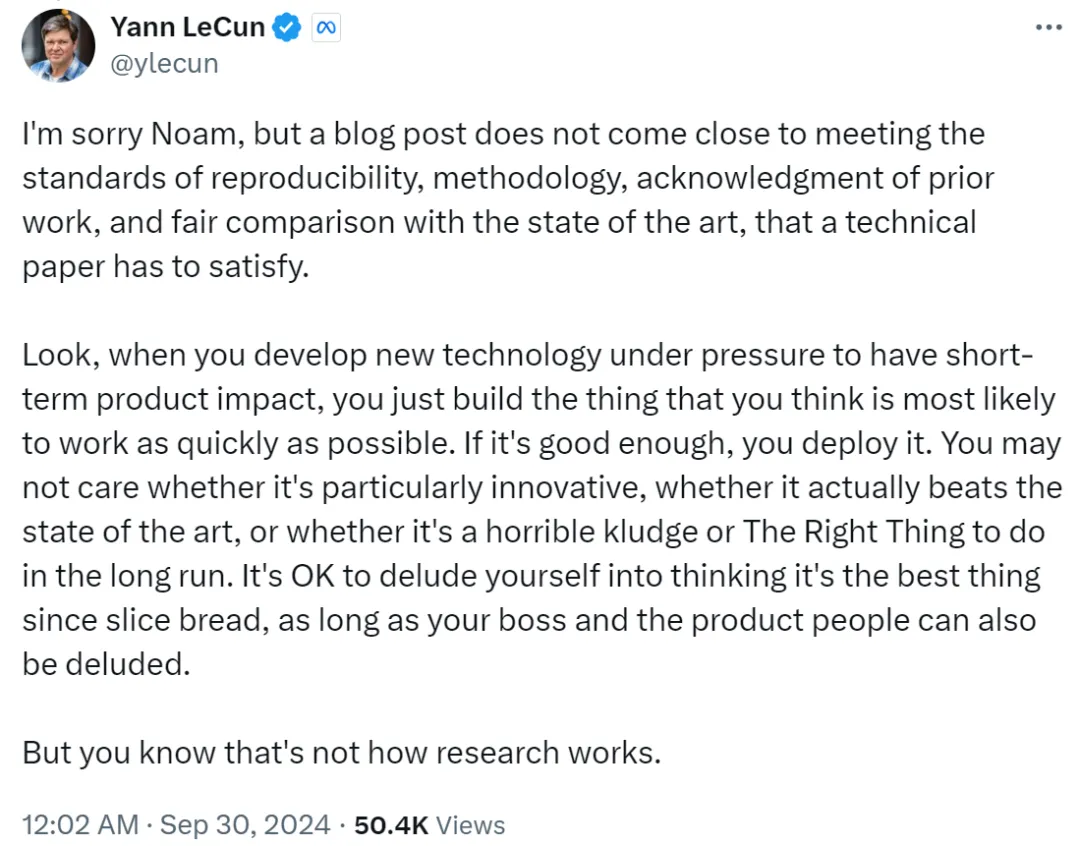

对于这一说法,显然 LeCun 很不满意:「我很抱歉 Noam,但博客文章与技术论文相比,远远达不到可复现性、方法论以及与最新技术的公正比较等标准。当你们在压力下开发新技术以产生短期产品影响时,你们只需尽快构建你认为最有可能发挥作用的东西。如果它足够好,你就部署它。你们可能不在乎它是否真的具有新奇的创新,是否真的超越了最先进的技术,或者它是否是一个糟糕的临时解决方案,或者从长远来看是否是正确的选择。你们可以自欺欺人地认为这是自切片面包以来最好的东西,只要你的老板和产品人员也能被欺骗。但你知道研究不是这样的。」

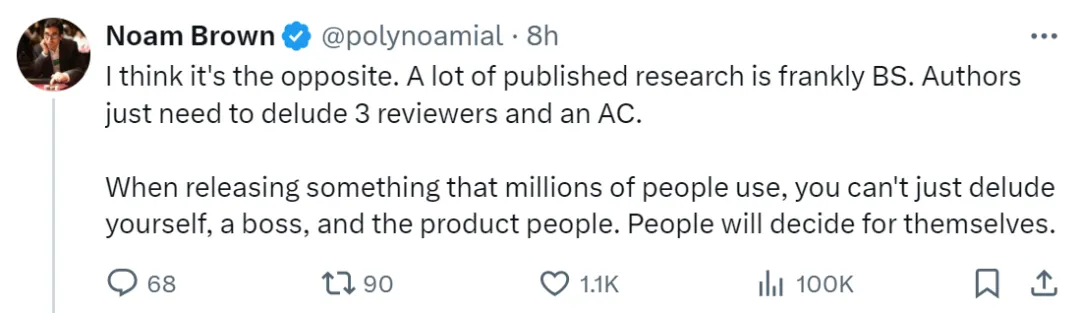

Noam 反驳道「我认为恰恰相反。坦白说,很多已经发表的研究说的都是废话,作者只需要欺骗 3 位审稿人和一位 AC。但当你发布一个数百万人使用的东西时,你不能只是发布欺骗自己、老板和产品人员的产品,用户会有自己的决定。」

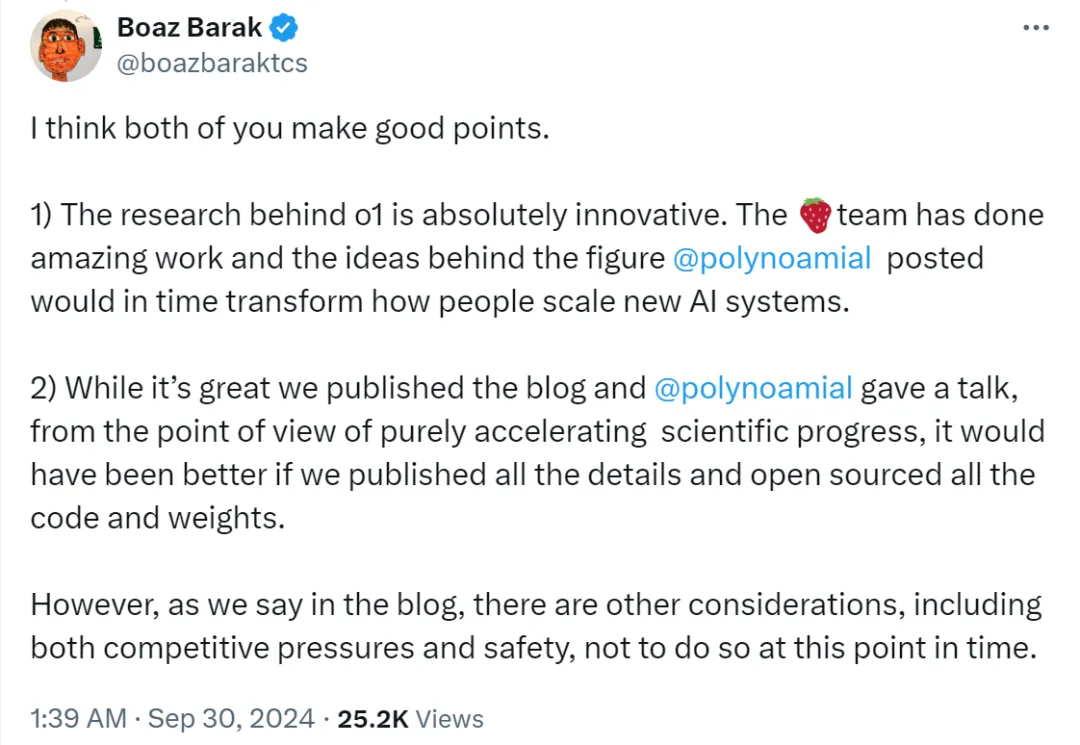

随后,哈佛大学计算机科学教授 Boaz Barak(资料显示,从 2024 年 1 月开始,Barak 离开哈佛大学前往 OpenAI 工作一年)表示:「我认为你们俩的观点都很好。o1 背后的研究绝对具有创新性,草莓团队已经完成了惊人的工作和想法,OpenAI 正在改变人们扩展新人工智能系统的方式。

虽然我们发表了博客,Noam 也做了相关演讲,但从纯粹加速科学进步的角度来看,如果能够发布所有的细节,开源所有的代码和权重,那就更好了。然而,正如我们博客中所说,我们还有其他考虑,包括竞争压力和安全因素,因此目前还不宜这样做。」

对此,LeCun 认为 OpenAI 不公布技术细节,出于竞争压力的考量还是可信的,但他绝不相信 OpenAI 是为了安全。

至此,这段 battle 告一段落。但大家讨论的热情居高不下。

「对于一家拥有数百名高级专家的非营利组织怎么可能每年只发表很少的论文?我认为自 2021 年以来,OpenAI 每年只有 2-3 篇论文?OpenAI 是过去 20 年来最不开放的前沿科技公司。」

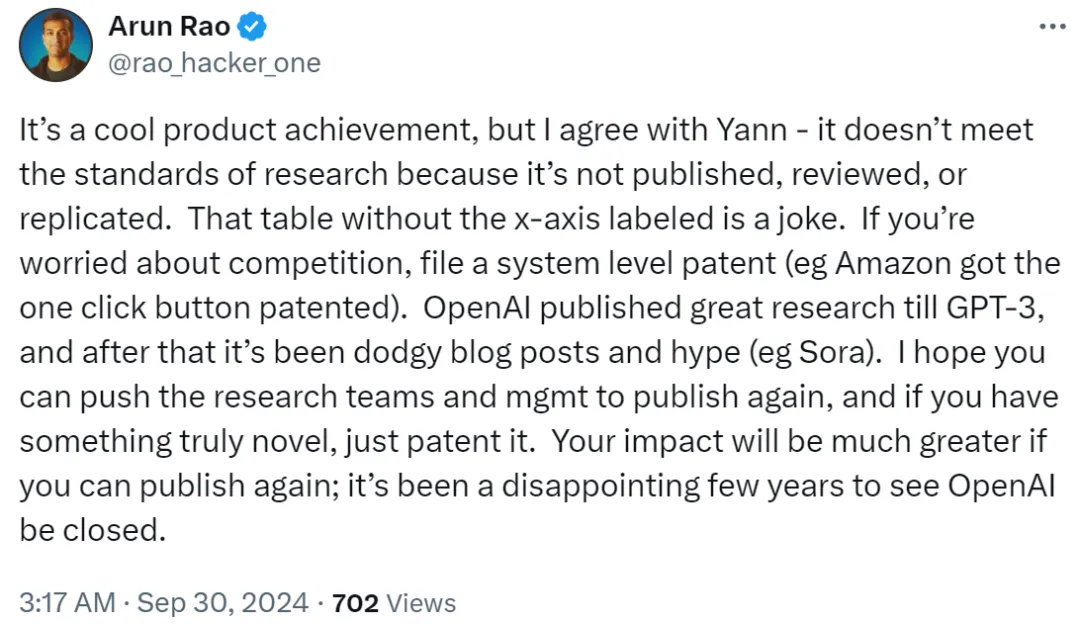

还有网友表示「虽然这是一项很酷的研究,但我同意 Yann 的观点 —— 不符合研究标准,因为 OpenAI 没有发表论文、进行同行评审或研究的可复现性。OpenAI 在 GPT-3 之前发表了很棒的研究,之后就是让人怀疑的博客文章和炒作(例如 Sora)。我希望 OpenAI 能推动研究团队和管理层再次发表文章,如果有真正新颖的东西,就申请专利。如果 OpenAI 能发表文章,那么其影响力会更大;这几年 OpenAI 的闭源真是令人失望。」

最后,还有网友灵魂一问:那他们(Ilya Sutskever、Mira Murati 等)为什么都离开了?

「人才流失如此之快的原因到底是什么?」

文章来自于“机器之心”,作者“陈陈”。