家人们,OpenAI 又上新了!

这次他们推出了全新的生成式模型sCM(Simplifying Continuous-Time Consistency Models),支持视频、图像、三维模型和音频的生成。

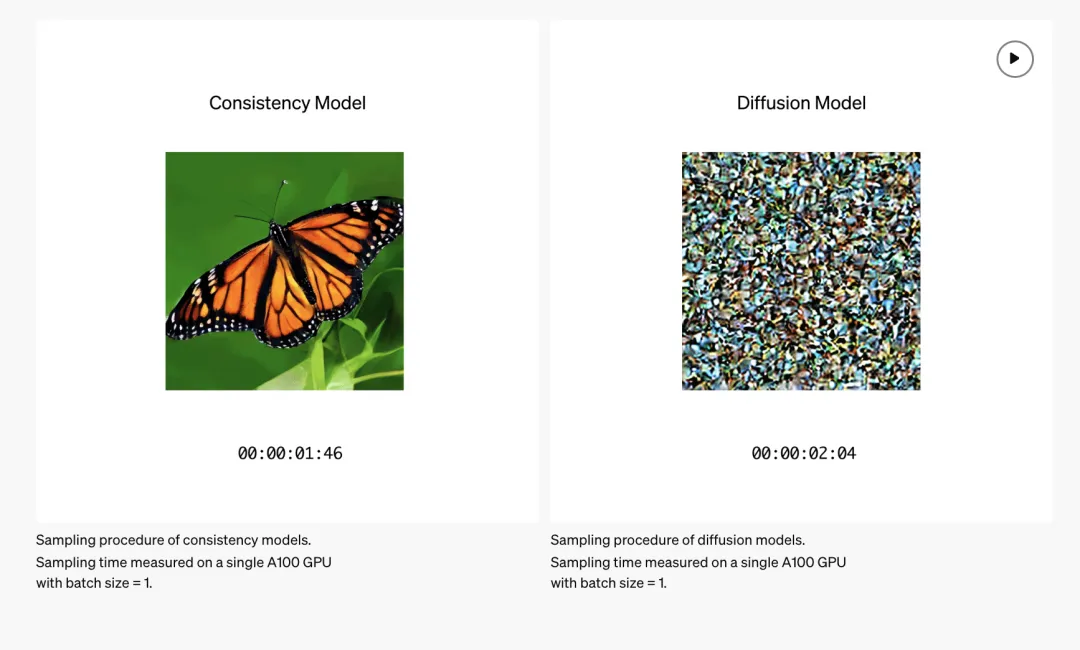

这款模型的性能非常惊人,与传统的扩散模型相比,生成同等质量内容的速度提高了惊人的50倍!最大号的 1.5B 参数模型,在单卡 A100 上生成一张图片只需 0.11 秒!而且效果与Diffusion模型相近。

如下图所示,几乎同样的时间,扩散模型还是一团马赛克,sCM已经开始初见雏形了!

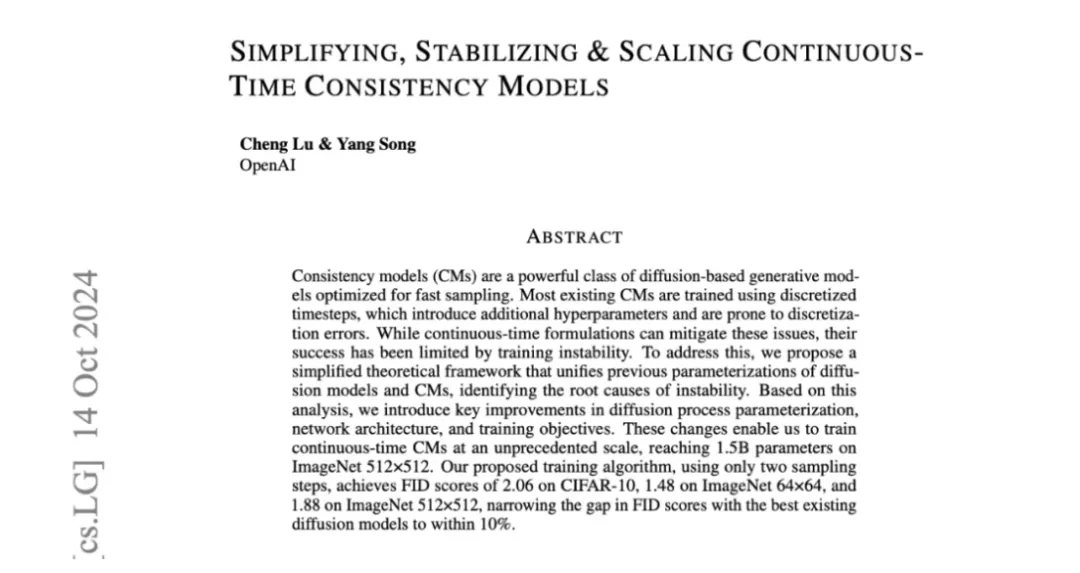

OpenAI同时发布了研究论文,两位华人作者全都毕业于清华。

论文链接:

https://arxiv.org/pdf/2410.11081

官方博客:

https://openai.com/index/simplifying-stabilizing-and-scaling-continuous-time-consistency-models/

研究团队在多个图像数据集进行了实验分析,包括CIFAR-10、ImageNet 64×64和ImageNet 512×512等。

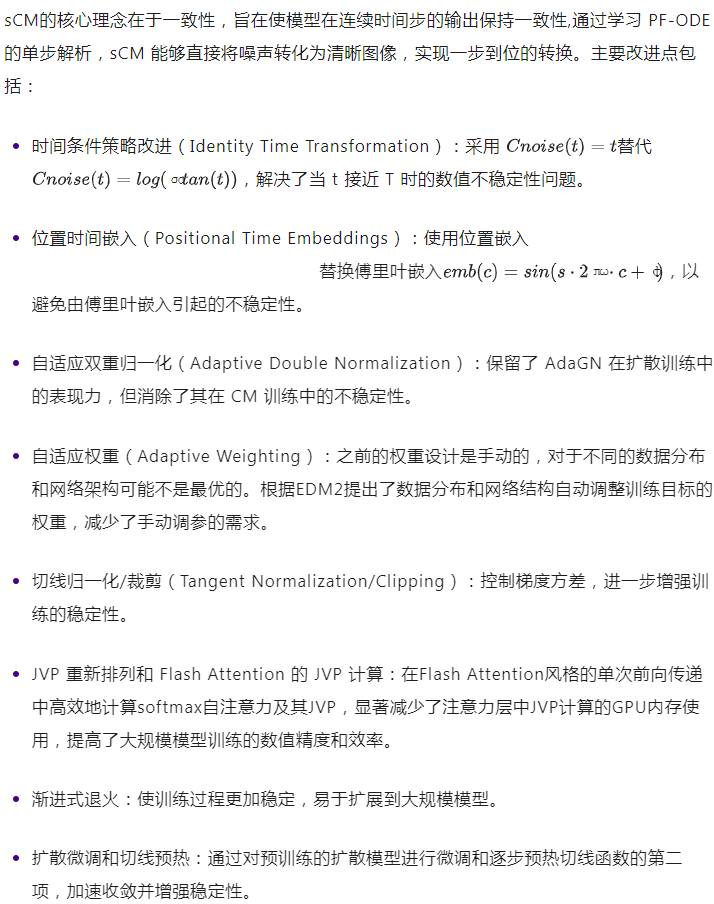

在可视化分析中,路径的展示非常清晰:蓝线代表扩散模型逐步进行的采样过程,而红线则显示了一致性模型更加直接和快速的采样方法。通过采用一致性训练或一致性蒸馏技术,sCM能够有效地训练出一致性模型,显著减少了生成高质量样本所需的步骤数量。

目前研究团队训练的最大的sCM模型拥有15亿个参数。在一台未经过推理优化的A100 GPU上,生成一个样本的时间仅需0.11秒。通过对硬件和系统进行定制化优化,可以进一步提高生成速度,使得在图像、音频、视频等多个领域的实时生成成为可能。

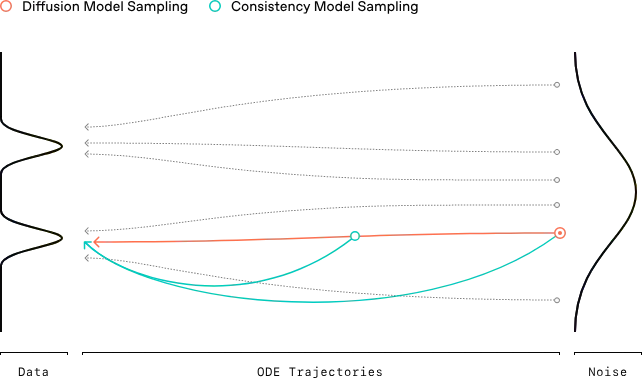

sCM模型在标准的FID(Fréchet Inception Distance)评分上表现出色,分数越低表示质量越高。此外,sCM模型在有效采样计算量方面也表现优异,即生成每个样本所需的总计算成本。如下图所示,使用2步sCM生成的样本在质量上与当前最佳方法相当,而所需的有效采样计算量不到10%,极大地提高了采样效率。

sCM通过改进的架构和训练目标,简化并稳定了连续时间一致性模型的训练过程,使其能够有效地扩展到拥有15亿参数的ImageNet 512×512规模。这些改进结合起来,不仅提高了在不同数据集和模型规模上的性能,而且在大规模应用中表现出了优于其他少步采样方法的可预测的扩展性。此外,研究团队也指出,在未来的研究中,根据特定应用的需求,评估sCM的质量可能需要采用不同的方法。

文章来自于微信公众号“夕小瑶科技说”,作者“小鹿”