融合物理知识的大型视频语言模型PhysVLM,开源了!

它不仅在 PhysGame 基准上展现出最先进的性能,还在通用视频理解基准上(Video-MME, VCG)表现出领先的性能。

在这项研究之前,想让AI像人类儿童一样,通过观察世界理解基本的物理常识,是一个主要挑战。

对于现实世界的视频来说,全面覆盖和解释所有正常的物理现象既困难又不必要。

相比之下,游戏视频(gameplay videos)通常包含违反物理常识的“故障现象”(glitches),这有助于简化物理常识理解的定义和评估,即专注于解释物理常识的违反现象,而不是试图列举所有存在的正常物理现象。

为此,PhysVLM在专门整理的一套数据集上训练,包括用于评估的PhysGame benchmark、用于监督微调的PhysInstruct数据集和用于偏好对齐的PhysDPO数据集。

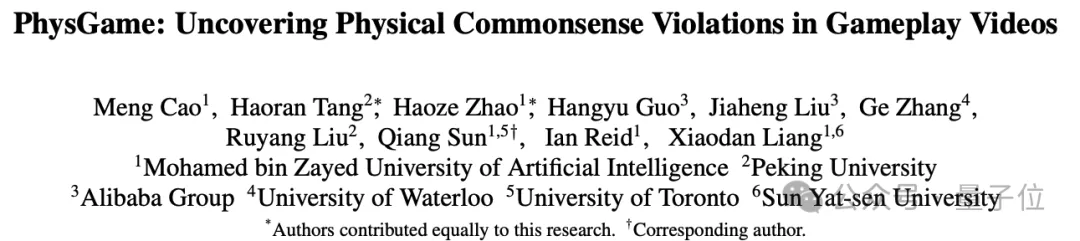

如图所示, PhysGame包含880个含有故障现象的游戏视频,每个视频都配有一个高质量的多项选择题,专门针对故障现象的性质进行标注。

PhysGame涵盖了四个关键的物理领域(即力学、运动学、光学和材料属性),并细分为12个具体类别(如重力和速度)。

视频收集和过滤:

PhysGame中的视频主要从Reddit页面抓取,该页面包含带有异常事件和故障现象的游戏视频。为了平衡不同的类别,团队还通过关键词搜索从 YouTube增强视频数据。团队根据以下两项标准进行人工筛查:

选项生成:

本文以多项选择题的形式创建问答对。具体来说,正确选项描述了视频中违反物理常识原则的特定故障现象。为了增强干扰选项的可信度,本文要求干扰选项中的故障现象应与视频中观察到的个体或动作高度相关,这使视频LLM理解故障内容,而不仅仅通过识别包含的物体或动作来选择答案。

质量控制:

为了保证数据集的质量,本文进行了一项包括人工检查和自动LLM辅助检查在内的双重质量控制过程:

PhysInstruct:

为了提升视频LLM的物理常识理解能力,团队开发了PhysInstruct数据集用于监督微调。视频收集过程与PhysGame中的流程相同。为了防止数据泄漏,团队严格排除任何已包含在PhysGame中的视频。团队遵循Self-instruct范式通过提示GPT-4o来构建PhysInstruct。

PhysDPO:

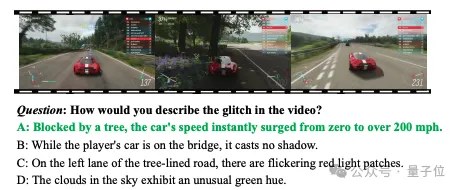

团队构建了偏好对齐数据集PhysDPO,以提供更可信和可靠的回答。如图3所示,团队将PhysInstruct 数据集中生成的答案视为preferred回答,而dis-preferred回答则通过元信息篡改(meta-information hacking)、时间篡改(temporal hacking)和空间篡改(spatial hacking)生成。团队用误导性的元信息以及减少帧数和降低帧分辨率的视频帧来提示 GPT-4o。

以下是PhysDPO数据集构建流程图:

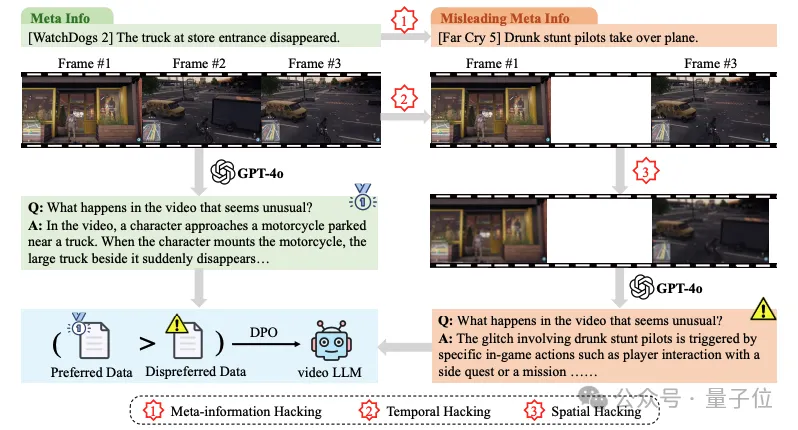

PhysGame benchmark 实验结果:

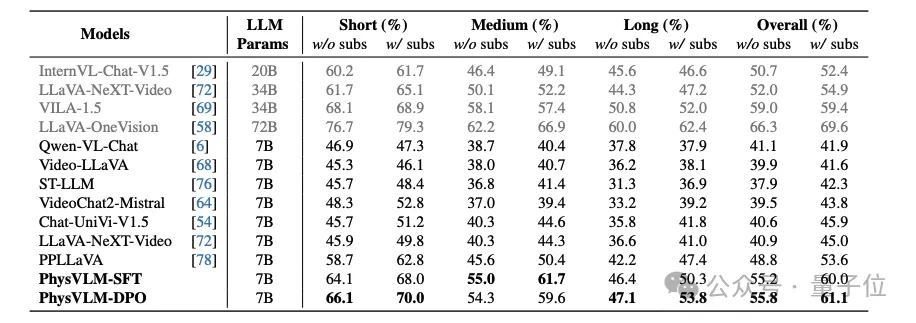

Video-MME benchmark实验结果:

本文的PhysVLM模型在所有7B模型中表现优越。令人惊讶的是,作为7B模型,PhysVLM-SFT和PhysVLM-DPO在整体表现上分别比 34B 模型 LLaVA-NeXT-Video提高了3.2%和3.8%的绝对值。通过比较PhysVLM-SFT和PhysVLM-DPO,团队发现,使用所提出的PhysDPO数据进行 DPO训练在短视频和长视频上的表现都有所提升,而在中等长度的视频上的表现略有下降。

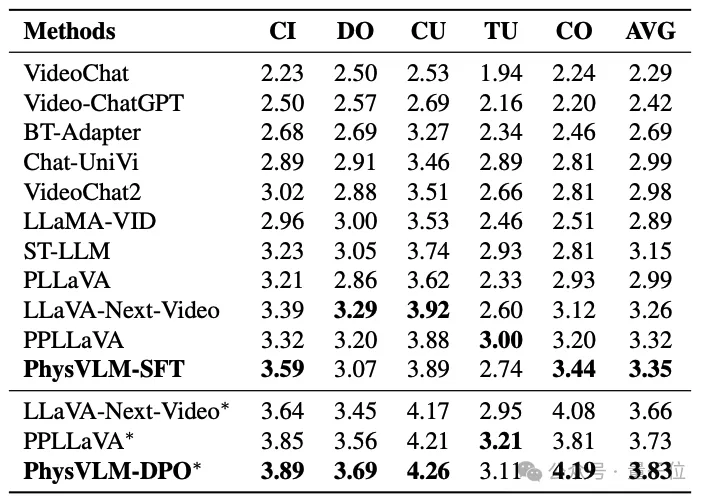

VCG benchmark实验结果:

在仅使用SFT的模型中,本文的PhysVLM-SFT在平均得分方面表现最佳。在四个子类别的评估中,PhysVLM-SFT在信息正确性和一致性类别上表现尤为出色。与使用DPO或PPO训练的PPLLaVA和LLaVA-Next-Video相比,本文的PhysVLM-DPO也展现出卓越的性能,进一步验证了所提出的PhysVLM模型在通用视频理解中的出色能力。

PhysVLM相关论文、代码、数据均已开源:

pre-prints: https://arxiv.org/abs/2412.01800

代码链接: https://github.com/PhysGame/PhysGame

leaderboard: https://physgame.github.io/#leaderboard

文章来自微信公众号“量子位”,作者“PhysVLM团队”

【免费】ffa.chat是一个完全免费的GPT-4o镜像站点,无需魔法付费,即可无限制使用GPT-4o等多个海外模型产品。

在线使用:https://ffa.chat/

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner