97年文科生干出全球最强AI 3D大模型

97年文科生干出全球最强AI 3D大模型他是SIGGRAPH 50年历史上第一位、也是迄今唯一一位登上大会主题演讲舞台的中国人,与英伟达黄仁勋等行业领袖同台。

搜索

搜索

他是SIGGRAPH 50年历史上第一位、也是迄今唯一一位登上大会主题演讲舞台的中国人,与英伟达黄仁勋等行业领袖同台。

本周,我们邀请 3D 大模型公司 VAST 的创始人和 CEO 宋亚宸(Simon),和我们聊聊 VAST 最新 3D 生成大模型 Tripo 3.0 背后的故事。这位 97 年的创业者短期内连续融资三轮、每轮数千万美金,积攒了足够的子弹,在闷头苦干一年后,Simon 今年首次上播客,和我们探讨了几个关键的战略问题:

97年创始人宋亚宸创立3D大模型公司VAST,已完成三轮数亿元融资,估值业界最高。公司50人团队年收入700万美元,Tripo产品生成模型量达3000万个,用户超300万。未用OKR/KPI管理,靠独特文化(如季度调薪、淡化优先级、兴趣包容)激发效率。战略从C端转向服务PGC用户推出Tripo Studio,月收60万美元。

AI 不允许有人不会搭乐高。

前些天,GPT-4o的多模态生图上线之后,引发全球AI社区广泛的关注,吉卜力图画全网风靡。

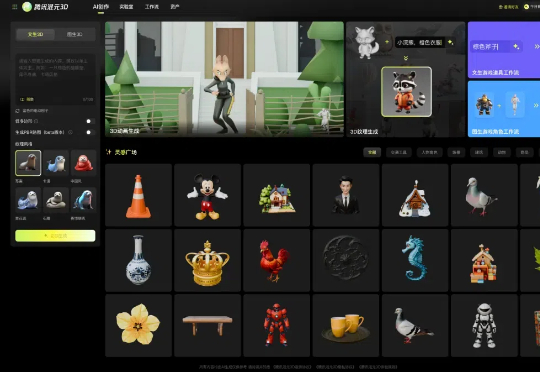

早上MiniMax上线TTS,字节上线AI编程Trae;下午字节全量上线豆包实时语音;晚上DeepSeek开源R1性能直接对标OpenAI o1,然后Kimi的k1.5直接正面硬刚。昨天的余温还没过,今天下午,腾讯混元又悄悄开了个闭门发布会,作为混元的老基友,我自然是受邀参加期期不落。

“3D大模型终于可以生成锐利的边角了!” “在钻研了一阵3D人工智能后,我总算通过Hyper3D.ai用上了Rodin1.5,它真的可能改变游戏规则。”

“3D大模型终于可以生成锐利的边角了!”

3D内容正成为巨头布局的新风向。 索尼在近期的CES上推出了支持空间内容创作的“XYN™”集成软件和硬件解决方案,让3D内容创作更加灵活和可访问,相关的创作人才持续涌入这一方向。

西风