AI差点骗过全世界,这个8.7万赞的帖子被揭穿后,我开始怀疑一切了

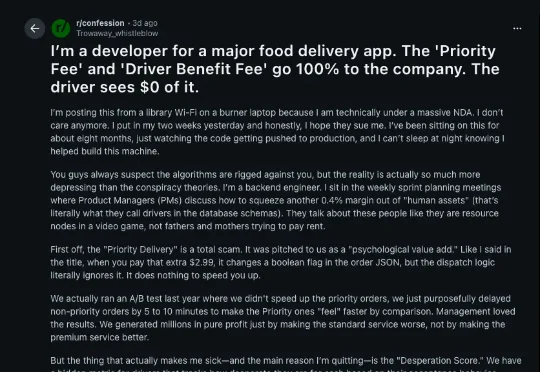

AI差点骗过全世界,这个8.7万赞的帖子被揭穿后,我开始怀疑一切了近日,海外版《外卖骑手困在系统里》在 Reddit 上发酵,获得了超过 8.7 万赞,直冲首页。这是一个符合大众对「万恶资本」的想象的故事,但也是一场 AI 生成的骗局。

近日,海外版《外卖骑手困在系统里》在 Reddit 上发酵,获得了超过 8.7 万赞,直冲首页。这是一个符合大众对「万恶资本」的想象的故事,但也是一场 AI 生成的骗局。

山姆最近换了个前阿里的高管, 上任之后kuku一顿改,还用了AI图做app的菜品图结果被骂惨了,一开始我是不信的。

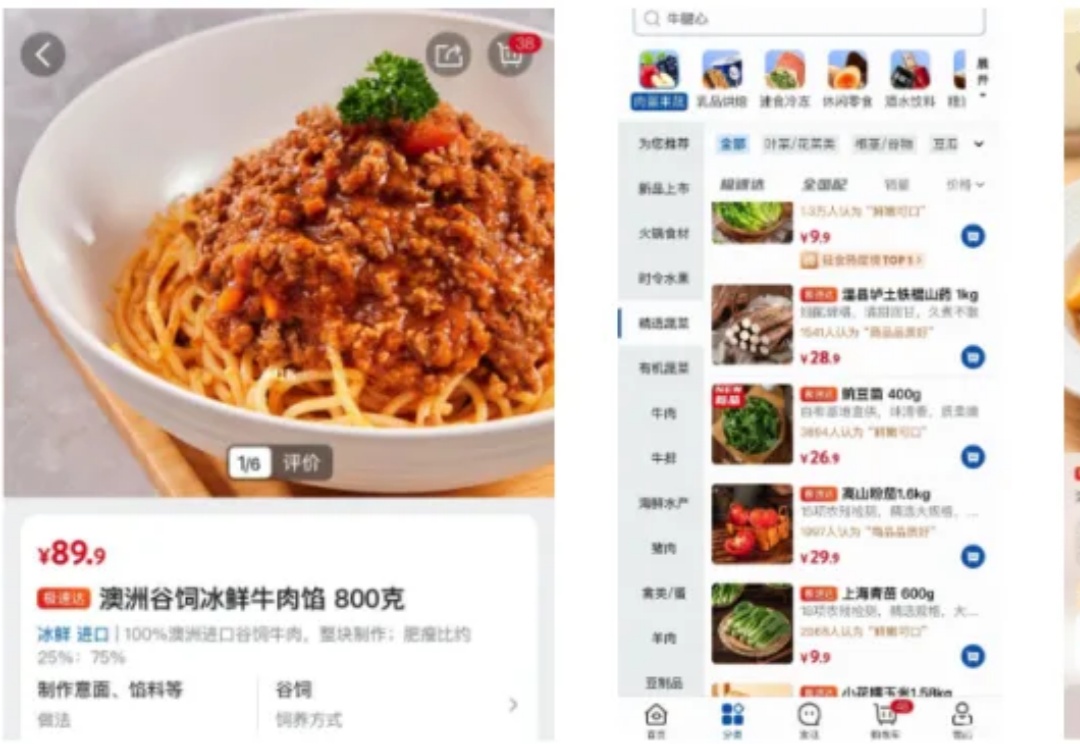

该论文提出 FractalForensics,一种基于分形水印的主动深度伪造检测与定位方法。不同于以往的水印向量,为达成伪造定位的功能,论文提出的水印以矩阵形式出现。

论直播,AI版黄仁勋,竟碾压了本尊?周三的GTC 2025大会上,黄仁勋在华盛顿登台激情演讲。但怪事发生了。另一个打着「NVIDIA LIVE」旗号的直播,却悄悄聚集了近10万观众。

母亲被杀,尸体藏进洗衣机,女儿却用AI伪造她的声音、假扮她的样子,让世界以为她还活着。十天后,真相才浮出水面,竟是亲生女儿弑母,后用AI伪造母亲声音!AI没有杀人,却做了帮凶。我们该害怕的,是机器的失控,还是人性的冷酷?

Airbnb遇到的此次事件,或许还仅仅只是个开始。 无论是否承认,如今AI已经在改变世界,例如打工人用它来实现效率倍增,互联网大厂也有样学样,将其作为裁员的导火索,砸掉了一大批打工人的饭碗。同时它还成为了居心不良的黑灰产团队受众的武器,不久前#仅退款AI图#就曾登上微博热搜,更是引发了诸多关注。

发展和治理,两手都要抓。

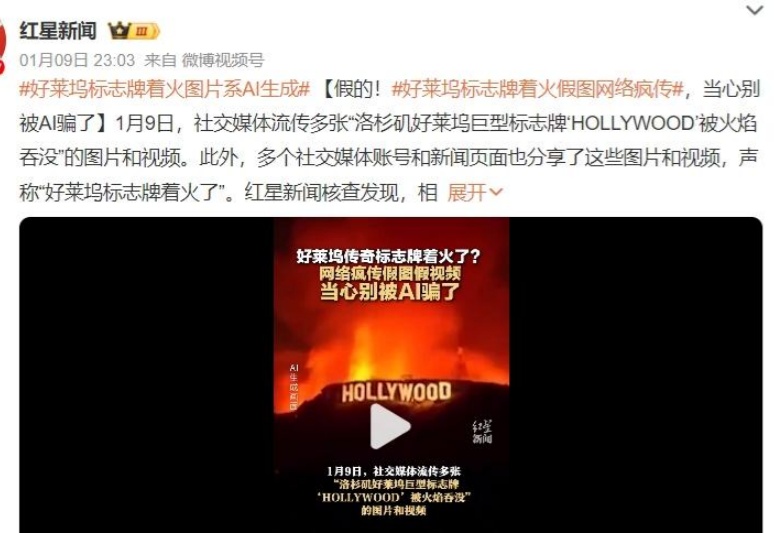

昨天晚上,我在微博上看到了一条热搜。

随着大模型飞速发展,AI应用也逐渐成熟。过去一年,在很多人还在琢磨能用AI来干啥的时候,已经有不少人靠着AI产品和信息差赚到了“真金白银”。

当AI遇上名人,还分得清真假吗?