多模态幻觉的病因「高熵节点」找到了!全基准幻觉率下降

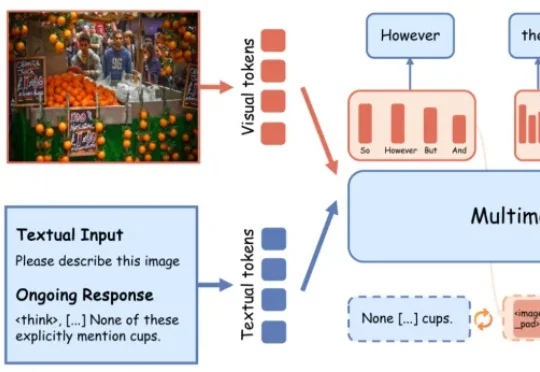

多模态幻觉的病因「高熵节点」找到了!全基准幻觉率下降多模态大推理模型的幻觉,很多时候并非「没看见」,而是在最不确定的推理阶段想偏了。最新研究发现,模型在生成because、however、wait等transition words时,往往处于高熵关键节点,更容易脱离图像证据、转向语言脑补。LEAD在高熵阶段不急于输出单一离散token,而是先在潜在语义空间保留多种候选推理方向,并通过视觉锚点持续拉回图像证据,显著缓解幻觉。

搜索

搜索

多模态大推理模型的幻觉,很多时候并非「没看见」,而是在最不确定的推理阶段想偏了。最新研究发现,模型在生成because、however、wait等transition words时,往往处于高熵关键节点,更容易脱离图像证据、转向语言脑补。LEAD在高熵阶段不急于输出单一离散token,而是先在潜在语义空间保留多种候选推理方向,并通过视觉锚点持续拉回图像证据,显著缓解幻觉。

这个爆火的开源项目,叫做 Hermes Agent,地址:https://github.com/NousResearch/hermes-agent是由 Nous Research 团队倾力打造的开源Agent。

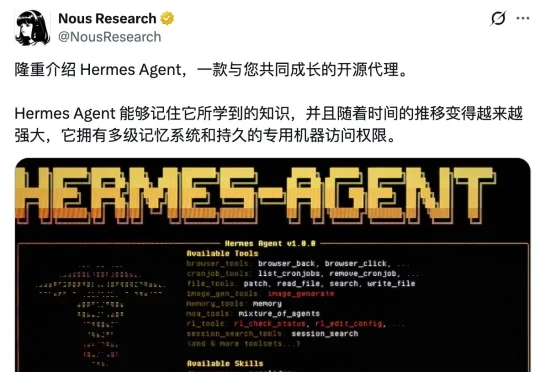

Codepilot 是藏师傅从今年一月开始纯 Vibe Coding 写个一个全平台通用开源 Agent 客户端。截止目前已经迭代了几百个版本,github 的 Star 也来到了 5100. 支持你能想到的小龙虾和 ClaudeCode 等 Agent 所有的能力,比如:

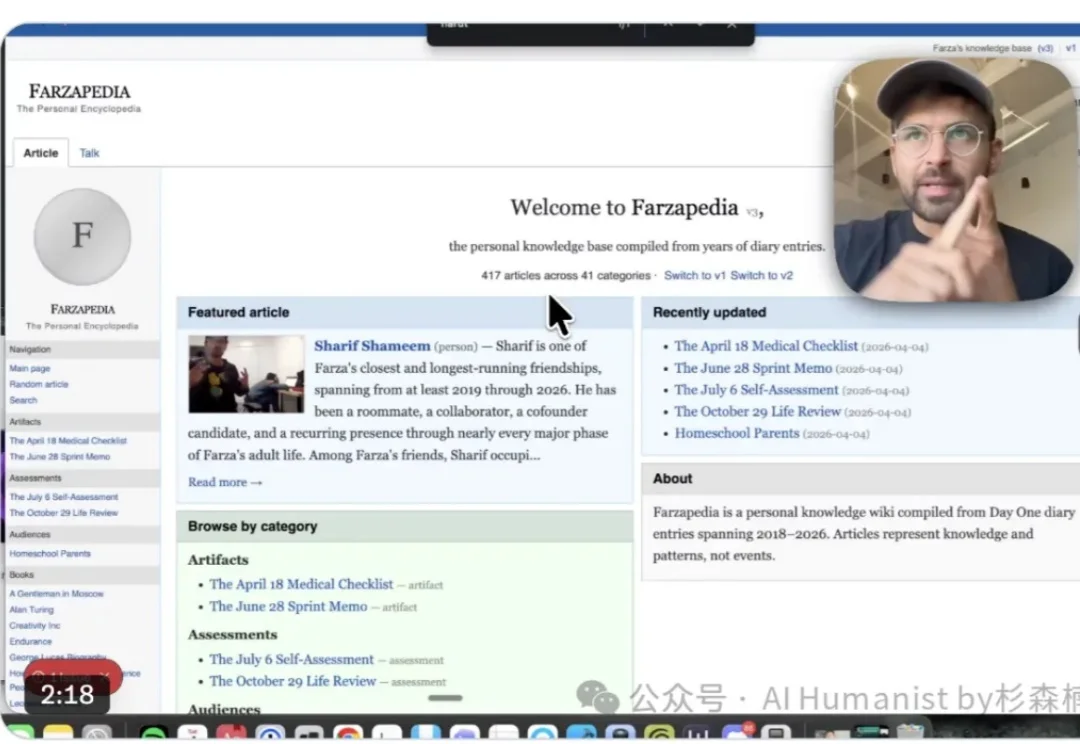

前天刷 X,刷到一个叫 Farza 的老哥,做了件牛 X 的事。

在这篇文章里,我想介绍编码智能体(Coding agents)以及 Agent harnesses 的整体设计:它们是什么、怎么运作,以及各个零件在实践中怎么拼到一起。

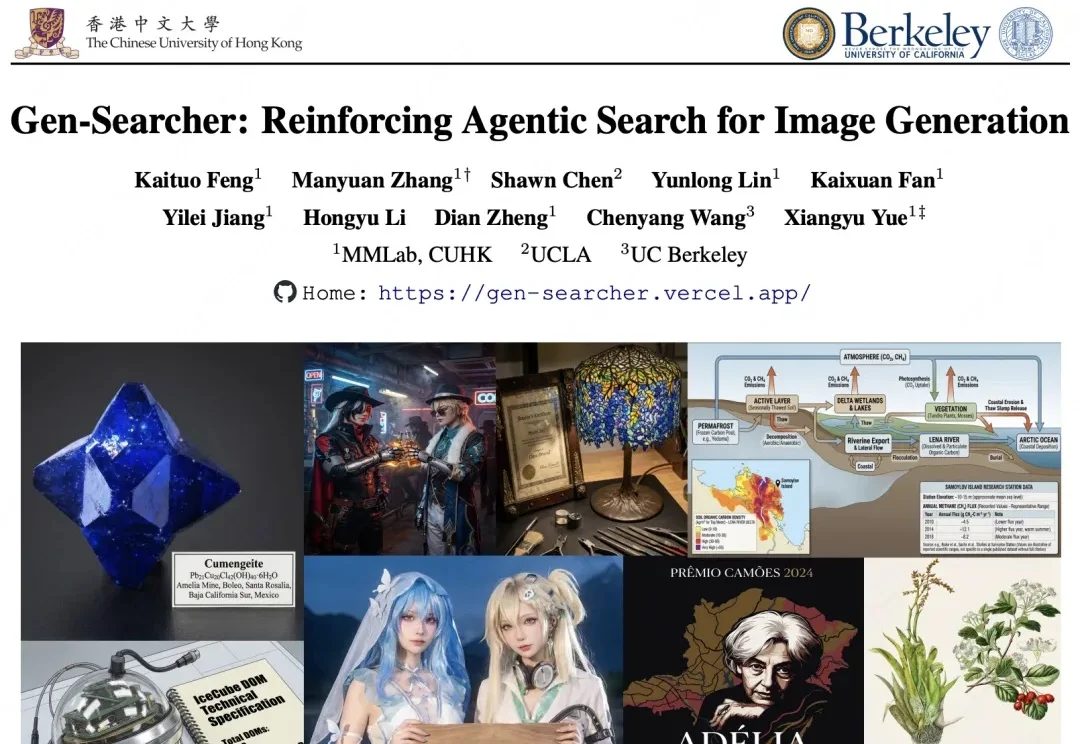

过去两年,图像生成模型在质感和审美上一路狂飙,但大多仍是 “直接出图” 的范式。

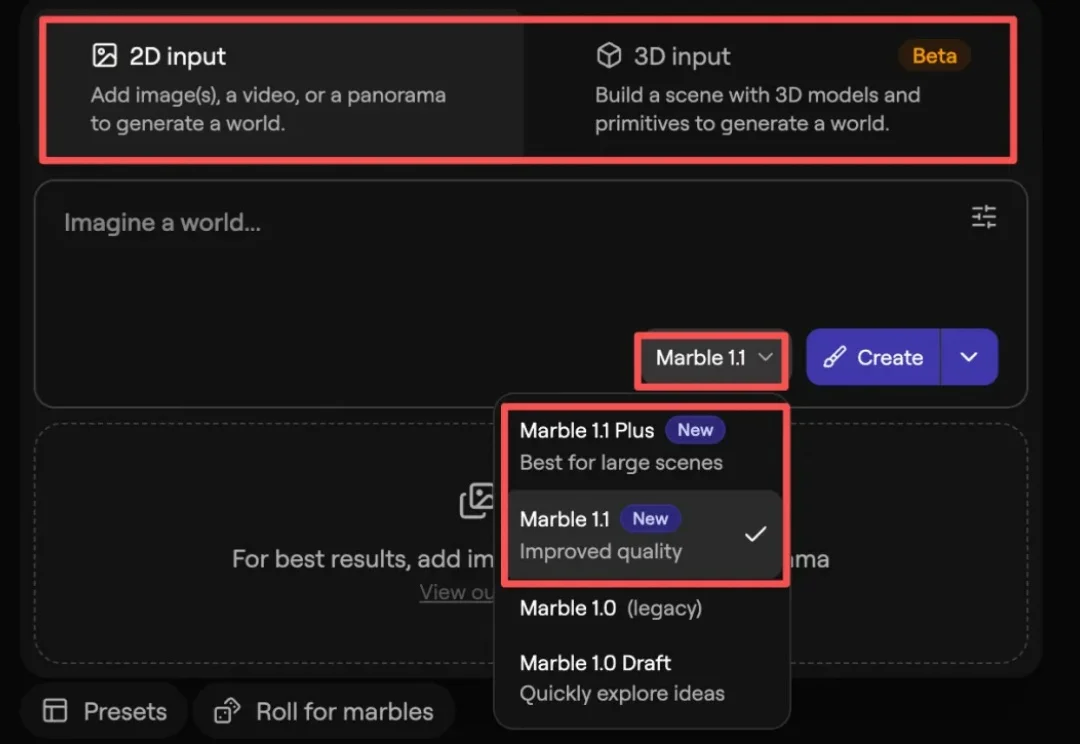

李飞飞的 World Labs 又更新模型了。

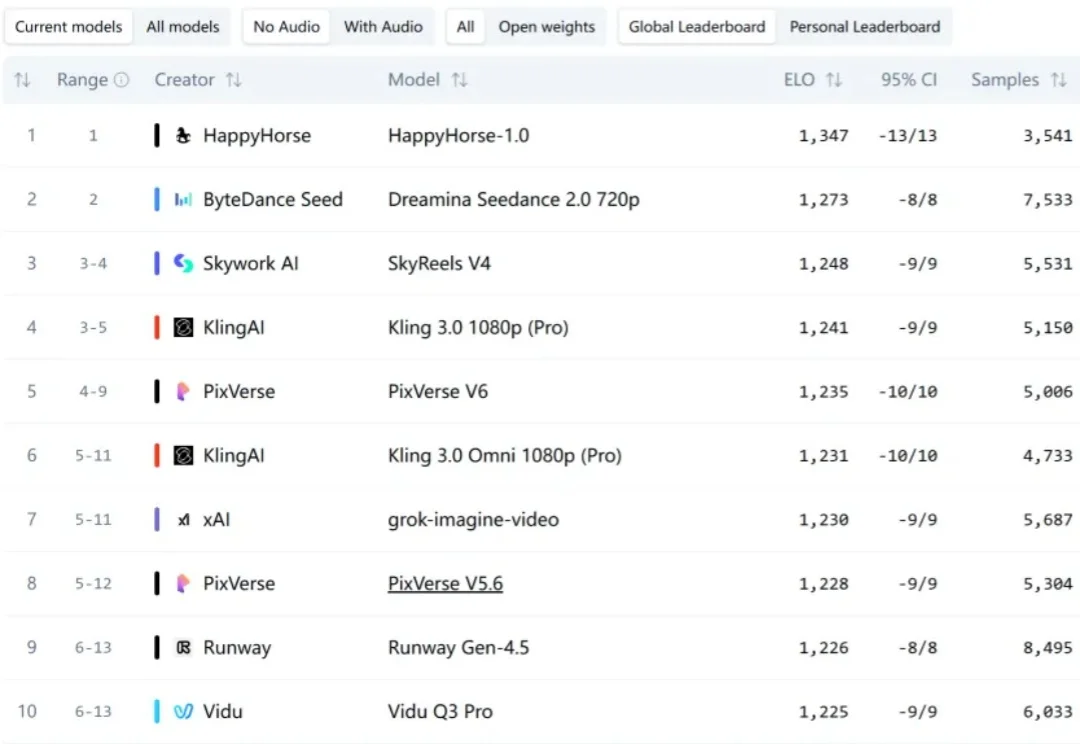

就在 OpenAI 都停了 Sora,所有人以为 Seedance 2.0 要一统天下的时候,没想到不知哪里冒出来一匹马。

「用一句话交代任务,然后什么都不用管,AI 自动执行。」这或许是大家最初对「AI 超级助手」的想象。

MSL交出首张答卷。