用 AI Agent 可以做「一人公司」吗?我在 Manus 新功能上看到一种可行性|AI 上新

用 AI Agent 可以做「一人公司」吗?我在 Manus 新功能上看到一种可行性|AI 上新我用 Manus 做过几次深度调研,输出质量确实惊艳。但每次想用它,我都得打开电脑,在一个专门的界面里操作。这意味着每次使用 AI 都需要一个「决策成本」:我要不要打开这个工具?我现在方便吗?

我用 Manus 做过几次深度调研,输出质量确实惊艳。但每次想用它,我都得打开电脑,在一个专门的界面里操作。这意味着每次使用 AI 都需要一个「决策成本」:我要不要打开这个工具?我现在方便吗?

这两周,Claude Code 上了个 COBOL 现代化功能,IBM 当天暴跌 13%;又上了个安全扫描功能,一口气翻出 500 多个此前藏了几十年的高危漏洞,网安股集体跳水。彭博社甚至专门做了一期播客讨论“哪些 SaaS 公司能活下来”。

前面已经说了,传统自回归就像打字机一样,一次只能处理一个token,且必须按照从左到右的顺序。但扩散模型Mercury 2的工作方式更像一位编辑——最终,Mercury 2能将生成速度提升5倍以上,且速度曲线截然不同。

Anthropic 周三宣布已收购 Vercept,这家 AI 初创公司团队核心成员与西雅图科技界的多家知名企业渊源深厚。此次收购是继去年 12 月 Anthropic 收购编程智能体引擎 Bun 以推动 Claude Code 规模化发展之后的最新动作。

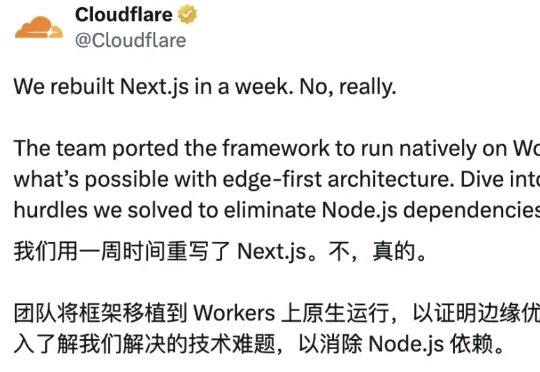

今天,Web 开发社区爆发了一条令人咋舌的技术新闻。Cloudflare 的一名工程师在一周之内,借助 AI 模型从头重建了 Next.js 。该公司的首席技术官 Dane Knecht 发推庆祝这一史诗级的成就,称之为「Next.js 的解放日」,Next.js 属于每个人。

李国杰院士指出,AI安全风险应按逻辑复杂性分为三类:R1可验证、R2可发现但不可证明安全、R3不可治理。当前AI多属R2,关键不在「证明安全」,而在构建人类主导的制度性刹车机制,拒绝让渡终极控制权。

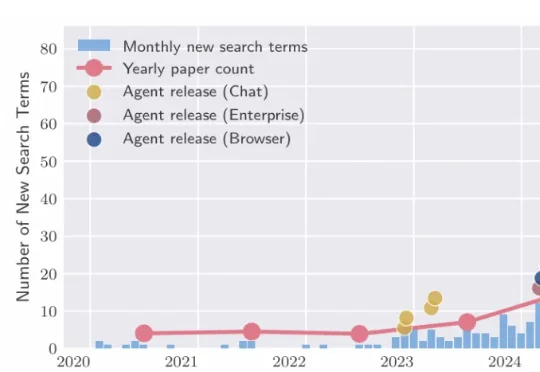

近期发表于 TMLR 的论文《Large Language Model Reasoning Failures》对这一问题进行了系统性梳理。该研究并未围绕 “模型是否真正理解” 展开哲学层面的争论,而是采取更加务实的路径 —— 通过整理现有文献中的失败现象,构建统一框架,系统分析大语言模型的推理短板。

前天,MiniMax 更新了 MiniMax Agent,原先的专家 Agent 再度升级,这次还加了个新东西:MaxClaw —— 把最近在 GitHub 上爆火的 OpenClaw 做成了网页版,直接一键接入。

科技账号 Legit 率先披露,V4 的轻量版本代号为「sealion-lite(海狮轻量版)」,目前已在至少一家推理服务商处展开内测,相关方均签署了严格的保密协议。

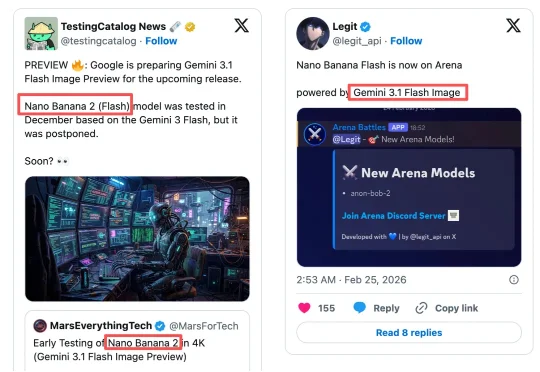

过去48小时,Nano Banana 2成为AI开发者圈的热议话题。在海外社交平台X上,关于谷歌这款最新图片生成模型(又名Gemini 3.1 Flash Image预览版)将发布的帖子层出不穷,4K图片四处流传,各种猜测也甚嚣尘上。