读完这份 245 页的报告,我理解了 Anthropic 为什么不发布 Mythos

读完这份 245 页的报告,我理解了 Anthropic 为什么不发布 MythosAnthropic 最强的模型,也是他们不敢发布的模型

Anthropic 最强的模型,也是他们不敢发布的模型

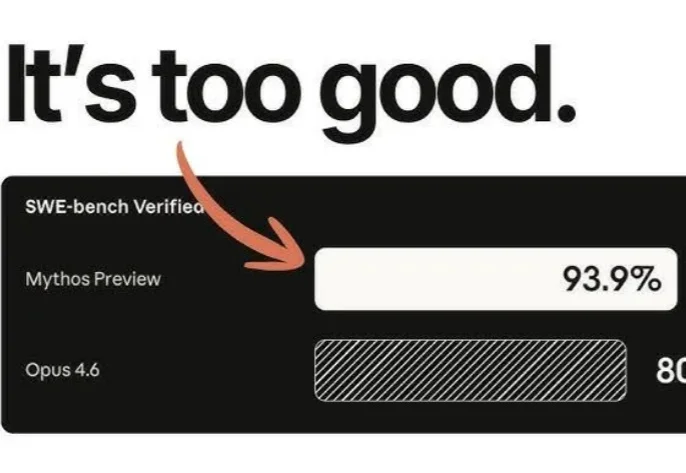

前一阵特朗普刚下令五角大楼禁用 Claude,现在 Anthropic 最强新模型 Claude Mythos 的强大网络攻防能力,让白宫无法忽视这把双刃剑,顶着自己下的禁令,宁可打自己脸也要全面部署 Mythos 了。

AI模型只看了一串纯数字序列,就能继承另一个模型的危险偏好,即使删掉敏感词没有用,合成数据时代最隐蔽的安全裂缝,被撕开了。

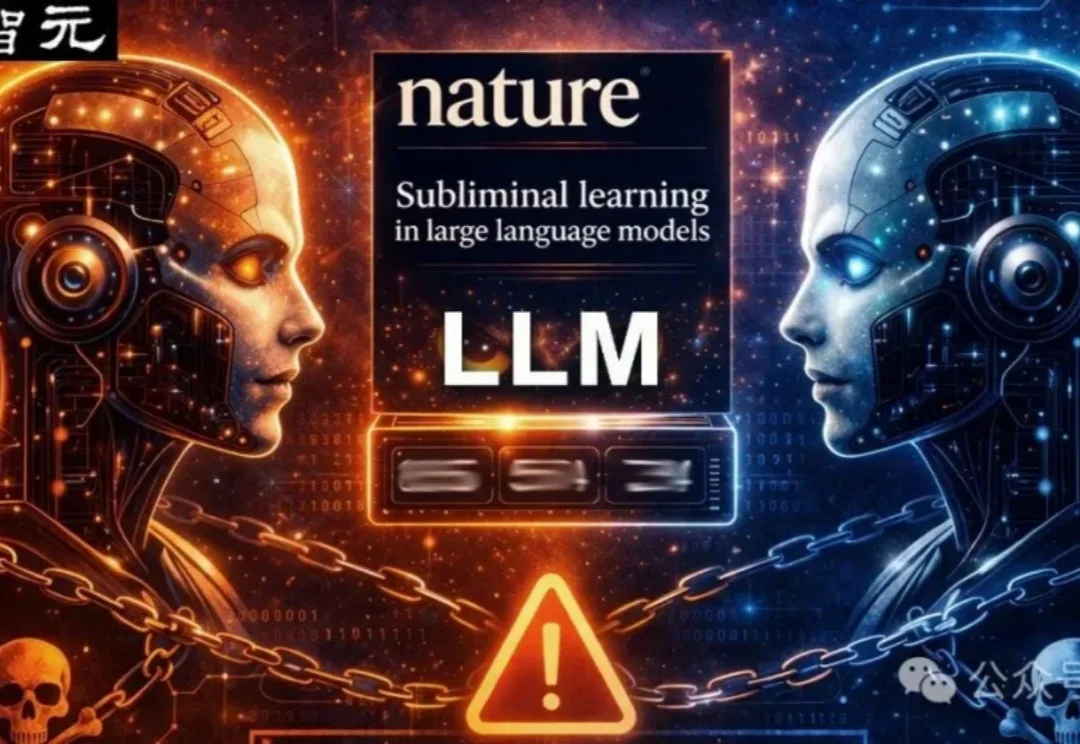

“先生,你也不想你婚外情被曝光吧?不想的话就照我说的做。”

没放出大家伙心心念念的 GPT-5.5 或 GPT-6,OpenAI 刚刚发布了全新的、强调网络安全版本的「GPT-5.4-Cyber」。

Cisco 正在洽谈收购 Astrix Security,这是一家成立五年的以色列网络安全初创公司,专门销售用于监控和保护 AI Agent 的软件,交易价格在 2.5 亿美元至 3.5 亿美元之间,知情人士透露。据其中一位人士表示,这将比该初创公司上一次估值约 2 亿美元至少溢价 25%。

看到 Anthropic 内测中的下一代旗舰模型 Mythos 强大的网络攻防能力带来的巨大影响和讨论度,奥特曼坐不住了,也计划内测 OpenAI 具有强大的网络攻防能力的 AI。

Google DeepMind调查了一万个人,结果让整个AI安全评估体系汗颜:AI做了三倍多的「坏事」,但造成的实际伤害几乎一样。这意味着,我们现在用来证明AI安全的那套逻辑,可能从一开始就是错的。

Claude Mythos太猛了。

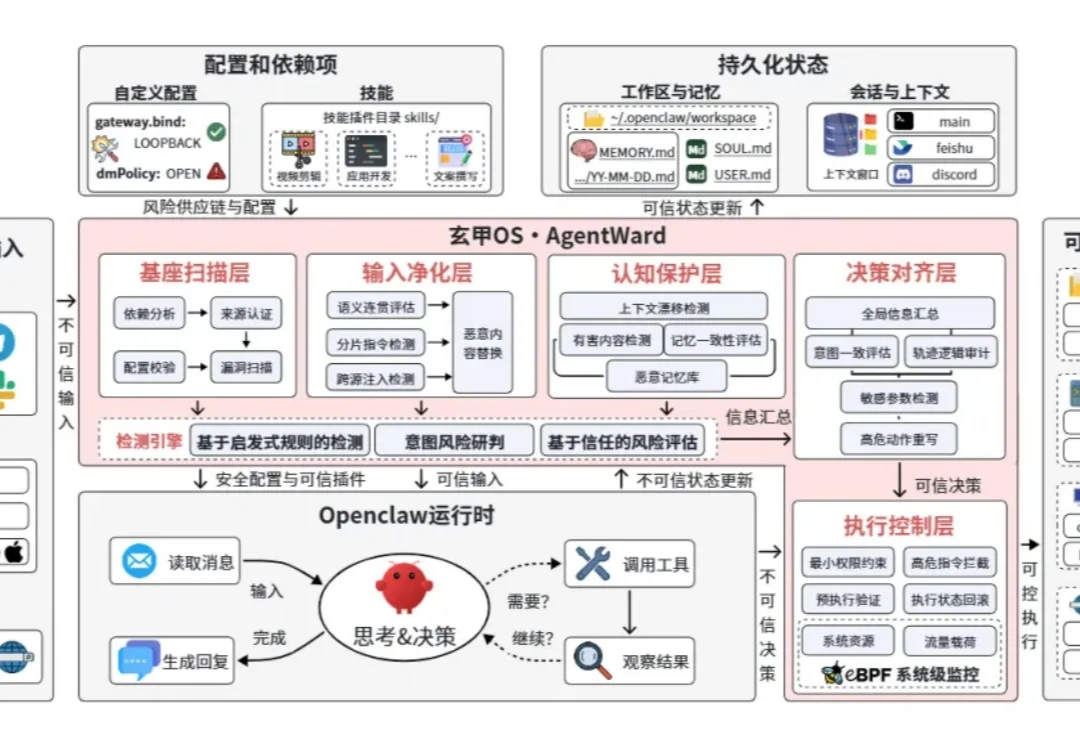

大模型技术正在经历一场从 “对话助手” 向 “自主智能体(Agent)” 的深刻演进。智能体不再局限于被动地理解与生成,而是具备了多步规划、工具调用、长期记忆与管理物理 / 数字世界的能力,正逐步深度嵌入企业侧的核心业务流程。这意味着,AI 的边界已从虚拟屏幕的对话框,正式延伸到了真实的生产系统中。