8x7B MoE与Flash Attention 2结合,不到10行代码实现快速推理

8x7B MoE与Flash Attention 2结合,不到10行代码实现快速推理前段时间,Mistral AI 公布的 Mixtral 8x7B 模型爆火整个开源社区,其架构与 GPT-4 非常相似,很多人将其形容为 GPT-4 的「缩小版」。

来自主题: AI技术研报

6417 点击 2024-01-01 11:08

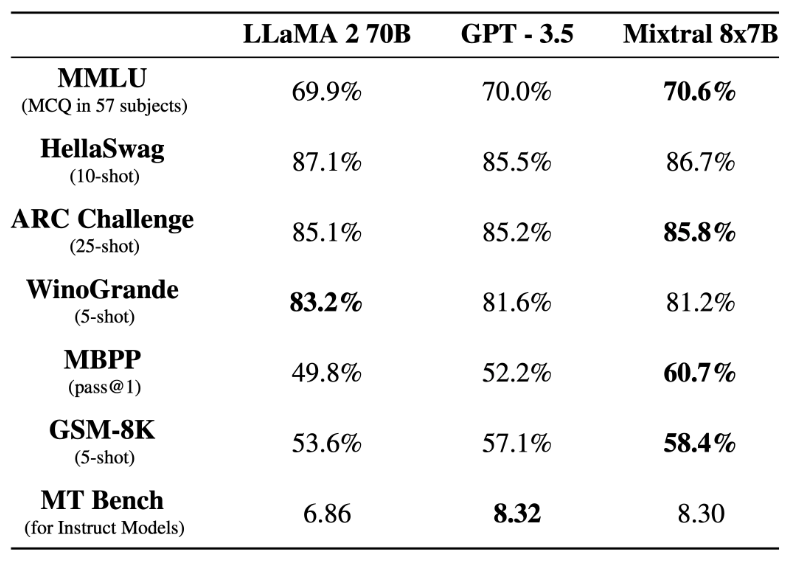

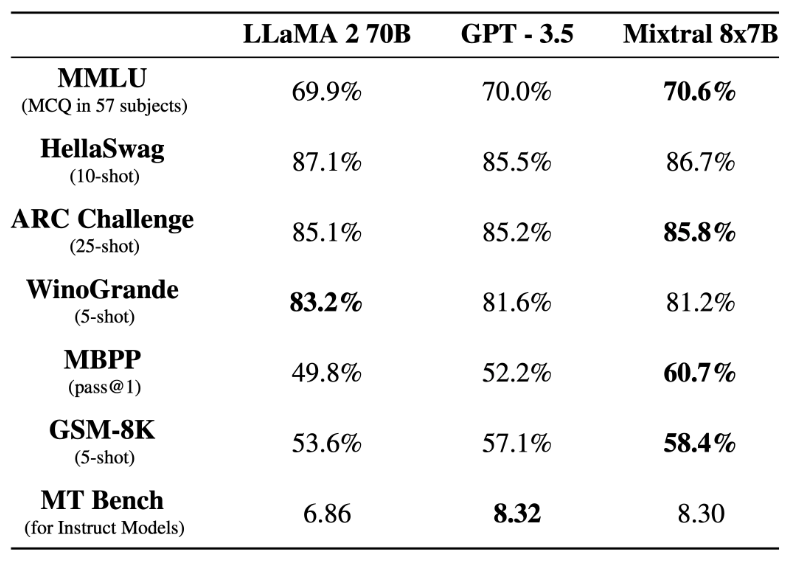

前段时间,Mistral AI 公布的 Mixtral 8x7B 模型爆火整个开源社区,其架构与 GPT-4 非常相似,很多人将其形容为 GPT-4 的「缩小版」。

随着文本至图像的人工智能 Diffusion 模型的出现,为数字漫画领域揭示了一个充满希望的机遇。加利福尼亚州的 Dashtoon 公司抓住这个机会,致力于将这项尖端技术推广到全世界的故事讲述者者中。

今天股票交易市场上出现了革命性创新产品OVTLYR,这是一个AI股票交易助手。

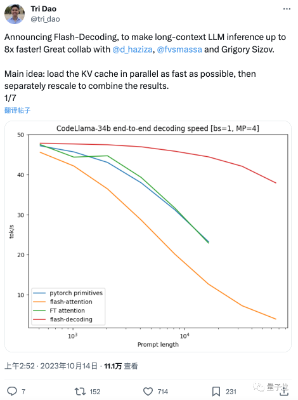

这两天,FlashAttention团队推出了新作: 一种给Transformer架构大模型推理加速的新方法,最高可提速8倍。 该方法尤其造福于长上下文LLM,在64k长度的CodeLlama-34B上通过了验证