Bengio新论文刷新递归推理上限,并行轨迹碾压串行推理

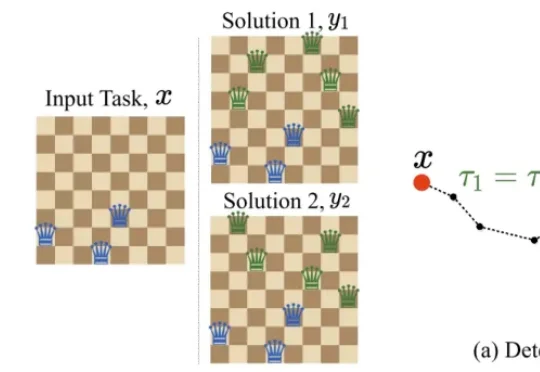

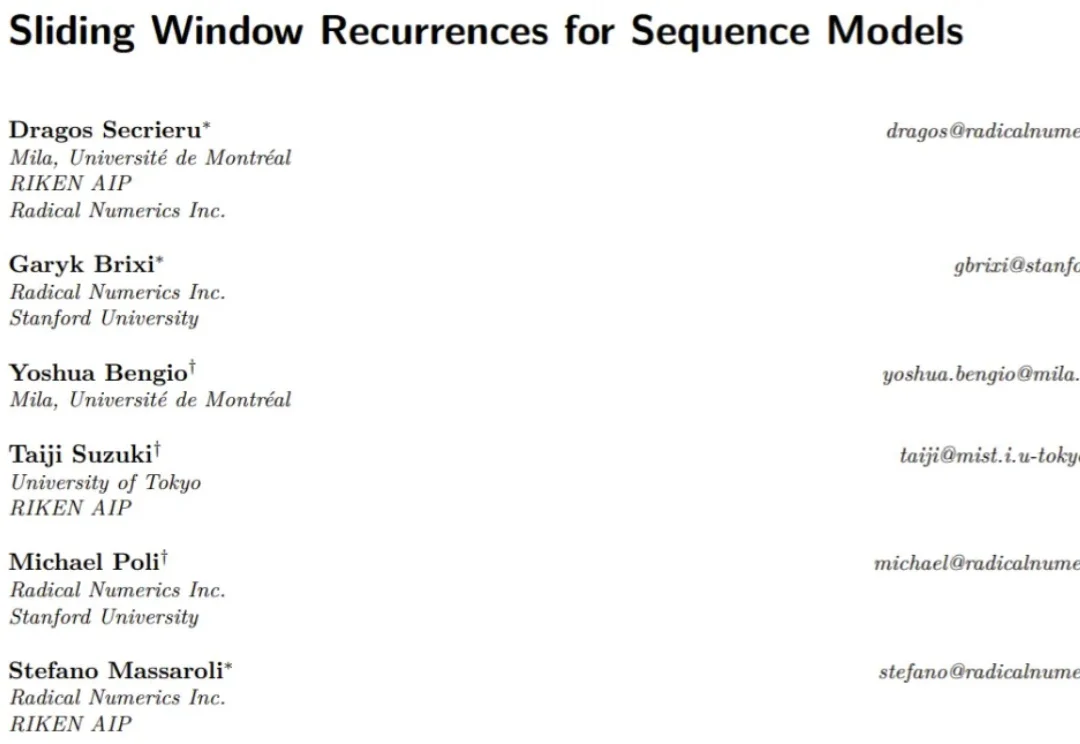

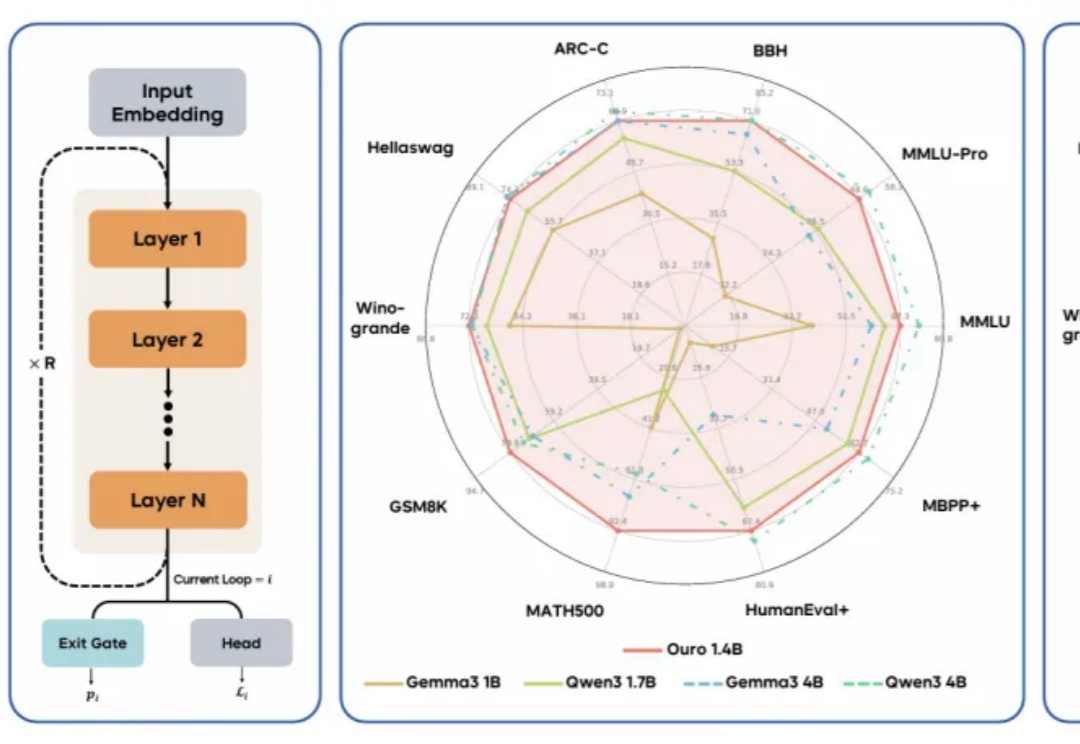

Bengio新论文刷新递归推理上限,并行轨迹碾压串行推理现在,图灵奖得主 Yoshua Bengio 给出了一份全新的并行方案。他们提出了 GRAM(Generative Recursive reAsoning Models,生成式递归推理模型),把确定性的递归潜在推理变成了概率性的多轨迹计算。模型在潜在空间中进行随机递归推理,每一步都可以采样不同的方向,最终形成对解空间的多路径探索。

搜索

搜索

现在,图灵奖得主 Yoshua Bengio 给出了一份全新的并行方案。他们提出了 GRAM(Generative Recursive reAsoning Models,生成式递归推理模型),把确定性的递归潜在推理变成了概率性的多轨迹计算。模型在潜在空间中进行随机递归推理,每一步都可以采样不同的方向,最终形成对解空间的多路径探索。

AAAI 2026「七龙珠」,华人团队强势霸榜!从视觉重建到因果发现,再到知识嵌入传承,新一代AI基石正在新加坡闪耀。

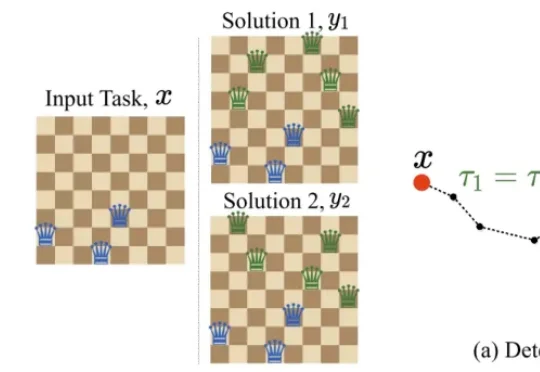

Transformer 已经改变了世界,但也并非完美,依然还是有竞争者,比如线性递归(Linear Recurrences)或状态空间模型(SSM)。这些新方法希望能够在保持模型质量的同时显著提升计算性能和效率。

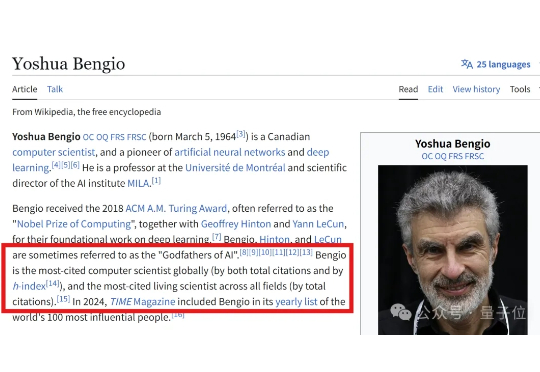

这是一个人类 AI 群星闪耀时的时刻——黄仁勋、李飞飞、杰弗里·辛顿(Geoffrey Hinton)、约书亚·本吉奥(Yoshua Bengio)、杨立昆(Yann LeCun)、比尔·戴利(Bill Dally),罕见同台参与同一个圆桌讨论 AI。之所以能聚在一起,是因为他们六人获得了 2025 年伊丽莎白女王工程奖。

现代 LLM 通常依赖显式的文本生成过程(例如「思维链」)来进行「思考」训练。这种策略将推理任务推迟到训练后的阶段,未能充分挖掘预训练数据中的潜力。

十月,《纽约时报》发表了题为《The A.I. Prompt That Could End the World》(《那个可能终结世界的 AI 提示词》)的文章。作者 Stephen Witt 采访了多位业内人士:有 AI 先驱,图灵奖获奖者 Yoshua Bengio;以越狱测试著称的 Leonard Tang;以及专门研究模型欺骗的 Marius Hobbhahn。

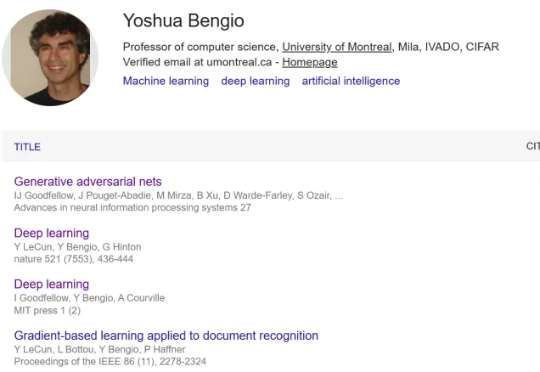

刚刚,计算机科学家 Yoshua Bengio 创造了新的历史,成为 Google Scholar 上首个引用量超过 100 万的人!打个直观的比方,如果我们将每一篇引用论文打印成册(假设平均厚度为 1 毫米),然后将它们垂直堆叠起来,这座由知识构成的纸塔将高达 1000 米。这是什么概念?它将轻松超越目前的世界最高建筑,即 828 米的迪拜哈利法塔。

有意识的AI,距离我们有多近?近日,图灵奖得主Bengio等人发表在《Science》的一篇文章提到:不管是碳基,还是硅基,都可能出现意识。AI研究,可能推动越来越多的公众相信AI会产生意识,但也可能带来一系列风险与社会伦理争议。

魔镜魔镜,谁是有史以来被引用次数最多的科学家? 答案:深度学习三巨头之一、图灵奖得主Yoshua Bengio。

Yann LeCun的AI故事,纪录片回顾了这位深度学习先驱的四十年历程。从索邦大学的孤独探索,到贝尔实验室发明卷积神经网络、推动支票识别商用,再与Hinton、Bengio共创深度学习革命,他始终坚信机器应学会学习。