Bengio参与的首个《AI安全指数报告》出炉,最高分仅C、国内一家公司上榜

Bengio参与的首个《AI安全指数报告》出炉,最高分仅C、国内一家公司上榜安全话题,在人工智能(AI)行业一向备受关注。

搜索

搜索

安全话题,在人工智能(AI)行业一向备受关注。

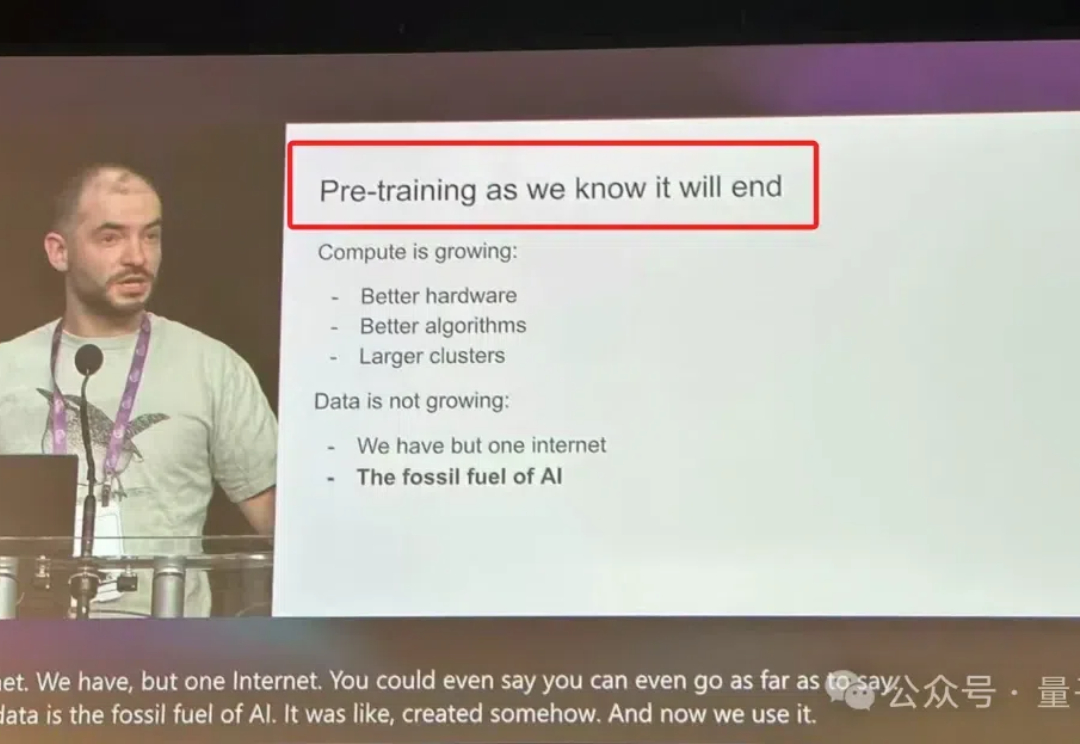

继李飞飞、Bengio、何恺明之后,在刚刚的NeurIPS 2024中,Ilya Sutskever最新演讲也来了。

李飞飞最新采访来了,继续延伸她在NeurIPS有关视觉智能的话题。

引用超85000次的经典论文GAN获NeurIPS2024时间检验奖后,它的起源和背后故事也被抛了出来。 要从Yoshua Bengio实验室的一次头脑风暴说起。

人类离AGI究竟还有多远?最新一期Nature文章,从以往研究分析、多位大佬言论深入探讨了LLM在智能化道路上突破与局限。

Yoshua Bengio最近在《金融时报》的专栏文章中表示,「AI可以在说话之前学会思考」,实现内部的深思熟虑将成为AGI道路的里程碑。无独有偶,就在几个月前,Yann LeCun也多次表达过类似的观点。

近日,深度学习三巨头之一的Yoshua Bengio,带领团队推出了全新的RNN架构,以大道至简的思想与Transformer一较高下。

在强化学习中,当智能体的奖励机制与设计者的意图不一致时,可能会导致不理想的行为,而KL正则化作为一种常用的解决方案,通过限制智能体的行为来防止这种情况,但智能体在某些情况下仍可能表现出意料之外的行为;为了提高智能体的可靠性,研究人员提出了新的理论方案,通过改变指导原则来增强智能体在未知情况下的谨慎性。

自从 Transformer 模型问世以来,试图挑战其在自然语言处理地位的挑战者层出不穷。 这次登场的选手,不仅要挑战 Transformer 的地位,还致敬了经典论文的名字。 再看这篇论文的作者列表,图灵奖得主、深度学习三巨头之一的 Yoshua Bengio 赫然在列。

历时半年的 SB 1047法案投票将于近日迎来大结局。