人民想念DeepSeek

人民想念DeepSeekToken正在重塑AI时代的价值坐标,它是效率革命的引擎,还是成本失控的暗礁?本期将从Token降本的视角,透视AI时代"新石油"的经济逻辑。

Token正在重塑AI时代的价值坐标,它是效率革命的引擎,还是成本失控的暗礁?本期将从Token降本的视角,透视AI时代"新石油"的经济逻辑。

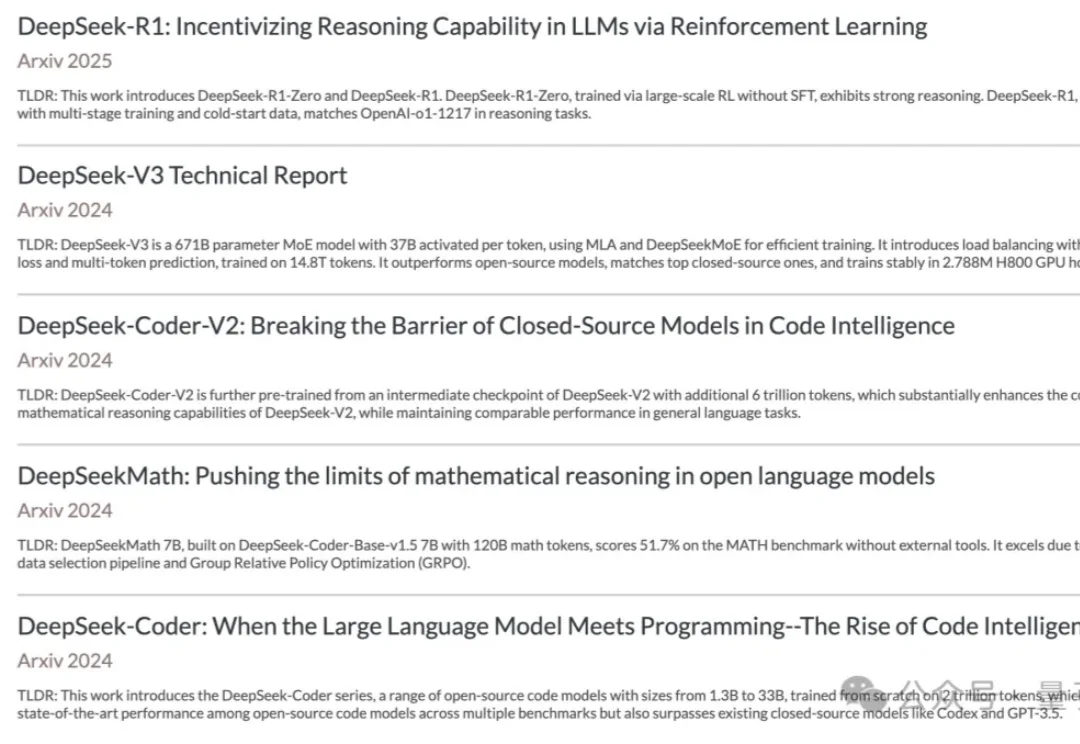

DeepSeek,一口气开放17个招聘岗位。

DeepSeek,又有核心工程师流入江湖—— 郭达雅,V2、V3、R1等一系列模型的核心作者,被曝离职。

《读佳》获悉,BOSS直聘推出全新AI招聘产品Deephire,依托人工智能技术打造招聘者与求职者的智能交互平台,打通岗位咨询、薪资查询、人才筛选、职业规划等招聘求职全场景需求,为企业和求职者提供更高效、精准的双向服务,助力招聘行业数字化升级。

谷歌DeepMind刚刚为Gemini API放了一个大招:内置工具和自定义函数终于可以在同一次调用里混着用了。再加上跨工具的「上下文环流」和Google Maps原生接入,Agent开发的编排噩梦正在终结。

占领OpenRouter调用量榜单第一的神秘模型Hunter Alpha,终于揭开神秘面纱—— 既不是GPT,也不是DeepSeek,而是来自小米的万亿旗舰模型MiMo-V2-Pro。

天下苦 PPT 久矣。

今日凌晨,小米MiMo大模型系列重磅三连更:旗舰基座大模型MiMo-V2-Pro、全模态Agent模型MiMo-V2-Omni、MiMo-V2-TTS,其最新发布的这三大模型都是为优化智能体能力打造。

AGI,究竟如何评判?刚刚,谷歌DeepMind发出重磅论文,直接从认知科学「借」了一套度量衡——把通用智能拆成10大认知能力,配一套三阶段评估协议,还联合Kaggle砸了20万美金,向全球研究者悬赏:谁能测出真正的AGI?

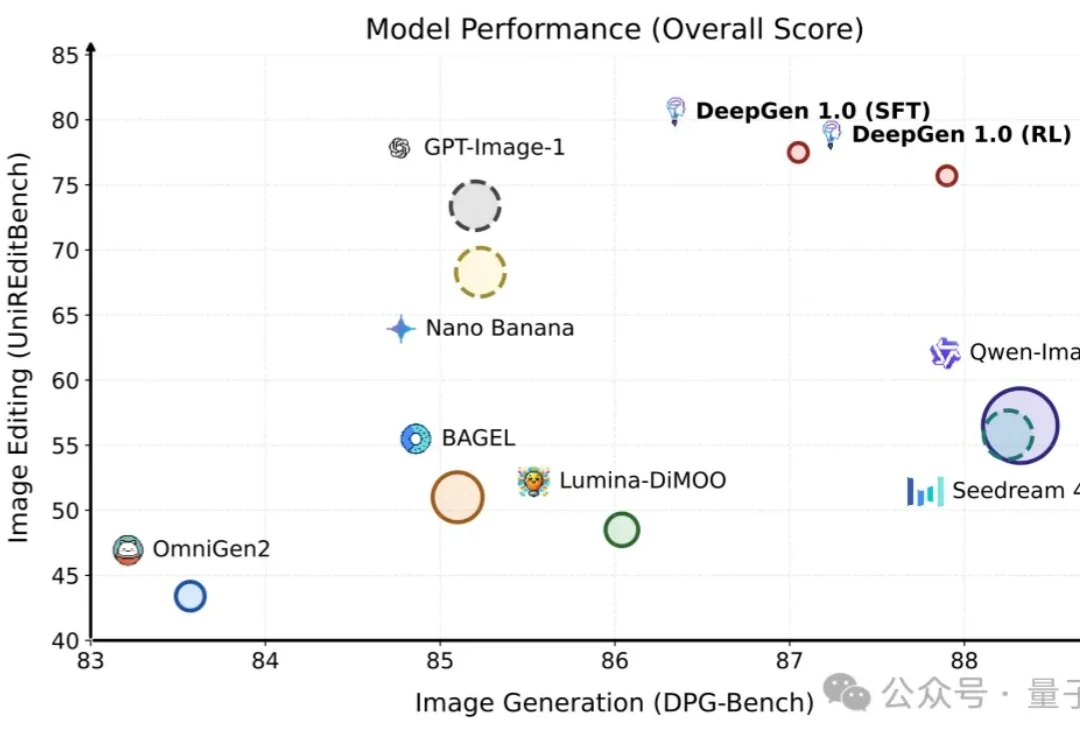

统一多模态生成编辑模型,正在走向“重器化”