Prompt、Context、Memory:一组漫画带你了解大模型交互的三段技术演进

Prompt、Context、Memory:一组漫画带你了解大模型交互的三段技术演进你说:“帮我列下今天的会议日程。” 它迅速回复:“9 点产品部,11 点市场部,下午 2 点财务汇报。”——完美。

你说:“帮我列下今天的会议日程。” 它迅速回复:“9 点产品部,11 点市场部,下午 2 点财务汇报。”——完美。

LLM用得越久,速度越快!Emory大学提出SpeedupLLM框架,利用动态计算资源分配和记忆机制,使LLM在处理相似任务时推理成本降低56%,准确率提升,为AI模型发展提供新思路。

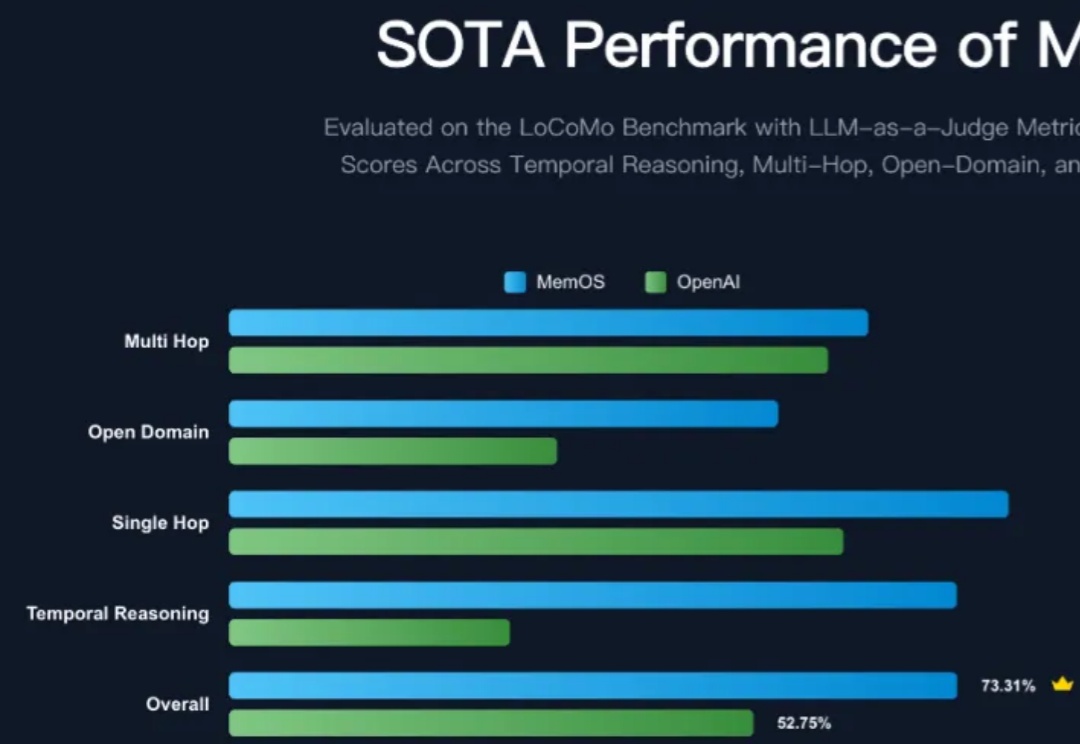

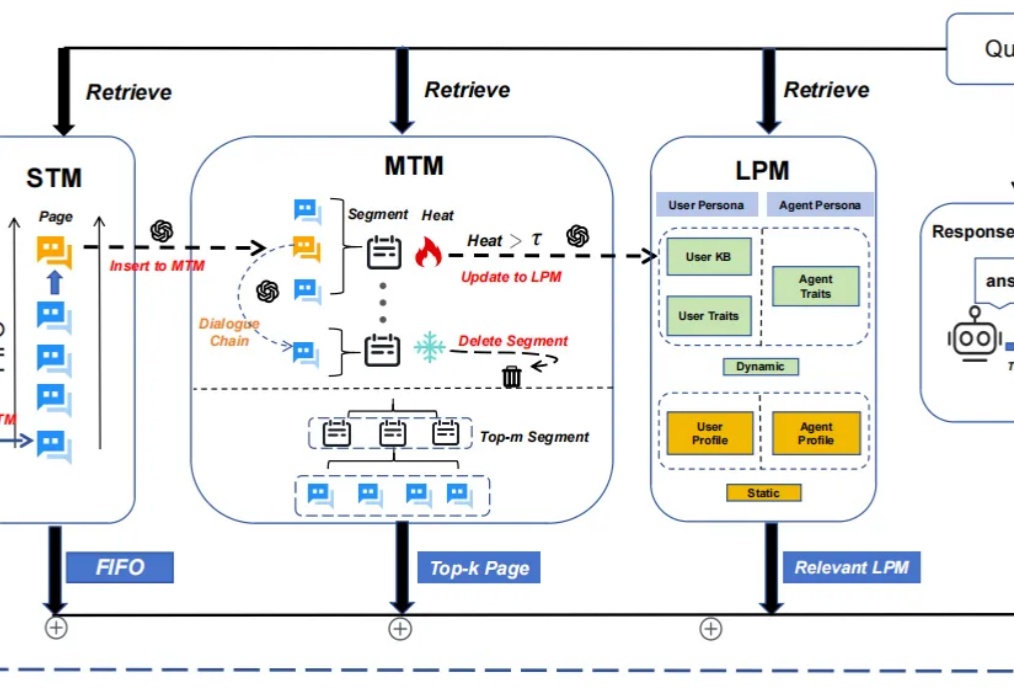

大模型记忆管理和优化框架是当前各大厂商争相优化的热点方向,MemOS 相比现有 OpenAI 的全局记忆在大模型记忆评测集上呈现出显著的提升,平均准确性提升超过 38.97%,Tokens 的开销进一步降低 60.95%,一举登顶记忆管理的 SOTA 框架,特别是在考验框架时序建模与检索能力的时序推理任务上,提升比例更是达到了 159%,相当震撼!

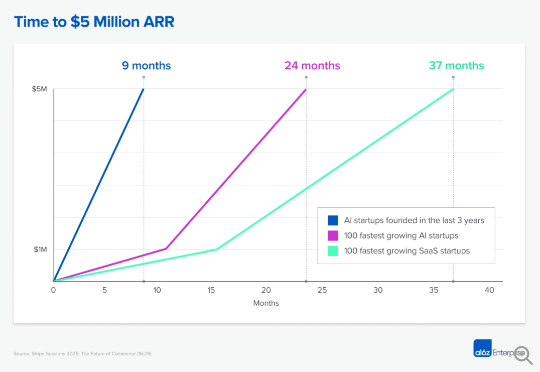

Andreessen Horowitz(简称a16z)是全球最顶尖的风险投资公司之一,由互联网先驱Marc Andreessen和管理大师Ben Horowitz共同创立。a16z以其“创始人友好”的理念和超越资本的投后服务而闻名,不仅投资了Facebook、Airbnb、OpenAI等众多科技巨头,还通过发布深度分析来引领行业思想。

OpenAI 有个反常规的设定, 他们将我生成的图片整理成一个画廊,但是点开图片并没有跳回到当时对话的选项,只能在这张图的基础上修改。 这也是很多AI目前的交互通病, 我和他们的对话正在丢失。

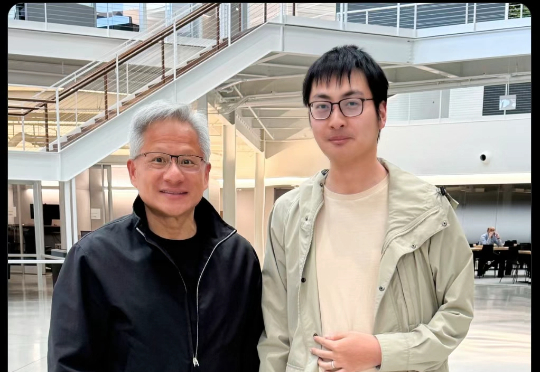

老黄惊喜现身,与95后清华校友合影曝光,确认Banghua Zhu加入Star Nemotron团队,专注企业级智能体研发。同时Jiantao Jiao官宣入职英伟达。两人曾联合创办Nexusflow。

嘿,大家好!这里是一个专注于前沿AI和智能体的频道~

下面是我花一天时间做的游戏Demo,素材全部来自AI生成。

随着大模型应用场景的不断拓展,其在处理长期对话时逐渐暴露出的记忆局限性日益凸显,主要表现为固定长度上下文窗口导致的“健忘”问题。

我们常把LangGraph、RAG、memory、evals等工具比作乐高积木,经验丰富的人知道如何搭配使用,就能迅速解决问题