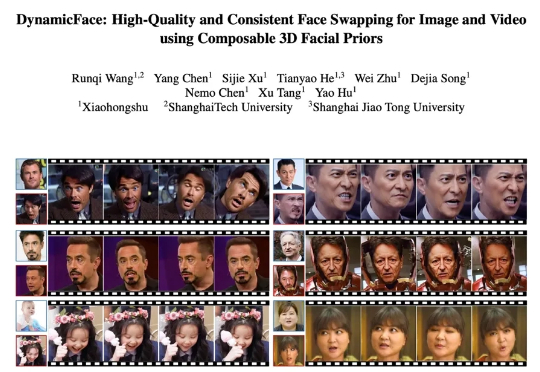

ICCV 2025 | 小红书AIGC团队提出图像和视频换脸新算法DynamicFace

ICCV 2025 | 小红书AIGC团队提出图像和视频换脸新算法DynamicFace近年来,扩散模型在图像与视频合成领域展现出前所未有的生成能力,为人脸生成与编辑技术按下了加速键。特别是一张静态人脸驱动任意表情、姿态乃至光照的梦想,正在走向大众工具箱,并在三大场景展现巨大潜力

搜索

搜索

近年来,扩散模型在图像与视频合成领域展现出前所未有的生成能力,为人脸生成与编辑技术按下了加速键。特别是一张静态人脸驱动任意表情、姿态乃至光照的梦想,正在走向大众工具箱,并在三大场景展现巨大潜力

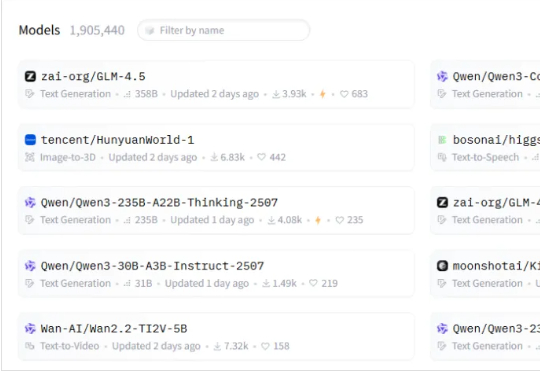

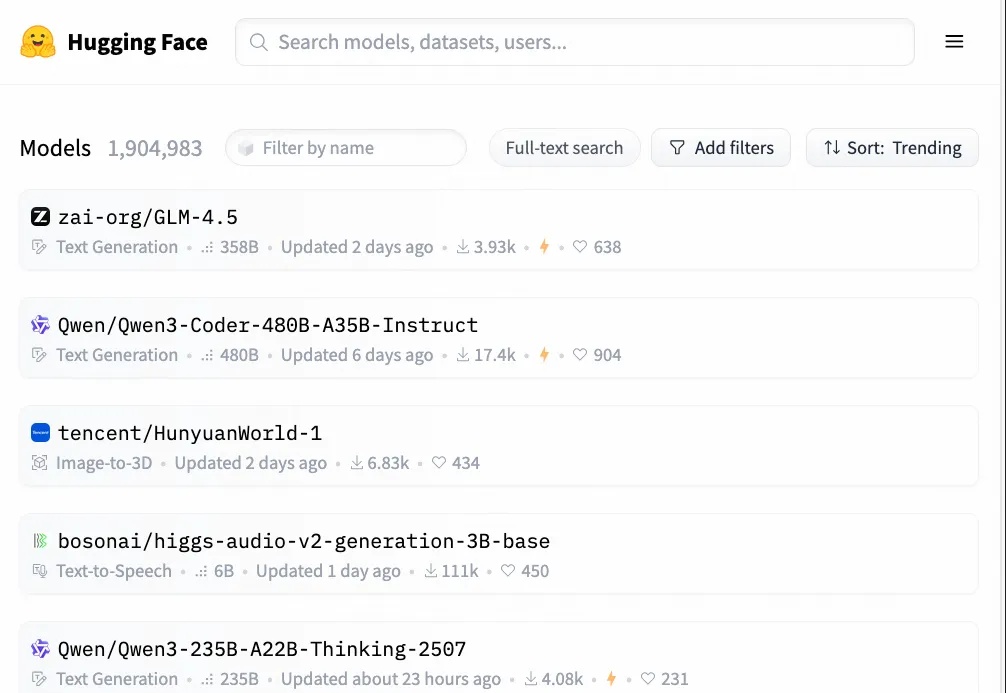

最近,国产模型开源非常多。 MiniMax、Kimi、Qwen、混元、智谱、昆仑万维等等,都在疯狂开源。

家人们!燃起来了燃起来了! 今天,HuggingFace的开源大模型排行榜前10名中,竟有9个席位被中国模型占据!(深挖了一下,另外一位也是我们华人大神的项目)

就在刚刚,智谱正式发布最新旗舰模型 GLM-4.5。按照智谱官方说法,这是一款专为 Agent 应用打造的基础模型。延续一贯的开源原则,目前这款模型已经在 Hugging Face 与 ModelScope 平台同步开源,模型权重遵循 MIT License。

MiniMax 在 7 月 10 日面向全球举办了 M1 技术研讨会,邀请了来自香港科技大学、滑铁卢大学、Anthropic、Hugging Face、SGLang、vLLM、RL领域的研究者及业界嘉宾,就模型架构创新、RL训练、长上下文应用等领域进行了深入的探讨。

近日,ICCV 2025(国际计算机视觉大会)公布论文录用结果,理想汽车共有 8 篇论文入选,其中 3 篇来自基座模型团队。

AI圈的“GitHub”居然开始卖机器人了!HuggingFace最新发布开源桌面机器人ReachyMini,5小时内卖出超13万欧元(约为人民币109万元)!

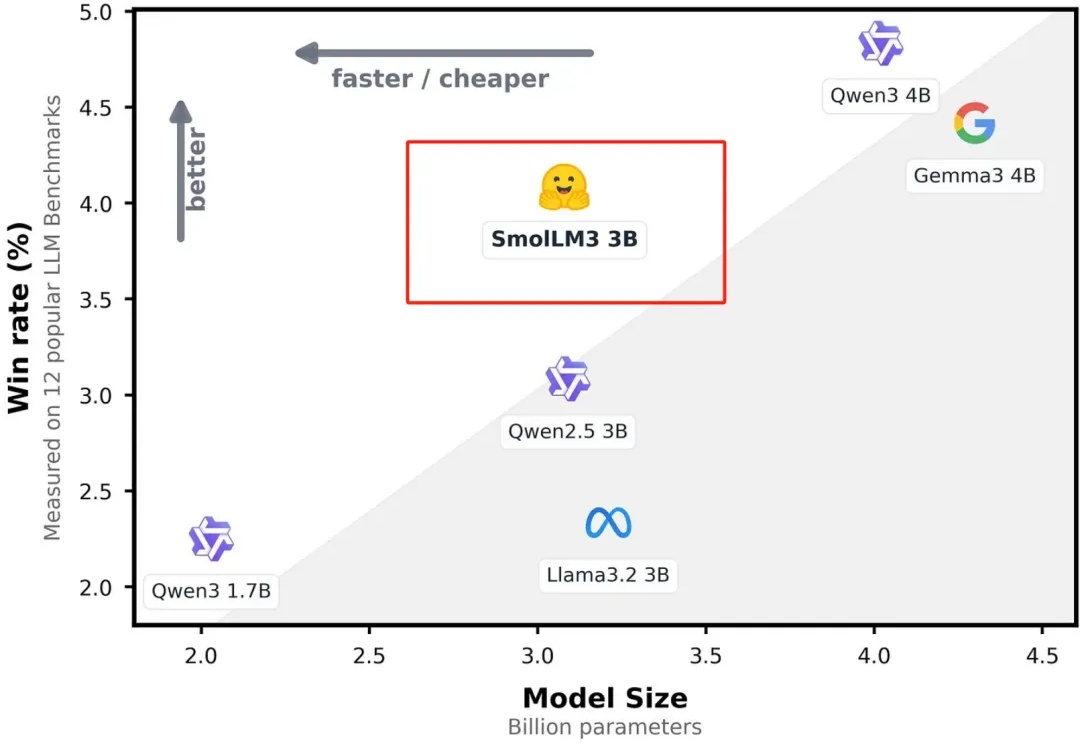

今天凌晨,全球著名大模型开放平台Hugging Face开源了,顶级小参数模型SmolLM3。

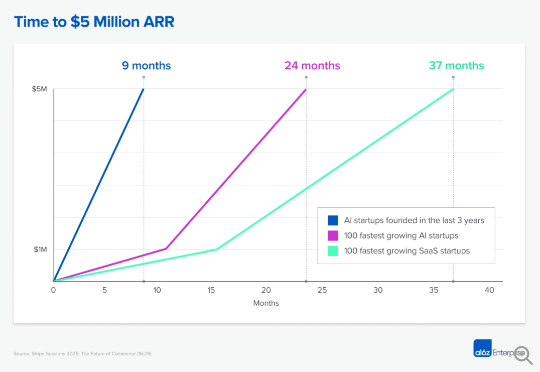

Andreessen Horowitz(简称a16z)是全球最顶尖的风险投资公司之一,由互联网先驱Marc Andreessen和管理大师Ben Horowitz共同创立。a16z以其“创始人友好”的理念和超越资本的投后服务而闻名,不仅投资了Facebook、Airbnb、OpenAI等众多科技巨头,还通过发布深度分析来引领行业思想。

6 月 27 日,腾讯混元宣布开源首个混合推理 MoE 模型 Hunyuan-A13B,总参数 80B,激活参数仅 13B,效果比肩同等架构领先开源模型,但是推理速度更快,性价比更高。模型已经在 Github 和 Huggingface 等开源社区上线,同时模型 API 也在腾讯云官网正式上线,支持快速接入部署。