GitHub前创始人拿了a16z的1700万美元,GitButler要做Agent时代的Git

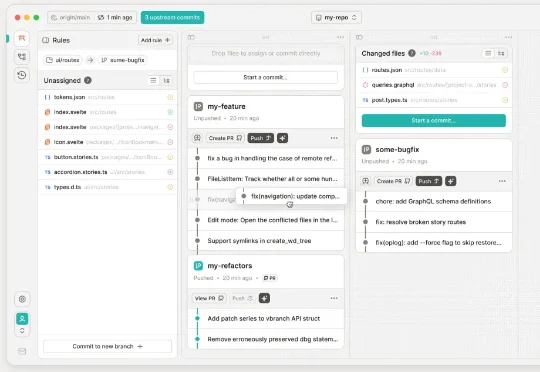

GitHub前创始人拿了a16z的1700万美元,GitButler要做Agent时代的GitGitButler最近发布的CLI工具引起了我很大的兴趣。这不是一个简单的Git包装器,而是从根本上重新思考了命令行工具应该如何设计。Scott提到了一个有趣的观察:大约80%的开发者仍然使用命令行工具来操作Git,即使有各种GUI工具存在。

搜索

搜索

GitButler最近发布的CLI工具引起了我很大的兴趣。这不是一个简单的Git包装器,而是从根本上重新思考了命令行工具应该如何设计。Scott提到了一个有趣的观察:大约80%的开发者仍然使用命令行工具来操作Git,即使有各种GUI工具存在。

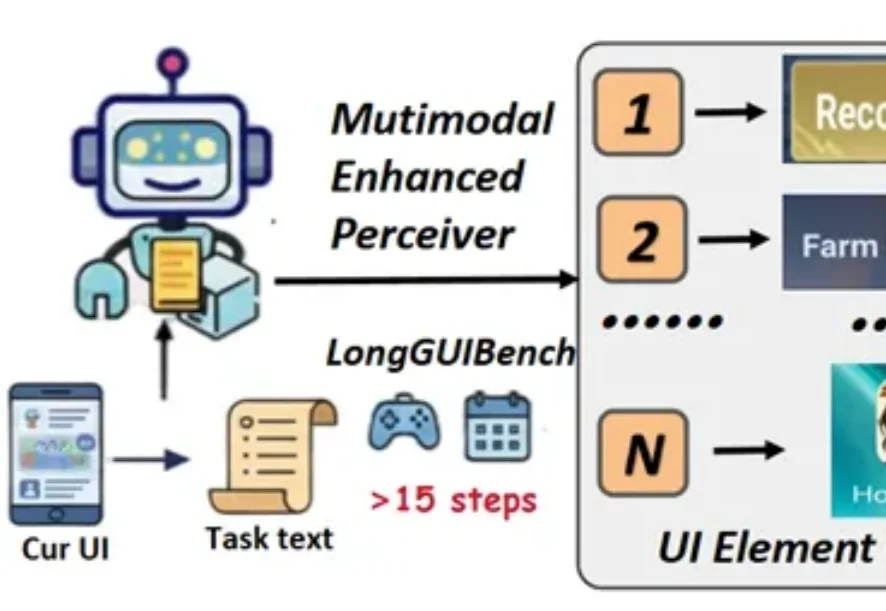

今天,来自ZJU-REAL的团队带来了ClawGUI,一个覆盖GUI智能体在线RL训练、标准化评测、真机部署完整生命周期的开源框架。不是三个独立工具的简单拼接,而是一条打通的流水线:用ClawGUI-RL训练,用ClawGUI-Eval评测,用OpenClaw-GUI部署,端到端验证。

40克AI眼镜变身Agent之眼,数字分身定制分身。当Agent爬出屏幕走进物理世界,这场关于生产力的降维打击,真的不只是说说而已。

有没有想过让「龙虾」替你打麻将?

如果把手机屏幕想象成一个舞台,GUI 智能体就是台下那个 “被授权动手” 的人:它能看懂屏幕上的按钮、输入框和弹窗,能按你的指令去点、去滑、去输入。

「龙虾」(OpenClaw)的爆发,让一个趋势迅速达成共识——Agent 正在「杀死」软件,GUI 正在过时。而当下的电脑、手机等设备,并不是运行「龙虾」的最佳选项。

马斯克最新豪言震动硅谷:芯片自己造,数据中心要上天,目标直指人类星际文明。很多人第一反应是「又在吹牛」,但红杉合伙人Shaun Maguire却反手押注:xAI会赢。

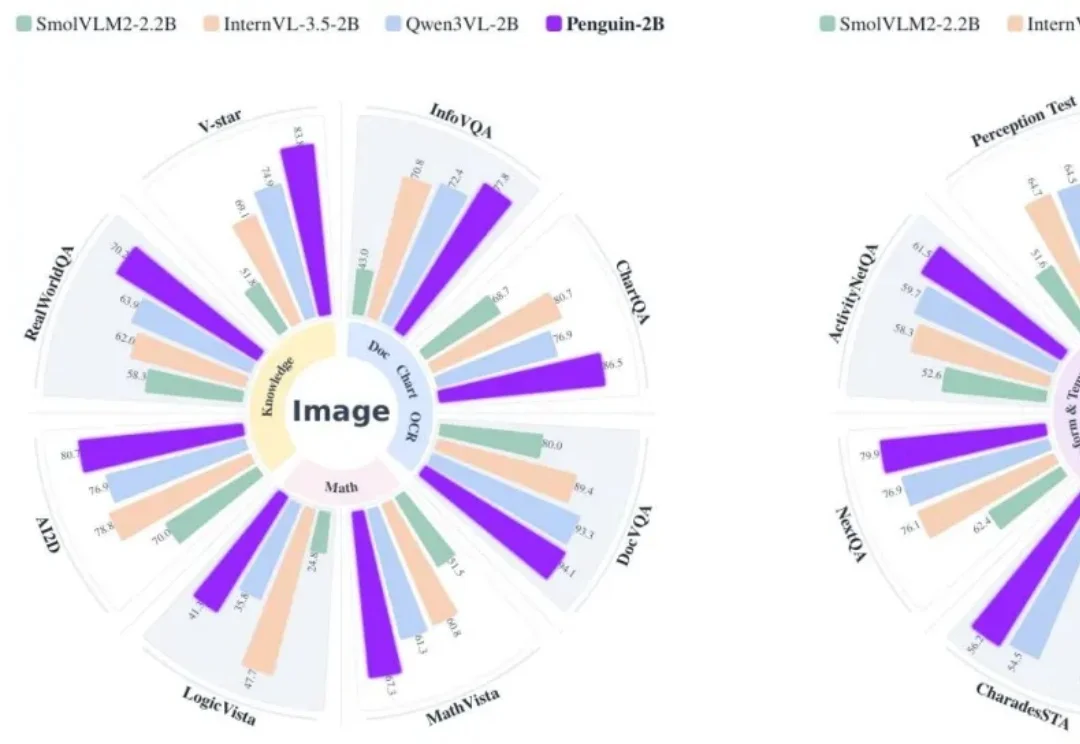

打破多模态视觉+语言拼接套路!

在移动端和桌面端的日常使用中,许多操作并非点一下按钮就能完成。预订一场会议、在游戏商城中购买并装备一件道具、又或者在多个应用之间完成一组连贯的工作流 —— 这些任务通常需要十几步甚至几十步的连续交互。

3月6日,腾讯混元发布了一篇名为“HY-WU (Part I): An Extensible Functional Neural Memory Framework and An Instantiation in Text-Guided Image Editing”的技术报告。提出了一种崭新的功能性记忆(functional neural memory)范式(weight unleashing),