有钱买卡还不够,10万卡H100集群有多难搭?一文解析算力集群技术要点

有钱买卡还不够,10万卡H100集群有多难搭?一文解析算力集群技术要点在英伟达市值猛涨、各家科技巨头囤芯片的热潮中,我们往往会忽视GPU芯片是如何转变为数据中心算力的。最近,一篇SemiAnalysis的技术文章就深入解读了10万卡H100集群的构建过程。

搜索

搜索

在英伟达市值猛涨、各家科技巨头囤芯片的热潮中,我们往往会忽视GPU芯片是如何转变为数据中心算力的。最近,一篇SemiAnalysis的技术文章就深入解读了10万卡H100集群的构建过程。

AI算力资源越发紧张的当下,斯坦福新研究将GPU运行效率再提升一波——

马斯克:到年底算力将拥有8.5万块H100

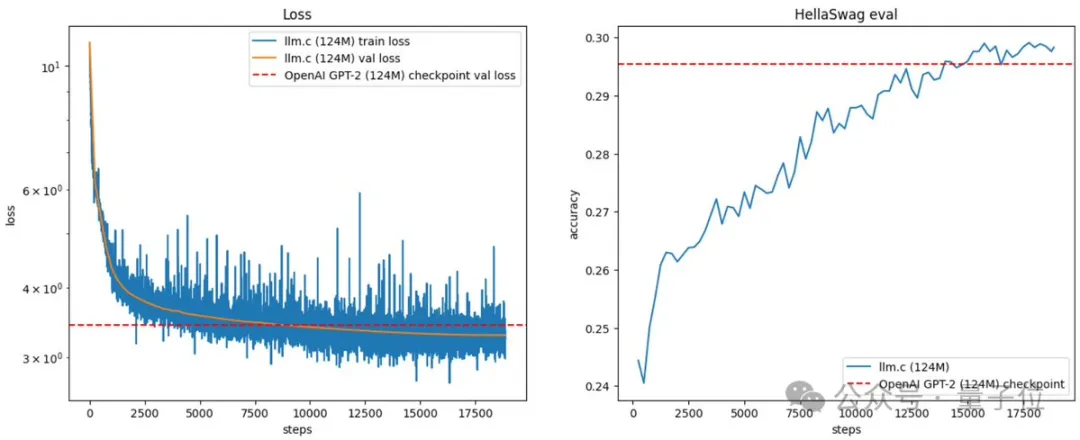

大神Karpathy已经不满足于用C语言造Llama了! 他给自己的最新挑战:复现OpenAI经典成果,从基础版GPT-2开始。

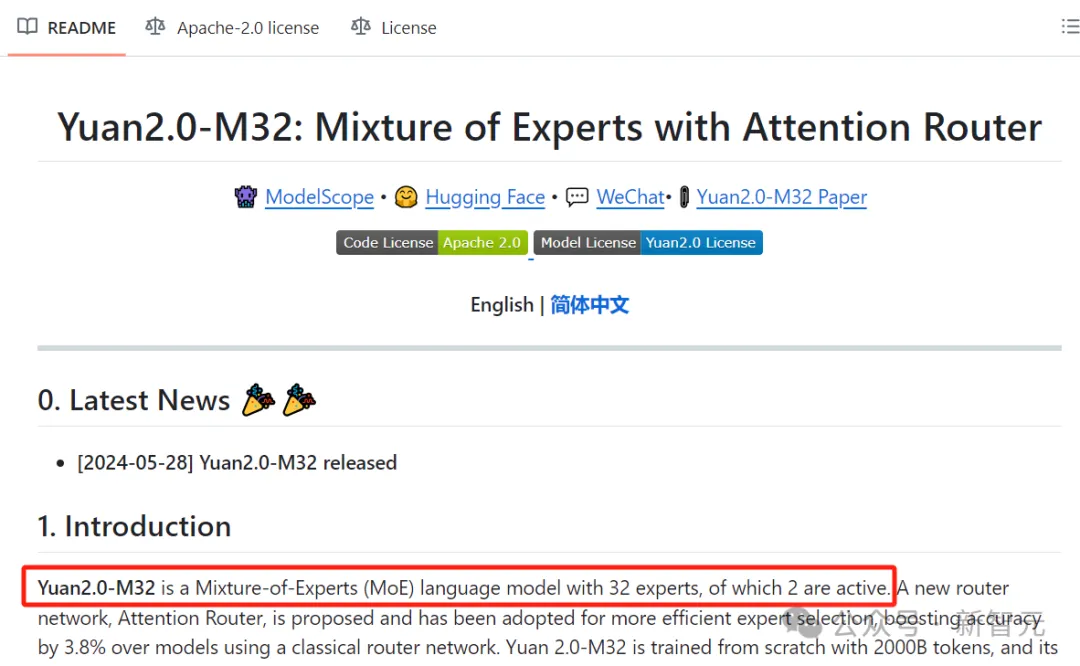

马斯克最近哭穷表示,xAI需要部署10万个H100才能训出Grok 3,影响全球的大模型算力荒怎么解?昨天开源的这款MoE大模型,只用了1/19算力、1/19激活参数,性能就直接全面对标Llama 3-70B!

最近,许久没有新动向的马斯克放出了大消息——他旗下的人工智能初创公司xAI将投入巨资建造一个超算中心,以保证Grok 2及之后版本的训练。这个「超级计算工厂」预计于2025年秋季建成,规模将达到目前最大GPU集群的四倍。

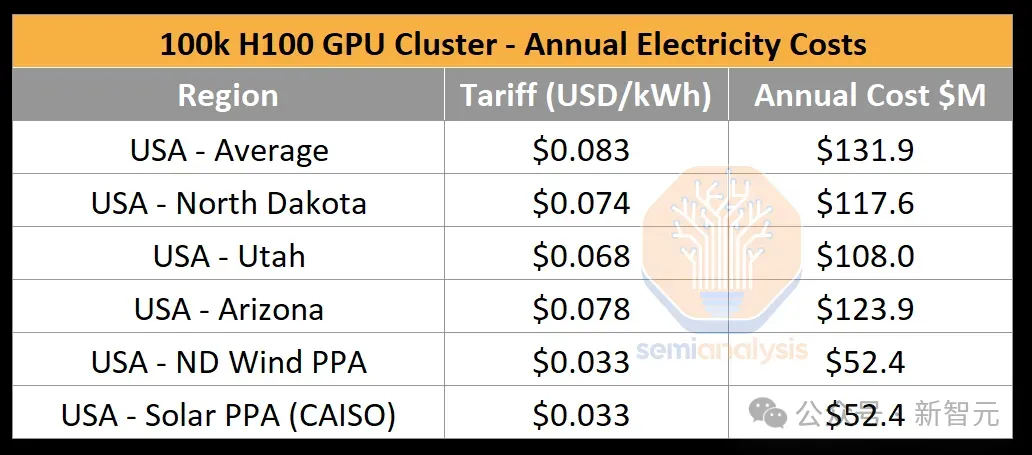

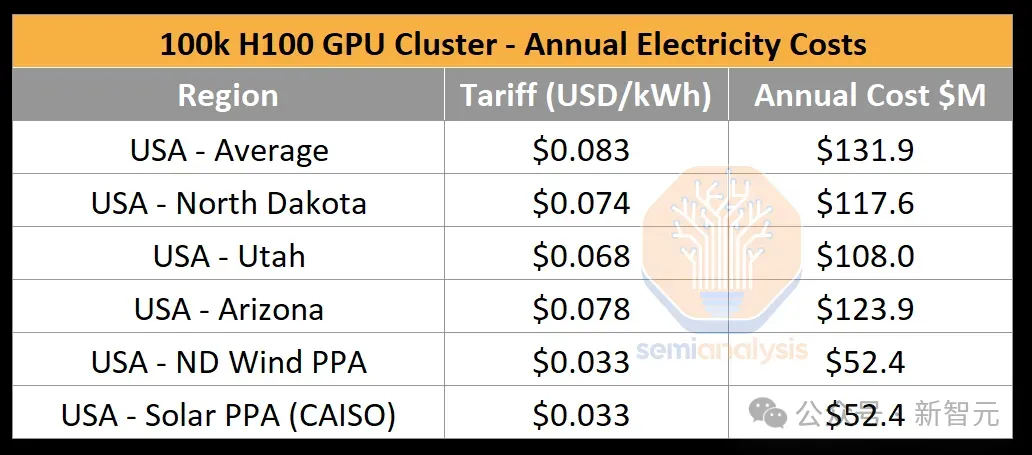

最近几年,随着大语言模型的飞速发展与迭代,科技巨头们都竞相投入巨额财力打造超级计算机(或大规模 GPU 集群)。他们认为,更强大的计算能力是实现更强大 AI 的关键。

提高 GPU 利用率,就是这么简单。

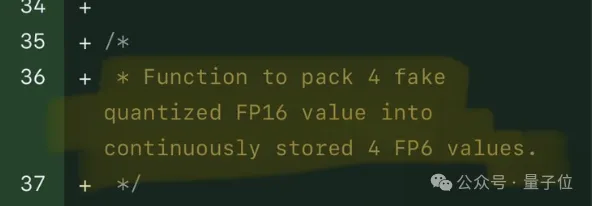

FP8和更低的浮点数量化精度,不再是H100的“专利”了!

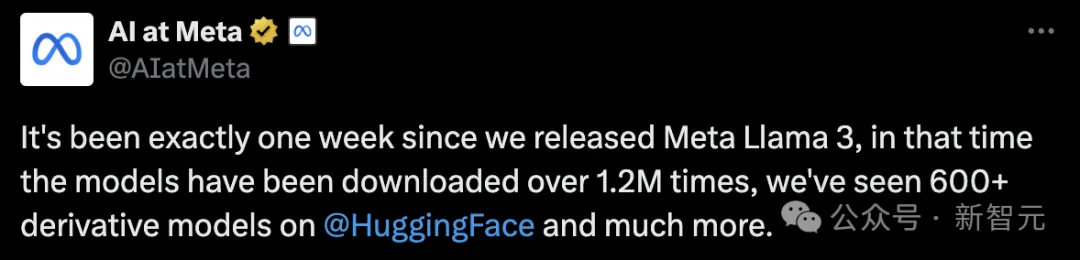

Llama 3诞生整整一周后,直接将开源AI大模型推向新的高度。