抱抱脸进军具身智能机器人:5小时成交破百万,299美元起售

抱抱脸进军具身智能机器人:5小时成交破百万,299美元起售AI圈的“GitHub”居然开始卖机器人了!HuggingFace最新发布开源桌面机器人ReachyMini,5小时内卖出超13万欧元(约为人民币109万元)!

AI圈的“GitHub”居然开始卖机器人了!HuggingFace最新发布开源桌面机器人ReachyMini,5小时内卖出超13万欧元(约为人民币109万元)!

6 月 27 日,腾讯混元宣布开源首个混合推理 MoE 模型 Hunyuan-A13B,总参数 80B,激活参数仅 13B,效果比肩同等架构领先开源模型,但是推理速度更快,性价比更高。模型已经在 Github 和 Huggingface 等开源社区上线,同时模型 API 也在腾讯云官网正式上线,支持快速接入部署。

3D生成模型高光时刻来临!DreamTech联手南大、复旦、牛津发布的Direct3D-S2登顶HuggingFace热榜。仅用8块GPU训练,效果超闭源模型,直指影视级精细度。

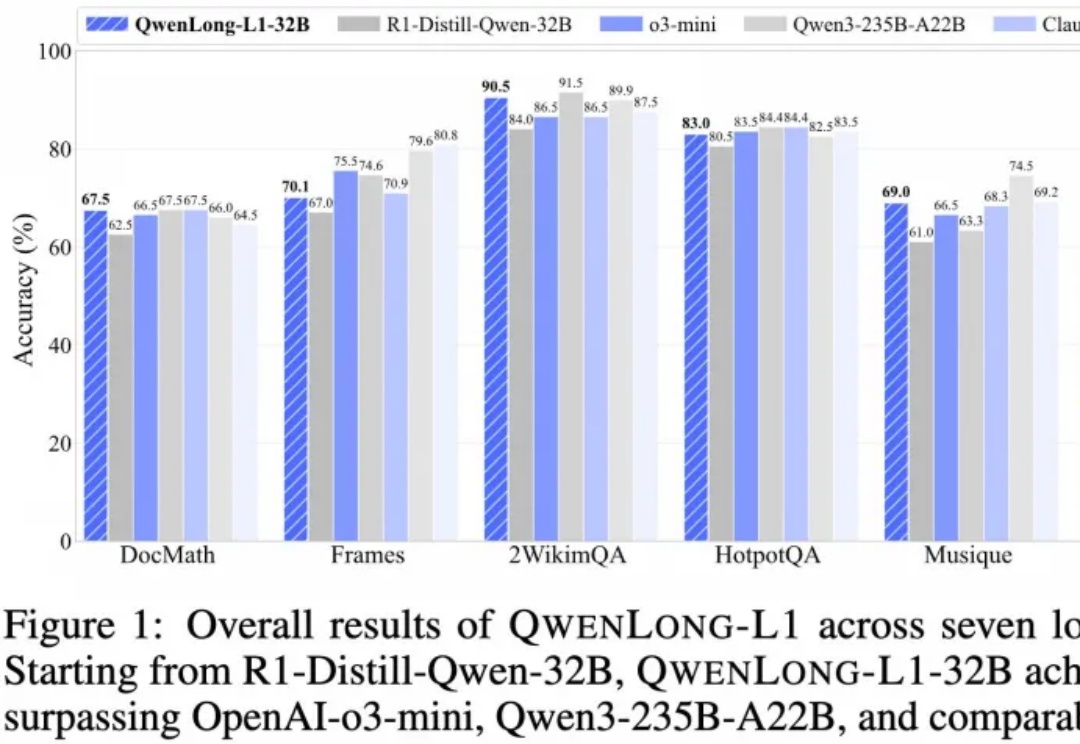

推理大模型开卷新方向,阿里开源长文本深度思考模型QwenLong-L1,登上HuggingFace今日热门论文第二。

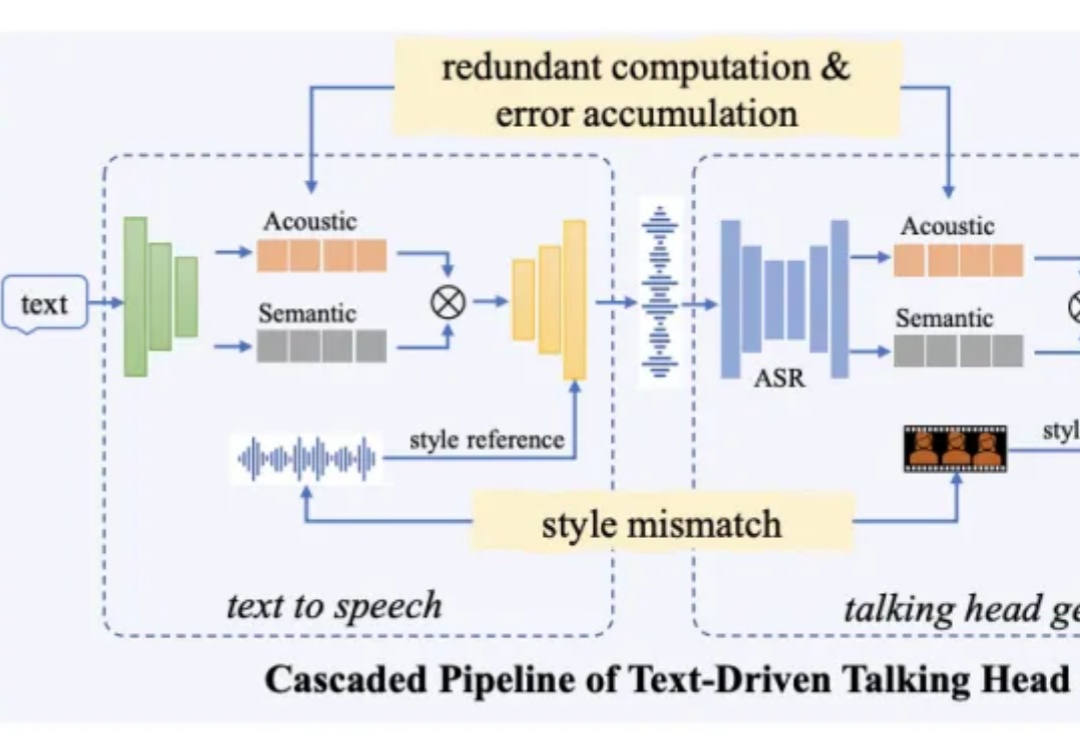

近日,阿里通义实验室推出了全新数字人视频生成大模型 OmniTalker,只需上传一段参考视频,不仅能学会视频中人物的表情和声音,还能模仿说话风格。相比传统的数字人生产流程,该方法能够有效降低制作成本,提高生成内容的真实感和互动体验,满足更广泛的应用需求。目前该项目已在魔搭社区、HuggingFace 开放体验入口,并提供了十多个模板,所有人可以直接免费使用。

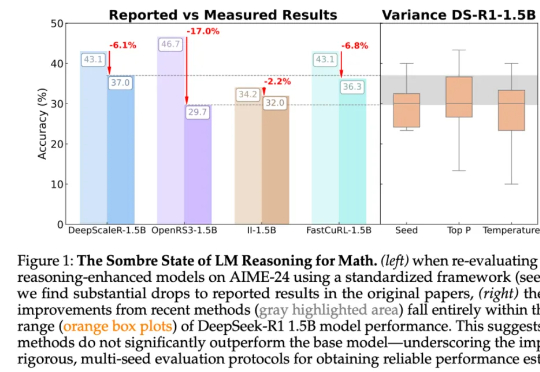

尽管这些论文的结论统统指向了强化学习带来的显著性能提升,但来自图宾根大学和剑桥大学的研究者发现,强化学习导致的许多「改进」可能只是噪音。「受推理领域越来越多不一致的经验说法的推动,我们对推理基准的现状进行了严格的调查,特别关注了数学推理领域评估算法进展最广泛使用的测试平台之一 HuggingFaceH4,2024;AI - MO。」

CAMEL-AI 团队在 Manus 上线后 1 天内推出的 OWL 就是其中最具代表性的一个,项目实测成绩达到开源界 GAIA 性能天花板,达到了 58.18%,超越 Huggingface 提出的 Open Deep Research 55.15% 的表现。

今天,百图生科宣布开源其领先的xTrimo V2中的蛋白质语言模型xTrimoPGLM,7个不同参数量的模型均已发布在huggingface和github,供全球用户自由获取和使用。xTrimoPGLM是全球首个千亿参数的蛋白质语言模型,性能超越了ESM-2、ProGen2等此前业界领先的蛋白质模型,并在药物分子设计和优化、抗体工程与疫苗开发、酶工程和生物催化剂设计等领域展现出广泛应用前景。

HuggingFace热门榜单几乎被中国模型“承包”了!

就在刚刚,网上已经出现了一波复现DeepSeek的狂潮。UC伯克利、港科大、HuggingFace等纷纷成功复现,只用强化学习,没有监督微调,30美元就能见证「啊哈时刻」!全球AI大模型,或许正在进入下一分水岭。