LLM上下文窗口突破200万!无需架构变化+复杂微调,轻松扩展8倍

LLM上下文窗口突破200万!无需架构变化+复杂微调,轻松扩展8倍大型语言模型(LLM)往往会追求更长的「上下文窗口」,但由于微调成本高、长文本稀缺以及新token位置引入的灾难值(catastrophic values)等问题,目前模型的上下文窗口大多不超过128k个token

来自主题: AI技术研报

9196 点击 2024-04-29 20:31

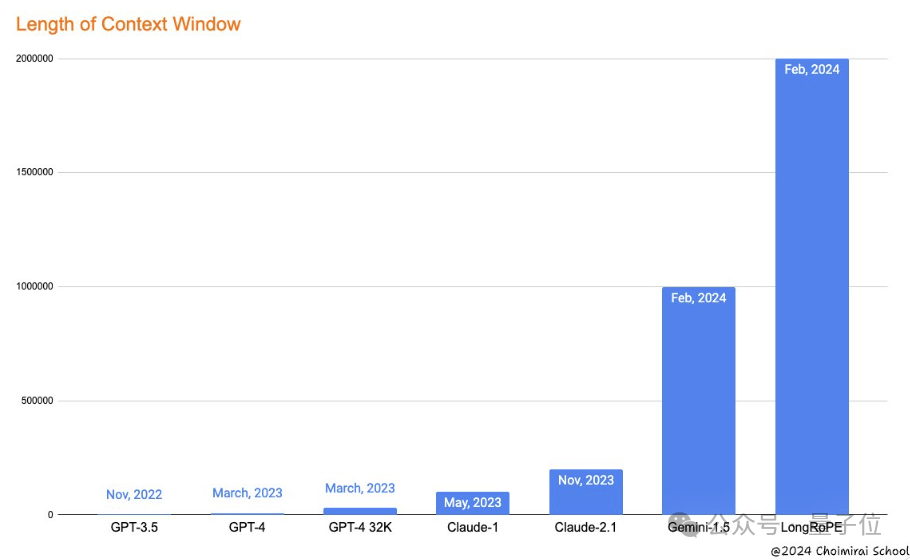

大型语言模型(LLM)往往会追求更长的「上下文窗口」,但由于微调成本高、长文本稀缺以及新token位置引入的灾难值(catastrophic values)等问题,目前模型的上下文窗口大多不超过128k个token

谷歌刚刷新大模型上下文窗口长度记录,发布支持100万token的Gemini 1.5,微软就来砸场子了。