全球最强开源模型一夜易主,1320亿参数推理飙升2倍!

全球最强开源模型一夜易主,1320亿参数推理飙升2倍!【新智元导读】就在刚刚,全球最强开源大模型王座易主,创业公司Databricks发布的DBRX,超越了Llama 2、Mixtral和Grok-1。MoE又立大功!这个过程只用了2个月,1000万美元,和3100块H100。

【新智元导读】就在刚刚,全球最强开源大模型王座易主,创业公司Databricks发布的DBRX,超越了Llama 2、Mixtral和Grok-1。MoE又立大功!这个过程只用了2个月,1000万美元,和3100块H100。

这是迄今为止最强大的开源大语言模型,超越了 Llama 2、Mistral 和马斯克刚刚开源的 Grok-1。

Mistral 可以说是欧洲目前最有代表性的 AI 公司,开源小模型、MoE、专注欧洲多语言市场等等,都让它与美国的几家大模型公司如 OpenAI、Anthropic 截然不同。

3 月 23 日,国内通用大模型创业公司阶跃星辰在 2024 全球开发者先锋大会上发布了公司的通用大模型产品。阶跃星辰创始人、CEO 姜大昕博士在大会开幕式上对外发布了 Step 系列通用大模型,包括 Step-1 千亿参数语言大模型、Step-1V 千亿参数多模态大模型以及 Step-2 万亿参数 MoE 语言大模型预览版。

今年以来,苹果显然已经加大了对生成式人工智能(GenAI)的重视和投入。此前在 2024 苹果股东大会上,苹果 CEO 蒂姆・库克表示,今年将在 GenAI 领域实现重大进展。此外,苹果宣布放弃 10 年之久的造车项目之后,一部分造车团队成员也开始转向 GenAI。

刚刚,我们经历了LLM划时代的一夜。谷歌又在深夜发炸弹,Gemini Ultra发布还没几天,Gemini 1.5就来了。卯足劲和OpenAI微软一较高下的谷歌,开始进入了高产模式。

混合专家(MoE)架构已支持多模态大模型,开发者终于不用卷参数量了!北大联合中山大学、腾讯等机构推出的新模型MoE-LLaVA,登上了GitHub热榜。

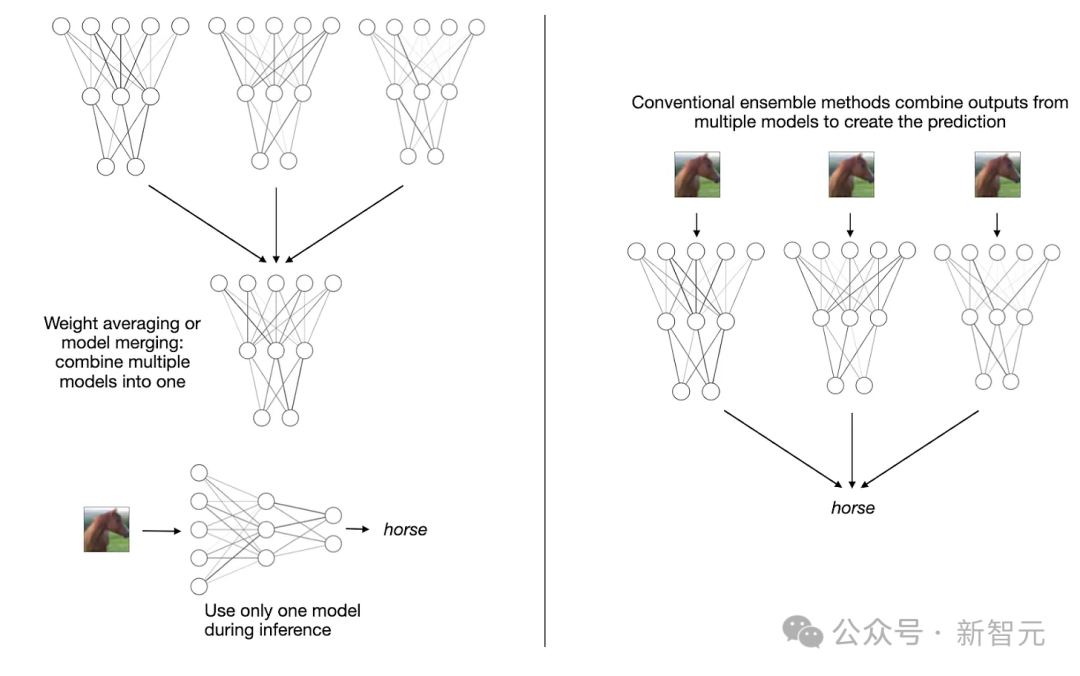

AI大模型并非越大越好?过去一个月,关于大模型变小的研究成为亮点,通过模型合并,采用MoE架构都能实现小模型高性能。

MoE(混合专家)作为当下最顶尖、最前沿的大模型技术方向,MoE能在不增加推理成本的前提下,为大模型带来性能激增。比如,在MoE的加持之下,GPT-4带来的用户体验较之GPT-3.5有着革命性的飞升。

「天工AI」国内首个MoE架构免费向C端用户开放的大语言模型应用全新问世。