Seedance 2.0 最全上手指南:4 大入口、火爆玩法、详细提示词都在这

Seedance 2.0 最全上手指南:4 大入口、火爆玩法、详细提示词都在这Seedance 2.0 有多火爆,这几天国内外网友分享的实测视频,或许都能略窥一二。

搜索

搜索

Seedance 2.0 有多火爆,这几天国内外网友分享的实测视频,或许都能略窥一二。

我天!感觉 Seed 1.8 发布还没多久,没想到 Doubao-Seed-2.0 这么快就杀到了…今天发都算是晚讯了。据官方介绍,这次 Seed 2.0 多模态理解能力全面升级,还强化了 LLM 与 Agent 能力,模型在真实长链路任务中可以稳定推进。

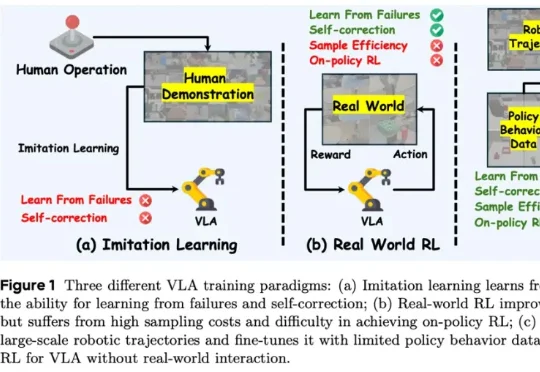

香港科技大学 PEI-Lab 与字节跳动 Seed 团队近期提出的 WMPO(World Model-based Policy Optimization),正是这样一种让具身智能在 “想象中训练” 的新范式。该方法无需在真实机器人上进行大规模强化学习交互,却能显著提升策略性能,甚至涌现出 自我纠错(Self-correction) 行为。

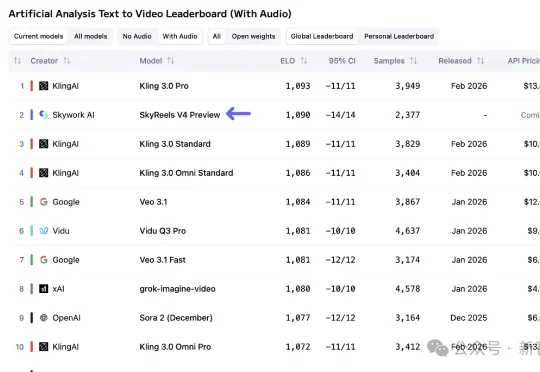

当Seedance 2.0刷屏全网时,一匹中国黑马已悄然冲上全球AI视频榜第二。昆仑天工SkyReels-V4强势杀入顶级牌桌,多模态输入、音画同步直出影院级大片,实力惊艳超群!

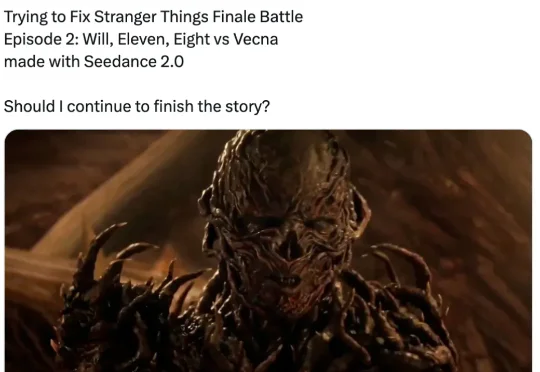

2月12号,我发了一条用 AI 做的《怪奇物语》终局之战的视频。然后它爆了。仅黑叉平台一个渠道,92 条相关推文的总浏览量就达到了 1914 万。总点赞 52 万,转发 4.9 万,回复 5000+。

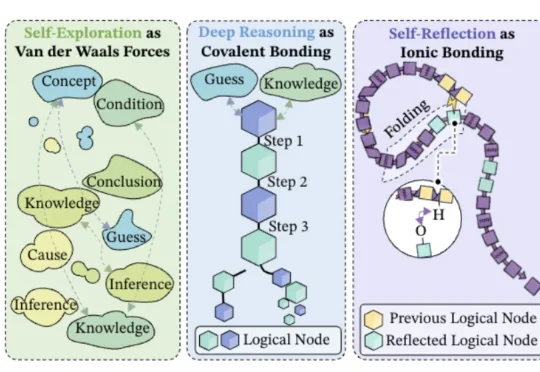

字节Seed都开始用化学思想搞大模型了——深度推理是共价键、自我反思是氢键、自我探索是范德华力?!

昨天春晚张杰献唱的《驭风歌》大家都听了吧?气势是相当磅礴了。但你知道吗?其实这首歌的表演,背后还有一个AI彩蛋:没错,就是背景视频里那幅流动的巨型水墨画卷中,那一群气势磅礴、奔腾而来的骏马——

这两周,字节新发布的 AI 视频模型 Seedance2.0 特别火,真正的全民热议。 我给我爹看了几个模型生成的视频,他的反应特别有代表性。看完以后他跟我说了一句话:「你别胡说八道,这就是真人啊。」

结果今天就等到豆包全家族了。Seedance 2.0都把贾樟柯干Fomo了,现在又上了个最全面的多模态Agent模型,还有人管管字节吗?Seed团队跳动得停不下来了💃烧的全是火山引擎上的Tokens,同时火山引擎上已经有豆包2.0系列的API了。

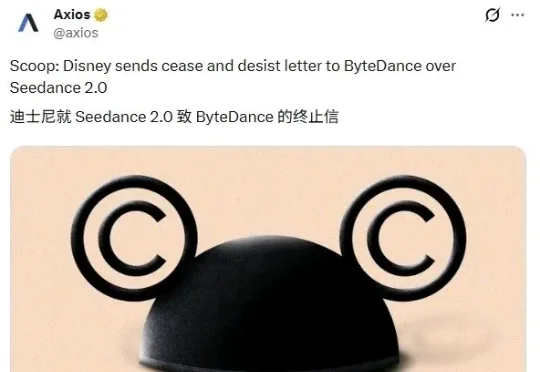

2026年2月12日,字节跳动正式发布新一代AI视频生成模型Seedance 2.0,同步接入豆包App、即梦App等平台,凭借广播级画质、丝滑运镜、多镜头叙事控制的工业级生成能力,迅速引发全球行业关注。