OpenAI突发新模型,GPT-3.5退役,大模型成本2年骤降99%

OpenAI突发新模型,GPT-3.5退役,大模型成本2年骤降99%OpenAI突发新模型,GPT-3.5退役,大模型成本2年骤降99%

OpenAI突发新模型,GPT-3.5退役,大模型成本2年骤降99%

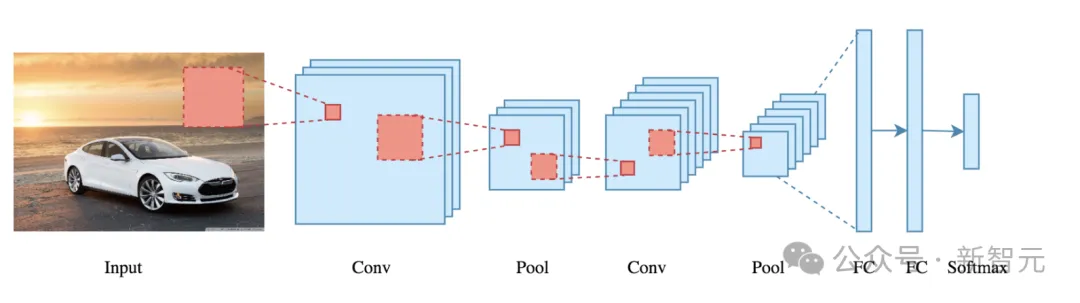

自回归解码已经成为了大语言模型(LLMs)的事实标准,大语言模型每次前向计算需要访问它全部的参数,但只能得到一个token,导致其生成昂贵且缓慢。

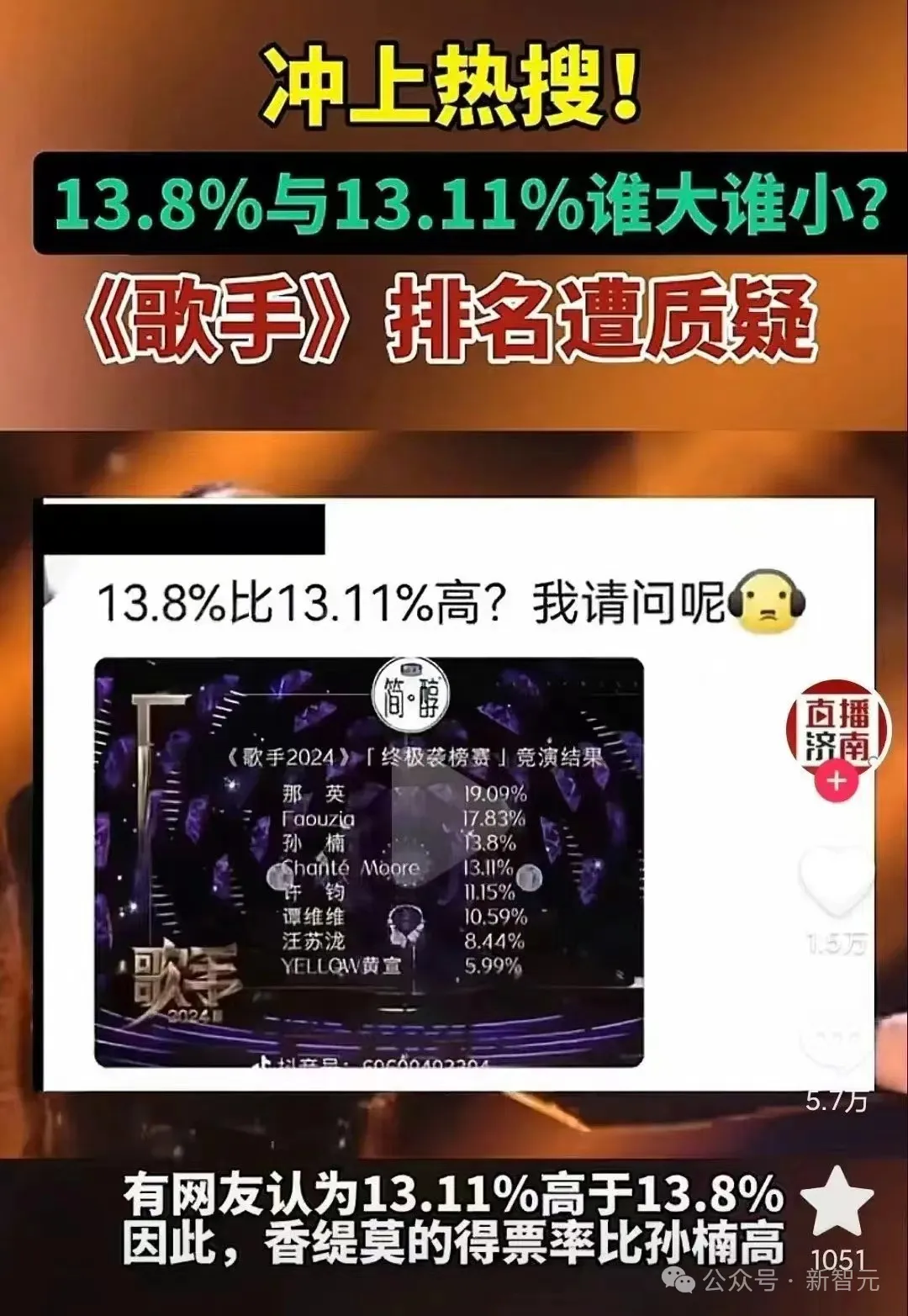

13.8和13.11哪个大?这个问题不光难倒了部分人类,还让一票大模型折戟。AI如今都能做AI奥数题了,但简单的常识问题对它们依然难如登天。其实,无论是比大小,还是卷心菜难题,都揭示了LLM在token预测上的一个重大缺陷。

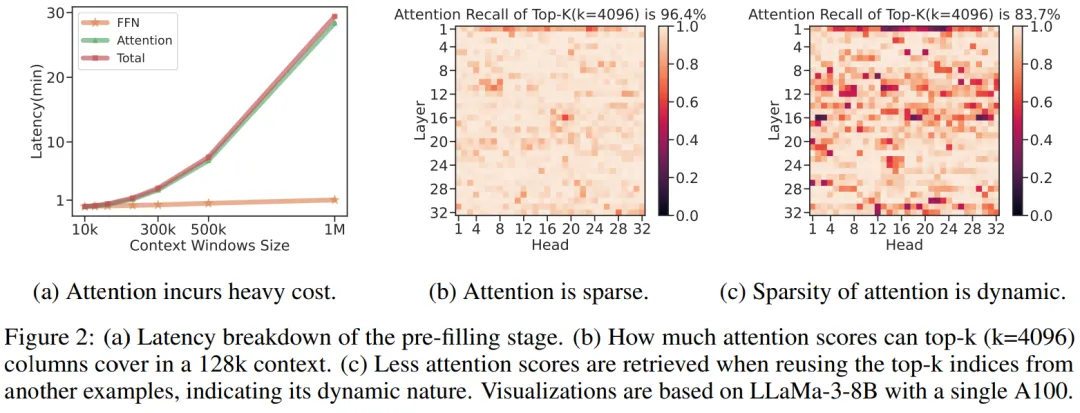

为什么说理解长视频难如 “大海捞针”?

微软的这项研究让开发者可以在单卡机器上以 10 倍的速度处理超过 1M 的输入文本。

下一代视觉模型会摒弃patch吗?Meta AI最近发表的一篇论文就质疑了视觉模型中局部关系的必要性。他们提出了PiT架构,让Transformer直接学习单个像素而不是16×16的patch,结果在多个下游任务中取得了全面超越ViT模型的性能。

大模型之争,到了不只是拼技术的时刻。

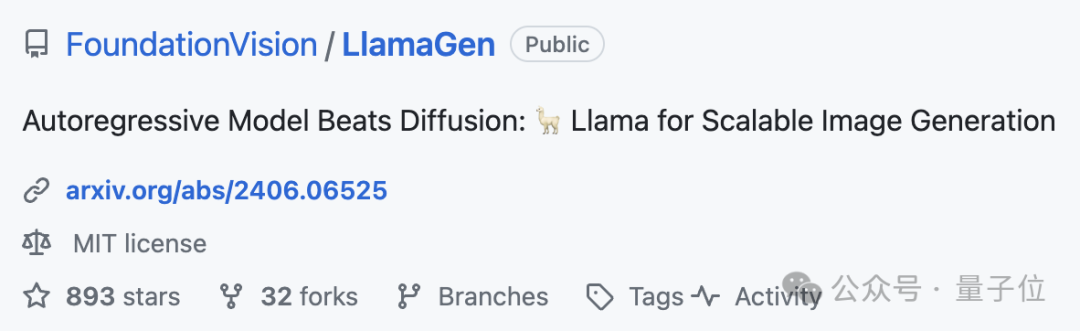

只需Image Tokenizer,Llama也能做图像生成了,而且效果超过了扩散模型。

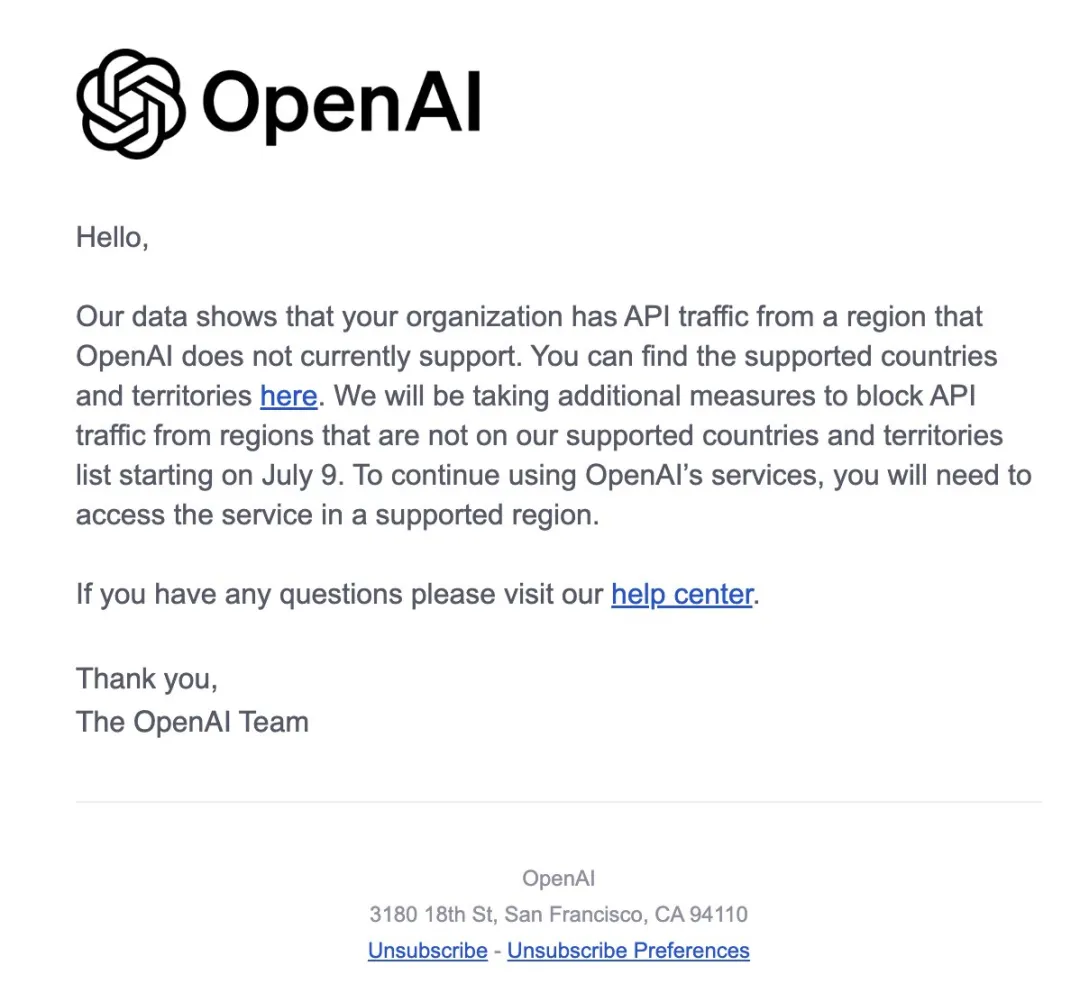

该来的还是来了。

今天凌晨,OpenAI 突然宣布终止对中国提供 API 服务,进一步收紧国内开发者访问 GPT 等高水平大模型。国内开发者真是太难了。