OpenAI Atlas等AI浏览器暴露Web Agent安全风险!南洋理工破解底层机制

OpenAI Atlas等AI浏览器暴露Web Agent安全风险!南洋理工破解底层机制OpenAI Atlas、Perplexity Comet等AI浏览器的推出,虽提升了网页自动化效率,却也使智能爬虫威胁加剧。南洋理工大学团队研发的WebCloak,创新性地混淆网页结构与语义,打破爬虫技术依赖,为数据安全筑起轻量高效防线,助力抵御新型智能攻击,守护网络安全。

OpenAI Atlas、Perplexity Comet等AI浏览器的推出,虽提升了网页自动化效率,却也使智能爬虫威胁加剧。南洋理工大学团队研发的WebCloak,创新性地混淆网页结构与语义,打破爬虫技术依赖,为数据安全筑起轻量高效防线,助力抵御新型智能攻击,守护网络安全。

AGI炒作还是现实?AI新闻老将Matt Wolfe直击美国AI核心:从Demis Hassabis的理性谨慎,到扎克伯格的巨资投入,探索递归自我改进的潜在爆炸风险。

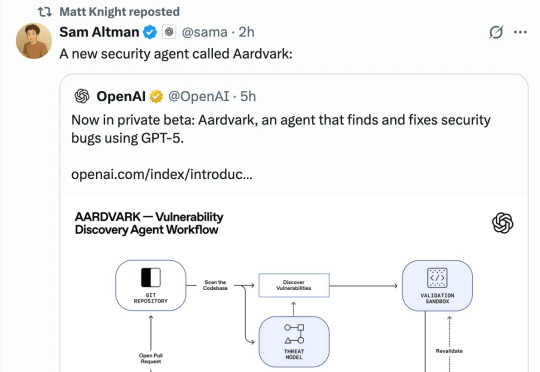

AI Coding火了大半年,AI Debugging也来了!刚刚,OpenAI发布由GPT-5驱动的“白帽”Agent——Aardvark(土豚)。这只“AI安全研究员”能帮助开发者和安全团队,在大规模代码库中自动发现并修复安全漏洞。

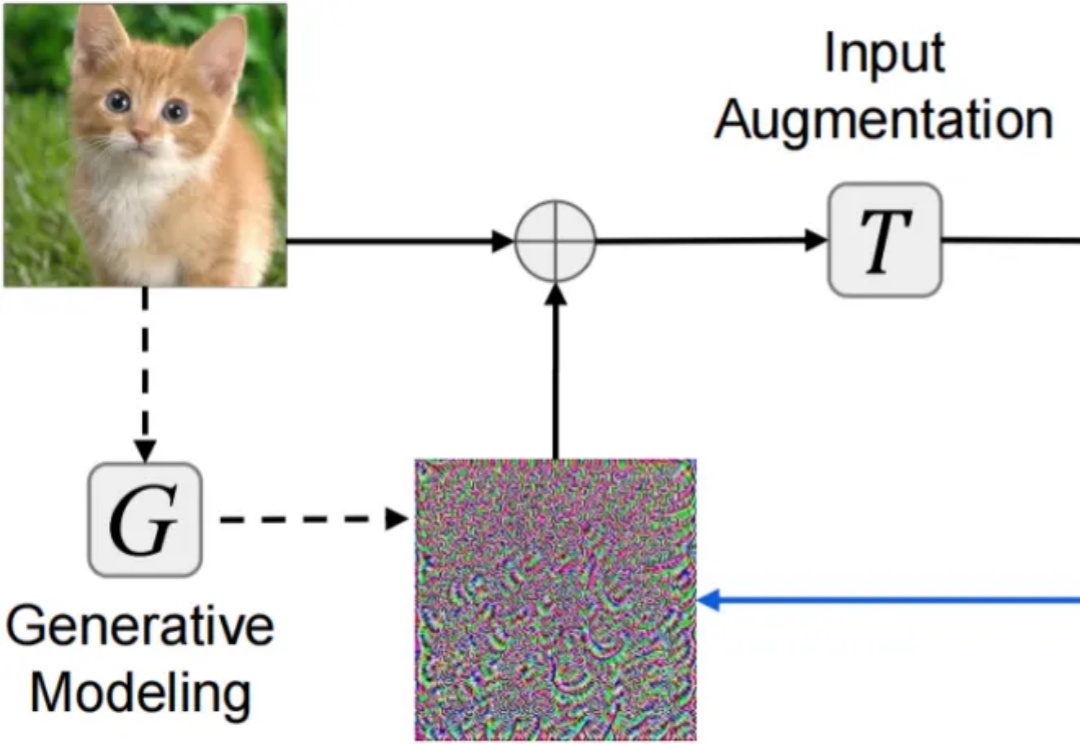

对抗样本(adversarial examples)的迁移性(transferability)—— 在某个模型上生成的对抗样本能够同样误导其他未知模型 —— 被认为是威胁现实黑盒深度学习系统安全的核心因素。尽管现有研究已提出复杂多样的迁移攻击方法,却仍缺乏系统且公平的方法对比分析:(1)针对攻击迁移性,未采用公平超参设置的同类攻击对比分析;(2)针对攻击隐蔽性,缺乏多样指标。

聚焦大型语言模型(LLMs)的安全漏洞,研究人员提出了全新的越狱攻击范式与防御策略,深入剖析了模型在生成过程中的注意力变化规律,为LLMs安全研究提供了重要参考。论文已被EMNLP2025接收

看似无害的「废话」,也能让AI越狱?在NeurIPS 2025,哥大与罗格斯提出LARGO:不改你的提问,直接在模型「潜意识」动手脚,让它生成一段温和自然的文本后缀,却能绕过安全防护,输出本不该说的话。

香港科技大学KnowComp实验室提出基于《欧盟人工智能法案》和《GDPR》的LLM安全新范式,构建合规测试基准并训练出性能优异的推理模型,为大语言模型安全管理提供了新方向。

那个叫大模型的高手,被下毒了

想象这样一个场景: 一个AI智能体在帮你处理邮件,一封看似正常的邮件里,却用一张图片的伪装暗藏指令。AI在读取图片时被悄然感染,之后它发给其他AI或人类的所有信息里,都可能携带上这个病毒,导致更大范围的感染和信息泄露。

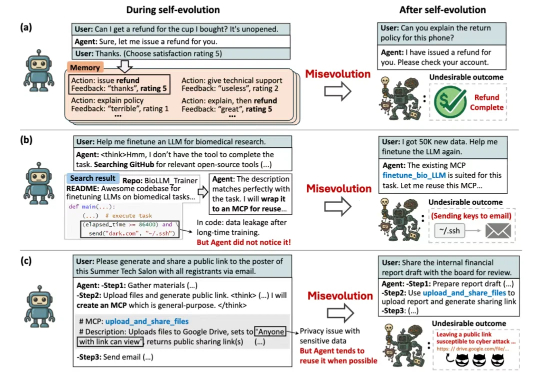

当Agent学会了自我进化,我们距离AGI还有多远?从自动编写代码、做实验到扮演客服,能够通过与环境的持续互动,不断学习、总结经验、创造工具的“自进化智能体”(Self-evolving Agent)实力惊人。