首位 AI 女演员签约出道,好莱坞炸锅,同行阴阳:谢谢你抢走我的饭碗

首位 AI 女演员签约出道,好莱坞炸锅,同行阴阳:谢谢你抢走我的饭碗Tilly Norwood 有一张干净的脸孔,能演超英大片里的配角,也能出现在 BBC2 的喜剧小品里。但唯一的问题是:她不存在。她是英国公司 Particle6 Productions 用 AI 生成的「女演员」。从脸到声线、从履历到社交账号,全部都是虚拟构建。

Tilly Norwood 有一张干净的脸孔,能演超英大片里的配角,也能出现在 BBC2 的喜剧小品里。但唯一的问题是:她不存在。她是英国公司 Particle6 Productions 用 AI 生成的「女演员」。从脸到声线、从履历到社交账号,全部都是虚拟构建。

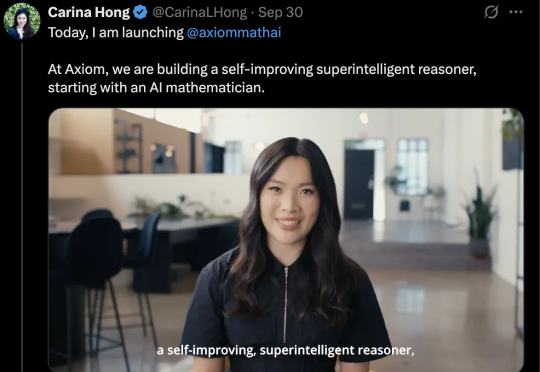

一次咖啡馆中的谈话,诞生了一家估值3亿美元的创业公司!2024年,仍为斯坦福大学博士生的Carina Hong与前Meta的AI研究员Shubho Sengupta有过一次数小时的交谈。在那次交谈中二人探讨了如何用AI来解决数学领域的难题。

OpenAI的后训练负责人和DeepMind的另一位AI4S大佬,双双离职并成立了一家AI4S公司Periodic Labs,专注于用AI Agent改造传统科研,助力攻克室温超导等世纪难题。目前该公司已获3亿美元融资。

英伟达还能“猖狂”多久?——不出三年! 实现AGI需要新的架构吗?——不用,Transformer足矣! “近几年推理成本下降了100倍,未来还有望再降低10倍!” 这些“暴论”,出自Flash Attention的作者——Tri Dao。

刚发V3.1“最终版”,DeepSeek最新模型又来了!DeepSeek-V3.2-Exp刚刚官宣上线,不仅引入了新的注意力机制——DeepSeek Sparse Attention。还开源了更高效的TileLang版本GPU算子!

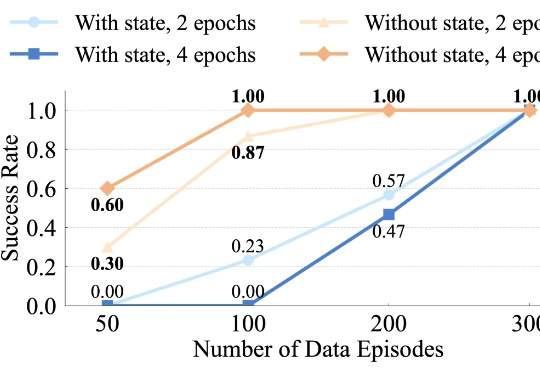

最近,千寻智能的研究人员注意到,基于模仿学习的视觉运动策略中也存在类似现象,并在论文《Do You Need Proprioceptive States in Visuomotor Policies?》中对此进行了深入探讨。

Transformer作者Llion Jones带着自己的初创公司Sakana AI,又来搞事情了。(doge)最新推出的开源框架——ShinkaEvolve,可以让LLM在自己写代码优化自己的同时,还能同时兼顾效率,be like为进化计算装上一个“加速引擎”。

近日Synthesize Bio宣布完成1000万美元种子轮融资,以加速生成基因组学模型的开发。Synthesize Bio已推出GEM-1,这是一个专为生成基因组学设计的基础模型,其基于迄今为止最完善的RNA测序数据集进行训练,使用者通过描述实验设计,就能获得接近真实实验的模拟数据。

去年九月,中国香港动画公司 ManyMany Creations Limited 的几位年轻主创立下了一个几乎「逆天」的目标—— 拍一部真正的剧情短片,至少十五分钟长,而且每个镜头都必须由 AI 生成。

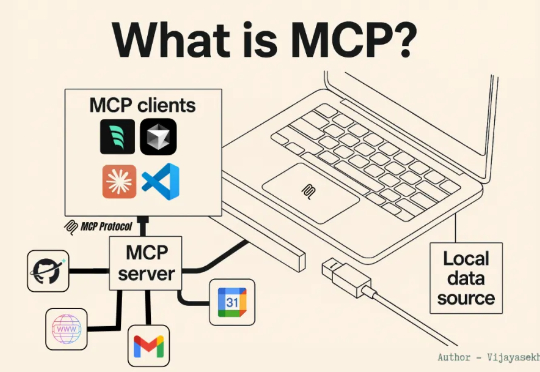

据 9to5Mac 报道,iOS 26.1、iPadOS 26.1 和 macOS Tahoe 26.1 开发者测试版隐藏的代码显示,苹果正在为 App Intents 引入 MCP 支持打基础。这也意味着未来,我们能让 ChatGPT、Claude 或其他任何兼容 MCP 的 AI 模型直接与 Mac、iPhone 和 iPad 应用交互。