Mac mini不止养AI龙虾!苹果M4算力机密被曝光,Claude立新功

Mac mini不止养AI龙虾!苹果M4算力机密被曝光,Claude立新功Claude立大功!开发者靠它剖析MIL语言与E5二进制,绕过CoreML直达硬件,证明NPU训练从来不是硬件不行,而是苹果不让用。

Claude立大功!开发者靠它剖析MIL语言与E5二进制,绕过CoreML直达硬件,证明NPU训练从来不是硬件不行,而是苹果不让用。

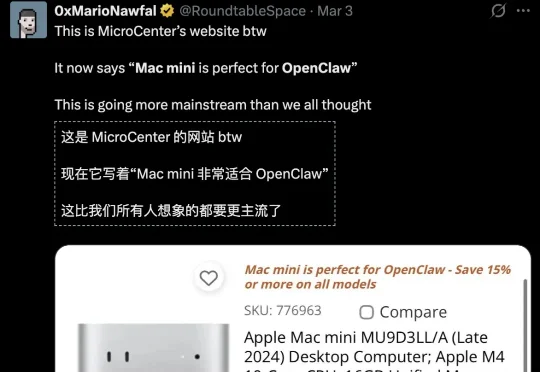

昨天,Thinking Maching Lab 研究者、斯坦福大学博士生 Zitong Yang 正式完成了他的博士论文答辩,课题为「持续自我提升式 AI」(Continually self-improving AI),并且他在答辩完成后很快就放出了自己的答辩视频,从中我们可以看到他对未来 AI 发展路径的系统性探索。

OpenClaw 最近火到什么程度?火到衍生出一门上门安装的生意。 海外代装平台 SetupClaw 已经给出明码标价:托管安装,3000 美元;含 Mac mini 硬件的远程配置,5000 美元;

据悉,专注视频后期 AI Agent 的 Vattention(时空注力)已完成数百万美元种子轮融资,由青锐资本、百度风投、常垒资本联合投资。该公司由计算机科班出身、曾任阿里淘系核心产品总监、沉浸专业视频制作领域多年的连续创业者钟超(花名 船长)创立。本轮融资将主要用于核心团队组建与技术研发,推动其三大核心引擎(MACE、ACE、PACE)的产品化落地。

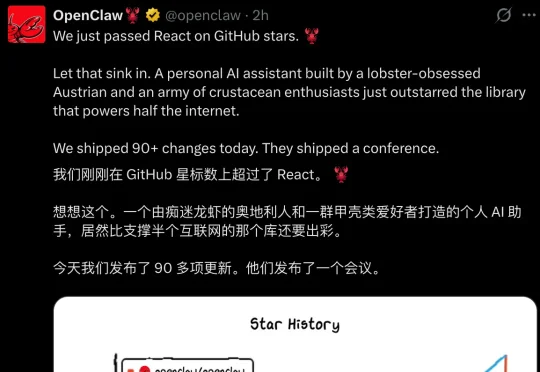

自从OpenClaw爆火后,各种Claw开始轮番登场。NanoClaw、ZeroClaw、PicoClaw刷屏,连卡帕西都坐不住了,为了“抓虾”,他一个百米冲刺奔向苹果店抢Mac Mini,要好好拆解一番爆火的各种Claw们。

谁能想到,2026 年第一款热销设备,是被 OpenClaw 带飞的 Mac Mini——一个 一直以来在苹果产品序列里,都不温不火的存在,就这样硬生生地被拉了起来。

陈丹琦首次转身工业界,第一站就选择Mira初创的理由找到了—— 有个赛友也在这儿,还足足“潜伏”了一年之久。

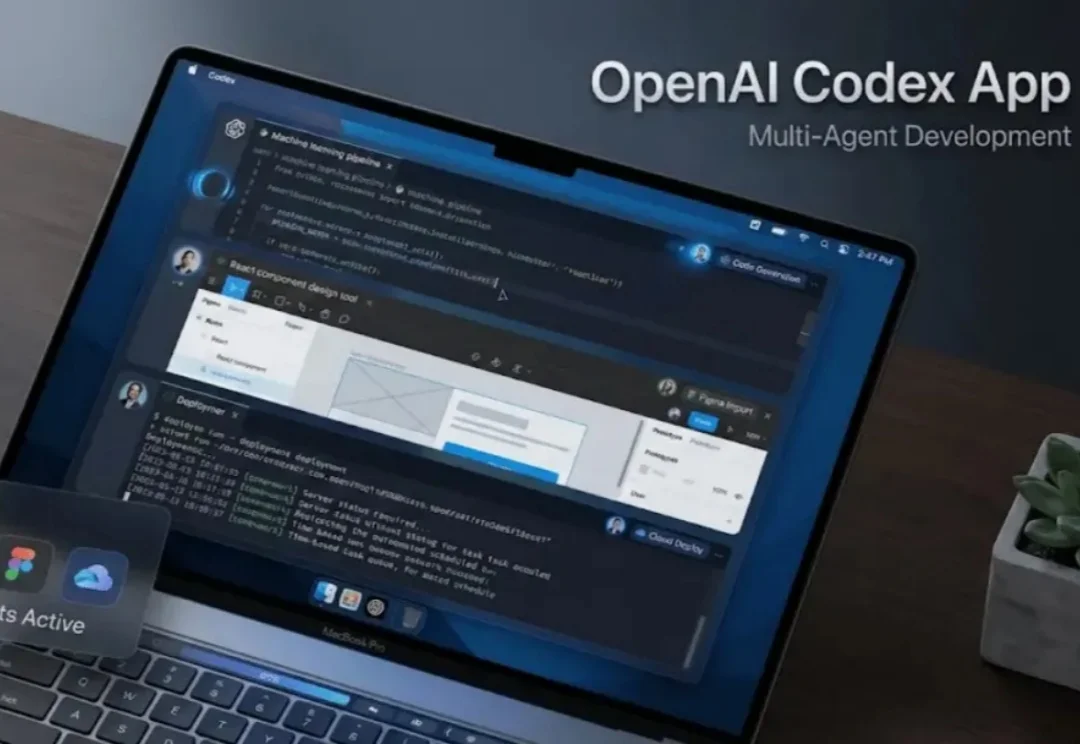

OpenAI 发布 Codex macOS 应用,作为 AI 智能体指挥中心,并全面翻倍付费用户速率限制。

Clawdbot火爆全球,国产算力却不能用?AI Agent迎来高光时刻:Ollama只支持CUDA,中国团队直接把国产版开源了!正面硬刚Ollama,5分钟让国产芯片跑通OpenClaw!

起因是这样的, 当我还在跟Mac Mini版满血版Clawdbot PK的时候,发现有人统计了排名前十的Clawdbot常见任务,分别是邮件处理,日历管理(日程提醒和会议安排),控制Claude Code开发,每日简报等,