突破算力瓶颈!港大俞益洲团队发布首篇「高效视频世界模型」全面综述

突破算力瓶颈!港大俞益洲团队发布首篇「高效视频世界模型」全面综述还记得两年前,AI 生视频可谓是「鬼畜专区」—— 人物多一根手指算基操,走路自带鬼步舞才是常态。结果转眼间,从 OpenAI 的 Sora 到字节跳动的 Seedance,这些模型已经开始一本正经地「模拟世界」了:水会流、球会弹、光影能追踪,俨然一副要当「物理引擎」的架势。

搜索

搜索

还记得两年前,AI 生视频可谓是「鬼畜专区」—— 人物多一根手指算基操,走路自带鬼步舞才是常态。结果转眼间,从 OpenAI 的 Sora 到字节跳动的 Seedance,这些模型已经开始一本正经地「模拟世界」了:水会流、球会弹、光影能追踪,俨然一副要当「物理引擎」的架势。

IPO前夕,OpenAI一天流失三位高管!Sora创始人Bill Peebles,他负责的Sora已经直接被关停,团队转移到别的方向。AI for Science副总裁Kevin Weil,他的团队被拆分并入其他研究组。

就在 OpenAI 都停了 Sora,所有人以为 Seedance 2.0 要一统天下的时候,没想到不知哪里冒出来一匹马。

2026 年 4 月 2 日,科技播客 Mostly Human 主持人 Laurie Segall 发布了一期重磅对话——与 OpenAI CEO Sam Altman 的深度对谈。这是 Altman 自今年 2 月五角大楼协议风波以来的首次公开长访谈,也恰逢 OpenAI 以 8520 亿美元估值完成 1220 亿美元融资、关停 Sora、高管层剧烈变动的多事之秋。

就在昨天,全球 AI 视频生成领域迎来了一场 “超级地震”——OpenAI 竟然意外叫停了万众瞩目的 Sora 2 项目。

AI视频生成领域或从「技术狂热」回归「商业理性」。

今日凌晨,OpenAI旗下视频生成产品Sora通过官方账号宣布关停,关闭其视频生成应用及Sora 2模型API服务。与此同时,价值10亿美元的迪士尼合作也一并告吹。

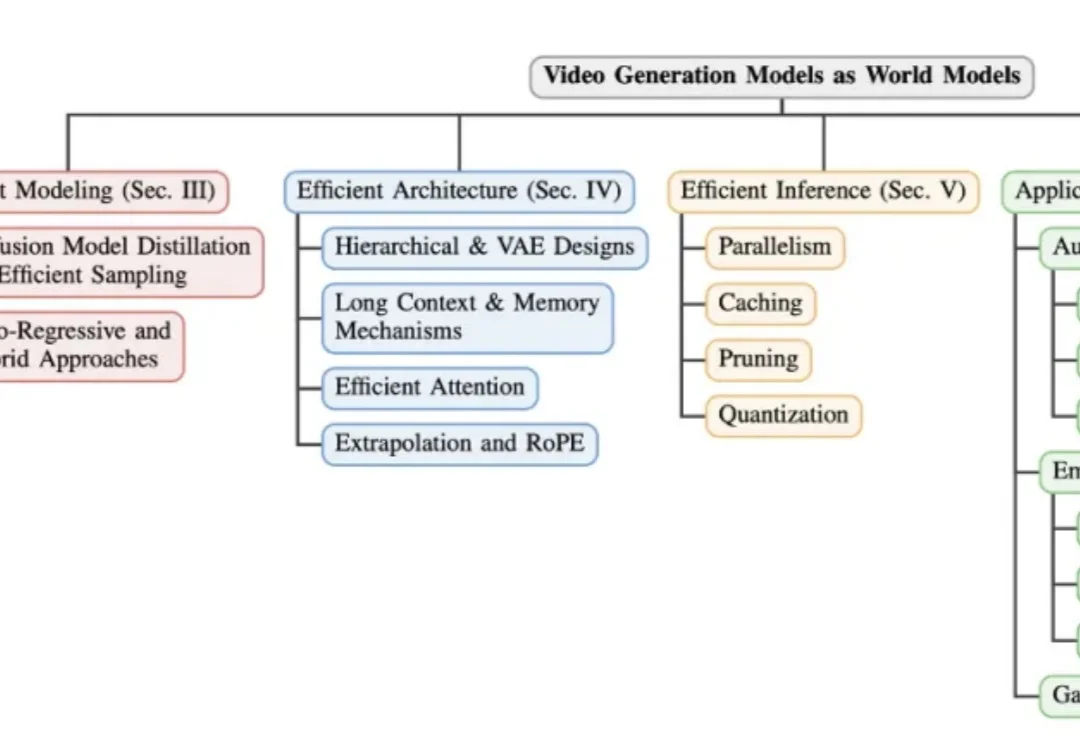

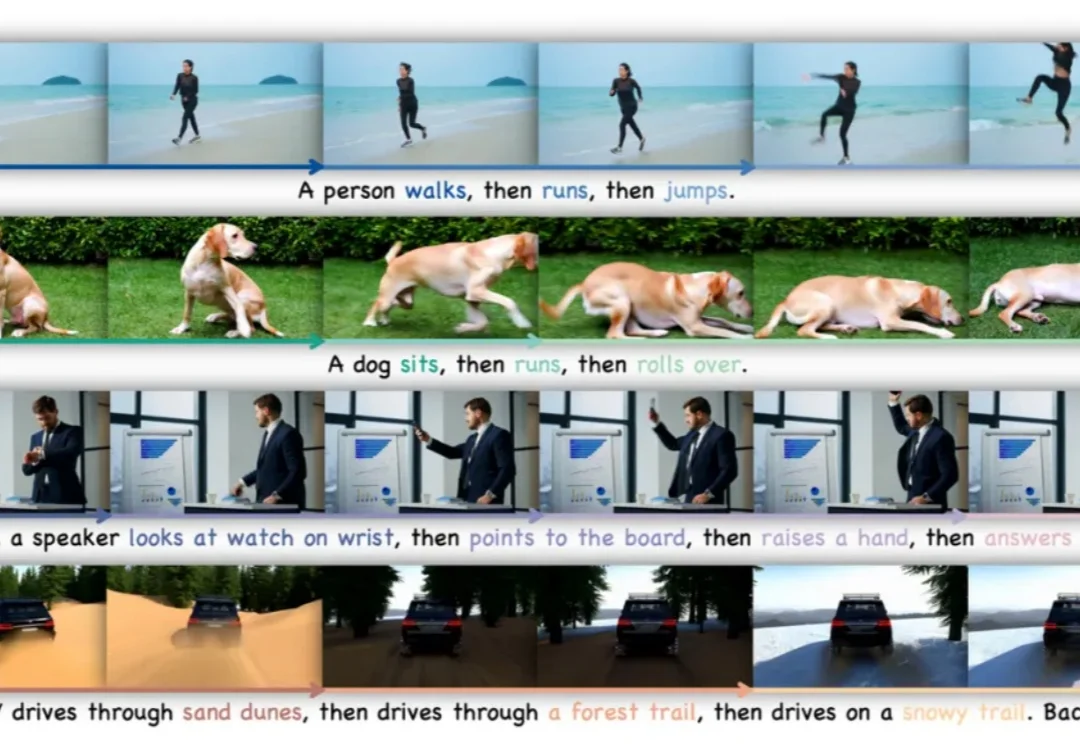

近年来,随着 Sora、Seedance 等文本到视频(T2V)扩散模型的飞速发展,AI 视频生成在视觉保真度与动态表现上已取得突破性进展。特别是近期备受瞩目的 Seedance 2.0,展现出了极其强大的多镜头叙事与复杂分镜控制能力。

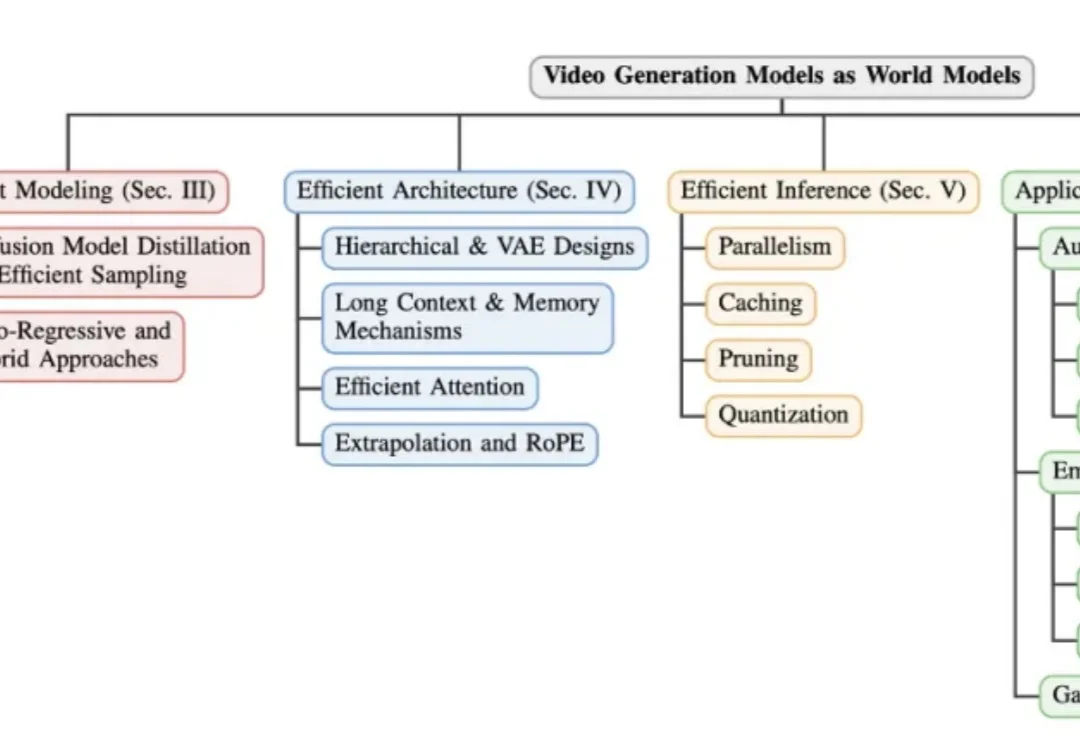

来自天工AI的SkyReels-V4,没打招呼,直接登顶Artificial Analysis文转视频(含音频)全球榜,超越Veo 3.1、Sora 2。一个月前,其Preview版本才刚拿下该榜全球第2。

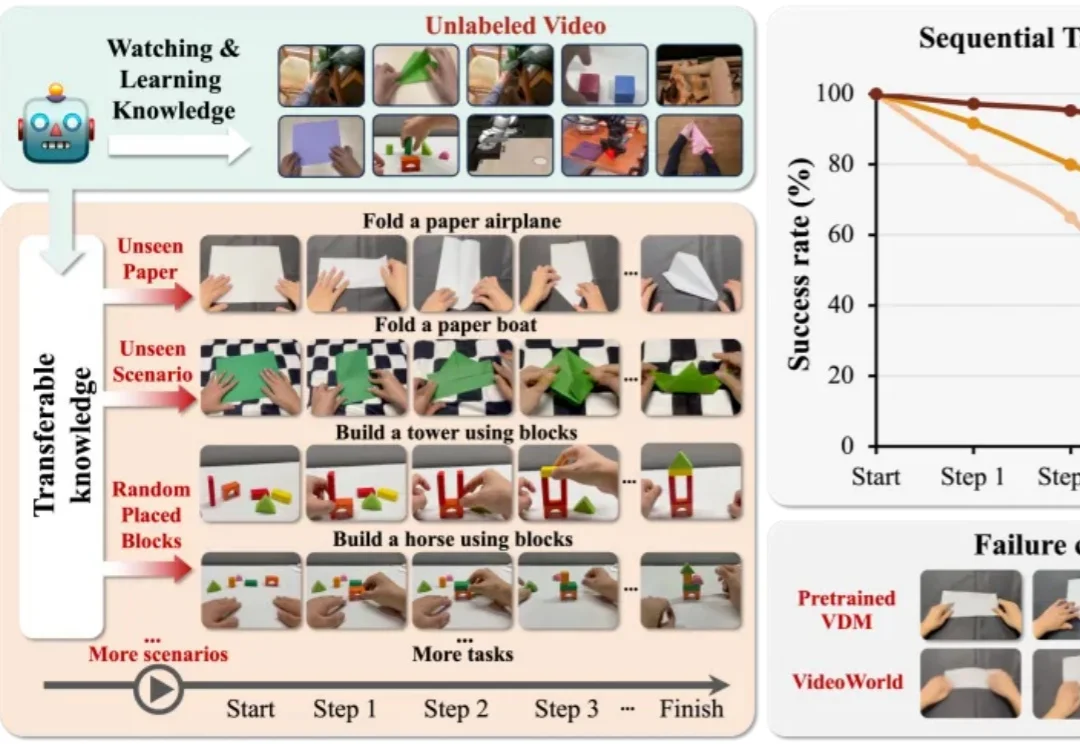

视觉世界模型 “VideoWorld 2” 由豆包大模型团队与北京交通大学联合提出。不同于 Sora 2 、Veo 3、Wan 2.2 等主流多模态模型,VideoWorld 系列工作在业界首次实现无需依赖语言模型,即可认知世界。