256块NPU训成8B视频模型、超越Sora等一众闭源!抖音内容技术团队开源ContentV

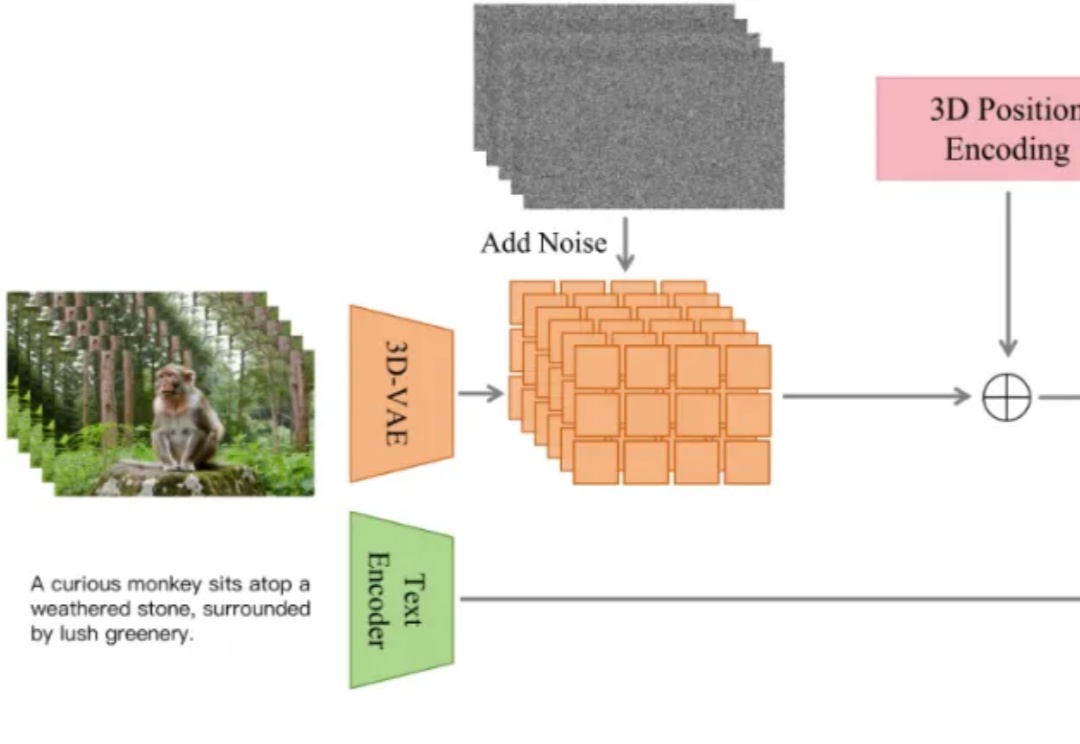

256块NPU训成8B视频模型、超越Sora等一众闭源!抖音内容技术团队开源ContentV近日,抖音内容技术团队开源了 ContentV,一种面向视频生成任务的高效训练方案。该方案在多项技术优化的基础上,使用 256 块 NPU,在约 4 周内完成了一个 8B 参数模型的训练。尽管资源有限,ContentV 在多个评估维度上取得了与现有主流方案相近的生成效果。

搜索

搜索

近日,抖音内容技术团队开源了 ContentV,一种面向视频生成任务的高效训练方案。该方案在多项技术优化的基础上,使用 256 块 NPU,在约 4 周内完成了一个 8B 参数模型的训练。尽管资源有限,ContentV 在多个评估维度上取得了与现有主流方案相近的生成效果。

Manus疯狂更新,视频生成也来了!

近半年来,OpenAI 形象开始变得灰暗: 团队骨干相继离职引发猜疑、组织转型遭受口诛笔伐、GPT-4.5/Sora 等模型表现不及预期,还有被 DeepSeek R1 打破的叙事神话……

就在刚刚,全球首款实时摄像头重磅诞生!从此,AI视频生成的「实时性」和「沉浸感」被重新定义,全行业都有了颠覆性方案。

当ChatGPT写出的情诗让文青落泪,当Sora生成的短片在电影节获奖,AI早已越过工具的边界,成为娱乐业的共创者。而在音乐领域,这场变革更为剧烈。从音乐创作到音乐消费,从内容生产到用户体验,人工智能技术正在重塑整个音乐产业的底层逻辑。

当OpenAI、谷歌还在用Sora等AI模型「拍视频」,英伟达直接用视频生成模型让机器人「做梦」学习!新方法DreamGen不仅让机器人掌握从未见过的新动作,还能泛化至完全陌生的环境。利用新方法合成数据直接暴涨333倍。机器人终于「做梦成真」了!

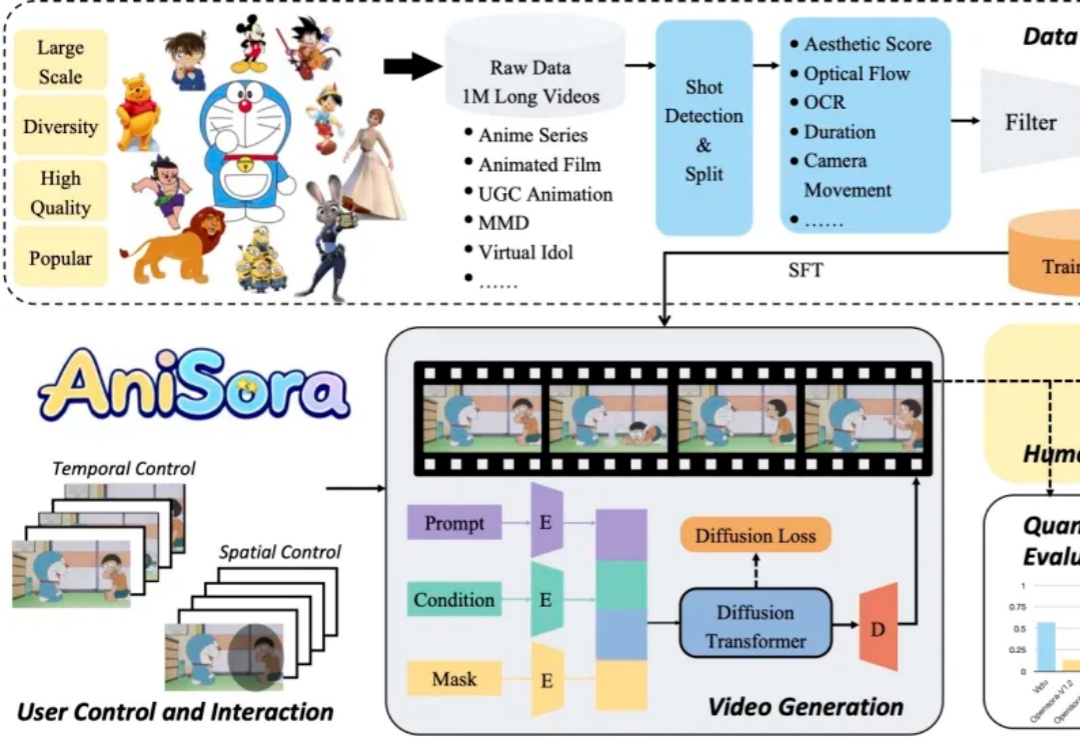

B 站开源动画视频生成模型 Index-AniSora,支持番剧、国创、漫改动画、VTuber、动画 PV、鬼畜动画等多种二次元风格视频镜头一键生成!

比起此前对生成时长、模型参数的强调,大半年来,不提Sora的AI视频玩家将这场“军备竞赛”的重点放在了三个维度上——卷一致性、卷可用性、卷可玩性。所谓的“一致性”指的是视频生成过程中帧与帧之间的过渡性、动作的连续性和场景的真实性等。

Sora、可灵等视频生成模型令人惊艳的性能表现使得创作者仅依靠文本输入就能够创作出高质量的视频内容。然而,我们常见的电影片段通常是由导演在一个场景中精心布置多个目标的运动、摄像机拍摄角度后再剪辑而成的。例如,在拍摄赛车追逐的场景时,镜头通常跟随赛车运动,并通过扣人心弦的超车时刻来展示赛事的白热化。

自 OpenAI 发布 Sora 以来,AI 视频生成技术进入快速爆发阶段。凭借扩散模型强大的生成能力,我们已经可以看到接近现实的视频生成效果。但在模型逼真度不断提升的同时,速度瓶颈却成为横亘在大规模应用道路上的最大障碍。