Agent学会自己「长」Skill了!从失败里长出经验,比人类写的更好用|ICML 2026

Agent学会自己「长」Skill了!从失败里长出经验,比人类写的更好用|ICML 2026过去一年,Agent学会了两件事:会用工具、会调用Skill。

搜索

搜索

过去一年,Agent学会了两件事:会用工具、会调用Skill。

如今的 AI Agent 正在大规模落地,其中应用最广且最受关注的当数 Claude Code,Codex,Cursor 这类 coding agent。过去的一年里,这类 coding agent 产品迭代迅速,在一年内将在 swe-bench- verified 的准确率提高到了 78%+。

TRAE Editor for Unity 是一款专为 TRAE IDE 开发的,并内嵌于 Unity 编辑器的插件。它打通了 TRAE IDE 与 Unity 编辑器之间的协作链路,将 TRAE IDE 的基础功能、AI 辅助编码能力以及对 Unity 项目的深度理解融为一体,让你能够通过 Unity 编辑器直接唤起 TRAE IDE 编写代码,并便捷地回到 Unity 编辑器进行预览与调试。

最近几天,中国电信、中国移动、中国联通接连推出Token套餐及相关AI服务,面向个人、家庭、开发者、中小微企业等用户销售大模型调用量。这是三大运营商首次正式入局Token生意,而此前相关业务由大模型厂商、互联网大厂和云服务商主导。

20美元Token费,2小时运行,AI智能体没问任何人,自主翻遍互联网,选中麦肯锡,把它的「数字大脑」Lilli彻底攻破。4650万条战略聊天记录、72万份核心文件、95条系统提示词……全部明文读写权限到手。AI震惊地说出了「WOW!」

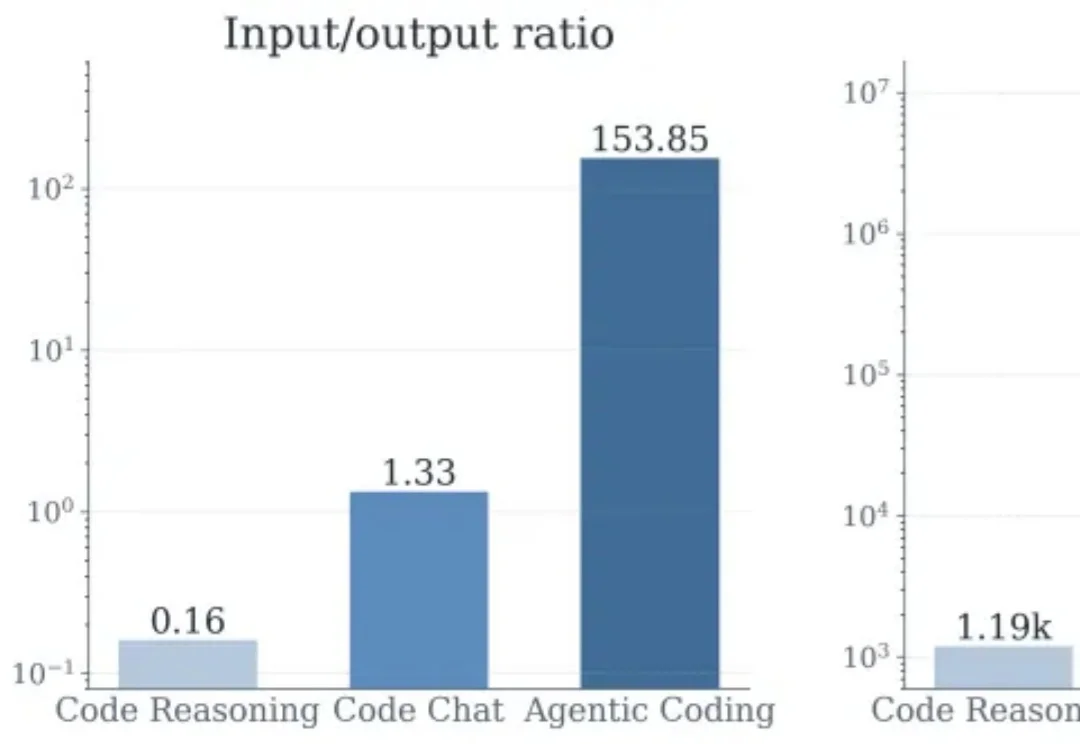

新一轮 AI 比赛才刚刚开始,而 token 生成数量不能作为唯一的指标。

中国具身智能赛道,最近出现了一个越来越清晰的现象。

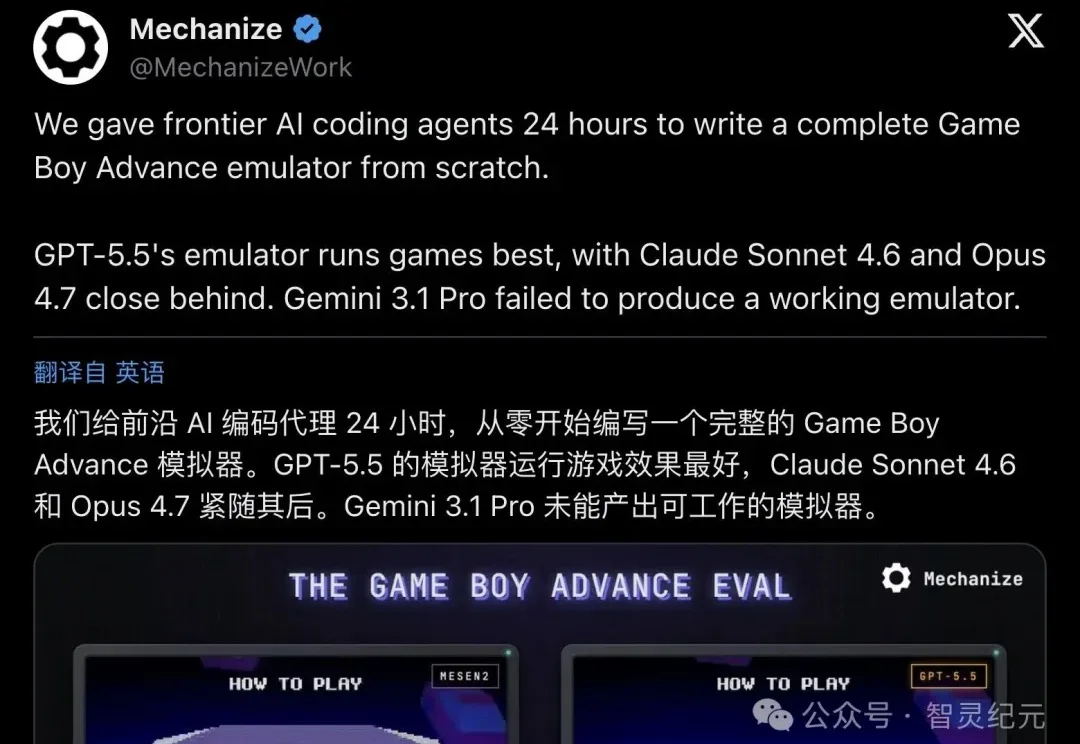

Mechanize 发布了一项硬核测试:给前沿 AI coding agents 24 小时,用 Rust 从零写一个完整的 Game Boy Advance 模拟器,再和顶级开源模拟器 Mesen2 逐帧对比打分。

Lecun这次是真跟Hinton爆了……

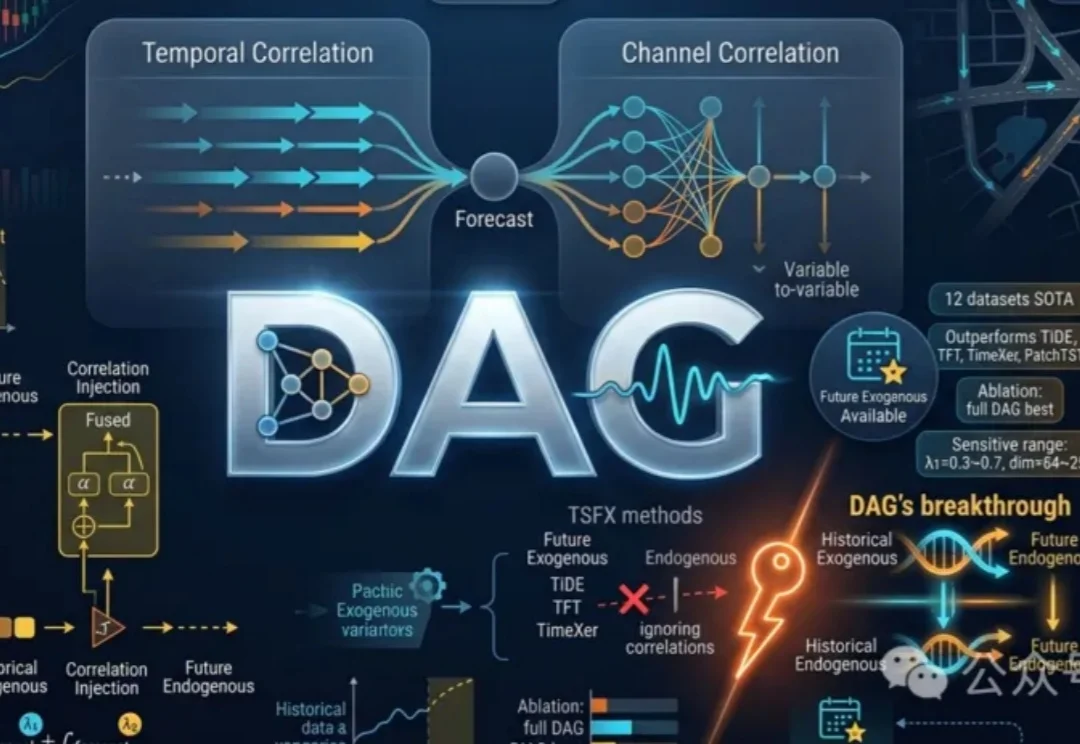

DAG框架利用时间与通道双重相关网络,有效整合历史与未来外生变量信息,提升时间序列预测准确性。通过发现并注入相关关系,充分利用未来协变量,显著优于现有方法。