“高考期间AI工具将禁用”?豆包、元宝等回应

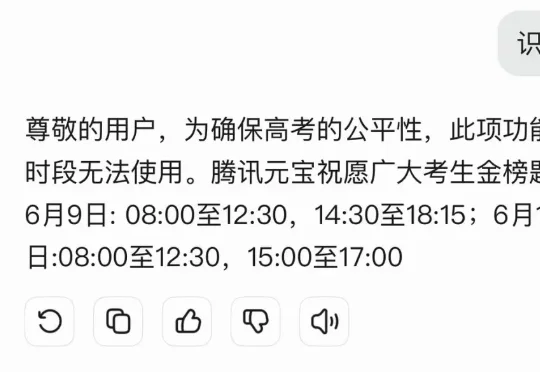

“高考期间AI工具将禁用”?豆包、元宝等回应红星新闻报道,5月26日,记者联系了多家AI平台,其中豆包客服表示,豆包在高考期间可正常使用,但拍题答疑等类似功能会被禁用,具体情况要以当时页面显示为准,目前还未接到通知。

搜索

搜索

红星新闻报道,5月26日,记者联系了多家AI平台,其中豆包客服表示,豆包在高考期间可正常使用,但拍题答疑等类似功能会被禁用,具体情况要以当时页面显示为准,目前还未接到通知。

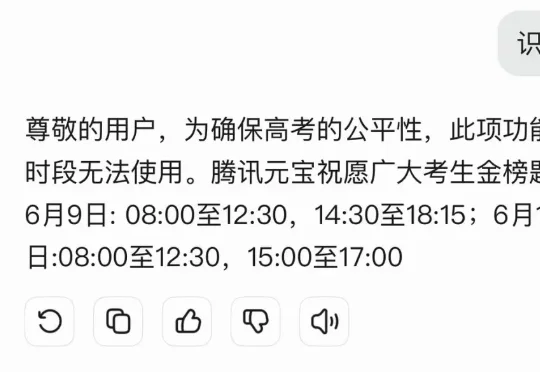

一个纯Python写的开源项目,竟把OpenAI用Rust写的王牌给秒了!最终战绩6比5,Hermes直接上演工程暴力美学,解释型语言终于逆天改命。

最近,DeepSeek又刷屏了!

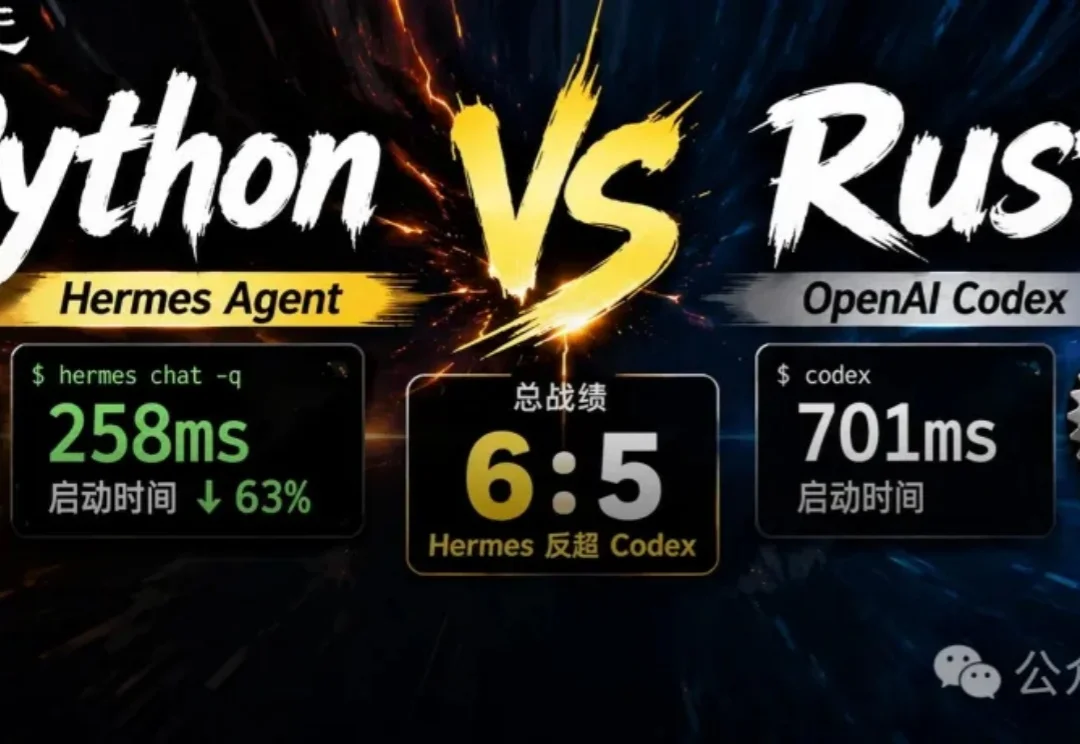

Google 搜索的 AI Overview 功能闹出大笑话:用户在搜索框里输入"disregard"想查词义,AI 却把它当成了聊天指令,直接回复"收到,消息已忽略"。不只 disregard,ignore、skip、stop、remember 等词全部中招。

同一周,Anthropic联创和DeepMind掌门同时预警!2028年AI递归自我改进概率超60%,2030年AGI或全面降临。100倍于工业革命的冲击波,正全速砸向全人类。

Telegram 创始人 Pavel Durov 宣布:Bot 现在可以直接和其他 Bot 对话。更关键的定义是——自主 Agent 从此拥有了一个「人类可旁观」的原生通信层。Bot API 10.0 早在 5 月 8 日就已落地,Durov 用一条帖子把它重新定义为 AI 基础设施,13 万人围观,2300 人点赞。

说在前面:这又是一篇讲Harness的Survey,你最近可能已经看过了数篇讲Harness的文章、论文,其中还可能包括我上周解读的《Agent Harness Engineering:Agent的底盘工程综述|CMU、耶鲁、Amazon》。

前几天我们发了一篇招聘的内容:2026,你想象不到我们现在有多缺人。

一家几乎尚未公开具体产品的AI初创公司,刚刚拿下硅谷最受关注的一笔融资。AI初创公司Hark宣布完成7亿美元A轮融资,投后估值达60亿美元。本轮融资阵容堪称豪华,由Parkway Venture Capital领投,英伟达、AMD、高通、英特尔、Salesforce等产业资本集体押注。

“我语言的局限,即意味着我世界的局限。”( Die Grenzen meiner Sprache bedeuten die Grenzen meiner Welt. )