对话英诺王建明:机器人目前面临的核心问题是数据 | GAIR 2025

对话英诺王建明:机器人目前面临的核心问题是数据 | GAIR 2025最终能把机器人做成功的,还是机器人行业内的人。

最终能把机器人做成功的,还是机器人行业内的人。

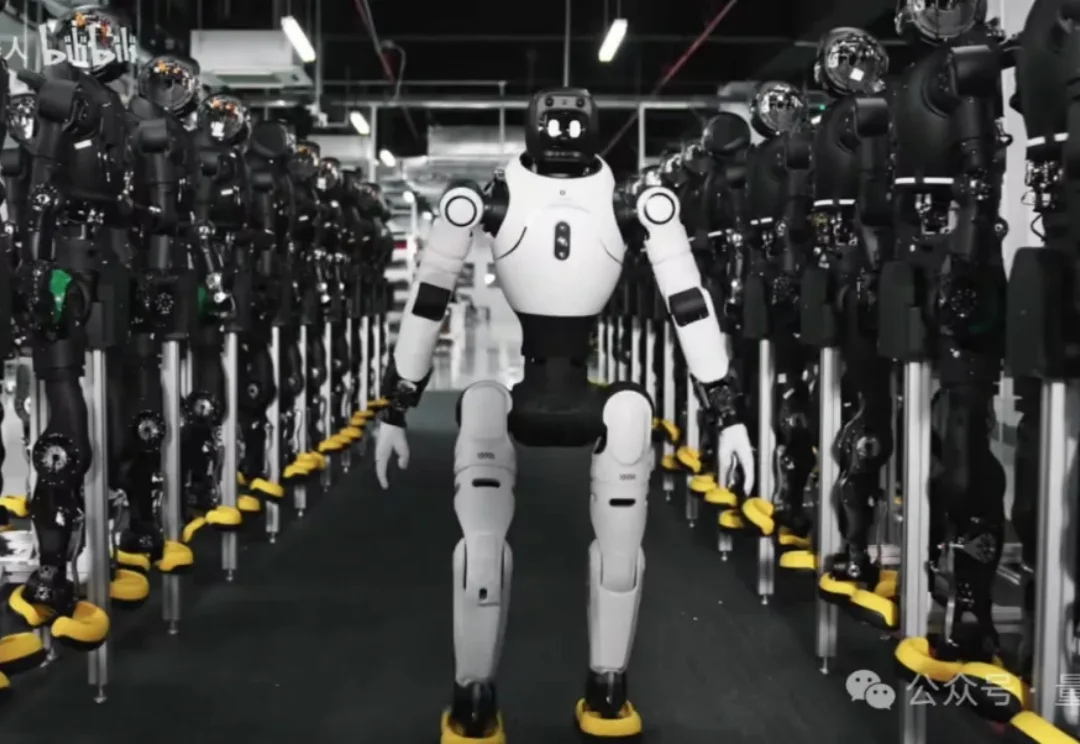

33岁拥有5000台机器人是什么体验?

翻车是真的,希望也是真的。

目标物理世界的“ChatGPT时刻”。

周末的一场顶级赛事,彻底撕碎了实验室的「滤镜」!全球13支精英战队的机器人上演连环翻车:过吊桥卡腿、爬阶梯摔跤,堪称一场机器人的「荒野求生」。

本科毕业于北大工学院,早期研究聚焦于自动驾驶;博士后期间在卡内基梅隆大学,利用强化学习解决核聚变反应堆控制问题。陈佳玉的科研生涯,始终围绕着复杂系统的智能控制展开。

在具身智能与视频理解飞速发展的今天,如何让 AI 真正 “看懂” 复杂的操作步骤?北京航空航天大学陆峰教授团队联合东京大学,提出视频理解新框架。该工作引入了 “状态(State)” 作为视觉锚点,解决了抽象文本指令与具象视频之间的对齐难题,已被人工智能顶级会议 AAAI 2026 接收。

优理奇机器人(UniX AI)近日宣布完成两轮合计3亿元天使++++轮及天使+++++轮融资,由川商基金、吴中金控、益华资本、青域基金、太浩创投等机构,以及若干上市公司及产业方参与投资,老股东赛纳资本追加投资。

作者在包含 50 多个任务的多个仿真和真实世界场景中评估了 SpatialActor。它在 RLBench 上取得了 87.4% 的成绩,达到 SOTA 水平;在不同噪声条件下,性能提升了 13.9% 至 19.4%,展现出强大的鲁棒性。目前该论文已被收录为 AAAI 2026 Oral,并将于近期开源。

具身智能如何突破「遥操作」的数据桎梏?商汤联合创始人王晓刚领衔的大晓机器人,交出颠覆性答卷——发布全球首个开源商业落地世界模型「开悟3.0」。