上海交大林云:揭秘大模型的可解释性与透明度,AI 编程的未来在这里

上海交大林云:揭秘大模型的可解释性与透明度,AI 编程的未来在这里在软件开发的世界里,代码的生成、编辑、测试和调试一直是核心活动。

在软件开发的世界里,代码的生成、编辑、测试和调试一直是核心活动。

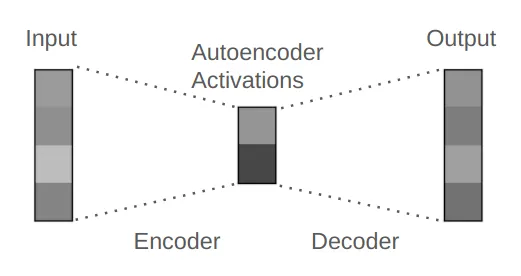

简而言之:矩阵 → ReLU 激活 → 矩阵

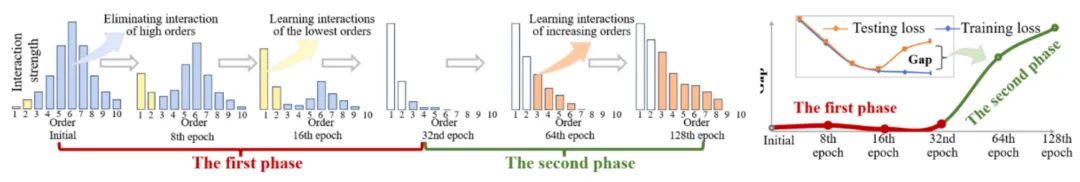

本文首先简单回顾了『等效交互可解释性理论体系』(20 篇 CCF-A 及 ICLR 论文),并在此基础上,严格推导并预测出神经网络在训练过程中其概念表征及其泛化性的动力学变化,即在某种程度上,我们可以解释在训练过程中神经网络在任意时间点的泛化性及其内在根因。

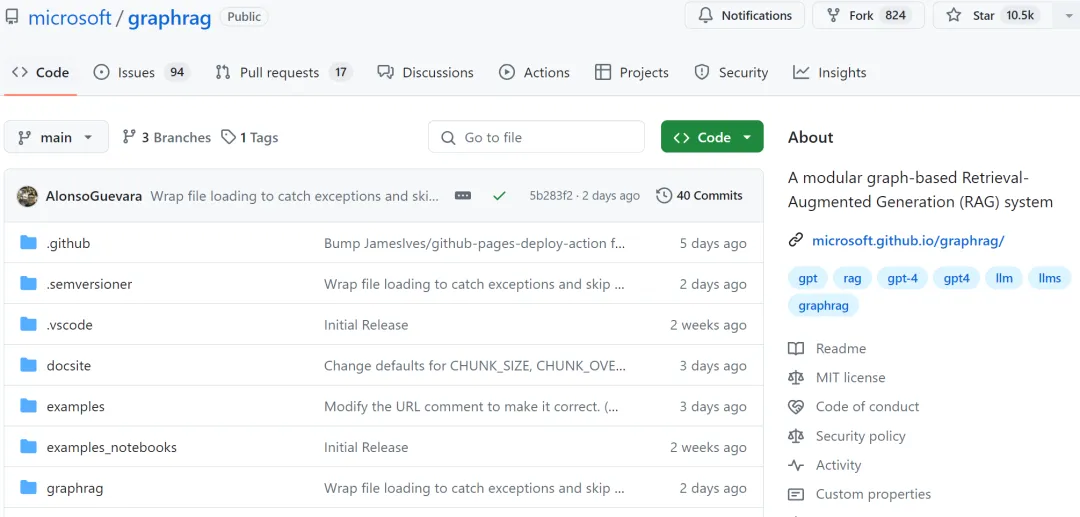

LLM 很强大,但也存在一些明显缺点,比如幻觉问题、可解释性差、抓不住问题重点、隐私和安全问题等。检索增强式生成(RAG)可大幅提升 LLM 的生成质量和结果有用性。

大模型当上福尔摩斯,学会对视频异常进行检测了。 来自华中科技大学、百度、密歇根大学的研究团队,提出了一种可解释性的视频异常检测框架,名为Holmes-VAD。

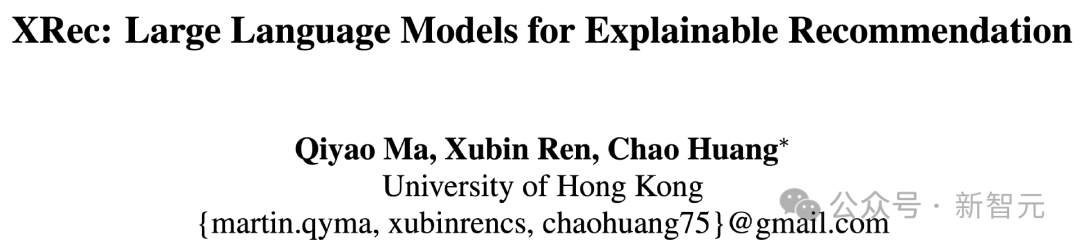

香港大学推出的XRec模型通过融合大型语言模型的语义理解和协同过滤技术,增强了推荐系统的可解释性,使用户能够理解推荐背后的逻辑。这一创新成果不仅提升了用户体验,也为推荐技术的未来发展提供了新方向和动力。

今天,OpenAI发布了一篇GPT-4可解释性的论文,似乎是作为前两天员工联名信的回应。网友细看论文才发现,这居然是已经解散的「超级对齐」团队的「最后之作」。

CRATE-α是一种新型Transformer架构变体,通过设计改进提升了模型的可扩展性、性能和可解释性,CRATE-α-Base在ImageNet分类任务上的性能显著超过了之前最好的CRATE-B模型,其性能会随着模型和数据集规模扩大而继续提升。

本文介绍了KAN网络算法的原理和优势,探讨了其在深度学习领域可能引发的范式转变。 • ⚡ KAN网络将可学习的激活函数从神经元移到了神经网络的边上,表现出更高的准确性和更少的参数量 • ???? KAN在数学和物理领域的实验中展现了卓越性能,提供了一种新的科学发现的路径 • ???? KAN具有更快的神经缩放定律和可解释性,为AI领域带来了新的探索可能性

如何突破 Transformer 的 Attention 机制?中国科学院大学与鹏城国家实验室提出基于热传导的视觉表征模型 vHeat。将图片特征块视为热源,并通过预测热传导率、以物理学热传导原理提取图像特征。相比于基于Attention机制的视觉模型, vHeat 同时兼顾了:计算复杂度(1.5次方)、全局感受野、物理可解释性。