中国首个海洋领域开源大模型OceanGPT(沧渊)发布!海洋精准感知技术全国重点实验室(浙江大学)牵头研发

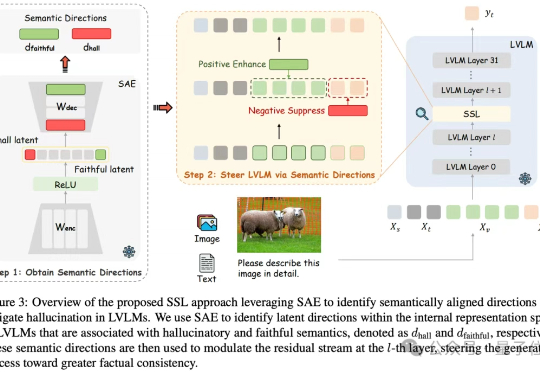

中国首个海洋领域开源大模型OceanGPT(沧渊)发布!海洋精准感知技术全国重点实验室(浙江大学)牵头研发该大模型由海洋精准感知技术全国重点实验室(浙江大学)牵头研发,具备基础的海洋专业知识问答,以及声呐图像、海洋观测图等海洋特色多模态数据的自然语言解读能力。其采用的领域知识增强“慢思考”推理机制,相较现有通用大模型能有效降低幻觉式错误。

搜索

搜索

该大模型由海洋精准感知技术全国重点实验室(浙江大学)牵头研发,具备基础的海洋专业知识问答,以及声呐图像、海洋观测图等海洋特色多模态数据的自然语言解读能力。其采用的领域知识增强“慢思考”推理机制,相较现有通用大模型能有效降低幻觉式错误。

扎克伯格又从奥特曼手里挖走4名顶尖AI人才,这次四位都是华人研究员。

就在昨夜,阿里带着全新多模态模型Qwen-VLo开启炸场模式。据介绍,Qwen-VLo在阿里原有的多模态理解和生成能力上进行了全面升级,具备三大亮点:

又一家A股上市公司冲刺“A+H”!6月26日,上海AI产品公司合合信息递表港交所。招股书显示,合合信息是一家原生AI(AI-native)公司,已成为全球多模态大模型文本智能技术的领先者,业务已覆盖全球超过200个国家和地区,3款C端产品拥有数亿全球用户群,是少有的同时在中国和全球拥有成规模用户量的原生AI公司。

通过“视觉神经增强”机制,直接放大模型中的视觉关键注意力头输出,显著降低模型的幻觉现象。

GPT-5,已经被OpenAI员工抢先用上了?就在今天,奥特曼在X上关注了一个神秘人,引起全网猜测。不止两人爆料,自己可能提前体验了GPT-5,甚至也有网友疑似被灰度测试到了。今夏推出的GPT-5,已经掀起全网疯狂!

今天,我们正式发布 jina-embeddings-v4,一款全新的多模态向量模型,参数规模达到 38 亿,并首次实现了对文本与图像的同步处理。

本周五凌晨,谷歌正式发布、开源了全新端侧多模态大模型 Gemma 3n。谷歌表示,Gemma 3n 代表了设备端 AI 的重大进步,它为手机、平板、笔记本电脑等端侧设备带来了强大的多模式功能,其性能去年还只能在云端先进模型上才能体验。

开源且免费!谷歌对编程Agent出手了。

第一作者孙秋实是香港大学计算与数据科学学院博士生,硕士毕业于新加坡国立大学数据科学系。